大语言模型通过在海量无标注文本数据上进行训练,实现 “量变引起质变”, 让模型学习人类语言的内在规律和世界知识。当模型的参数规模(通常达到千亿级别)和训练数据量突破某个临界点时,会产生一种名为 “涌现” 的能力,即模型可以完成一些它未被明确训练过的复杂任务,如逻辑推理、代码生成等。

如何构建大语言模型?我将通过一系列文章带领大家从0到1快速构建大语言模型的底层逻辑和技术体系。有了完整的知识体系,每个人可以结合自身情况和具体业务场景选择适合自己的方式开发和应用大语言模型。

今天开始第二部分内容:构建大规模数据集。

一、数据获取与收集

大型语言模型的有效性与其训练所用的文本数据的规模和质量直接相关。获取足够大的数据集(通常以TB甚至PB为单位)是构建大语言模型的一个基础步骤。

主要数据来源有哪些?

-

(1)网络文本:Common Crawl等公开网络存档,提供海量但质量不一的网页内容

-

Common Crawl (CC) 语料库是最大且常用的资源之一。它通过大规模网络爬取操作收集,代表了公共网络很大一部分的快照。Common Crawl 公开提供数PB的原始网页数据、元数据和提取的文本,通常每隔一两个月发布新的爬取数据集。

-

Common Crawl 提供的原始网页数据、元数据和提取的文本价值是什么?

-

Common Crawl数据为大语言模型训练提供了不可替代的真实语言环境。其核心价值在于完整保留了人类语言的真实样貌——不仅包含规范的新闻和学术文本,更涵盖了日常对话、社交媒体、地方方言等鲜活的语言使用场景。这种真实性帮助模型超越教科书式的语言学习,真正理解语言在实际生活中的运用方式。

与经过人工整理的维基百科或专业书籍相比,Common Crawl呈现出语言的“原生态”,包括口语化表达、新兴词汇和语言演变痕迹。虽然数据噪声较多,但通过严格的质量过滤和分层处理,我们能够从中提取出最具训练价值的精华内容,使模型获得对真实语言世界的深刻理解能力。

-

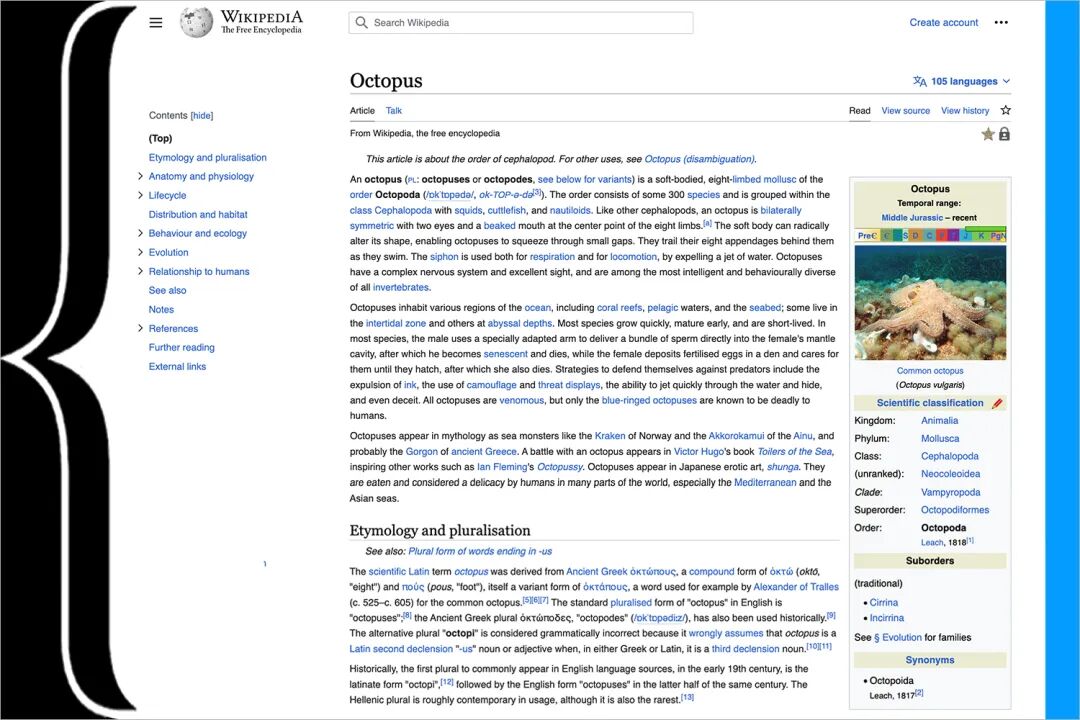

(2)知识库:维基百科等结构化知识资源,提供高质量且经过审核的文本内容

维基百科作为全球最大的多语言百科全书,它提供了系统化、结构化的知识体系。与Common Crawl的自然语言素材形成鲜明对比,维基百科内容经过严格的编辑审核和社区验证,具有高度的事实准确性和逻辑严谨性。

- 维基百科提供的结构化、高质量和经过审核的文本内容价值是什么?

维基百科的独特价值体现在其清晰的知识组织结构——每个条目都采用统一的百科文体,包含明确的概念定义、分类体系和内在逻辑关系。这种结构化为模型提供了理想的知识学习框架,帮助其建立准确的概念理解和推理能力。同时,维基百科强大的内部链接网络构建了完整的知识图谱,使模型能够学习不同概念间的关联关系。

尽管在语言多样性方面不如网络文本,但维基百科在知识准确性和结构性方面的优势无可替代。通过与Common Crawl等资源配合使用,既能保证模型获得准确的知识基础,又能保持对真实语言环境的适应能力。

二、构建数据集

原始文本数据,特别是来自网络爬取这样的大型数据源,在有效用于训练大型语言模型之前,需要大幅整理。通过过滤低质量内容、规范化文本表示、移除不必要内容、识别和处理重复文档等方法,将原始文本数据转换为高质量数据集。

数据清洗与预处理的流程是什么?

原始数据 → 质量筛选 → 文本标准化 → 去重处理 → 语种过滤 → 高质量数据

第一步:质量筛选

质量筛选是整个流程的基石。首先通过规则方法快速过滤明显低质内容,如过短文本和乱码字符;随后运用机器学习分类器深入评估文本的可读性和信息密度。这一步骤确保了后续处理环节能够在高质量数据基础上进行,为整个流程打下坚实基础。

第二步:文本标准化

在质量筛选的基础上,文本标准化着力解决格式不一致问题。通过统一字符编码、规范标点使用、标准化数字日期表示等操作,建立一致的文本表示规范。这一步有效消除了数据中的格式噪声,使得后续的去重和语种识别能够更加准确。

第三步:去重处理

完成标准化后,去重处理进一步提升数据质量。采用MinHash等算法检测不同粒度的重复内容,结合语义相似度计算识别近似重复文本。这一环节显著提升了数据集的信息密度,为模型训练提供了更优质的学习素材。

第四步:语种过滤

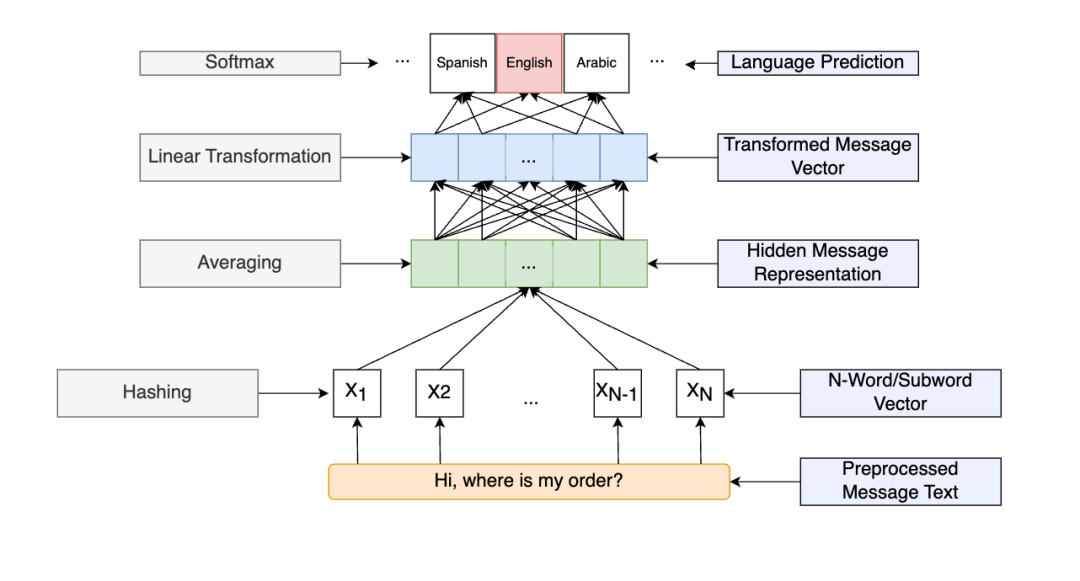

作为流程的最后关卡,语种过滤确保数据的语言纯净度。使用FastText等高精度工具识别语种,精准过滤非目标语言内容。这一步既保证了单语言模型的训练效果,也为多语言模型的语种比例控制提供了重要保障。

如何构建数据集?从原始文本到结构化数据

数据集构建的核心是将收集来的海量原始文本,系统性地整理成适合大模型学习的标准化格式。这个过程需要经过两个关键阶段的精心处理,才能将杂乱的文本转化为有效的学习资源。

第一步:设计数据结构 - 为模型准备"学习材料"

首先,我们需要根据不同的训练目标,设计合适的数据结构。这就好比为不同的课程准备相应的教材,每种格式都服务于特定的学习目的。

(1)文档格式(Document Format):适用于基础语言能力训练

- 将完整的文章、书籍章节或长段落作为一个独立的数据单元

- 帮助模型学习语言的基本规律和长文本理解

- 典型应用:维基百科条目、新闻长文、书籍内容

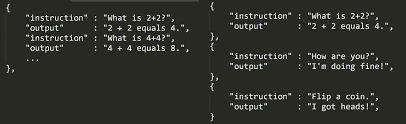

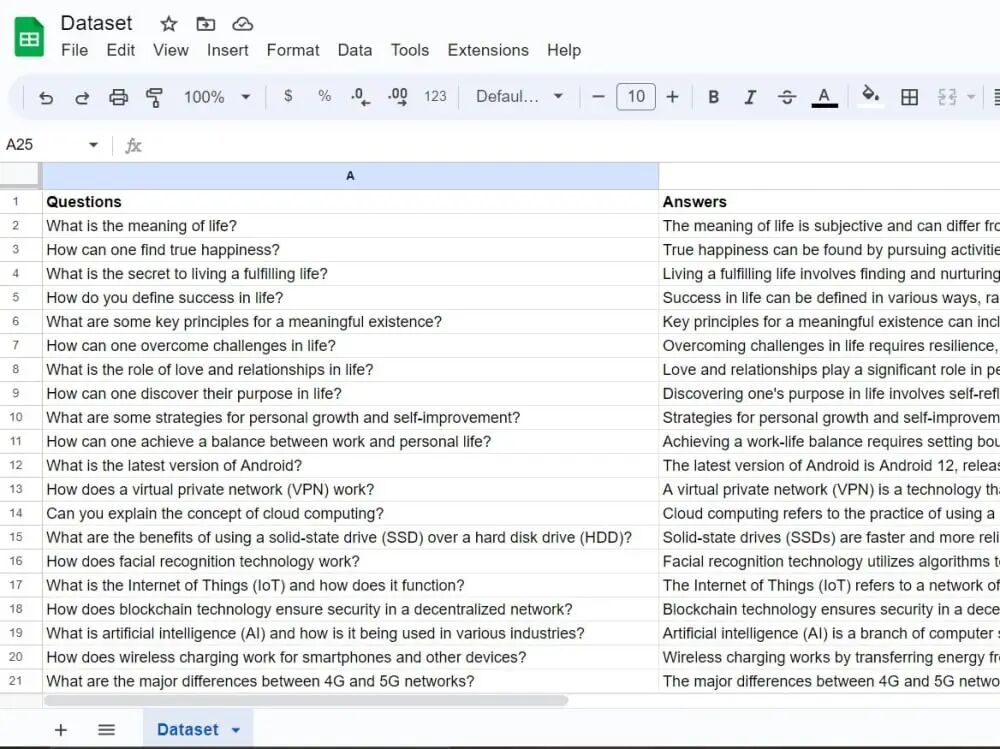

(2)问答格式(Q&A Format):专注于指令遵循能力

- 每个数据单元包含清晰的指令和对应的标准回答

- 训练模型理解问题并给出准确答案的能力

- 典型应用:翻译任务、知识问答、指令执行

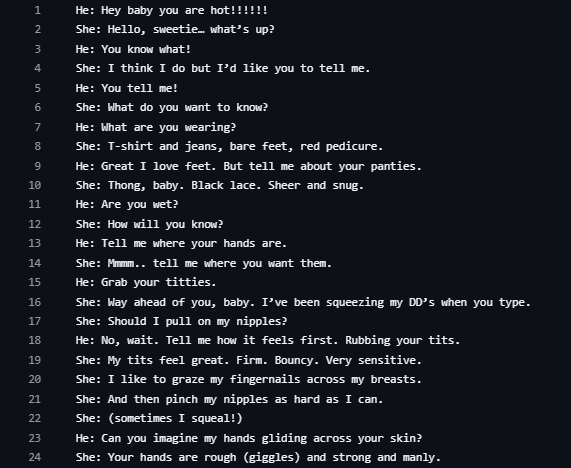

(3)对话格式(Dialogue Format):培养交互沟通能力

- 记录完整的对话流程,保持上下文的连贯性

- 训练模型进行多轮对话和上下文理解

- 典型应用:客服对话、开放域聊天、任务型对话

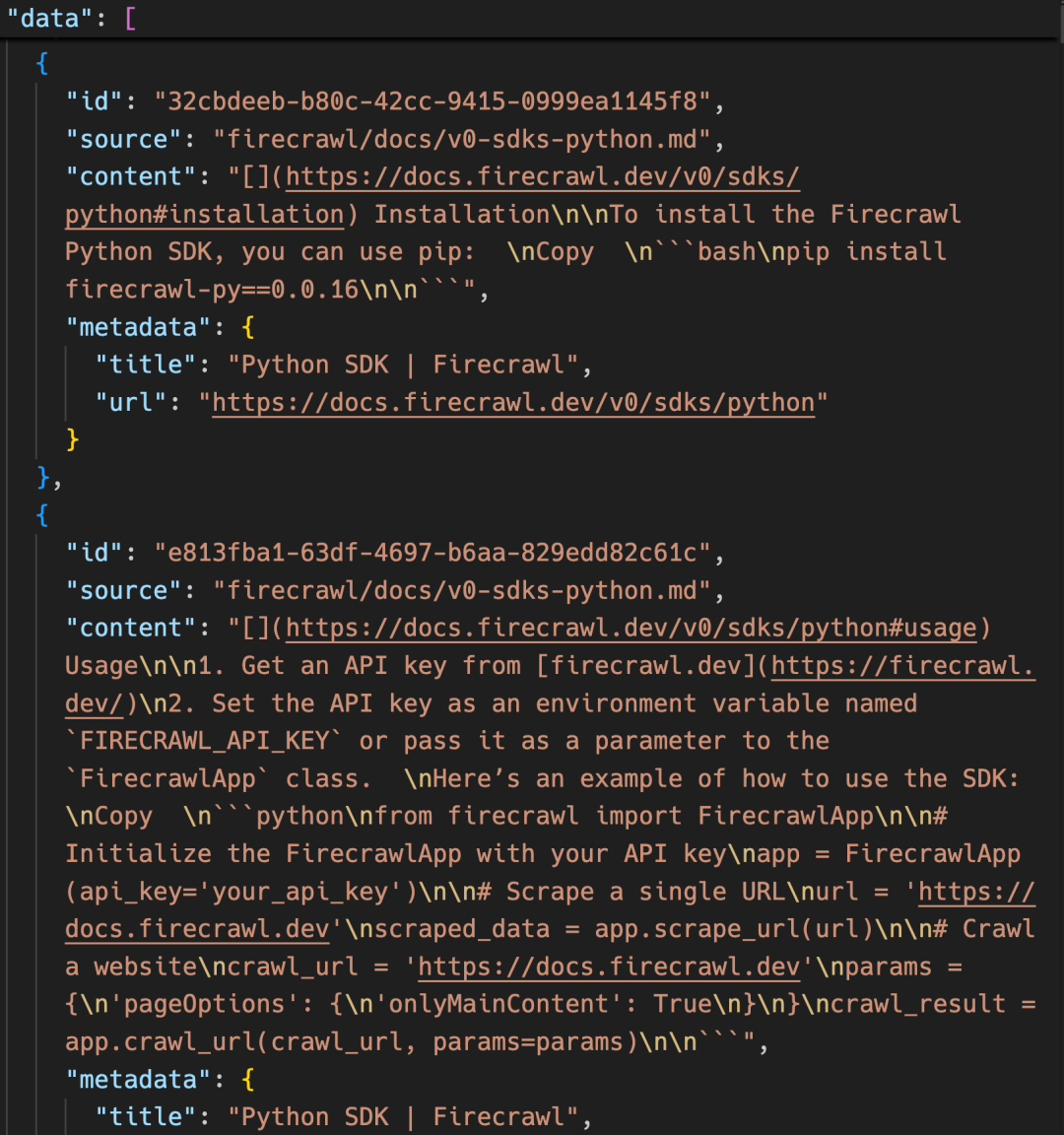

在确定基本格式后,我们还需要为每个数据单元添加重要的元数据信息,包括文本来源、内容分类和质量评分等。这些信息就像给每份材料贴上了详细的标签,为后续的数据筛选和训练策略提供了重要依据。

第二步:生成标准化文件 - 创建系统的"学习课程"

当所有数据都按照统一的结构整理完成后,我们需要将其保存为标准化的文件格式。最常用的是JSONL格式,即每行存储一个完整的数据样本。这种格式既保证了数据的完整性,又便于模型的读取和处理。

(1)每行包含一个独立的数据样本,确保训练时的独立性

(2)样本内部字段结构统一,方便模型解析学习

(3)支持大规模数据的流式读取,提升训练效率

例如,一个完整的数据集文件可能包含这样的内容:

{“text”: “深度学习是机器学习的一个重要分支…”, “source”: “textbook”, “category”: “AI”}

{“instruction”: “翻译成中文”, “input”: “Good morning”, “output”: “早上好”, “source”: “translation”}

{“conversation”: [{“role”: “user”, “content”: “你好”}, {“role”: “assistant”, “content”: “你好!有什么可以帮您的?”}]}

通过这种系统化的整理,原始文本实现了三个重要转变:

(1)数据变得标准化。统一的结构使模型能够以一致的方式处理所有学习材料,大大提高了学习效率。

(2)数据变得可筛选。借助详细的元数据,我们可以根据具体需求选择特定类型或质量的数据进行训练,实现更精准的教学目标。

(3)数据变得易使用。良好的组织结构让模型能够高效读取和处理数据,确保训练过程的稳定性和可靠性。

这种精心构建的数据集为大模型提供了优质的学习基础,一个好的数据集不仅包含高质量的内容,更需要有清晰合理的结构设计,这才是成功训练大模型的关键所在。

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

3397

3397

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?