您可能已经了解到过去几个月发布的大量 AI 应用程序。您甚至可能已经开始使用其中的一些。

ChatPDF和CustomGPT AI等 AI 工具已经对人们变得非常有用——这是有充分理由的。您需要滚动浏览 50 页文档才能找到简单答案的日子已经一去不复返了。相反,您可以依靠 AI 来完成繁重的工作。

但是这些开发人员究竟是如何创建和使用这些工具的呢?好吧,他们中的许多人都在使用一个名为 LangChain 的开源框架。

在本文中,我将向您介绍 LangChain,并向您展示如何将其与 OpenAI 的 API 结合使用来创建这些改变游戏规则的工具。希望我能激发你们中的一员提出自己的想法。让我们开始吧!

(人工智能教程:java567.com/search.html?sWord=%E4%BA%BA%E5%B7%A5%E6%99%BA%E8%83%BD&v=2306035)

浪链是什么?

LangChain是一个开源框架,允许 AI 开发人员将 GPT-4 等大型语言模型 (LLM) 与外部数据相结合。它以 Python 或 JavaScript (TypeScript) 包的形式提供。

如您所知,GPT 模型一直在 2021 年之前接受数据训练,这可能是一个重大限制。虽然这些模型的常识很丰富,但能够将它们连接到自定义数据和计算会打开许多大门。这正是 LangChain 所做的。

从本质上讲,它允许您的 LLM 在得出答案时参考整个数据库。因此,您现在可以让 GPT 模型以报告、文档和网站信息的形式访问最新数据。

最近,LangChain 的人气大幅飙升,尤其是在 3 月份推出 GPT-4 之后。这要归功于它的多功能性以及与强大的 LLM 搭配使用时打开的许多可能性。

LangChain 如何运作?

虽然您可能认为 LangChain 听起来很复杂,但实际上它很容易上手。

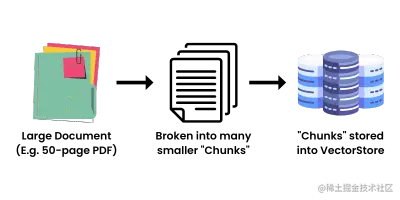

简而言之,LangChain 只是将大量数据组合在一起,LLM 可以使用尽可能少的计算能力轻松引用这些数据。它的工作原理是获取大量数据源,例如 50 页的 PDF,并将其分解为“块”,然后嵌入到 Vector Store 中。

创建向量存储的简单示意图

创建向量存储的简单示意图

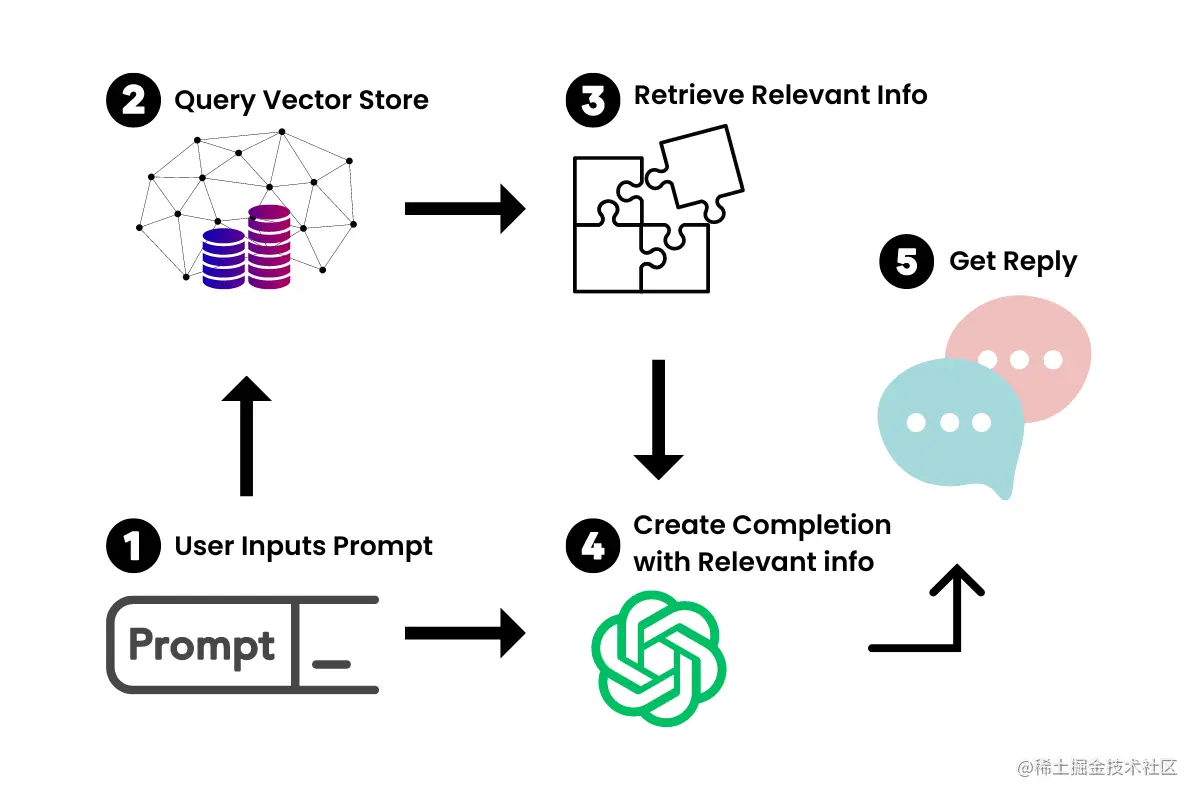

现在我们已经有了大型文档的矢量化表示,我们可以将其与 LLM 结合使用,以仅检索在创建提示-完成对时需要引用的信息。

当我们在新的聊天机器人中插入提示时,LangChain 将查询 Vector Store 以获取相关信息。将其视为您文档的迷你 Google。检索到相关信息后,我们会将其与提示一起提供给 LLM 以生成我们的答案。

LangChain 如何与 OpenAI 的 LLM 合作

LangChain 如何与 OpenAI 的 LLM 合作

LangChain 还允许您创建可以执行操作的应用程序——例如上网冲浪、发送电子邮件和完成其他与 API 相关的任务。查看AgentGPT,这是一个很好的例子。

这有很多可能的用例——这里只是我想到的几个:

- 个人 AI 邮件助理

- 人工智能学习伙伴

- 人工智能数据分析

- 定制公司客户服务聊天机器人

- 社交媒体内容创作助理

而这样的例子不胜枚举。我将在以后的文章中介绍正确的构建教程,敬请期待。

如何开始使用朗链

LangChain 应用程序由 5 个主要组件组成:

- 模型(LLM 包装器)

- 提示

- 链条

- 嵌入和向量存储

- 代理商</

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1293

1293

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?