从开发到运行时保护您的AI应用生态系统

关键字: [Amazon Web Services re:Invent 2024, 亚马逊云科技, 生成式AI, Prisma Cloud, Ai Application Ecosystem, Data Exposure Risks, Runtime Security, Prompt Injection Attacks, Model Protection]

导读

随着人工智能应用引入新的组件,如模型、插件和数据集,每个元素都带来独特的风险。了解Palo Alto Networks和Precision AI如何帮助您管理整个AI生命周期的风险,并检测和预防多态威胁。探索Palo Alto Networks的“安全AI设计”产品:AI安全态势管理和AI运行时安全。这些解决方案保护您的整个AI技术栈——涵盖数据、供应链、应用程序和运行时——确保您的AI/ML环境安全、合规且具有弹性。本演示由亚马逊云科技合作伙伴Palo Alto Networks为您带来。

演讲精华

以下是小编为您整理的本次演讲的精华。

科技世界正在飞速发展,人工智能(AI)正在改变各个行业。在2024年亚马逊云科技 re:Invent大会上,Palo Alto Networks产品管理高级总监Jamie Patel热情洋溢地欢迎观众,届时将探讨保护AI应用生态系统的问题,从开发到运行时,这在AI大规模应用的时代至关重要。

Palo Alto Networks的Prisma Cloud中负责DSPM和AI SPN产品的Jotam Ben Ezra与Jamie一同登台。Jotam拥有丰富的网络安全经验,他认识到我们正生活在令人兴奋的时代,AI正在革新金融服务、制药和政府等行业。他强调AI的采用速度前所未有,这得益于它在提高生产力和效率方面的能力。

AI融入的应用程序数量惊人,已有数千个存在。Jotam解释说,企业在两个主要领域采用AI:员工利用AI应用程序来提高日常工作效率,以及企业将AI构建到自己的应用程序中。这种双重采用创造了一个复杂的生态系统,需要谨慎考虑和安全措施。Jotam表示:“我们已经有数千个AI融入的应用程序存在。几乎每个SaaS应用程序今天都开始融入AI。”

对于使用AI应用程序的员工,安全团队面临的挑战是维护对使用哪些应用程序的可见性、它们的可信度,以及控制流向这些应用程序的数据。Palo Alto Networks的AI访问安全解决方案通过自动生成对数千个应用程序的可见性来解决这一问题,使组织能够监控使用情况、应用政策并控制允许流向这些应用程序的数据。

然而,本次会议的重点是企业构建自己的AI应用程序。Jotam描绘了当今典型企业的画面,各个团队正在开发AI驱动的解决方案,如IT助手、支持聊天机器人和面向客户的应用程序的协作伙伴。这些AI应用程序融入到现有的应用程序基础设施中,包括AI模型、基础设施、数据、插件和代理。他说:“现在,如果你是一家典型的企业,你的IT团队正在构建一个IT助手来加快案例解决。你的服务团队正在构建支持聊天机器人以提供更好的客户支持。也许应用程序团队正在为不同的面向客户的应用程序构建协作伙伴,也许还有十几个其他用例正在组织内的不同阶段进行。”

这个复杂生态系统的每个组件都带来了潜在的安全风险。无论是由云服务提供商管理、自主开发还是自托管的AI模型都存在风险。作为AI管道一部分部署的基础设施、为模型提供能力的数据,以及促进组件之间信息传输的插件和代理,都存在必须解决的漏洞。Jotam强调:“无论是在基础设施层、模型层、数据集层还是插件和代理层,这些不同的组件都可能存在潜在的安全风险,每一层都可能存在供应链问题、错误配置问题或漏洞暴露。”

为了说明这些风险,Jotam向观众展示了几个常见的AI管道示例及其相关的安全问题。第一个示例涉及一个部分自动化访问管理的IT助手代理。在这种情况下,凭证泄露可能使攻击者能够劫持模型,这种技术被称为“LLM劫持”。这不仅使攻击者可以免费访问模型(可能产生巨大成本),而且还为通过提示工程攻击渗透敏感数据打开了大门。Jotam表示:“有证据表明,在某些情况下,与我们的模型交互的攻击者试图渗透敏感数据。所以在我们的案例中,IT知识库可能包含机密数据,通过不同的提示工程技术与模型交互可能会获取原始数据。”

第二个示例关注客户支持聊天机器人,在训练或推理过程中的数据污染攻击可能会严重影响模型的行为。Jotam强调,即使被污染的数据比例不到1%,如果执行正确,也可能对模型的输出产生深远影响。他说:“结果表明,攻击者实际上不需要改变大量数据就能做到这一点,所以即使不到1%的数据被污染,如果做得正确或错误,也可能导致行为发生重大变化。”此外,还存在模型被盗和存储在数据库中的对话历史记录暴露的风险。Jotam解释道:“如果暴露了,这意味着他们现在拥有了我们的模型,可以使用它。它可能是专有的,可能是秘密的。我们还有Amazon DynamoDB数据库,其中存储了所有与该模型交互的提示历史记录。如果我们没有妥善保护存储此对话历史记录的方式,或者没有妥善保护与此模型交互的提示的存储方式,那么我们就有失去这些数据的风险。”

在这个客户支持聊天机器人示例中,Jotam描述了架构包括客户和提示进入管道,对话历史记录保存在Amazon DynamoDB数据库中,Lambda函数从中获取并发送到使用Amazon SageMaker训练的自管理模型。还有一个用于微调模型的数据集,存储在Amazon S3存储桶中,另一个存储桶存储经过训练的模型本身。

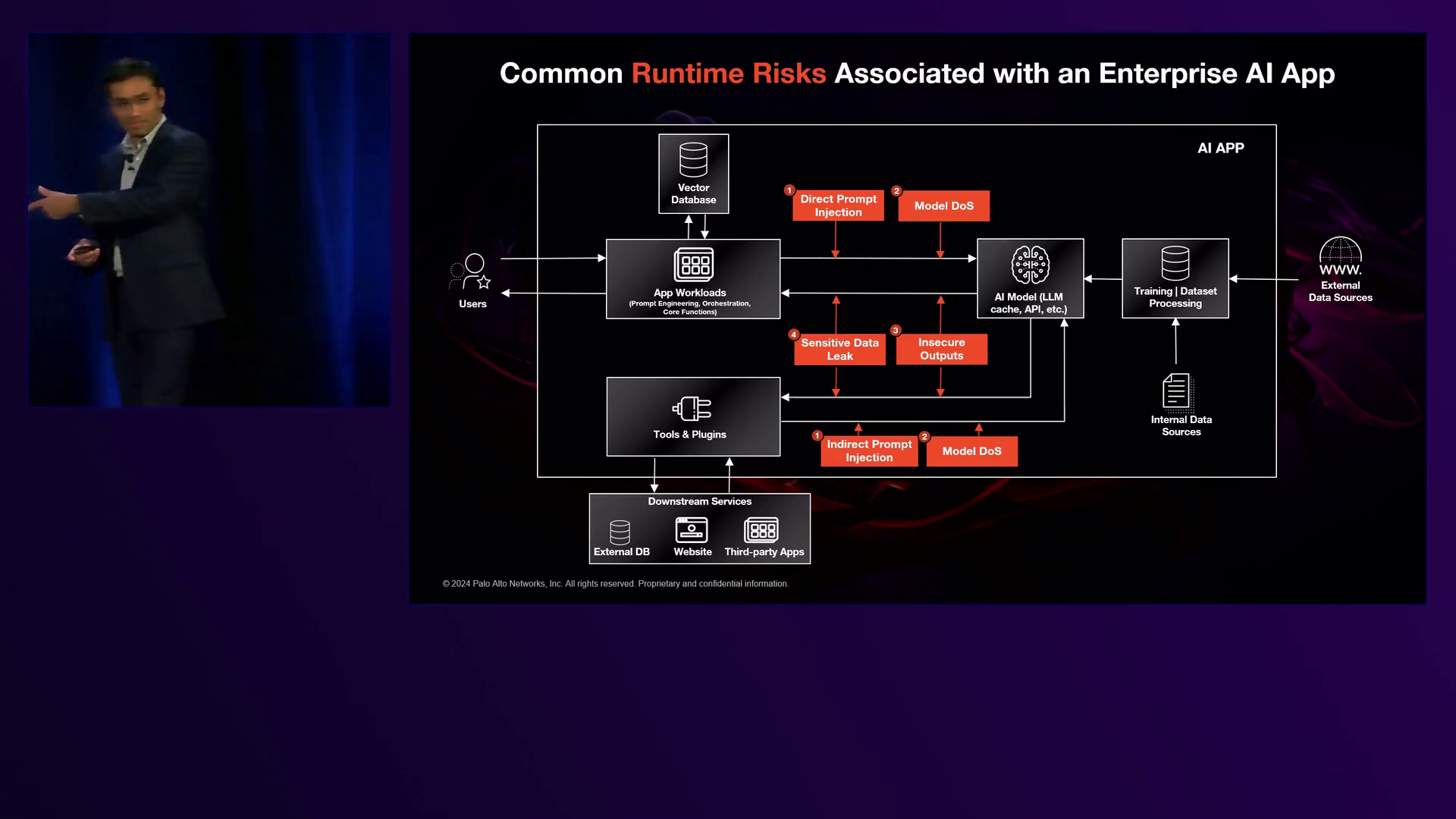

在讨论了开发阶段的风险之后,Jamie Patel将讨论转移到生产中的GenAI(生成式AI)应用程序所面临的运行时风险。他承认,在未来三年内,几乎所有企业都将拥有生产中的GenAI应用程序,这凸显了解决这些风险的紧迫性。Jamie提到:“根据我们与CSO、CIO和所有客户的对话,在未来三年内,他们中几乎100%的人都将至少在生产中拥有GenAI应用程序。”

AI应用程序与标准Web应用程序的关键区别在于扩展的技术栈。AI应用程序包含模型、向量数据库、训练数据集和自主代理等组件,而这些组件在传统Web应用程序中是不存在的。因此,AI应用程序不仅面临Web应用程序所面临的标准攻击,还面临一系列新的AI特定威胁。Jamie解释道:“AI应用程序也是Web应用程序,但它具有更扩展的技术栈,这意味着它具有标准Web应用程序可能没有的模型。与这些模型交互可能是基础模型或微调模型。我们有向量数据库的概念,称为影响数据集和训练数据集。这些概念在标准Web应用程序中是缺失的。”

Jamie提供了这些新威胁的示例,包括通过在整个互联网上训练的模型输出执行恶意代码、通过提示注入攻击控制模型行为、通过使模型过度重复输出进行模型拒绝服务攻击,以及在推理过程中通过查询恶意URL进行数据污染攻击。此外,无法控制自主代理及其通信也构成了重大风险。他说:“例如,在亚马逊云科技中运行的AI基础设施中,你的AI应用程序会从LLM获得一些响应。想象一下LLM,LLM是在整个互联网上进行训练的。它们不仅拥有好的知识,还拥有坏的知识。如果模型输出了这种坏的知识,并在你的应用程序工作负载上执行,那就是恶意代码执行。”

为了说明这些风险,Jamie展示了一个简单的GenAI应用程序架构。在这个设置中,用户与应用程序工作负载交互,应用程序工作负载与大型语言模型(LLM)通信。为了完善上下文并提高准确性,应用程序工作负载会多次与LLM交互,导致一种扇出效应,即单个用户提示会触发与LLM之间大量的事务和字符交换。Jamie解释道:“这意味着至少会有一种扇出效应,用户提出一个提示可能只有80个字符,但在幕后我们有100倍的事务正在进行,以字符和字节计算,这些都是与LLM的交互。”

Jamie演示了具体的攻击示例,包括作为输出传递恶意URL、提示注入攻击欺骗模型忘记其指令,以及由于模型产生幻觉并提供比要求更多信息而导致医疗保健聊天机器人泄露患者个人身份信息(PII)。

虽然Palo Alto Networks利用AI进行安全防护,其机器学习模型每天可防御76亿次威胁,包括250万次零日攻击,但该公司也认识到需要针对AI应用程序采取特定的安全措施。Jamie表示:“我们拥有超过4000个机器学习模型,每天都在为客户提供保护。我们使用精准AI技术防御了76亿次威胁,在我们为客户防御的76亿次威胁中,每天都有约250万次是世界上从未见过的零日攻击。”

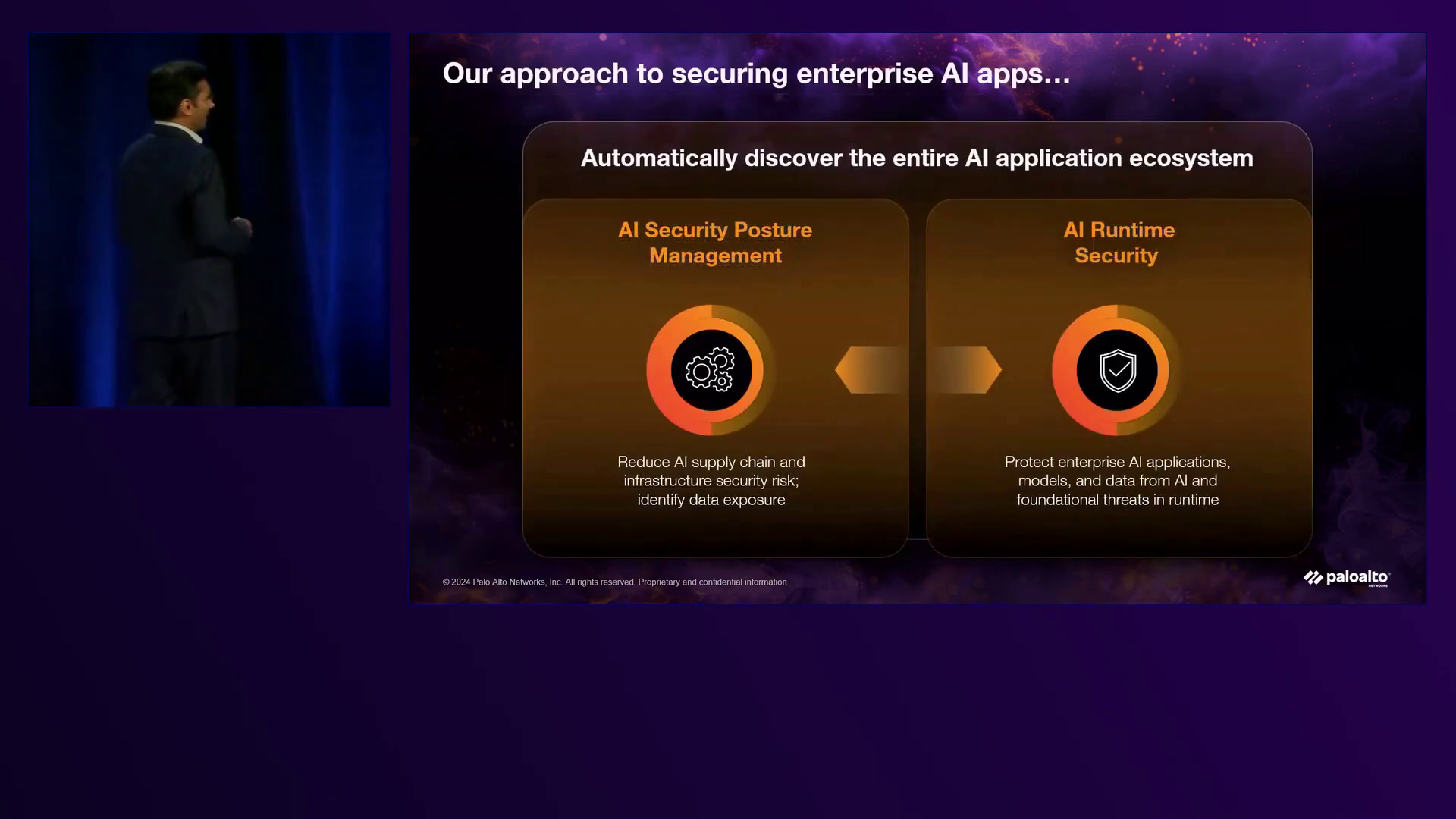

为了解决人工智能应用程序的安全需求,Palo Alto Networks提供了两种解决方案:AI Access Security用于保护员工访问公共AI应用程序,以及AI Security Posture Management(AISPM)和AI Runtime Security用于企业的AI应用程序。

AISPM从自动发现整个AI生态系统开始,包括跨多个云的模型、数据和基础设施。这种全面的可见性对于理解各个组件之间的复杂关系并识别潜在的数据暴露风险至关重要。AISPM然后分析与供应链问题、错误配置和数据暴露相关的风险,映射组件之间的复杂关系以检测意外的数据泄露。Jotam强调:“基本上对于使用应用程序的员工,我们有多个领域的多个应用程序,因此我们有人自动编码,我们有人总结文档,并且基本上有人过着日常生活,但现有的应用程序数量已经达到数千个。”

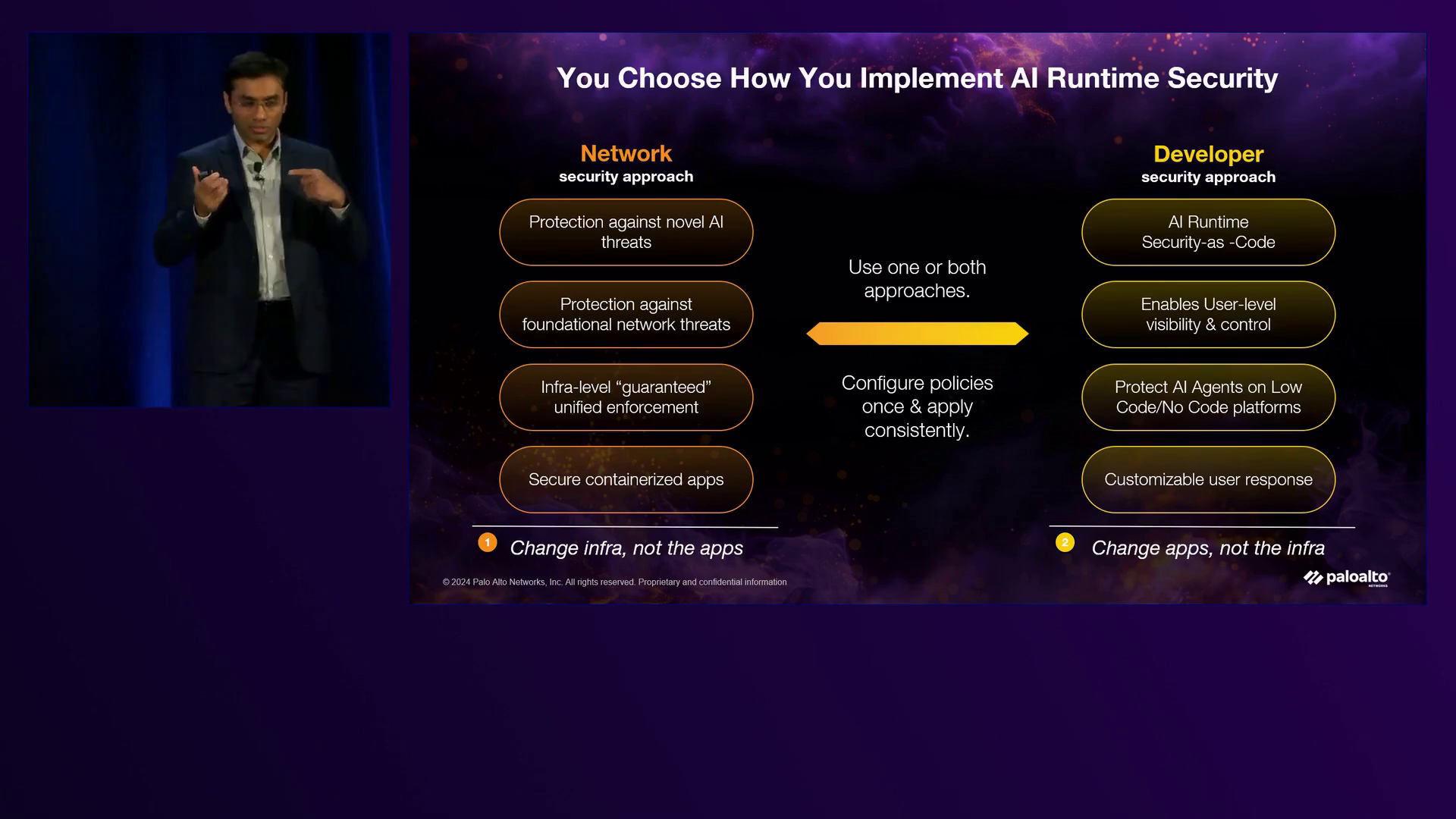

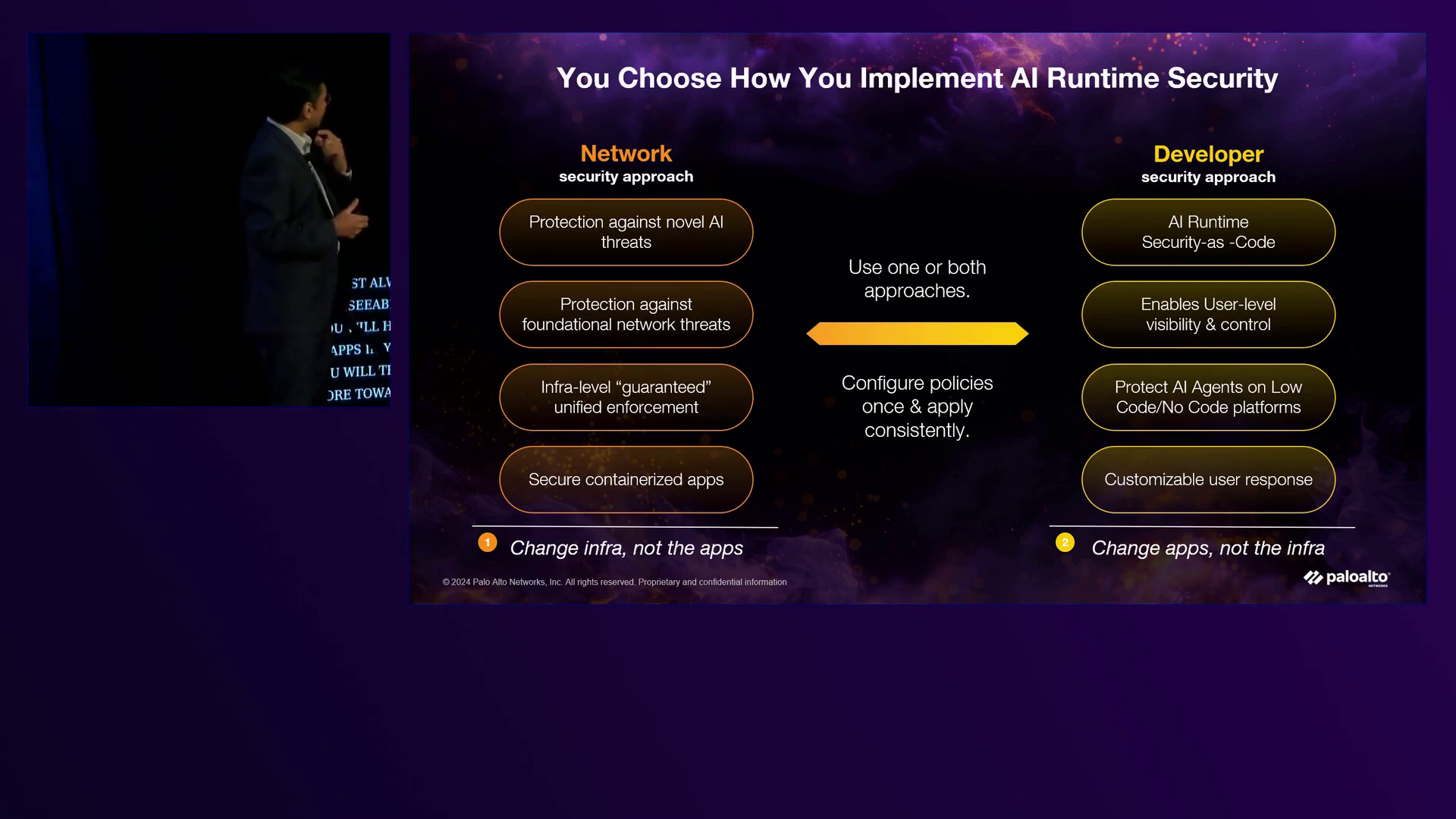

对于运行时保护,Jamie解释说Palo Alto Networks提供了两种选择:基于网络的执行点和面向开发人员的API方法。基于网络的执行点通过单一产品保护AI和非AI应用程序流量免受所有网络和AI威胁。这种方法消除了对多种安全解决方案的需求,简化了安全架构。

另一方面,面向开发人员的API方法允许组织使用简单的代码片段将AI安全直接嵌入到他们的应用程序中。这种方法特别适用于基础设施访问受限的场景,例如用于构建自主代理的低代码或无代码平台。Jamie提到:“我们目前也以API形式提供,使用REST API,只需一行代码,您就可以在收到提示后、将提示发送到模型之前,简单地在应用程序中包含该代码,调用我们的API,对提示进行清理;当您从模型获得响应时,在将响应发送回用户之前,再次调用我们的API,确保响应是安全的。”

无论选择哪种方法,流程都始于发现AI应用程序生态系统。Jamie演示了工作流程,从加入云账户并授予只读权限开始。这一步骤使Palo Alto Networks的解决方案能够发现和清点AI生态系统中涉及的应用程序工作负载、模型、数据集、插件和互联网目的地。在演示中,Jamie显示了“大约21个应用程序、10个模型、大约135种不同类型的数据集”以及“您的工作负载正在与之通信的14个互联网目的地”。

一旦完成发现阶段,组织就可以使用Terraform模板部署AI Runtime实例。这些实例部署在专用的安全VPC中,后面有一个网关负载均衡器和一组自动扩展的AI Runtime实例。应用程序流量将通过这个安全VPC进行检查和执行。在演示中,Jamie展示了在北美地区部署AI Runtime实例以保护“7个亚马逊云科技应用程序”。

在部署过程中,组织可以定义安全策略(称为“配置文件”),以控制应用程序和模型之间的访问、指定提示注入处理(警报或阻止)、管理允许和拒绝的URL,并利用Palo Alto Networks超过1000种预定义数据模式的庞大库来实现数据保护。

Jamie展示了受保护的应用程序与模型通信的情况,突出了在AI Runtime安全控制台中查看被阻止的威胁、警报和建议操作的能力。

为进一步说明AI Runtime安全功能,Jamie以一个由该解决方案保护的银行聊天机器人应用程序为例。在这种情况下,未受保护的应用程序版本成功地在其响应中传递了一个恶意URL,给用户带来了重大风险。然而,受保护的版本通过部署AI Runtime安全性,有效地阻止了恶意负载,证明了该解决方案防止此类威胁的有效性。

银行聊天机器人演示设置包括用户询问银行服务查询,例如“我如何申请汽车贷款?”。托管在Amazon EKS上的银行应用程序工作负载将查询Amazon Kendra作为知识库,调用Amazon Lambda函数以确定如何回答提示,并使用Anthropic的Claude模型生成最终文本响应,结合从Kendra检索的数据。

Jamie展示了这个演示应用程序的两个版本——一个未受保护的版本和一个部署了Palo Alto Networks AI Runtime安全性的受保护版本。在未受保护的版本中,由于推理过程中的数据污染,恶意URL被注入到响应中,可能会使用户面临恶意软件或恶意内容的风险。然而,在受保护的版本中,AI Runtime安全性成功阻止了恶意URL,防止了不安全的输出到达用户。

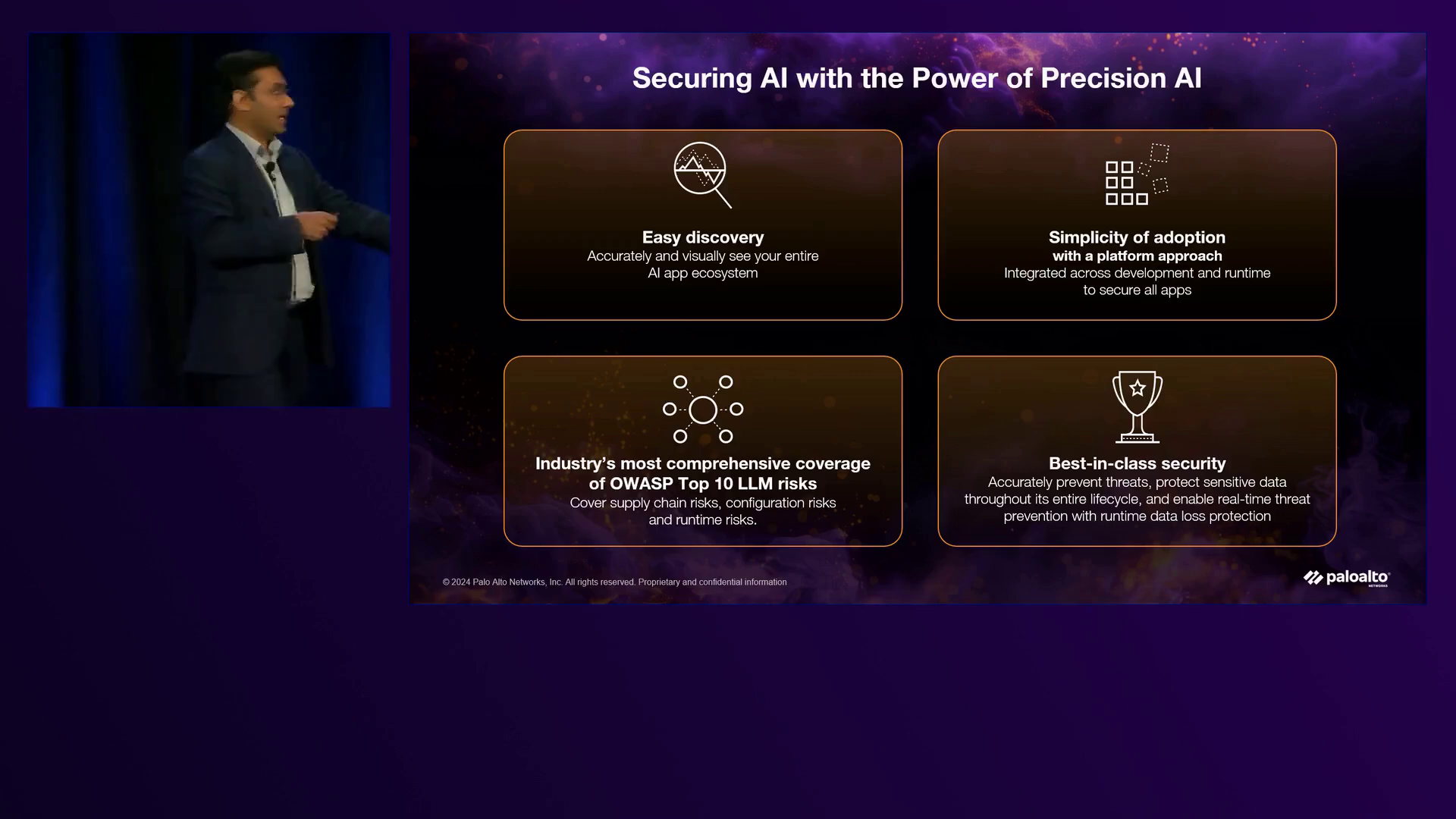

总之,在亚马逊云科技 re:Invent 2024大会上的这个会议全面概述了保护AI应用程序生态系统所面临的挑战和解决方案。Palo Alto Networks的Jamie Patel和Jotam Ben Ezra强调了AI在各个行业的快速采用,以及企业为利用AI功能而构建的复杂生态系统。他们强调了AI生态系统的每个组件(从模型和基础设施到数据和插件)中存在的潜在安全风险,以及在开发和运行时阶段解决这些风险的必要性。Palo Alto Networks的解决方案AISPM和AI Runtime Security提供了一种全面的方法来保护AI应用程序,从自动发现、风险分析到实时威胁预防。该会议强调了保持警惕和主动保护AI应用程序的重要性,因为威胁环境正在快速发展。

下面是一些演讲现场的精彩瞬间:

演讲者热情洋溢地通过识别不同的群体,如云安全专业人员、网络安全专家和开发人员,为使用人工智能(AI)来对抗人工智能威胁的会议做了铺垫。

强调了凭证泄露的风险,包括未经授权访问人工智能模型、潜在的财务损失,以及通过提示工程技术的数据外泄。

强调了大型语言模型(LLM)所带来的潜在安全风险,包括提示注入攻击、敏感数据泄露,以及连接工具和插件的漏洞。

Palo Alto Networks通过在安全产品中使用人工智能,并确保人工智能应用程序的安全性,来保护人工智能。

该公司利用4000多个机器学习模型每天防御76亿次威胁,包括250万次零日攻击。

亚马逊云科技推出了一种基于网络的安全解决方案,提供全面的保护,防御人工智能攻击和传统网络威胁,为保护人工智能和非人工智能应用程序提供统一平台。

Amazon将人工智能安全性引入API,允许开发人员只需几行代码就可以无缝地将威胁检测和缓解集成到他们的人工智能应用程序中。

总结

Palo Alto Networks 展示了他们的人工智能安全解决方案,旨在保护企业在采用生成式人工智能应用程序时免受新兴威胁。重点内容包括:

- 人工智能应用程序拥有复杂的生态系统,包括模型、数据管道、插件和代理,每一个环节都可能引入潜在的安全风险,如供应链问题、错误配置和数据泄露。

- 在运行时,人工智能应用程序面临新的威胁向量,如提示注入、模型拒绝服务、不安全输出和数据投毒攻击,传统的安全措施无法应对。

- Palo Alto Networks 提供两种互补的解决方案:人工智能安全态势管理(AISPM)用于保护人工智能供应链、配置和数据;人工智能运行时安全通过基于网络的执行或开发人员API实现对人工智能威胁的实时保护。

- AISPM提供对整个人工智能生态系统的自动发现、风险分析、跨训练/推理数据集的数据安全性以及合规性跟踪。人工智能运行时安全通过内联流量检查或API集成阻止提示注入、模型拒绝服务、不安全输出和数据泄露。

- 凭借无缝部署、全面的人工智能威胁覆盖以及利用其经过验证的安全专业知识,Palo Alto Networks 旨在实现企业安全采用生成式人工智能,同时降低相关风险。

亚马逊云科技(Amazon Web Services)是全球云计算的开创者和引领者。提供200多类广泛而深入的云服务,服务全球245个国家和地区的数百万客户。做为全球生成式AI前行者,亚马逊云科技正在携手广泛的客户和合作伙伴,缔造可见的商业价值 – 汇集全球40余款大模型,亚马逊云科技为10万家全球企业提供AI及机器学习服务,守护3/4中国企业出海。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?