|

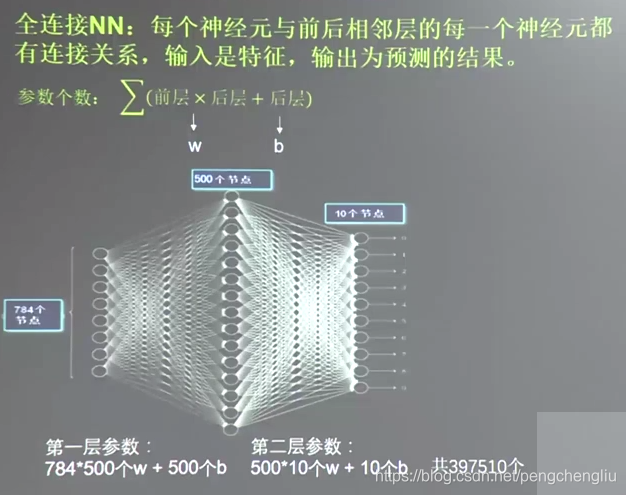

前面两讲我们使用全连接神经网络对Mnist数据集进行了训练,我们已经学会使用数据集训练模型,并让训练好的模型输出识别结果了。 我们之前的模型之所以叫全连接神经网络,是因为每一个神经元和前后相邻层的每一个神经元都有连接关系。前面,我们把原始图像的所有像素点以一维数组的形式输入全连接神经网络;全连接网络会计算分类评估值,也就是,识别出的结果。 在全连接神经网络中,每一层参数w的个数等于前一层神经元的个数乘以后一层神经元的个数。每一层参数b的个数等于后一层神经元的个数。这样,待优化的总参数就是各层的参数w和b的总和。比如,上节课的两层神经网络,第一层需要784*500+500,第二层需要500*10+10个。一共有近40万个待优化的参数。这还只是分辨率为28*28的黑白图像。

如果换成现实生活中的高分辨率彩色图像,不仅像素点增加,还从灰度图的单通道信息变成红绿蓝的三通道信息。待优化的参数过多,很容易导致模型过拟合。

|

卷积神经网络(0)----基本原理

最新推荐文章于 2025-07-08 16:16:53 发布

本文将深入探讨卷积神经网络的基本原理,包括其结构、卷积操作、池化技术以及在图像识别中的应用,帮助读者理解CNN在深度学习中的核心作用。

本文将深入探讨卷积神经网络的基本原理,包括其结构、卷积操作、池化技术以及在图像识别中的应用,帮助读者理解CNN在深度学习中的核心作用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

622

622

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?