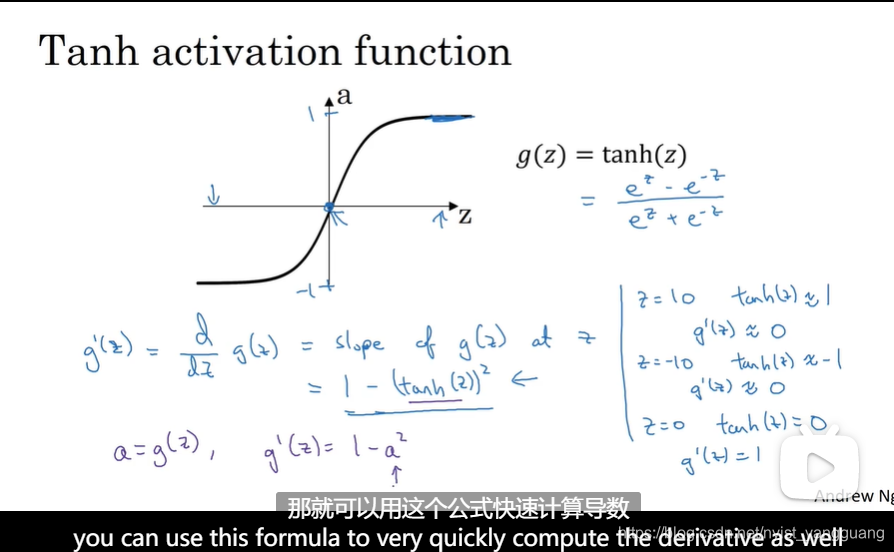

1 tanh(x)函数求导

求导过程 https://blog.youkuaiyun.com/qq_35200479/article/details/84502844

函数tanh(x)图像:

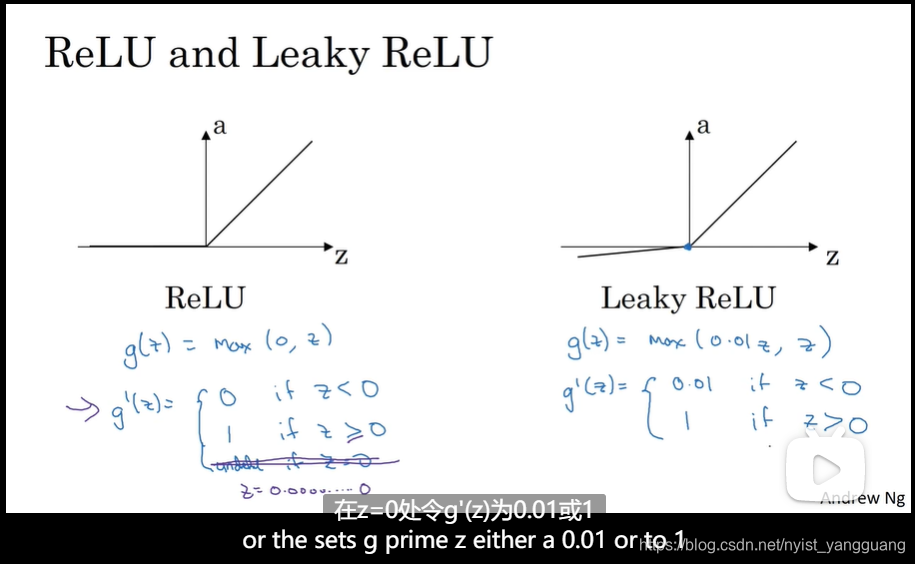

2 ReLU函数求导

在自变量为0(z为0时,函数导数无定义),不过吴老师说z=0概率非常小,所以当z等于0时导数可以任意赋值,一般还是赋值为1。

求导过程 https://blog.youkuaiyun.com/qq_35200479/article/details/84502844

函数tanh(x)图像:

在自变量为0(z为0时,函数导数无定义),不过吴老师说z=0概率非常小,所以当z等于0时导数可以任意赋值,一般还是赋值为1。

762

762

2万+

2万+

974

974

3427

3427

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?