引言

在前一篇专栏文章《扩散模型入门:概念与背景》中,我们从宏观角度了解了扩散模型的发展历程和基本思想。本文将深入探讨扩散模型的理论基础,从数学层面剖析其核心机制。我们将像解剖一台精密机器一样,逐层展示扩散模型的数学构造:从马尔可夫链的随机过程开始,到变分下界的优化目标,再到各种采样加速技术的原理。这些数学工具就如同建筑师手中的图纸,为我们构建起扩散模型这座理论大厦提供了坚实的基础。

扩散模型的成功并非偶然,而是建立在深厚的数学理论之上。正如牛顿力学需要微积分作支撑,扩散模型也需要概率论、随机过程和变分推理等数学工具的支持。本文将通过严谨的数学推导和直观的物理类比,帮助读者深入理解扩散模型的内在机制,为后续的实践应用奠定坚实的理论基础。

1. 扩散模型理论基础

1.1 数学基础:马尔可夫链与随机微分方程

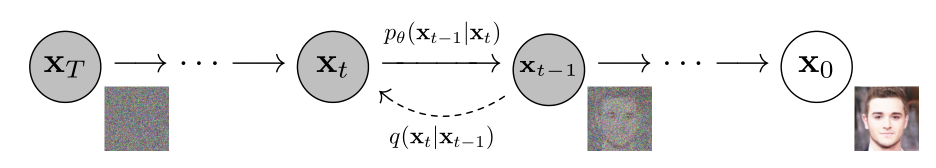

扩散模型的理论根基植根于概率论中的马尔可夫过程。想象一个醉汉在街上行走,他的下一步只取决于当前位置,而不依赖于过去的路径——这就是马尔可夫性质的形象比喻。在扩散模型中,这种"无记忆"特性使我们能够将复杂的数据生成过程分解为一系列简单的条件概率。

马尔可夫链的数学表述为,给定当前状态,未来状态

的条件概率分布为:

$$P(x_{t+1} = s | x_t = r, x_{t-1} = q, ..., x_0 = p) = P(x_{t+1} = s | x_t = r)$$

这个简洁的表达式蕴含着深刻的哲学思想:当下即是一切,过去只通过现在来影响未来。在扩散模型的语境下,这意味着每一步的加噪或去噪过程都只依赖于当前的状态,不需要记忆整个历史轨迹。

扩散模型中的前向过程(加噪过程)可以表示为一个马尔可夫链:

这里表示在

时刻状态

条件下,

时刻状态

的条件概率分布。在DDPM[1]中,这个条件概率被设计为高斯分布:

其中是预定义的方差调度参数,控制着每一步添加噪声的强度。这个看似简单的公式背后蕴含着精妙的设计思想:通过逐步添加高斯噪声,我们能够将任意复杂的数据分布

转换为简单的标准高斯分布

。

表格1:不同扩散模型中的马尔可夫转移核设计

| 模型 | 转移核 |

噪声调度 |

特点 |

|---|---|---|---|

| DDPM[1] | 线性调度 | 标准高斯转移 | |

| Improved DDPM[2] | 余弦调度 | 学习方差 | |

| VDM[3] | 连续时间SDE | 连续参数化 | 更灵活的调度 |

随机微分方程(SDE)为我们提供了一个更加连续和统一的框架来理解扩散过程。当我们将离散的马尔可夫链推广到连续时间域时,就得到了SDE的描述[4]:

这里是漂移项,

是扩散项,

表示维纳过程的增量。这个方程就像是描述粒子在液体中的布朗运动:

项代表确定性的漂移,而

项代表随机的扰动。

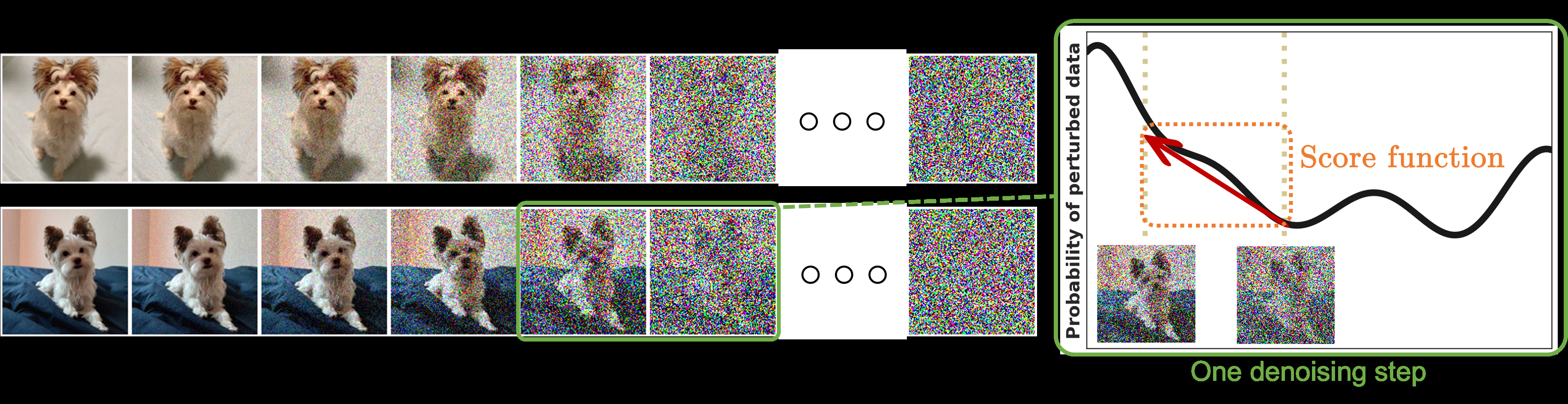

1.2 前向扩散过程(加噪)的数学表达

前向扩散过程的核心思想是通过逐步添加噪声来破坏数据的结构。这个过程可以比作时间的倒流:我们观察一杯热水逐渐冷却,分子运动从有序变为无序,最终达到热平衡态。在扩散模型中,我们人为地模拟这个过程,将有序的数据逐渐转化为无序的噪声。

DDPM中的前向过程具有一个重要的性质:在给定的条件下,任意时刻

的状态

都可以直接采样得到,而无需逐步迭代。这个性质源于高斯分布的封闭性,即高斯分布的线性组合仍然是高斯分布。

设,

,则有:

这个公式告诉我们,从原始数据到任意时刻

的状态

,可以通过一个简单的线性变换加上高斯噪声来实现:

这种重参数化技巧(reparameterization trick)的引入,使得我们能够通过采样标准高斯噪声来间接采样

,从而实现梯度的反向传播。

从信息论的角度来看,前向过程实际上是一个信息压缩和丢失的过程。随着的增加,

逐渐趋向于0,意味着原始信息

的权重不断减小,而随机噪声的权重不断增加。当

时,

几乎完全变成了标准高斯噪声,原始数据的信息完全丢失。这种设计的巧妙之处在于,它为逆向过程的学习提供了明确的目标:从纯噪声逐步恢复出有意义的数据结构。

1.3 逆向去噪过程的参数化与优化目标

如果说前向过程是"破坏"的艺术,那么逆向过程就是"重建"的科学。逆向过程试图逆转前向扩散的过程,从噪声中逐步恢复出原始数据。这就像是考古学家从残破的文物碎片中重建历史的全貌——每一步都需要基于当前的信息和先验知识来做出最优的推断。

逆向过程的理论基础来自于贝叶斯定理。给定当前状态和原始数据

,前一时刻状态

的后验分布为:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?