问题1:逻辑回归和SVM的异同

LR与SVM的相同点:

- 都是有监督的分类算法;

- 如果不考虑核函数,LR和SVM都是线性分类算法。

- 它们的分类决策面都是线性的。

- LR和SVM都是判别式模型。

LR与SVM的不同点:

- 本质上是loss函数不同,或者说分类的原理不同。

- SVM是结构风险最小化,LR则是经验风险最小化。

- SVM只考虑分界面附近的少数点,而LR则考虑所有点。

- 在解决非线性问题时,SVM可采用核函数的机制,而LR通常不采用核函数的方法。

- SVM计算复杂,但效果比LR好,适合小数据集;LR计算简单,适合大数据集,可以在线训练。

文末免费送电子书:七月在线干货组最新 升级的《2021最新大厂AI面试题》免费送!

问题2:LR的参数可以初始化0 吗?

可以。

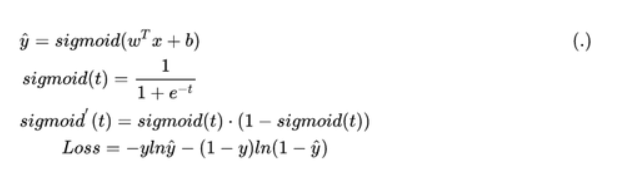

在逻辑回归中,

因此在LR的反向传播中,我们假设w=[w1,w2]Tw=[w_1,w_2]^Tw=[w1,w2]T,则

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?