这是一篇有关 UAV 领域的论文精读,因为近期工作涉及到无人机反制(简称:反无),所以还是需要阅读几篇和该领域相关的论文。总体来说这篇文站是一篇十分精炼的综述,没有过多的废话,直接点名了不同无人机监测、识别、跟踪方案之间的优劣。

写在最前面

为了方便你的阅读,以下几点的注意事项请务必了解:

- 该系列文章每个字都是我理解后自行翻译并写上去的,可能会存在笔误与理解错误,如果发现了希望读者能够在评论区指正,我会在第一时间修正错误。

- 阅读这个系列需要你有基本的 UAV 相关基础知识,有时候我会直接使用英文名词,因为这些词汇实在不容易找到符合语境的翻译。

- 原文可能因为版面限制存在图像表格与段落不同步的问题,为了更方便阅读,我会在博文中重新对图像表格进行排版,并做到引用图表的文字下方就能看到被引用的图表。因此可能会出现一张图片在博客中多处位置重复出现的情况。

- 对于原文中的图像,我会在必要时对图像描述进行翻译并附上我自己的理解,但如果图像描述不值得翻译我也不会强行写上去。

Basic Information

- 论文标题:Securing the Skies: A Comprehensive Survey on Anti-UAV Methods, Benchmarking, and Future Directions

- 原文链接: https://arxiv.org/abs/2504.11967

- 发表时间:2025年04月17日

- 发表平台:arxiv

- 预印版本号:[v2] Thu, 17 Apr 2025 09:25:04 UTC (411 KB)

- 作者团队:Yifei Dong, Fengyi Wu, Sanjian Zhang, Guangyu Chen, Yuzhi Hu, Masumi Yano, Jingdong Sun, Siyu Huang, Feng Liu, Qi Dai, Zhi-Qi Cheng

- 院校机构:

- University of Washington

- Carnegie Mellon University

- Clemson University

- Drexel University

- Microsoft Research

- 项目链接: 【暂无】

- GitHub仓库: 【暂无】

Abstract

无人机 (Unmanned Aerial Vehicles, UAV) 对于基础设施巡检、监视及相关任务而言不可或缺,但也带来了严峻的安全挑战。本综述对 反无人机 领域进行了广泛的研究,重点关注三大核心目标——分类、检测、跟踪,并详细介绍了基于扩散的数据合成、多模态融合、视觉语言建模、自监督学习和强化学习等新兴方法。系统地评估了单模态和多传感器(涵盖 RGB、红外、音频、雷达、RF)领域的最新解决方案,并讨论了大规模和对抗性基准测试。研究揭示了实时性能、隐身检测和基于群体的场景中仍然存在的差距,凸显了对鲁棒性、自适应反无人机系统的迫切需求。通过强调开放的研究方向,目标是促进创新,并在无人机广泛使用的时代指导下一代国防战略的发展。

1. Introduction

UAV 在民用和军用领域的作用日益广泛,在基础设施巡检、侦察和监视方面发挥着重要作用。然而,无人机的快速扩散也带来了严重的安全威胁,包括未经授权进入禁区和秘密收集数据。随着低成本、敏捷的无人机日益普及,对能够探测、跟踪、压制敌方无人机的强大反无人机 (anti-UAV) 技术的需求也日益迫切。

Scope & Motivation

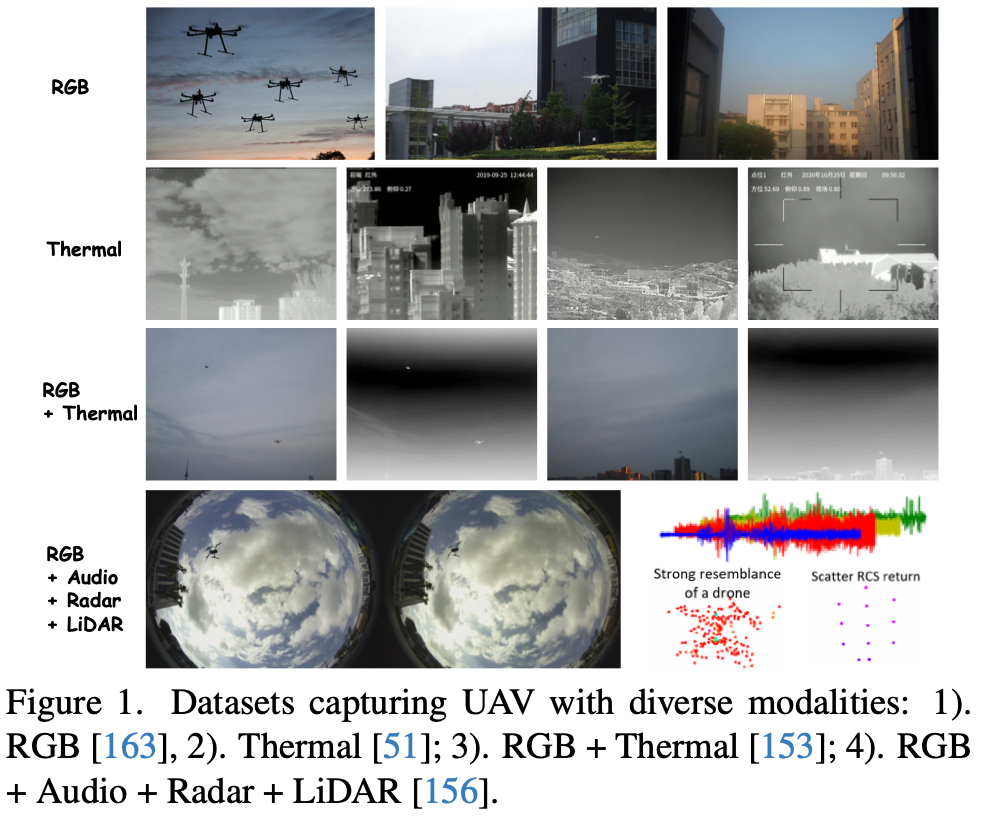

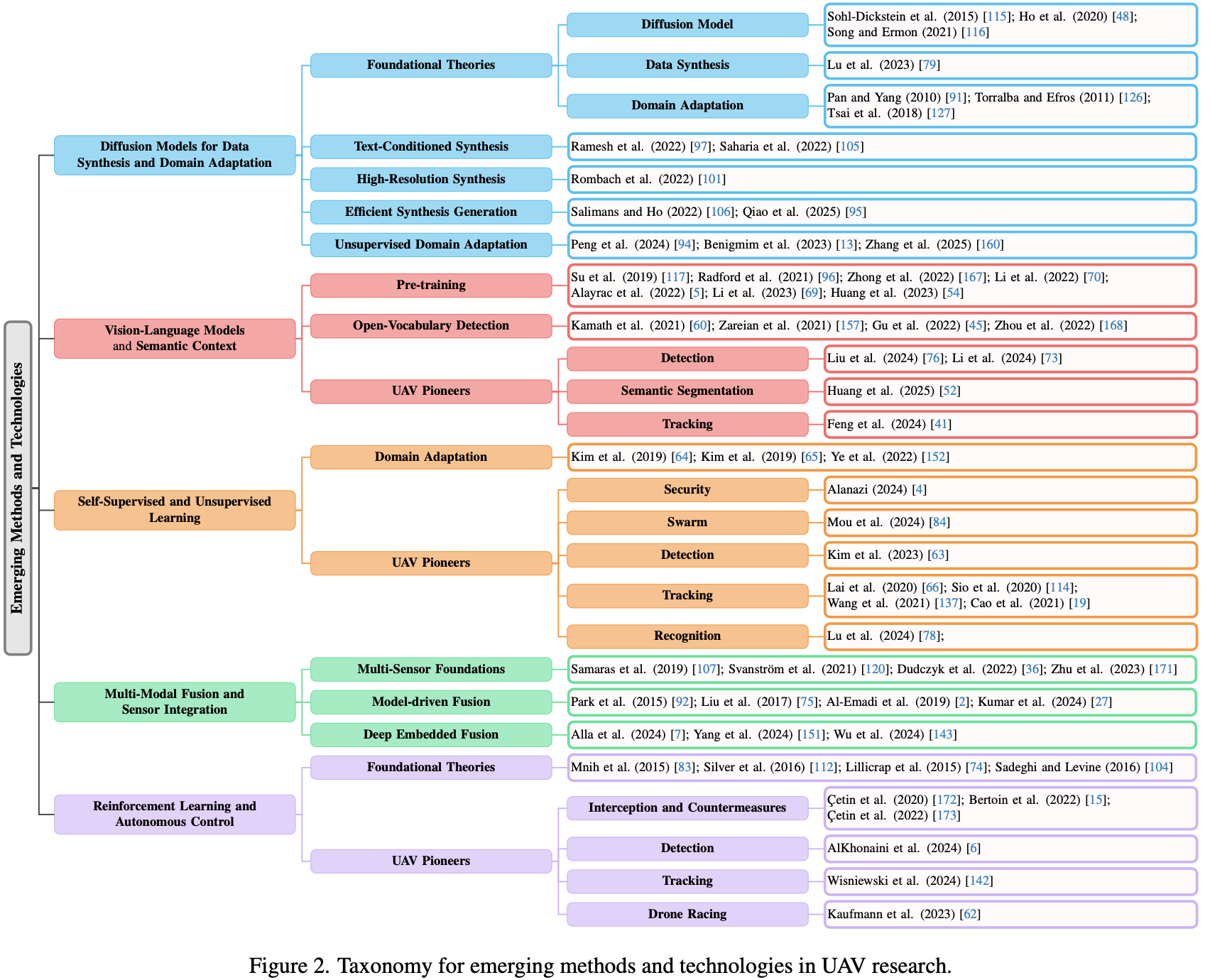

本文全面概述了当前的反无人机研究,重点关注三个关键目标:分类(第3节)、检测(第4节)、跟踪(第5节)。强调 利用多模态数据(包括RGB、红外(IR)、雷达、RF、音频)来解决小物体检测、不稳定飞行轨迹、对抗策略问题的重要性。Fig.2展示了推动现代反无人机创新的五个主要研究方向:(i) 基于扩散的数据合成和领域自适应,(ii) 视觉语言建模,(iii) 自监督和无监督学习

Datasets & Benchmarking

反无人机系统的进步至关重要,取决于高质量、大规模的数据集。第二部分回顾了包括 DroneRF、Halmstad Drone 和 Anti-UAV 在内的关键基准测试,详细介绍了它们的注释保真度、采样率和环境多样性。作者还强调了当前迫切需要涵盖夜间作战、群体威胁、实时拦截等场景的专业数据集。Table.1 对比了这些数据集,揭示了注释标准、传感器同步、对抗现实性方面持续存在的差距,这些差距限制了标准化评估并阻碍了稳健系统的开发。

Classification, Detection, & Tracking.

检测(detection)可以通过视觉或传感器数据定位无人机;分类(classification)可以更深入地了解无人机的类型和飞行轨迹;第三部分将概述近期的分类方法,这些方法整合了视觉和非视觉特征,以提高准确性和威胁评估能力;第四部分将探讨 SOTA 检测流程,涵盖从传统的基于特征到基于 CNN 和 Transformer 的架构;第五部分将讨论领先的跟踪(Tracking)算法(例如基于 YOLO 和 Siamese 算法),这些算法旨在在混乱或对抗环境中管理快速移动的无人机。

Emerging Techniques & Future Directions

第六部分重点介绍一些重要的新兴范式,例如扩散驱动增强、视觉-语言集成、自监督学习、高级多模态融合以及用于实时控制的强化学习,并探讨它们在重塑反无人机能力方面的巨大潜力。这些方法旨在通过领域自适应、强大的传感器集成、快速的策略更新,打造能够应对不断变化的威胁的自适应实时系统。第六部分以前瞻性的视角总结了下一代反无人机解决方案,概述了这些新兴方法如何推动未来的研究和产业创新。

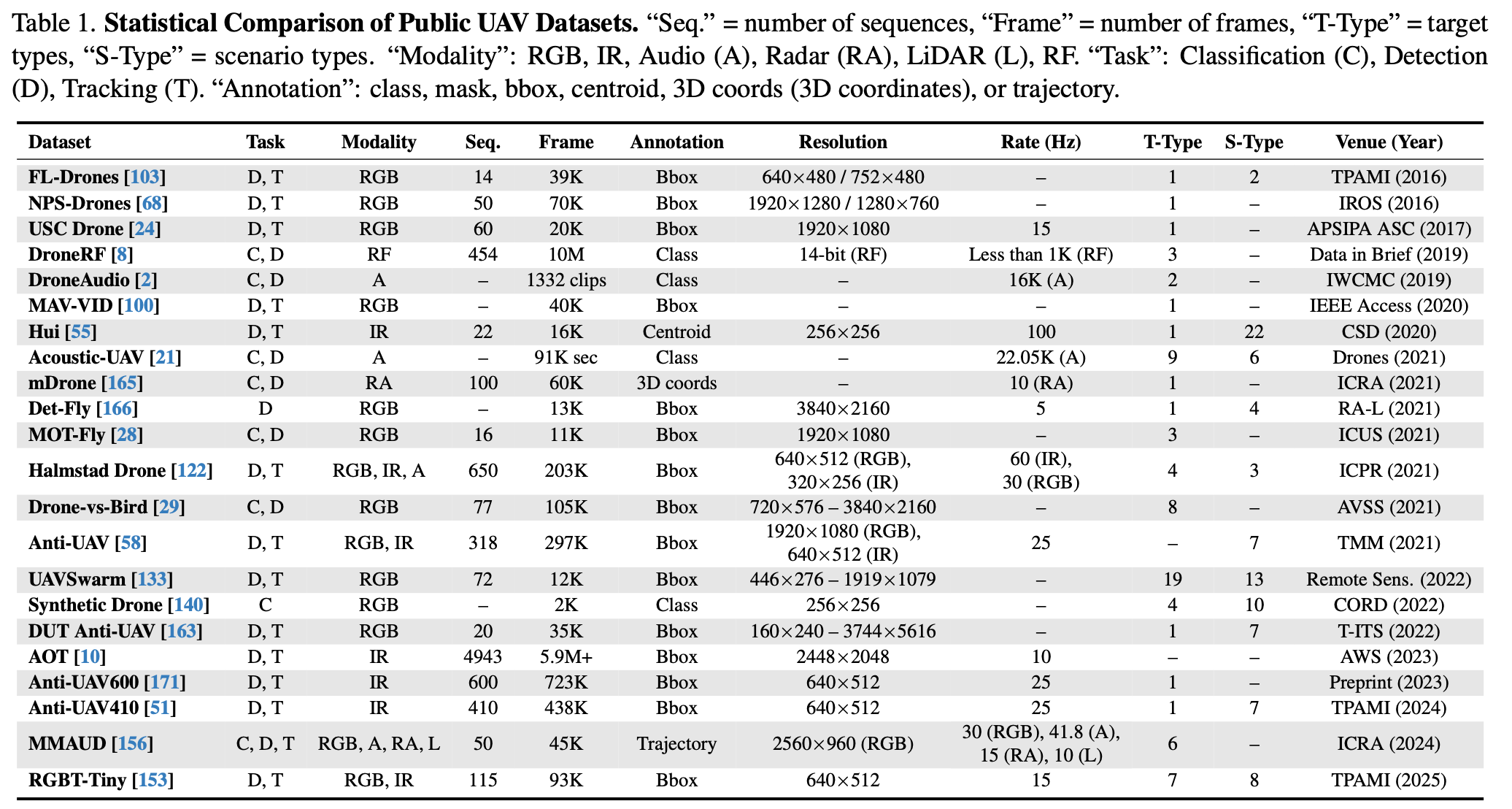

2. UAV Datasets & Benchmarking

Table.1 总结了公开可用的无人机数据集,涵盖各种传感器模式(例如 RGB、IR、音频、雷达、LiDAR、 RF)、标注方案(例如边界框、3D 坐标)和采样率。本节重点介绍重要的数据集项目,探讨新兴趋势,并强调尚未解决的挑战。

Foundational Efforts & Modality Expansion

使用最广泛的数据集:

- 基于 RGB 的空中探测和跟踪:

FL-Drones、NPS-Drones、USC Drone; - 基于电磁特征射频的无人机分类:

DroneRF; - 基于声学无人机分类:

DroneAudio、Acoustic-UAV; - 融合 RGB、IR、音频的无人机分类:

Halmstad Drone; - 集成雷达与激光雷达:

MMAUD; - 大规模集群与低能见度:

UAVSwarm和mDrone;

社区驱动的竞赛(例如第二届和第三届反无人机研讨会和第四届反无人机挑战赛)以反映现实世界作战复杂性的对抗性或混乱场景为特色,上面的数据集 UAVSwarm 和 mDrone 强调大规模群体协调或低能见度跟踪,对稳健的多传感器融合提出了需求。

Complex Scenes & Modalities

- 夜间红外与恶劣天气:

Anti-UAV600、Anti-UAV410; - 视觉上与无人机相似的野生动物:

Drone-vs-Bird; - 室内或GPS受限环境:

Midgard、Rosner;

同时,注释已从边界框扩展到 3D 坐标和全面的轨迹信息,以适应拦截和多无人机机动日益复杂的情况。

Trends & Open Challenges

尽管数据集范围取得了显著进展,但仍存在一些差距。像 MMAUD 和 Halmstad Drone 这样的数据集需要精确的传感器校准和同步,但标准化的融合协议仍然有限。虽然 UAVSwarm 最多可容纳 23 架无人机,但在更大规模(50 架以上)的无人机群上进行测试仍然不常见,这限制了大规模合作跟踪与拦截的研究。此外,隐身或干扰场景正在成为反无人机的关键主题——在开源数据集中仍然很少出现。高分辨率数据流(例如 DetFly 和 AOT)也对机载系统的存储和处理提出了挑战,促使人们进一步研究压缩和硬件加速。

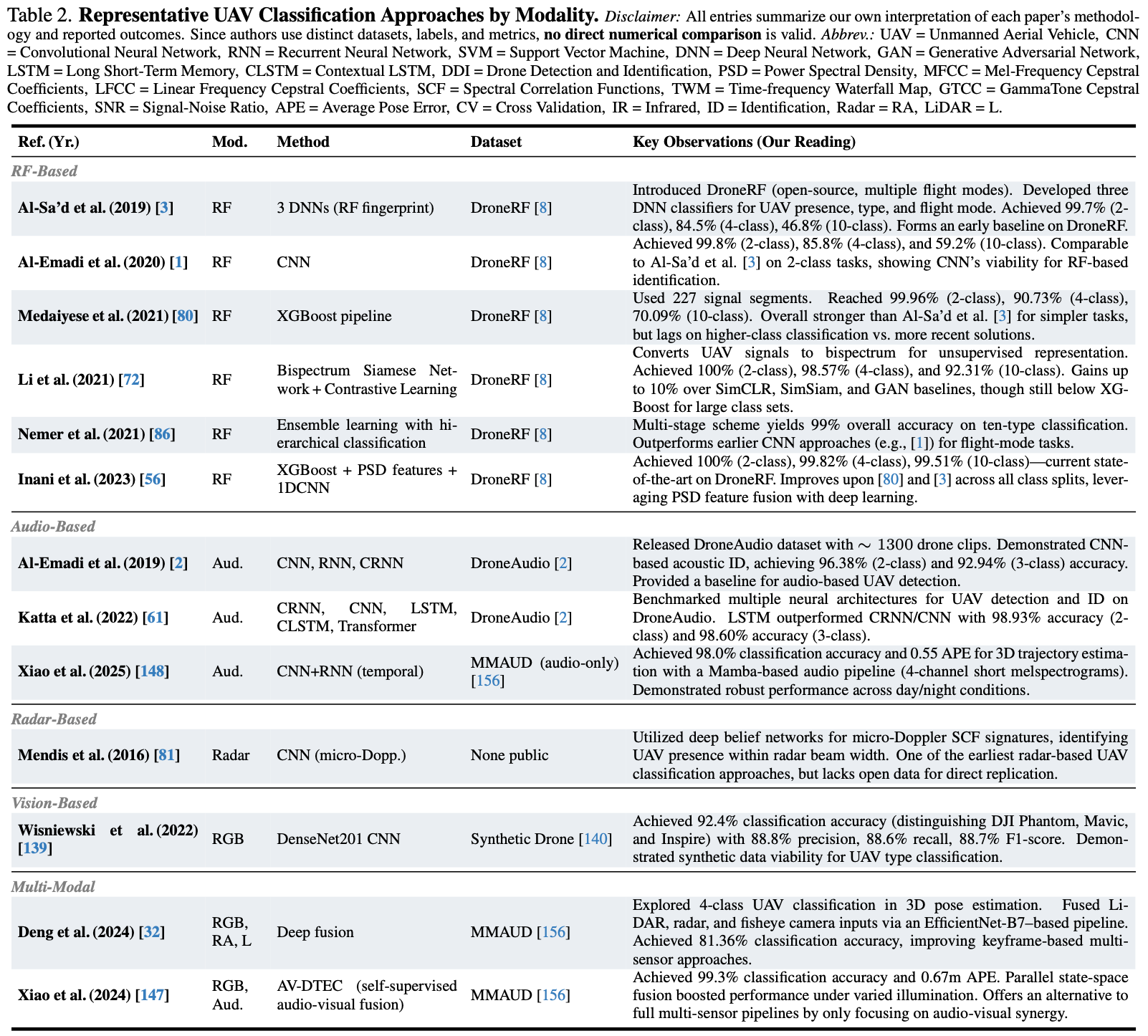

3. UAV Classification Approaches

Table.2 综合了涵盖射频 (RF)、音频、雷达、视觉、激光雷达 (LiDAR) 等模态的代表性无人机分类方法。这些方法涵盖从简单的无人机存在检测到更细致的无人机类型、飞行模式、方向分类。虽然由于实验方案不一致,比较起来比较困难,但特定模态的考虑因素(例如光谱噪声或光照变化)激发了不同的架构和数据处理策略。

3.1 RF-Based Classification

以射频 (RF) 为中心的方法利用 无人机发射的电磁特征 来探测、识别甚至辨别特定的飞行模式。Al-Sa’d 等人引入了 DroneRF 数据集,在 2-class 任务上表现出很高的准确率 (99.7%),但在更精细的 10 类任务上性能较低 (46.8%);Al-Emadi 等人的后续工作证实了 CNN 对 DroneRF 的可行性,达到了 99.8% (2-class) 和 59.2% (10-class);最近的研究探索了高级特征工程或集成学习:例如,Nemer 等人通过分层集成超越了基于 CNN 的基线方法;Li 等人将双谱表示与对比学习结合起来;

Inani 等人通过融合 PSD 特征、1D-CNN 和 XGBoost,实现了近乎完美的 10-class 准确率(99.51%)。 《Machine Learning based framework for Drone Detection and Identification using RF signals》

尽管取得了这些进展,但实际部署仍面临着频谱拥塞、对抗干扰和领域转移等挑战。

3.2 Audio-Based Classification

音频流程根据旋翼噪声和其他声学特征来区分无人机。Al-Emadi 等人介绍了 DroneAudio 数据集,使用 CNN 实现了 96.38%(2-class)和 92.94%(3-class)的准确率;Katta 等人随后展示了 LSTM、CRNN 和 Transformer 的优势,其中 LSTM 达到了 98.93%(2-class);

Xiao 等人采用时间 CNN+RNN 来处理 MMAUD 的音频模态,达到了 98.0% 的准确率,同时获得了出色的姿态估计结果。 《TAME: Temporal Audio-based Mamba for Enhanced Drone Trajectory Estimation and Classification》

风噪声、背景噪音或多架无人机产生的噪音在实际场景中仍然是一个障碍,这促使人们对去噪滤波器和多麦克风阵列进行研究。

3.3 Radar-Based Classification

雷达提供的微多普勒特征在能见度降低或夜间条件下仍能持续存在

Mendis 等人使用深度信念网络验证了基于雷达的无人机分类,但有限的数据集可用性阻碍了其广泛应用。 《Deep learning based doppler radar for micro UAS detection and classification》

目前,基于 CNN 和 LSTM 的流程占据主导地位,专注于微多普勒表征,以提高其在杂乱环境中的鲁棒性。尽管如此,雷达硬件成本和校准限制仍然是实际挑战。

3.4 Vision-Based Classification

计算机视觉流程旨在通过光学图像实现无人机识别,通常侧重于特定制造商型号(例如,大疆 Phantom、Mavic)。

Wisniewski 等人在三种无人机(Phantom、Mavic、Inspire)上实现了 92.4% 的准确率,并证明了合成图像的可行性。 《Drone Model Classification Using Convolutional Neural Network Trained on Synthetic Data》

其他研究则结合先进的检测器或领域自适应技术,解决了小物体尺寸和运动模糊的问题。虽然基于视觉的方法在受控场景下性能较高,但在极端光照、恶劣天气或密集杂波条件下性能会下降。

3.5 Multi-Modal Recognition

集成多个传感器(例如,射频+音频、雷达+激光雷达+视觉、音频+视觉)可以减轻单传感器的盲点。Deng 等人融合了 MMAUD 的鱼眼 RGB、雷达和激光雷达数据,在 4-class 任务上达到了 81.36% 的准确率;

Xiao 等人则结合了音频和 RGB 流,实现了 99.3% 的准确率和亚米级的姿态误差。 《AV-DTEC: Self-Supervised Audio-Visual Fusion for Drone Trajectory Estimation and Classification》

虽然多模态设置可以提高鲁棒性,但也需要仔细的校准、同步和更大的计算资源。

Key Insights & Challenges

在上述方法中,每种模态都面临着固有的限制:

- 基于射频 (RF) 的解决方案擅长飞行模式或类型识别,但 无线电拥塞和潜在的对抗性攻击 是关键障碍

- 基于音频的方法在受控环境中实现了高精度,但在高噪声或大风环境中性能会显著下降;

- 基于雷达的流程可以绕过视觉遮挡,但成本更高,校准要求也更高;

- 基于视觉的方法通常可以提供细粒度的识别,但会随着光照或天气变化而降低;

- 多模态融合可以弥补单传感器的弱点并减少误报,但这也增加了实时部署的复杂性。

此外,对抗鲁棒性仍然是一个悬而未决的问题,尤其是在传感器或神经网络可能被欺骗或欺骗性信号欺骗的情况下。一个持续的研究方向是高效、低延迟的架构,这些架构可以进行机载或基于边缘的处理,以实现无人机的快速检测和分类。

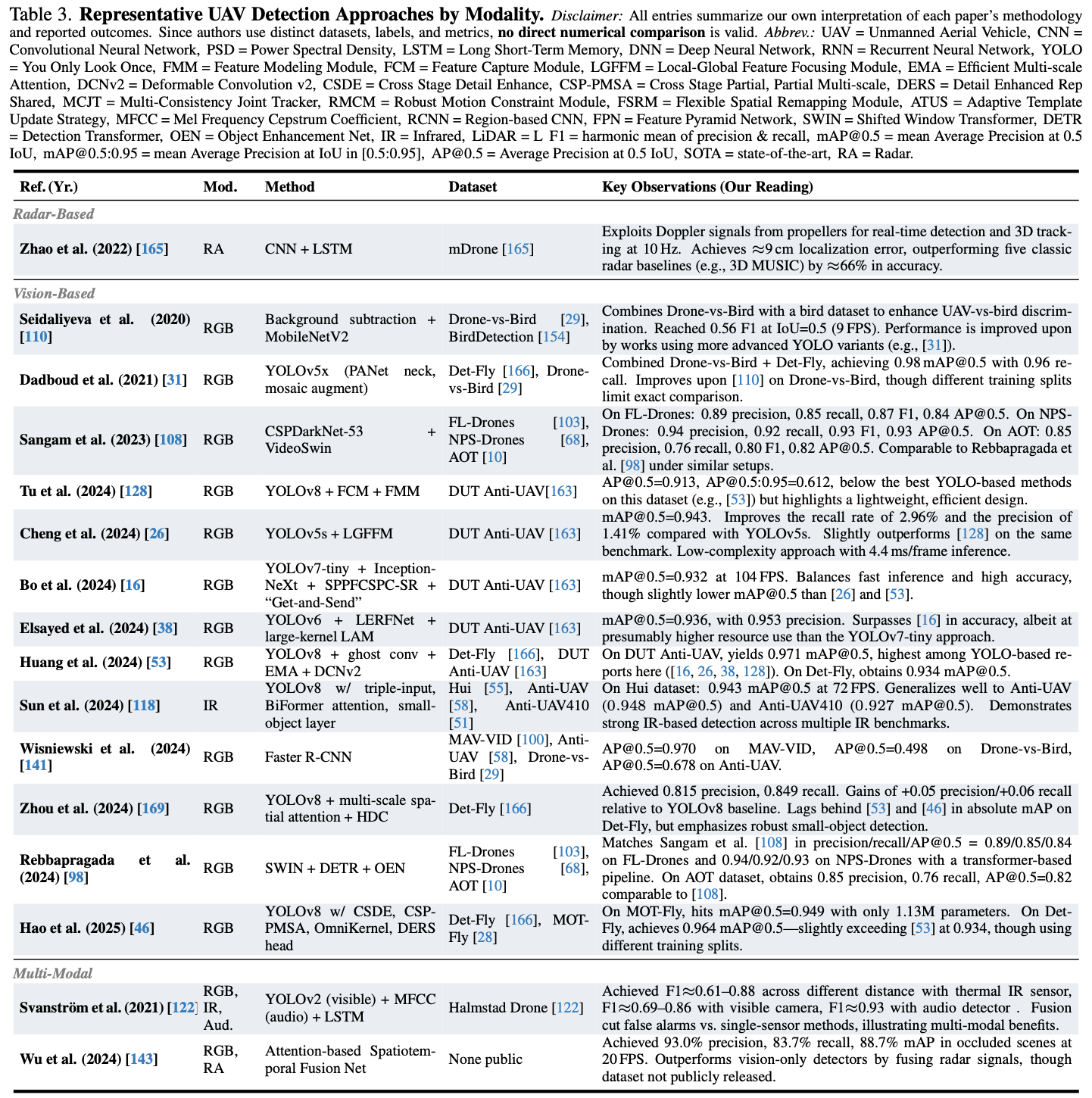

4. UAV Detection Approaches

Table.3 总结了涵盖雷达、视觉和多模态解决方案的无人机检测流程。每种模态都针对不同的挑战——例如小目标尺寸、杂乱环境和恶劣天气——提供了独特的优势和权衡。尽管由于数据集和评估方案的不同,直接进行数值比较具有挑战性,但这些方法共同展现了检测算法和系统设计的新兴趋势。下文将讨论文献中的一些重要见解。

4.1 Radar-Based Detection

雷达方法利用 微多普勒特征 探测无人机,在 低能见度或恶劣天气条件下具有较高的适应性。例如,Zhao 等人通过结合 CNN 和 LSTM,实现了 10 Hz 的分米级定位,其性能优于传统的雷达基线方法。

然而,雷达传感器容易受到干扰和杂波的影响,尤其是在城市地区或电磁环境十分拥挤的情况下。

4.2 Vision-Based Detection

得益于现成的摄像头和先进的基于 CNN 的检测器,基于视觉的技术仍然被广泛采用。早期的研究主要集中在基于区域的方法和 YOLO 架构,并逐渐演变为更轻量级或以注意力机制为导向的变体。

虽然 马赛克增强 和 专用模块 可以提升小物体检测性能,但基于视觉的方法仍然容易受到遮挡、杂波、极端距离的影响。因此,研究人员探索了热成像和红外 (IR) 成像,或在实时嵌入式场景中权衡速度和精度。

4.3 Multi-Modal Fusion

单模态方法通常在低能见度(视觉)、干扰(雷达)或噪声(音频)等次优条件下会失效。因此,多模态融合作为利用互补传感器数据的一种手段已获得广泛关注。

Svanstrom 等人的研究表明,在基于 YOLO 的 RGB 或热成像中添加音频特征可以提高 F1 得分并减少误报;Wu 等人通过基于注意力机制的时空网络融合雷达和 RGB 流,以改进遮挡处理。

然而,实际应用需要 精确的传感器同步、均衡的硬件成本、强大的计算效率 以及 实时数据关联。

Key Insights & Challenges

从先前的研究可以看出几个反复出现的主题:

- 小型无人机检测:有限的像素覆盖范围和细微的微多普勒特征使检测变得复杂,这促使人们提出多尺度特征提取、可变形卷积和 Transformer backbone。确保高精度实时运行仍然具有挑战性;

- 环境因素:环境噪声(音频)、照明(视觉)和无线电干扰(雷达)会降低性能,这凸显了对先进的杂波抑制和强大的传感器硬件的需求;

- 泛化 vs. 专一化:基于 YOLO 的模型提供了可泛化的框架,但特定领域(例如隐形无人机)可能需要更具体的架构或领域自适应策略;

- 多模态融合:互补传感器有效降低误报率并提高准确率,但传感器校准、实时延迟和硬件成本等问题仍有待解决;

- 基准测试与部署:异构数据源、标签格式和测试条件使标准化评估变得复杂。尽管实验室演示显示出良好的前景,但在拥挤的户外环境中的实时性能仍未得到充分探索。克服这些挑战对于战场反无人机系统来说至关重要。

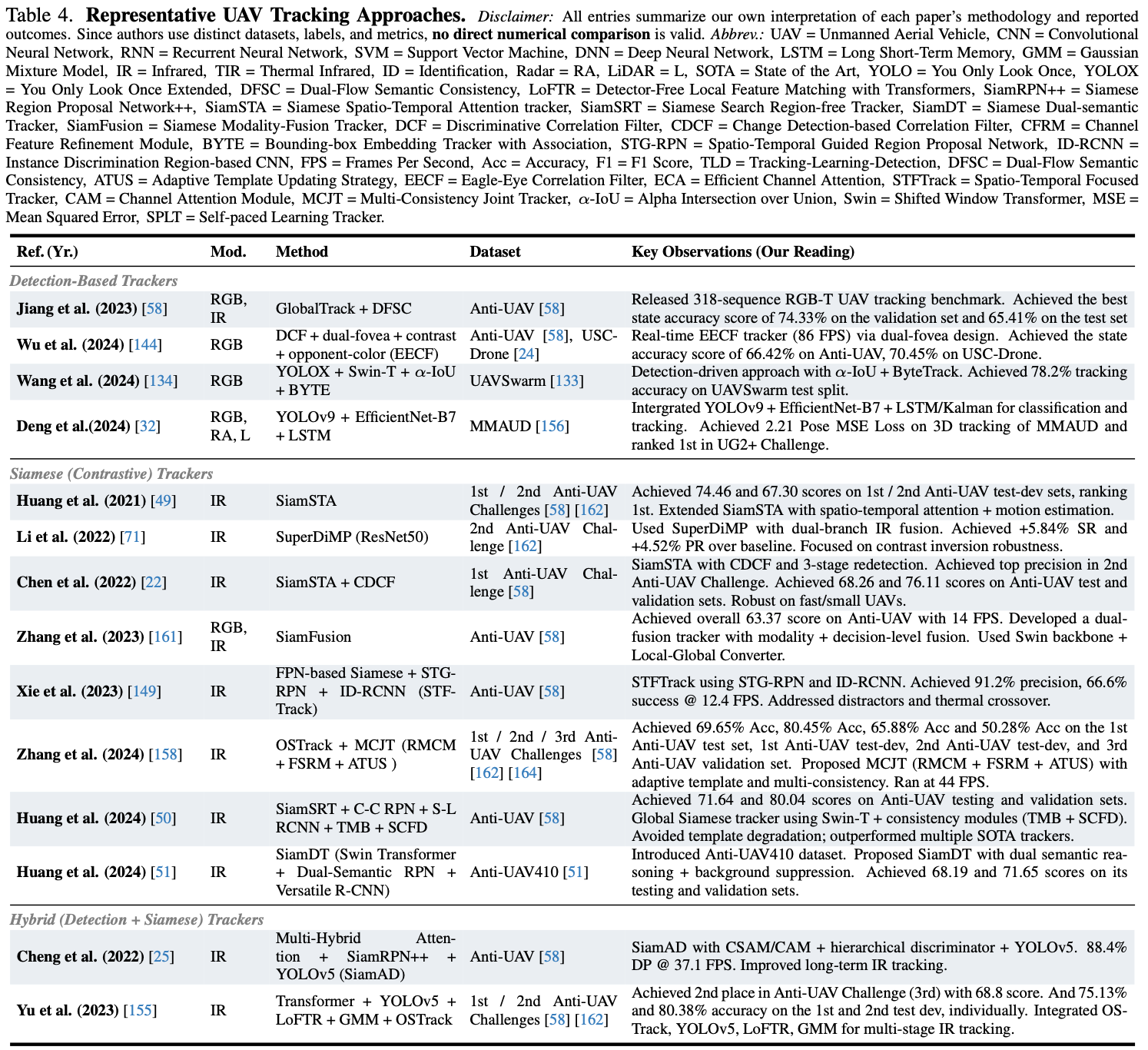

5. Anti-UAV Tracking Approaches

Table.4 回顾了主要的无人机跟踪方法,涵盖基于检测、基于 Siamese 和混合跟踪器,采用 RGB、IR 和多模态输入。尽管数据集和指标差异限制了直接的数值比较,但这些方法共同代表了无人机跟踪领域的最新水平。

5.1 Detection-Based Trackers

基于检测的流程通常优先考虑实时性能,并使用高效的目标检测器。例如,Wu 等人提出了 EECF,这是一个双中央凹相关滤波器跟踪器,运行速度为 86 FPS,在 Anti-UAV 上的状态准确率为 66.42%,在 USC-Drone 上的状态准确率为 70.45%;Wang 等人将 YOLOX与 Swin Transformer 和 ByteTrack 集成,在 UAVSwarm 上实现了 78.2% 的准确率;

Deng 等人将 YOLOv9 和 EfficientNet-B7 与 LSTM/卡尔曼滤波相结合进行 3D 跟踪,在 MMAUD 上获得了位姿 MSE 最高排名,并赢得了 UG2+ 挑战赛。 《Multi-Modal UAV Detection, Classification and Tracking Algorithm – Technical Report for CVPR 2024 UG2 Challenge》

5.2 Siamese (Contrastive) Trackers

孪生跟踪器(Siamese trackers)擅长学习鲁棒的特征相似性,并处理快速或规避的无人机运动。Huang 等人凭借 SiamSTA 在第一届和第二届反无人机挑战赛中均夺得冠军,该方法融合了复杂的时空注意力和运动估计;Li 等人使用双分支红外融合策略增强了 SuperDiMP,在第二届反无人机挑战赛中将精度提高了 4.52%;Chen 等人使用 CDCF 和多阶段重新检测机制进一步增强了 SiamSTA,在对抗小型快速无人机方面表现出色;

除了单模态之外,Zhang 等人的 SiamFusion 无缝集成了 RGB 和 IR 流,在 Anti-UAV 测试中获得了 63.37 分,彰显了互补传感器模式的实际价值。 《Modality Meets Long-term Tracker: A Siamese Dual Fusion Framework for Tracking UAV》

5.3 Hybrid (Detection + Siamese) Trackers

混合方法将检测流程与孪生匹配相结合,充分利用了每种范式各自的优势。Cheng 等人提出了 SiamAD,它是 YOLOv5、多种混合注意力模块和 SiamRPN++ 的综合体,在 Anti-UAV 数据集上以 37.1 FPS 的速度实现了 88.4% 的检测精度;

Yu 等人集成了 Transformers、YOLOv5、LoFTR、GMM 和 OSTrack,在第三届 Anti-UAV 挑战赛中获得第二名,证明了基于多阶段红外跟踪的实用性; 《A Unified Transformer-based Tracker for Anti-UAV Tracking》

Key Insights & Challenges

虽然实时孪生跟踪器和基于检测的流程可以维持高帧率,但它们在杂波、遮挡或集群条件下往往表现不佳,因此需要更具自适应性的架构。隐身机动和干扰进一步使无人机跟踪复杂化,凸显了鲁棒域自适应和动态线索优先级排序的必要性。虽然 RGBT 传感器融合可以缓解单个传感器的缺陷,但加入激光雷达或雷达不可避免地会增加校准开销和计算负荷。现有的基准测试很少能够捕捉大规模群体、多样化的天气条件或严重的遮挡,从而限制了系统的进展。基于 Transformer 的解决方案可以解决复杂的运动模式和部分遮挡问题,但实时性能可能会滞后,需要针对机载或边缘设备进行专门的硬件优化。

由于关联不确定性和特定领域的限制,将多目标追踪器(例如 ByteTrack)扩展到更大规模的无人机集群仍然具有挑战性。最终,下一代追踪器将需要更快的推理速度、更强大的传感器融合和更广泛的数据集,才能在实际条件下实现可靠的反无人机性能。

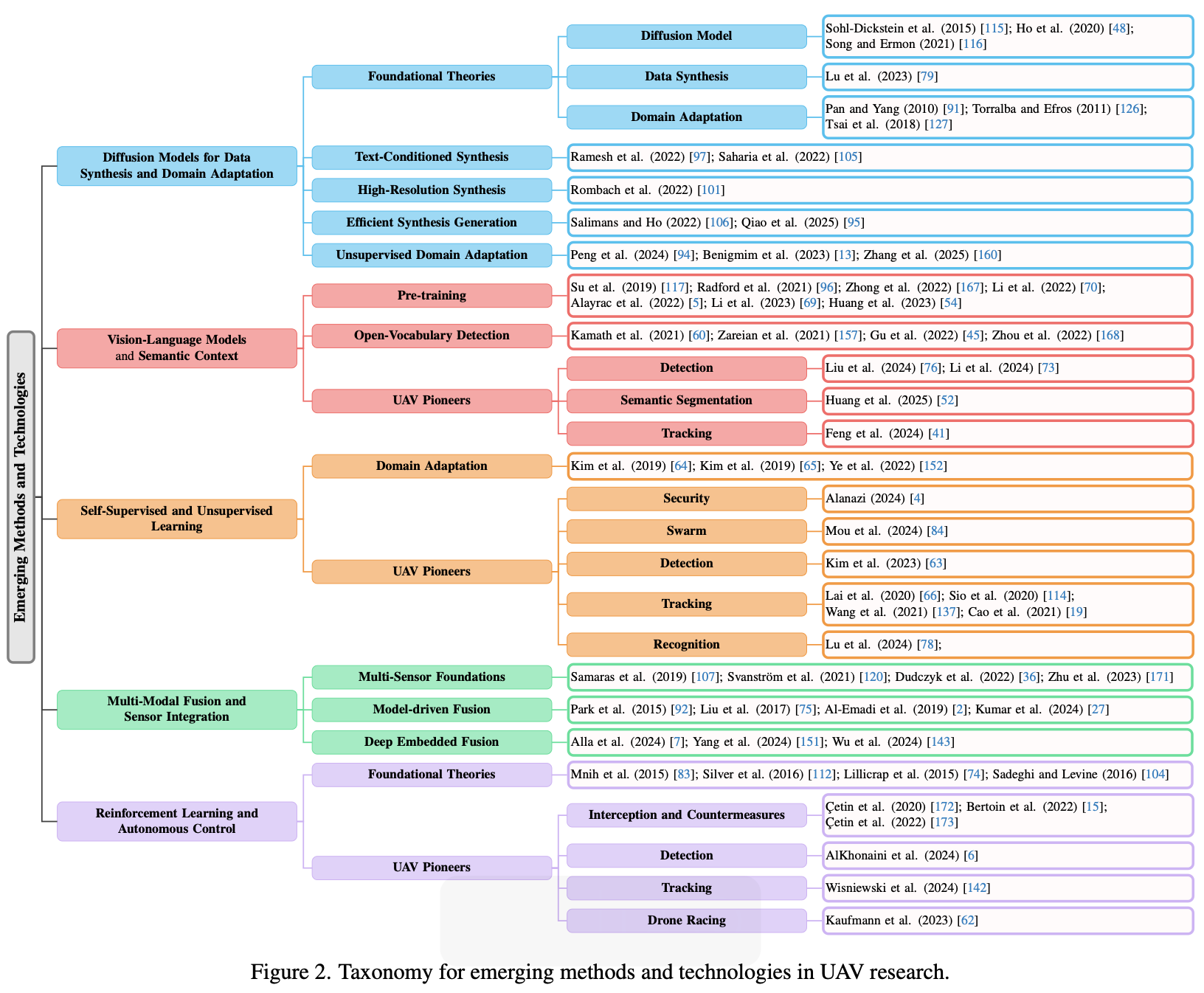

6. Emerging Techniques & Future Directions

近期的无人机研究已采用先进的机器学习范式来提升性能、可扩展性和自主性。Fig.2 将这些创新分为五个关键主题:

- 用于数据合成和领域自适应的扩散模型;

- 用于语义理解的视觉-语言模型;

- 自/无监督学习;

- 多模态融合和传感器集成;

- 用于自主控制的强化学习;

Diffusion Models for Data Synthesis & Domain Adaptation

扩散模型可生成高保真无人机图像,以解决数据稀缺问题并增强领域多样性,其中包括基于文本条件的方法。更快采样技术的最新进展支持近乎实时的增强,而基于扩散的领域自适应则缩小了合成数据与真实世界数据之间的差距。未来的研究可能侧重于基于实时传感器数据流的动态自适应,从而能够在无人机动态运行条件下进行持续优化。

Vision-Language Models & Semantic Context

视觉语言 (VL) 方法将文本线索与视觉特征相结合,以促进开放词汇无人机的检测和分类。针对无人机的适配方法结合了飞行剖面图、任务目标或有效载荷属性的文本描述,从而显著丰富了威胁评估。通过利用语义叙述(例如,渗透路线、可疑货物),未来基于 VL 的系统可以快速适应新的无人机类别,并增强态势感知能力。

Self-Supervised & Unsupervised Learning

自监督和无监督方法减轻了对不同高度、传感器和天气条件下标记空中数据的依赖。近期研究致力于群体泛化,进一步加强了多无人机检测、跟踪和识别,以及安全性。展望未来,能够快速实时适应领域变化的大规模自监督预训练,或许能够持续响应不断变化的无人机行为和隐身战术。

Multi-Modal Fusion & Sensor Integration

融合传感器(例如 RGB、IR、雷达和音频)可显著提升无人机检测和跟踪的鲁棒性。经典融合如今已通过深度嵌入方法得到增强,从而允许在实时约束下自适应地调整传感器权重。然而,保持精确同步并谨慎平衡功耗或带宽仍然是实现鲁棒性、大规模部署的关键考虑因素。

Reinforcement Learning & Autonomous Control

强化学习 (RL) 已被证明可有效实现动态环境下的自适应无人机决策,并以此为基础取得了诸多突破。现代以无人机为中心的强化学习研究涵盖拦截、检测、跟踪和高速竞速,并经常集成生成式或多模态输入以实现快速策略更新。未来的方向可能侧重于分层或多智能体强化学习,以实现大规模群体控制,并在合作行为与对抗性对策和特定任务约束之间取得平衡。

7. Conclusion

本综述考察了不断发展的反无人机领域,重点关注探测、跟踪、识别。重点介绍了传感器融合、深度学习和多模态系统方面的最新进展,强调了在不利条件下开发稳健、实时解决方案的紧迫性。对代表性数据集的分析揭示了对抗鲁棒性和可扩展集群跟踪方面的差距。关键见解强调了跨模态集成、对对抗策略的韧性以及自监督学习和强化学习的前景。展望未来,生成式建模、语义理解和自适应多模态框架将推动下一波反无人机创新浪潮。

4046

4046

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?