AI MCP基础篇:从零开始理解上下文协议

作为GDG(Google Developer Groups)组织者,过去两年我参与组织了数十场AI相关的技术活动。在与众多开发者的交流中,我深刻感受到AI技术正在重塑整个技术生态。为了将这些宝贵的经验沉淀下来,我决定推出这个AI技术系列文章,既是对自己学习历程的记录,也希望能帮助更多对AI感兴趣的开发者。毕竟,AI是当前最大的技术趋势,我们都应该拥抱这个变革的时代。

在AI应用开发中,上下文管理一直是个棘手的问题。MCP(Model Context Protocol)的出现,为我们提供了一套标准化的解决方案。本文将带你深入了解MCP协议的核心概念和实现原理。

概述

MCP(Model Context Protocol)是AI领域的一个重要协议,它为AI模型提供了标准化的上下文管理机制。作为AI应用开发的基础设施,MCP解决了模型与上下文系统之间的标准化交互问题。

学习目标

- 理解MCP的基本概念和核心价值

- 掌握MCP的架构设计和工作原理

- 了解MCP在实际应用中的使用场景

- 为后续学习Agent和AI编程打下基础

什么是MCP?

MCP(Model Context Protocol)是一个开放协议,用于标准化AI模型与上下文管理系统之间的交互。它解决了AI应用开发中的关键问题:如何有效地管理和利用上下文信息来提升模型性能。

MCP的核心价值

- 标准化交互:统一AI模型与上下文系统的通信方式

- 上下文感知:让AI模型能够理解和使用对话历史

- 性能优化:通过智能上下文管理提升响应质量

- 可扩展性:支持多种AI模型和上下文源

为什么需要MCP?

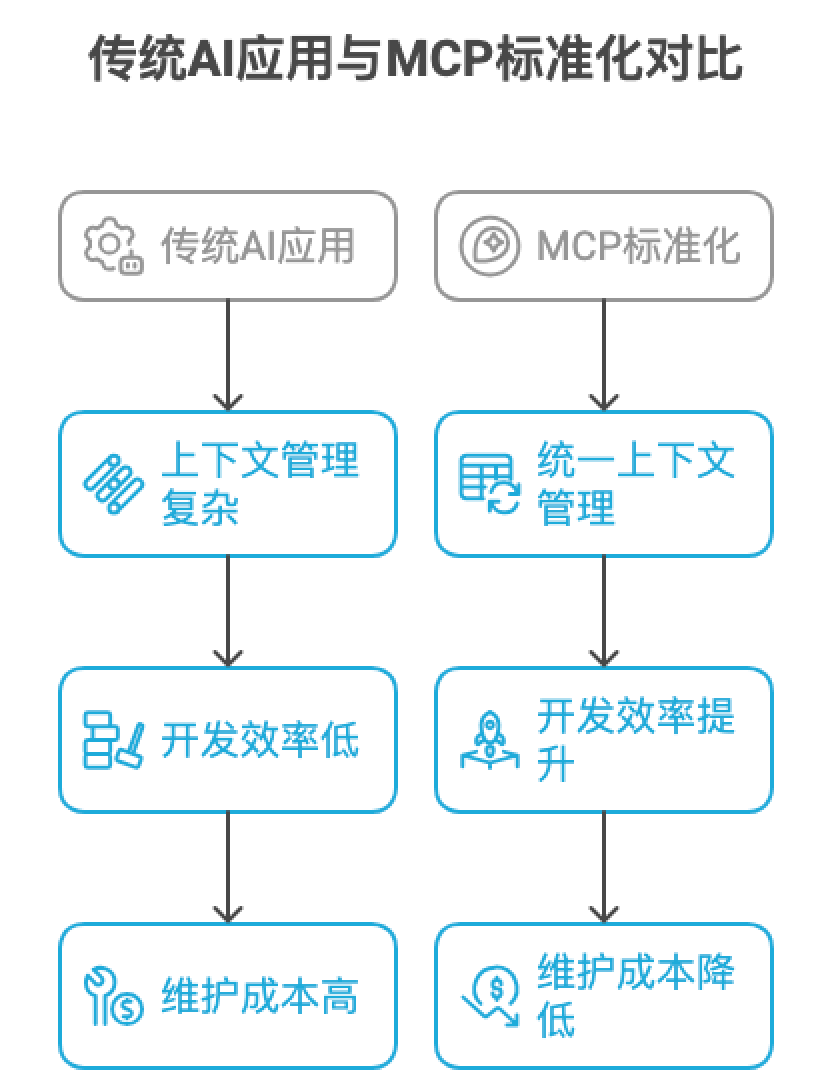

在AI应用开发过程中,上下文管理往往是最容易被忽视但又至关重要的环节。传统的上下文管理方式存在诸多问题:缺乏标准化、难以维护、性能不稳定等。MCP的出现,为这些问题提供了系统性的解决方案。

MCP的重要性

MCP核心概念

1. 上下文(Context)

在MCP中,上下文指的是模型理解和处理任务所需的所有相关信息。这包括:

- 对话历史:用户与模型的交互记录

- 用户偏好:个性化设置和行为模式

- 系统状态:当前应用环境和配置

- 外部数据源:数据库、API等外部信息

2. 协议层(Protocol Layer)

MCP定义了多个协议层,每个层负责不同的功能:

| 协议层 | 功能描述 | 示例 |

|---|---|---|

| 传输层 | 数据传输和通信 | HTTP, WebSocket |

| 会话层 | 会话管理和状态维护 | Session ID |

| 上下文层 | 上下文数据管理 | Context API |

3. 数据模型(Data Model)

MCP使用标准化的数据模型来表示上下文信息:

{

"context": {

"id": "session_123",

"timestamp": "2025-11-19T10:00:00Z",

"metadata": {

"user_id": "user_456",

"model_type": "gpt-4"

},

"content": [

{

"role": "user",

"message": "你好,我需要帮助",

"timestamp": "2025-11-19T10:00:00Z"

}

]

}

}

MCP架构解析

整体架构

详细架构说明

1. 客户端层 (Client Layer)

组件职责:

- 用户界面: 提供用户交互界面

- MCP客户端: 实现MCP协议,处理与服务器的通信

- 会话管理器: 管理本地会话状态

- 上下文缓存: 缓存常用上下文数据,提升性能

2. 服务器层 (Server Layer)

组件职责:

- API网关: 路由请求,负载均衡

- 认证授权: 验证用户身份和权限

- 协议解析器: 解析MCP协议消息

- 上下文管理器: 核心业务逻辑,管理上下文生命周期

- 数据持久化: 处理数据存储操作

- 模型适配器: 适配不同的AI模型接口

3. 数据层 (Data Layer)

存储策略:

- 关系数据库: 存储结构化数据(用户信息、会话元数据)

- 缓存层: 存储热点数据,提升读取性能

- 文件存储: 存储大文件和非结构化数据

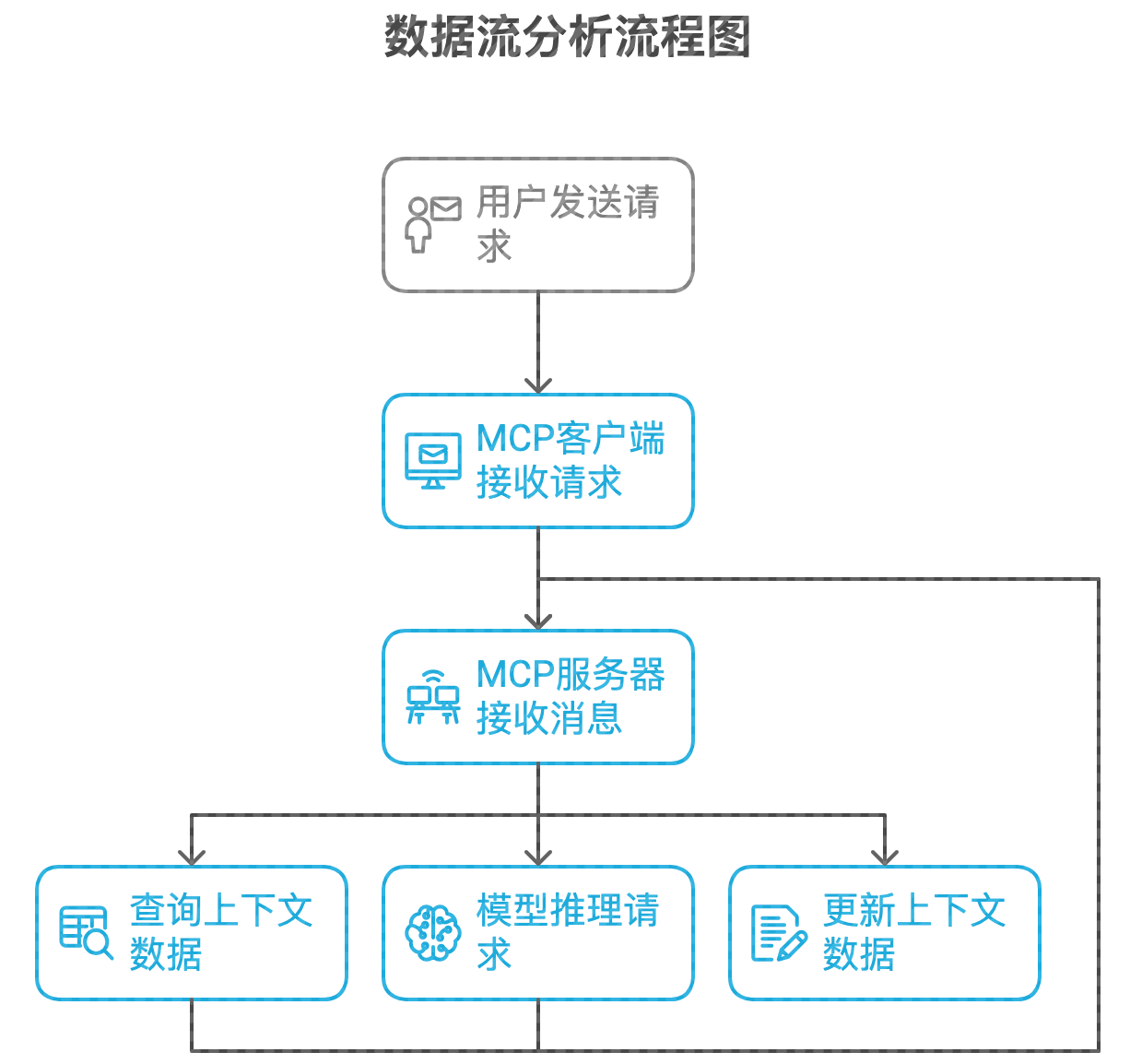

数据流分析

MCP的数据流遵循清晰的请求-响应模式:用户请求经过客户端层处理后,通过MCP协议发送到服务器层,服务器处理后调用AI模型服务,最终将结果返回给用户。

核心特性

1. 上下文管理

MCP提供了完整的上下文管理功能:

- 上下文创建: 初始化新的会话上下文

- 上下文更新: 动态添加新的对话内容

- 上下文查询: 检索历史对话信息

- 上下文清理: 智能管理上下文长度

2. 协议标准化

MCP协议的设计遵循以下原则:

- 向后兼容: 新版本协议兼容旧版本

- 可扩展性: 支持自定义扩展字段

- 安全性: 内置认证和授权机制

- 性能优化: 支持批量操作和流式传输

3. 多模型支持

MCP可以适配多种AI模型:

- OpenAI系列: GPT-3.5, GPT-4, GPT-4 Turbo

- 开源模型: Llama, ChatGLM, Baichuan

- 专用模型: 代码生成、图像理解、语音识别

应用场景

1. 智能客服系统

利用MCP管理多轮对话上下文,提供个性化的客户服务体验。

2. 代码助手

在编程环境中,MCP可以维护代码上下文,提供准确的代码补全和建议。

3. 内容创作

帮助创作者管理创作过程中的上下文信息,生成连贯的内容。

4. 教育应用

在在线教育平台中,MCP可以跟踪学生的学习进度和对话历史。

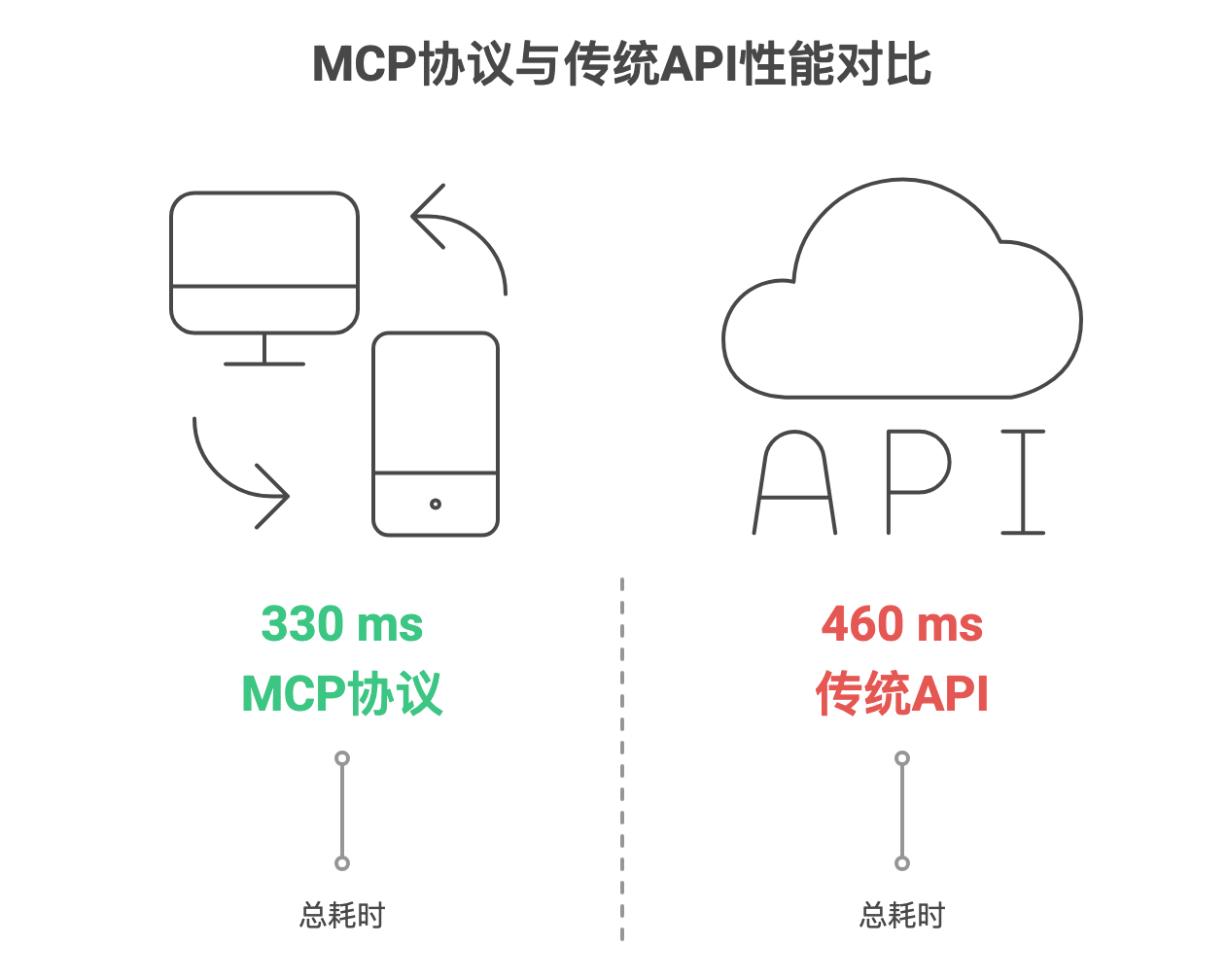

性能优势

MCP通过标准化的上下文管理机制,显著提升了AI应用的性能表现。相比传统的上下文处理方式,MCP能够:

- 减少上下文传输的开销

- 提高模型推理的效率

- 优化内存使用和缓存策略

- 支持大规模并发处理

下一步学习

在掌握了MCP的基础概念后,建议继续学习:

- AI Agent入门指南:了解如何基于MCP构建智能代理系统

- AI编程实践:学习如何在实际项目中应用MCP技术

参考资料

下一篇预告:在下一篇文章《AI Agent入门指南:构建智能代理系统》中,我们将探讨如何基于MCP协议构建能够自主决策和执行的智能代理系统,让AI应用具备更强的自主性和智能性。

1660

1660

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?