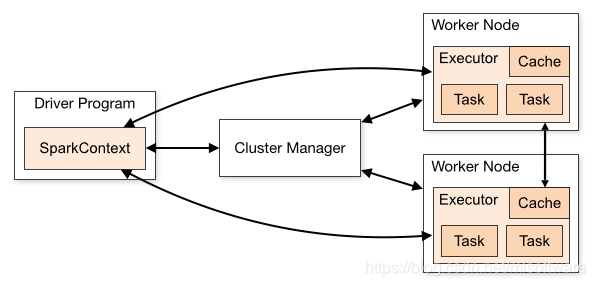

1、spark应用程序启动(driver)

2、调用spark context初始化配置和输入数据

3、spark context启动DAGSchedule构造DAG图,切分任务

4、Driver向Cluster Manager请求计算资源

5、Cluster Manger根据Driver的主机地址等信息同志集群的所有计算节点Worker

6、Worker收到信息,根据Driver的主机地址,向Driver通信注册,根据本地空闲资源,报告可以领取的任务数

7、Driver根据DAG分配任务给Worker

8、Worker收到任务后,启动Executor执行任务,如果本地没有Driver代码,则下载,通过反射加载执行

spark的执行过程

最新推荐文章于 2024-07-02 09:36:29 发布

本文详细介绍了Spark应用程序的启动过程,从Driver程序初始化SparkContext开始,到DAGScheduler构造DAG图,再到Driver向ClusterManager请求资源,最后到Worker执行任务的整个流程。深入解析了Spark如何调度和执行任务。

本文详细介绍了Spark应用程序的启动过程,从Driver程序初始化SparkContext开始,到DAGScheduler构造DAG图,再到Driver向ClusterManager请求资源,最后到Worker执行任务的整个流程。深入解析了Spark如何调度和执行任务。

5455

5455

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?