毕设的开题工作已经开始进行了,题目是“基于学术大数据分析的导师推荐系统”。之前和学长讨论了一下,觉得在进行推荐之后,如何得到用户反馈,如何了解推荐的效果是一个需要解决的问题。基于这个问题,学姐给出了一个方向,就是将推荐系统设计成可解释推荐系统,一次得到交互和反馈。

今天一大早,开始自学可解释性。主要参考和引用:http://www.sohu.com/a/279581943_133098?qq-pf-to=pcqq.c2c

以下为正文。

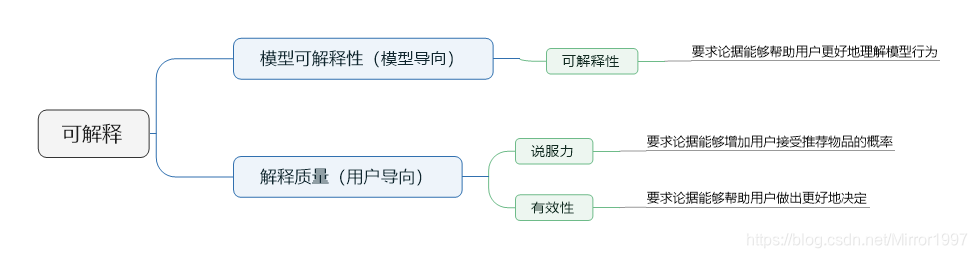

目的:在给用户进行相关推荐的时候,添加解释和推荐原因是十分有必要的。通过提高系统的可解释性,构建可解释系统,为用户提供“推荐+解释”的组合,从而优化推荐结果,提高系统可信任度和透明度。

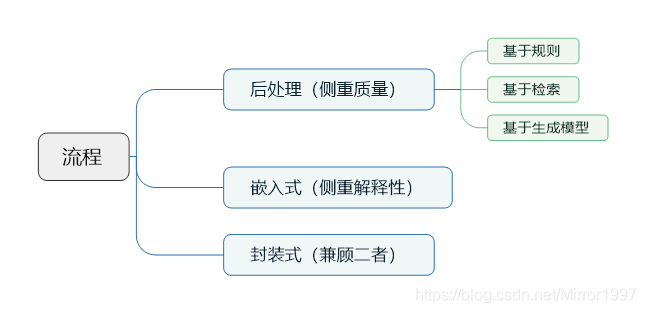

流程:

基于规则:是指由解释方法设计者事先给定一些简单模板(例如“N个微博用户都喜欢这个商品”),

本文探讨了在推荐系统中增加解释性的重要性,介绍了基于规则、检索、嵌入式和封装式四种方法来构建可解释推荐系统。通过提高系统的可解释性,可以增强用户信任度和透明度。文中提到了Microsoft Concept Graph和多视角学习等技术在构建深度可解释网络中的应用,并利用增强学习框架来优化解释质量和模型的解释能力。

本文探讨了在推荐系统中增加解释性的重要性,介绍了基于规则、检索、嵌入式和封装式四种方法来构建可解释推荐系统。通过提高系统的可解释性,可以增强用户信任度和透明度。文中提到了Microsoft Concept Graph和多视角学习等技术在构建深度可解释网络中的应用,并利用增强学习框架来优化解释质量和模型的解释能力。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

799

799

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?