测试环境:py3+win10

- 安装:cmd命令行输入 pip3 install jieba

- 介绍:jieba是个不错的中文分词第三方库,需要额外安装;利用一个中文词库,确定汉字之间的关联概率;汉字间概率大的组成词组,形成分词结果;除了分词,用户还可以添加自定义的词组。

- 三种模式:

- 精确模式:把文本精确地切分开,不存在冗余的单词。

- 全模式:把文本中所有可能的词语都扫描出来,有冗余。

- 搜索引擎模式:在精确模式基础上,对长词再次切分。

-

常用函数:(函数前带‘l’字母的,返回列表)

- jieba.cut(string) 精确模式,返回一个可迭代的数据类型

- jieba.cut(string,cut_all=True) 全模式,输出文本string中所有可能的单词

- jieba.cut_for_search(string) 搜索引擎模式,适合搜索引擎建立索引的分词

- jieba.lcut(string) 精确模式,返回一个列表。

- jieba.lcut(string,cut_all = True) 全模式,返回列表。

- jieba.lcut_for_search(string) 搜索引擎模式,返回列表。

- jieba.add_word(word) 向分词词典中添加新词word

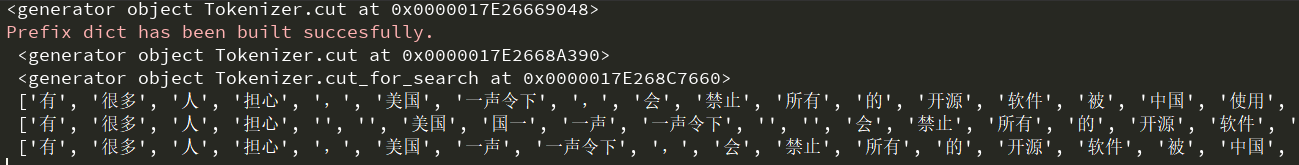

import jieba

str_test = '有很多人担心,美国一声令下,会禁止所有的开源软件被中国使用,这样的担忧是不必要的。'

'''返回迭代器'''

c1 = jieba.cut(str_test)

c2 = jieba.cut(str_test,cut_all=True)

c3 = jieba.cut_for_search(str_test)

'''返回列表'''

list_c1 = jieba.lcut(str_test)

list_c2 = jieba.lcut(str_test,cut_all=True)

list_c3 = jieba.lcut_for_search(str_test)

print(c1,'\n',c2,'\n',c3,'\n',list_c1,'\n',list_c2,'\n',list_c3)

返回如下:

本文介绍了jieba中文分词第三方库,其需额外安装,利用中文词库确定汉字关联概率进行分词,用户还能添加自定义词组。文中说明了精确、全、搜索引擎三种模式,以及jieba.cut、jieba.lcut等常用函数的用法。测试环境为py3+win10,可通过pip3 install jieba安装。

本文介绍了jieba中文分词第三方库,其需额外安装,利用中文词库确定汉字关联概率进行分词,用户还能添加自定义词组。文中说明了精确、全、搜索引擎三种模式,以及jieba.cut、jieba.lcut等常用函数的用法。测试环境为py3+win10,可通过pip3 install jieba安装。

2319

2319

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?