一、官方安装包基本信息

最新版本

Windows版:v0.6.0.0(国内镜像版,大小999.8M)

Linux版:v0.6.0(官方版,大小1.59G)

macOS版:支持通过官网直接下载(版本号与Windows/Linux同步)

支持平台

桌面端:Windows(Win7及以上)、Linux(x86_64/ARM64)、macOS

容器化部署:支持Docker(需配合Docker Desktop)

核心功能

简化本地部署大型语言模型(如Llama、DeepSeek、Qwen等)

支持CPU推理及硬件加速(如Apple Silicon、AMD GPU)

提供命令行工具(CLI)和API接口

二、官方安装包获取方式

官网下载

访问Ollama官网,点击“Download”按钮选择对应平台安装包

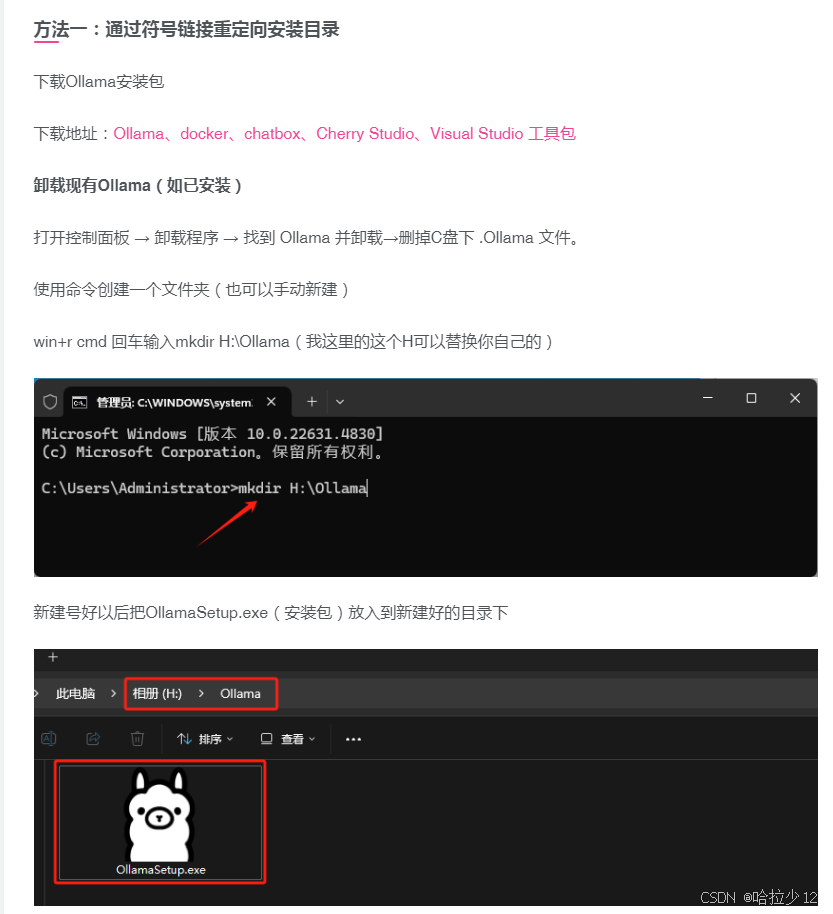

注意:Windows版安装包默认仅支持C盘安装路径(路径:C:\Users\[用户名]\AppData\Local\Programs\Ollama)

国内镜像下载

Windows中文镜像版:可通过第三方平台(如Ollama、docker、chatbox、Cherry Studio、Visual Studio工具包-语义熔炉网)获取

Linux离线安装包:提供迅雷加速下载链接(需手动解压至/usr/local目录)

命令行安装(Linux/macOS)

自动安装脚本:

Copy Code

curl -fsSL https://ollama.com/install.sh | sh 支持自动适配系统架构(x86_64/ARM64)

手动安装:

下载.tgz压缩包并解压至系统目录(如/usr/local)

配置环境变量:

Copy Code

export OLLAMA_HOST=http://[服务器IP]:11434 需设置开机启动服务

三、安装注意事项

系统要求

Windows:需预留至少2GB存储空间,推荐8GB以上内存

Linux:确保已安装sudo权限及基础依赖(如解压工具)

模型兼容性

需根据设备配置选择适配的模型版本(如低配设备避免运行过大模型)

导入本地模型时需编写配置文件(GGUF/PyTorch/Safetensors格式均支持)

常见问题

安装失败:检查网络是否可访问官网(部分镜像包需验证完整性)

模型加载错误:确认模型文件与Ollama版本兼容,避免混合使用不同框架模型

四、附加工具与扩展

Chatbox/OpenWebUI

搭配使用可实现可视化模型交互(需单独部署)

Docker集成

支持通过Docker容器化运行Ollama及关联服务(如DeepSeek R1模型)

以上信息综合自Ollama官网及主流技术社区公开文档。

整套安装包下载:

1735

1735

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?