本文主要介绍了Golang爬虫及正则表达式的实现示例,文中通过示例代码介绍的非常详细,具有一定的参考价值,感兴趣的小伙伴们可以参考一下。编程资料学习点击领取

目录

补充:正则表达式加golang爬虫爬取经典案例豆瓣top250

最近学习go,爬取网站数据用到正则表达式,做个总结;

Go中正则表达式采用RE2语法(具体是啥咱也不清楚);

字符

- . ——匹配任意字符 e.g: abc. 结果: abcd,abcx,abc9;

- [] ——匹配括号中任意一个字符 e.g: [abc]d 结果:ad,cd,1d;

- - ——[-]中表示范围 e.g: [A-Za-z0-9];

- ^ ——[^]中表示除括号中的任意字符 e.g:[^xy]a 结果:aa,da,不能为xa,ya;

数量限定

- ? ——前面单元匹配0或1次;

- + ——前面单元匹配1或多次;

- * ——前面单元匹配0或多次;

- {,} ——显示个数上下线;e.g : ip地址——[0-9]{1,3}.[0-9]{1,3}.[0-9]{1,3}.[0-9]{1,3};

其他

- \ ——转义字符;

- | ——条件或;

- () ——组成单元 如果字符串本身有括号"[(] aaa. [)]" ;

方法

| 1 2 3 4 |

|

爬虫

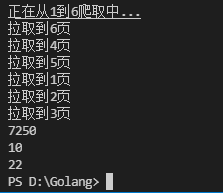

爬取博客园所有文章阅读量,评论,推荐;

| 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71 72 73 74 75 76 77 78 79 80 81 82 83 84 85 86 87 88 89 90 91 92 93 94 95 96 97 98 99 100 101 102 103 104 105 106 107 108 109 110 111 112 113 114 115 116 |

|

补充:正则表达式加golang爬虫爬取经典案例豆瓣top250

| 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71 72 73 74 75 76 77 78 79 80 81 82 83 84 85 86 87 88 89 90 91 92 93 94 95 96 97 98 99 100 101 102 103 |

|

到此这篇关于Golang爬虫及正则表达式的实现示例的文章就介绍到这了,感谢关注,为你们准备了编程学习的一套资料,还有相应的代码,视频教程都可以获取,添加Q裙703046414即可获取。

本文详细讲解了使用Golang实现爬虫并结合正则表达式进行数据提取的过程,包括字符匹配、数量限定等正则概念,并提供了一个爬取豆瓣Top250的案例。

本文详细讲解了使用Golang实现爬虫并结合正则表达式进行数据提取的过程,包括字符匹配、数量限定等正则概念,并提供了一个爬取豆瓣Top250的案例。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?