!!!摘于GPT

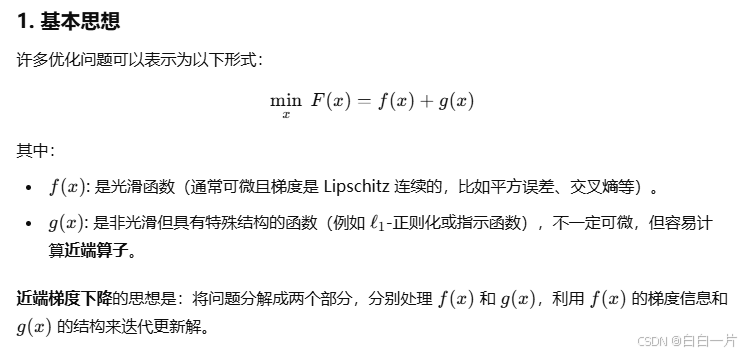

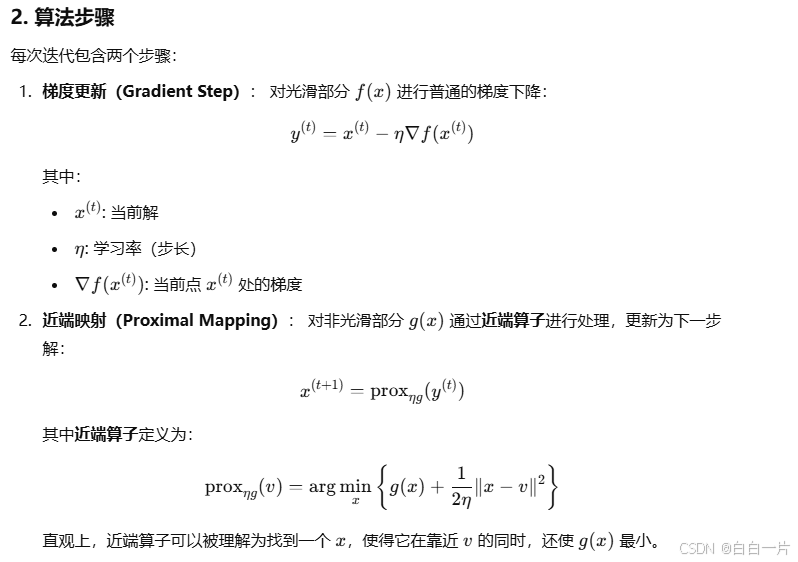

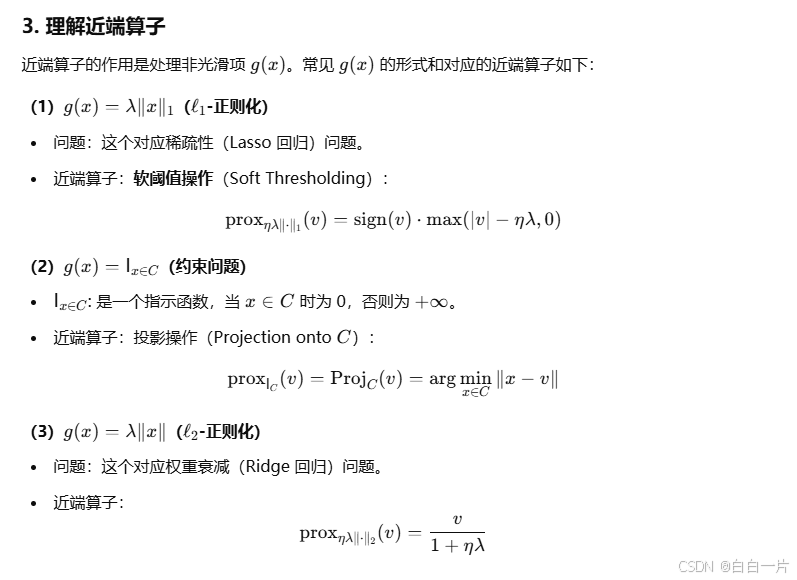

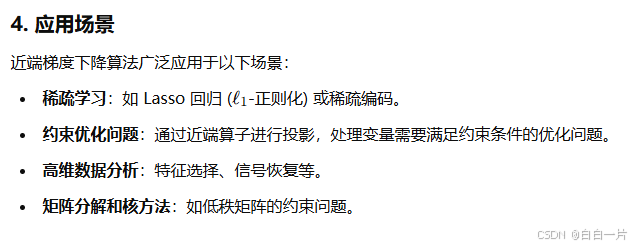

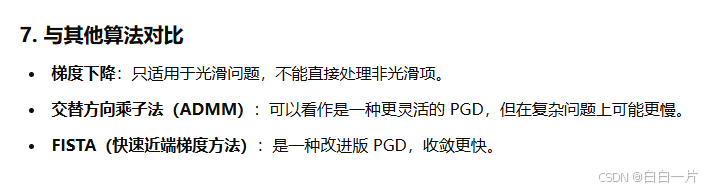

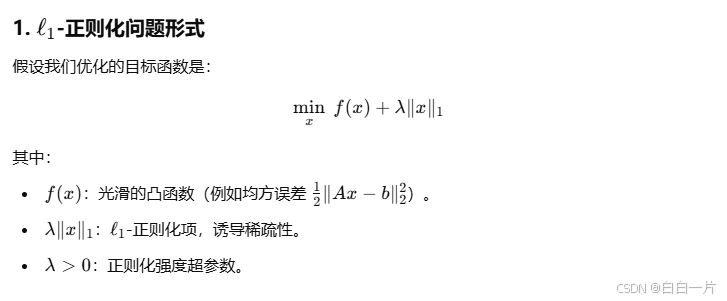

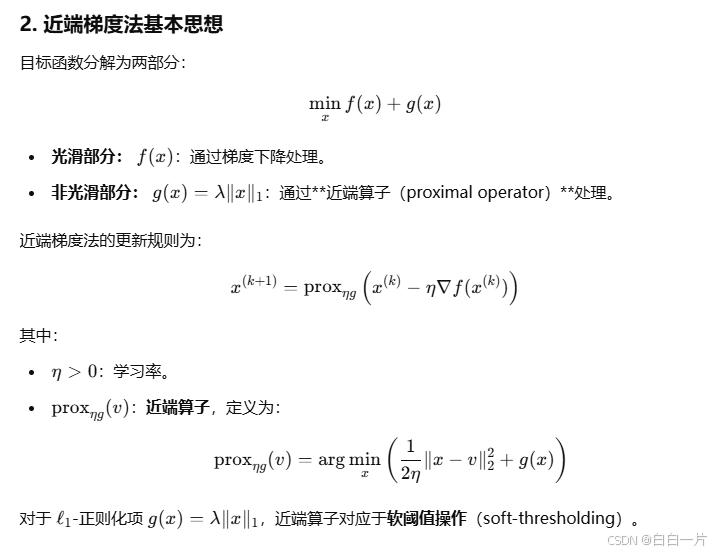

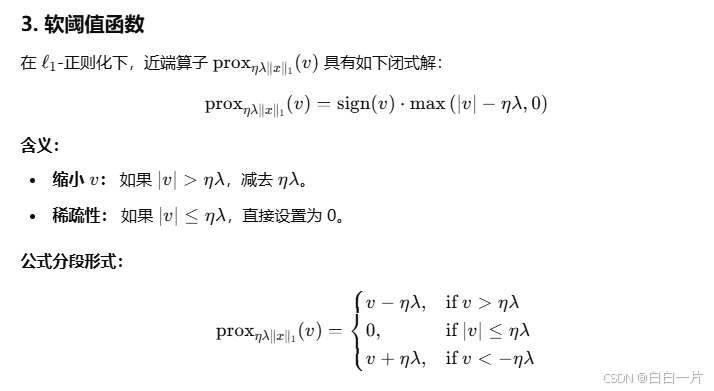

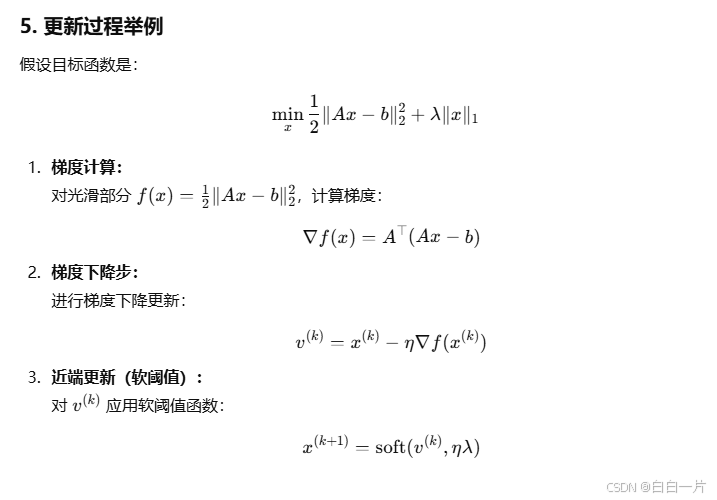

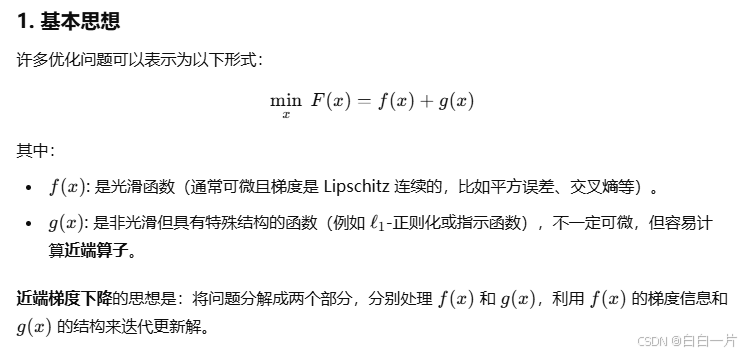

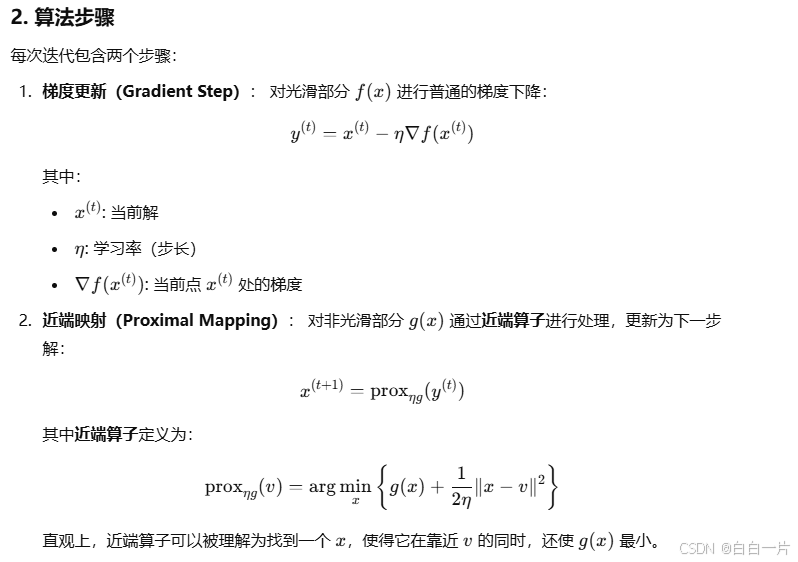

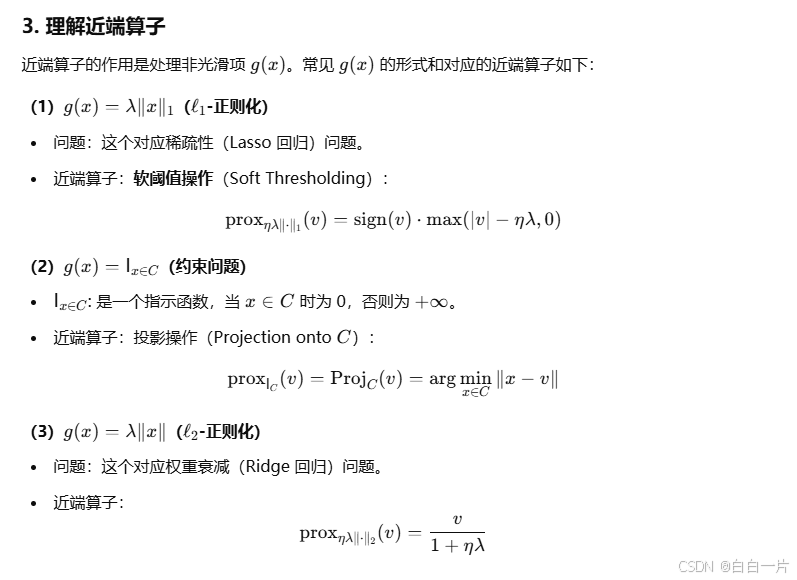

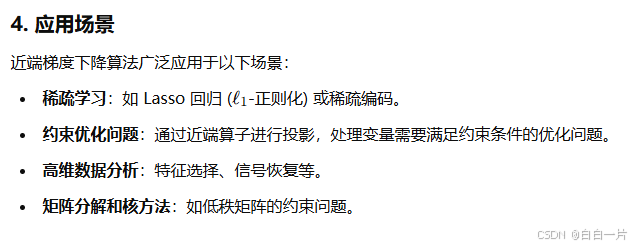

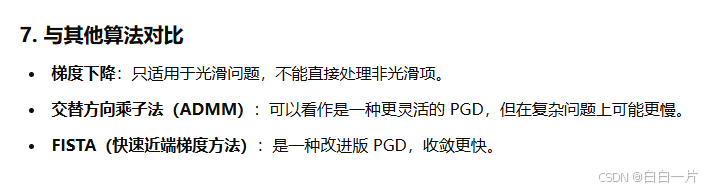

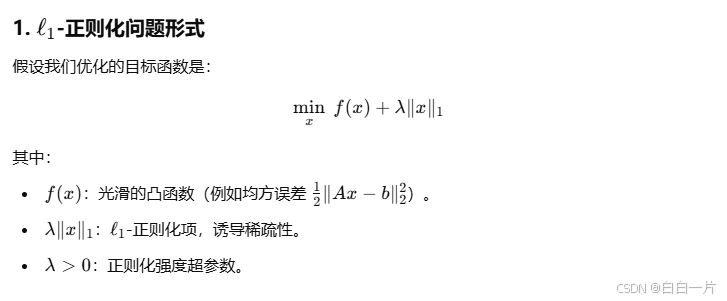

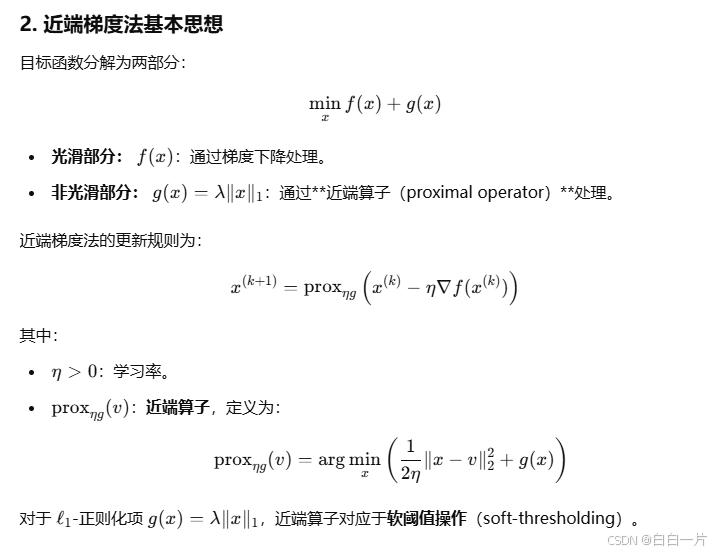

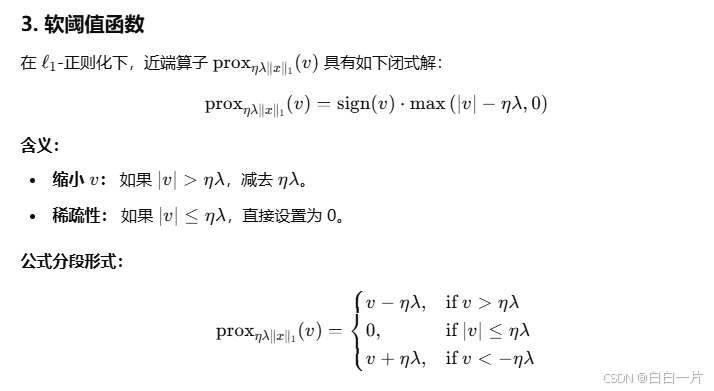

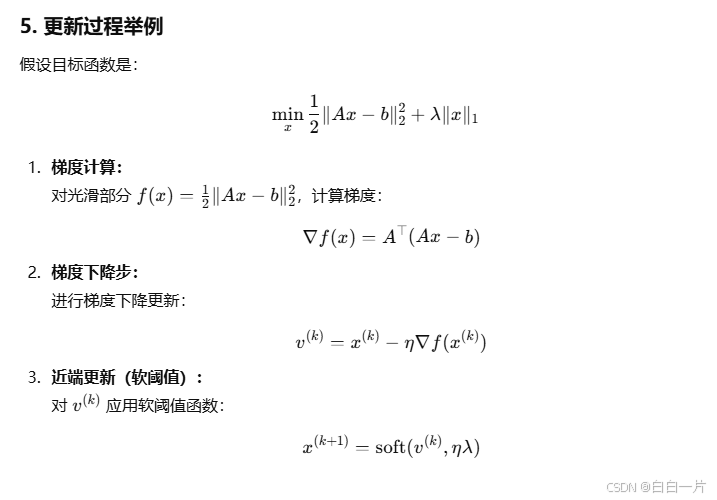

近端梯度下降优化算法(Proximal Gradient Descent, 简称 PGD)是一种用于优化非光滑目标函数的优化方法。它扩展了传统梯度下降算法,可以有效处理目标函数中包含非光滑项的情况,特别是在稀疏性、约束优化等问题中应用广泛。

!!!摘于GPT

近端梯度下降优化算法(Proximal Gradient Descent, 简称 PGD)是一种用于优化非光滑目标函数的优化方法。它扩展了传统梯度下降算法,可以有效处理目标函数中包含非光滑项的情况,特别是在稀疏性、约束优化等问题中应用广泛。

3118

3118

6136

6136

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?