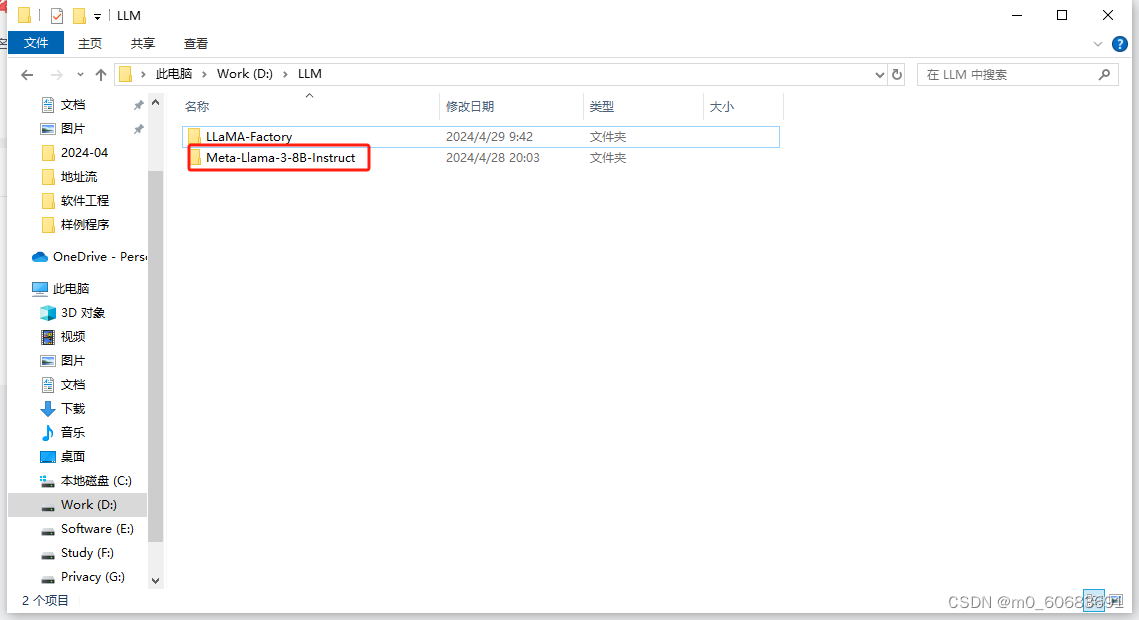

一、安装llama模型文件

下载地址(魔塔):https://modelscope.cn/models/LLM-Research/Meta-Llama-3-8B-Instruct/files

点击下载模型,复制git命令:

git clone https://www.modelscope.cn/LLM-Research/Meta-Llama-3-8B-Instruct.git

在存放模型空白处右键,点击git bash here,下载llama3模型至本地

由于文件较大,因此该过程比较久,保持下载窗口打开,知道出现下一命令行表示下载完成。

二、安装LLaMA-Factory

github:

本文详细指导如何下载并安装LLaMA模型,包括Meta-Llama-3-8B-Instruct版本,以及使用LLaMA-Factory进行模型环境配置、微调和导出的过程。

本文详细指导如何下载并安装LLaMA模型,包括Meta-Llama-3-8B-Instruct版本,以及使用LLaMA-Factory进行模型环境配置、微调和导出的过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1556

1556

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?