CCAFNet: Crossflow and Cross-scale Adaptive Fusion Network for Detecting Salient Objects in

RGB-D Images

CCAFNet跨流和跨尺度自适应融合网络用于RGB-D 图像显著目标检测

一 动机

现有的 SOD 模型主要利用 RGB 图像及其在三个融合域中的相应深度信息之间的关系:输入 RGB-D 图像、提取的特征图和输出显着对象。然而,这些模型并没有很好地利用高级和低级信息之间的交叉流动。此外,这些模型中的解码器使用涉及多个计算的传统卷积。

二 方法

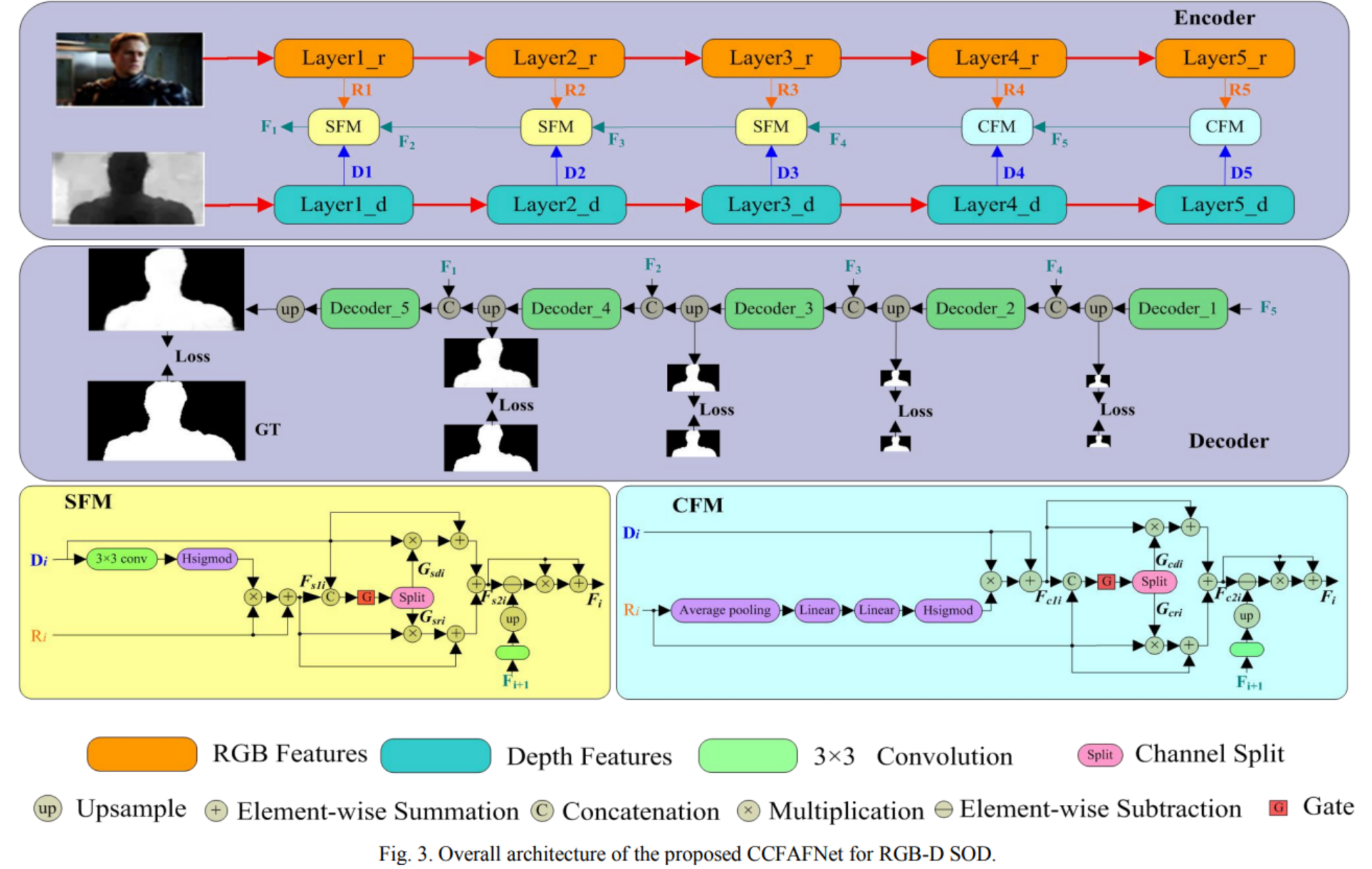

提出了一种跨流和跨尺度自适应融合网络 (CCAFNet) 来检测 RGB-D 图像中的显著对象

三 网络框架

该网络包括一个特征编码器和一个特征解码器。 在编码器中,RGB 图像及其对应的深度图首先被馈送到 SOD 的双流架构。 骨干网络VGG,CFM 和 SFM 改进了低级空间信息和高级语义信息的融合。 不仅使用高级语义信息,还使用低级空间信息来实现跨模态语义和空间互补信息的融合。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1174

1174

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?