对比学习的主要思想就是相似的样本的向量距离要近,不相似的要远.对比学习在有监督/无监督场景下都取得了非常亮眼的成绩,所以是我们炼丹的必备知识.早期的对比学习是只有一个正样本和一个负样本进行对比,最近的训练目标变成了一个batch内多个正/负样本进行训练.

Contrastive Loss

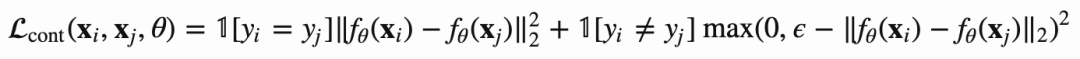

有一系列样本{xi},它们的label yi = {1, ..., L}, L类,还有个函数f将样本xi映射成embedding,有着相同yi的样本有着相似的embedding, 因此对比学习loss定义如下:

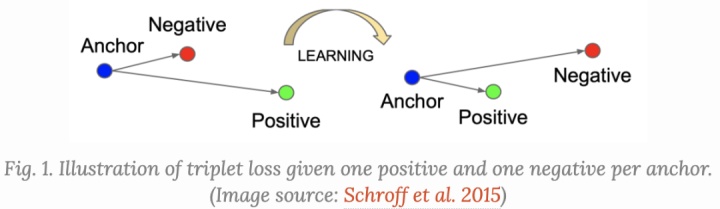

Triplet Loss

Triplet loss大家应该并不陌生,最早出现在FaceNet的论文里,这篇论文主要学习人脸表达,需要同一个人在不同角度位置的表达都很相近.

定义一个锚点(anchor) x,有个正例x+和一个负例x-,所以目标函数就是要最小化x和x+的距离,最大化x和x-的距离,定义如下所示:

本文详细介绍了对比学习中的多种训练目标,包括Contrastive Loss、Triplet Loss、Lifted Structured Loss、N-pair Loss、NCE和InfoNCE,以及Soft-Nearest Neighbors Loss,这些损失函数在深度学习、机器学习和人工智能领域中对于优化模型表现至关重要,特别是在无监督和有监督学习场景下。

本文详细介绍了对比学习中的多种训练目标,包括Contrastive Loss、Triplet Loss、Lifted Structured Loss、N-pair Loss、NCE和InfoNCE,以及Soft-Nearest Neighbors Loss,这些损失函数在深度学习、机器学习和人工智能领域中对于优化模型表现至关重要,特别是在无监督和有监督学习场景下。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?