数据描述

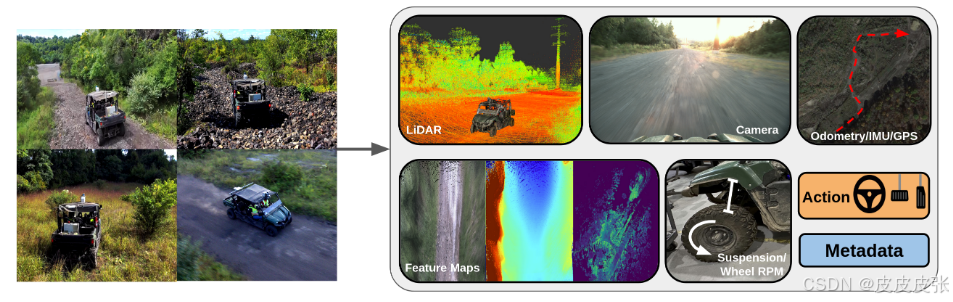

2021年CMU发布了TartanDrive1.0数据集。2024年,作为原始数据集的后续工作,CMU以 15m/s 的速度收集了 7 个小时的数据,并在原始相机、惯性传感器、GPS 传感器和本体传感器旁边添加了三个新的 LiDAR 传感器,并将其命名为TartanDrive2.0,该数据集适用于自我监督学习任务的大规模越野驾驶数据集。

数据获取途径:https://github.com/castacks/tartan_drive_2.0

数据集主页:TartanDrive 2.0

元数据

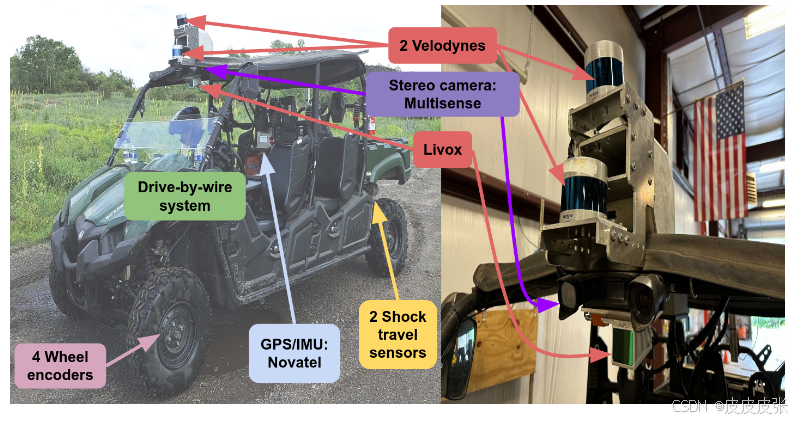

传感器

3个激光雷达: 2个32线Velodyne,其中一个向下倾斜,以获得近车附近的地面信息; 1个Livox Mid-70 安装在MultiSense相机下方。提供车辆正前方信息。所有Lidar均配置为10Hz运行

2个Mu

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3356

3356

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?