这篇文章是2024年发表在《Computers & Security》上的关于FL中的客户端-服务器攻击与防御综述。以下是自己的重点总结

论文链接:《A review on client-server attacks and defenses in federated learning

摘要

联邦学习 (FL) 提供去中心化机器学习 (ML) 功能,同时可以保护数据隐私。 然而,这种架构带来了独特的安全挑战。本文对这些挑战进行了全面调查,根据目标对攻击进行分类:客户端训练数据、本地模型、FL 通道、服务器端聚合参数和全局模型。我们进一步讨论为本地和全局模型量身定制的防御机制。 通过我们的调查,我们阐明了 FL 固有的漏洞,并提供了确保鲁棒性的对策的见解。我们的研究结果强调了双重重点策略的重要性,即解决客户端和服务器级别的安全问题。

1 引言

主要工作:

- 我们对FL中的攻击进行了详细而全面的分类,区分了客户端和服务器端目标。

- 我们深入研究每种已识别的攻击类型,阐明其方法、潜在影响以及它在现实世界的 FL 系统中带来的挑战。

- 我们提供了实施安全措施的系统指南,强调分层防御策略,解决 FL 中客户端和服务器级别的漏洞。

- 我们强调双重战略的必要性,展示了保护 FL 中客户端和服务器端组件的相互交织的挑战和好处。

- 我们通过提供关于 FL 安全性的综合资源、综合最新研究并以适合新手和专家的可访问格式呈现,来弥补当前文献中的空白。

对 FL 范式中的攻击和防御进行细致的分类。 认识到漏洞和威胁在 FL 生态系统中的分布并不均匀,我们根据具体目标对它们进行了细分:客户端,包括训练数据、本地模型和 FL 通道本身,以及服务器端,重点关注聚合参数或梯度 以及总体的全局模型。 同样,我们的防御策略经过定制,可以保护客户端的本地模型和服务器端的全局模型。

1.1 研究问题

FL 中的客户端:

- 攻击者如何利用或毒害 FL 设置中各个客户端的训练数据来破坏全局模型,此类攻击对现实世界有何影响?

- FL 的去中心化性质如何影响本地模型对对抗性攻击的敏感性,以及在这种情况下哪种类型的攻击最有效?

- FL 客户端更新过程中有哪些可供攻击者利用的关键漏洞,以及如何在实际应用中解决这些漏洞?

- FL 如何用于秘密通信,这些类型的攻击会产生哪些后果,以及哪些实际场景使 FL 特别容易受到此类滥用?

FL 中的服务器端:

- 攻击者如何在 FL 的模型聚合阶段操纵或窃听聚合的更新或梯度,以及哪些现实场景使服务器端更容易受到这些攻击?

- FL 中的受感染服务器会带来哪些风险,特别是涉及全局模型的完整性,以及在实践中哪些措施可以有效减轻这些风险?

- 攻击者如何利用 FL 系统中的恶意客户端来影响全局模型,以及哪些策略可以识别和应对此类协同攻击?

FL 中的防御:

- 在 FL 系统中检测或减轻来自恶意客户端的有毒更新的最有效策略是什么?哪些策略在特定的现实场景中最有希望?

- FL 服务器如何确保从客户端接收到的更新的完整性和真实性,以及这些防御机制对各种应用领域有何影响?

- 哪些防御机制可以有效保护客户数据隐私,同时仍对全局模型做出贡献?这些防御机制在有效性和实用性方面与传统集中式学习防御相比如何?

比较分析:

- 在 FL 的背景下,哪个群体更容易受到攻击:客户端组件还是服务器端组件?哪些因素导致这种易感性?

- 考虑到 FL 的独特挑战,传统的集中式学习防御与 FL 环境中所需的防御相比如何,特别是在解决特定的现实威胁方面?

- 可以提出哪些未来的研究方向和客观见解来增强对 FL 安全性的理解和有效性,特别是在确定针对双方最有效的攻击的最有效的防御技术方面?

1.2 FL背景

FL学习步骤:

- 初始化:选择要训练的ML模型架构。 设置模型的参数。

- 客户端选择:选择一组客户端(去中心化设备)参与FL过程。 这些客户负责在本地训练模型。

- 模型分发:将初始模型分发给已选定的客户。 此阶段至关重要,因为它确保所有客户端都以相同的模型状态开始训练过程。

- 本地模型训练:每个选定的客户都使用其本地数据来进一步训练模型。 这需要计算相对于本地数据的梯度并改变模型的参数。 本地训练过程中可以使用各种优化方法,例如随机梯度下降(SGD)。

- 模型更新的聚合:在本地训练之后,必须聚合所有参与客户的模型更新(梯度)。

- 重复步骤2至4:执行步骤2至5,直到模型收敛或满足预定的停止阈值。

- 评估:为了跟踪进度,定期在验证数据集上评估全局模型的性能。

- 部署:当FL过程完成后,训练好的全局模型可以用来对新数据进行推理。

FL分类:

- 水平 FL:这是最常见的场景(Yang et al., 2019),其中多个客户端拥有来自不同用户的数据样本,但数据保留在相同的特征空间中。当多个组织拥有不同的用户数据但相似的数据类型时,经常会出现这种情况。例如,两个卫生机构可能拥有来自不同人群的患者数据。

- 垂直 FL:在这种更复杂的设置中(Cheng 等人,2020),多个客户端具有重叠的数据,但每个客户端都有自己的一组功能。如果我们考虑用户的在线行为,一家公司可能有他们的浏览历史记录,而另一家公司可能有他们的购买信息。

- 联合迁移学习:经典机器学习中的迁移学习涉及对一项工作(源域)上的预训练模型进行微调,以执行另一项通常相关的任务。目标是利用源领域的大数据来帮助数据较少的目标领域的学习。联合迁移学习(Liu et al., 2020a)将此概念应用于联合环境。 为了避免数据分布不平衡或稀缺性,联合迁移学习用于将知识从数据较多的领域迁移到数据较少的领域。

1.3相关工作

无线联邦学习 (WFL) 中的后门攻击(Wan 等人,2023)

分类为数据和模型中毒类型,并非常注重细节。 这项研究广泛地研究了这些攻击所表现出的复杂性和隐蔽性,仔细审查了多个阶段,包括初始数据收集、模型聚合以及对不同防御策略有效性的评估。 它强调在 WFL 中使用非 IID 数据来进一步实施这些攻击,强调了能够抵御这些网络的动态和分布式特征的适应性防御机制的重要性。

梁加等人(2023)的注意力发生了转移。

FL 客户端存在的漏洞,特别强调与数据和模型中毒相关的复杂性。 这项调查强调了理解受损模型或有毒数据可能严重阻碍学习过程、导致错误或偏见结论的方式的关键性质。

Mothukuri 等人(2021)扩展了这个主题。

通过涵盖广泛的攻击向量和相应的防御机制。 本文探讨了 FL 中安全和隐私的复杂问题。它研究了各种攻击向量(包括中毒和推理)如何需要不同的防御策略,包括安全聚合协议和增强的隐私保护技术。

Sikandar 等人(2023)提供了全面的分析。

各种攻击向量,例如模型反转、规避和复杂的后门攻击。 这项调查对差分隐私和对抗训练等对策进行了批判性分析,以评估它们在防御这些复杂攻击策略方面的功效。

Chen 等人(2023)检查了 FL 系统的弹性和完整性。

本研究探讨了一系列攻击向量和对策,为加强 FL 对抗对抗性操纵的可信度和鲁棒性的关键作用提供了宝贵的视角。

Nair 等(2023)提供了对抗性攻击的详尽分类。

罗德里格斯·巴罗佐等人(2023),涵盖客户端和服务器端的各种潜在漏洞。

这些调查根据攻击的特征、目标和对 FL 生态系统的影响对攻击进行分类,对 FL 的潜在安全挑战进行了全面分析。

戈塞林等人(2022) 通过研究保护隐私的最先进方法。

包括同态加密、安全多方计算和差分隐私,提出了创新的观点。 本文探讨了各种安全攻击及其相应的解决方案,例如复杂的中毒和拜占庭攻击。 此外,它还深入研究了由于 FL 中通信和数据的异构性而出现的独特障碍。通过对不同的通信高效机制进行检查并提出异质性的可能解决方案,本次调查有助于集体理解 FL 系统中隐私、安全和效率之间复杂的相互作用。 它通过检查FL安全和隐私动态领域内的潜在障碍和可能的研究途径,为正在进行的讨论做出了贡献。

2 安全威胁及对策概述

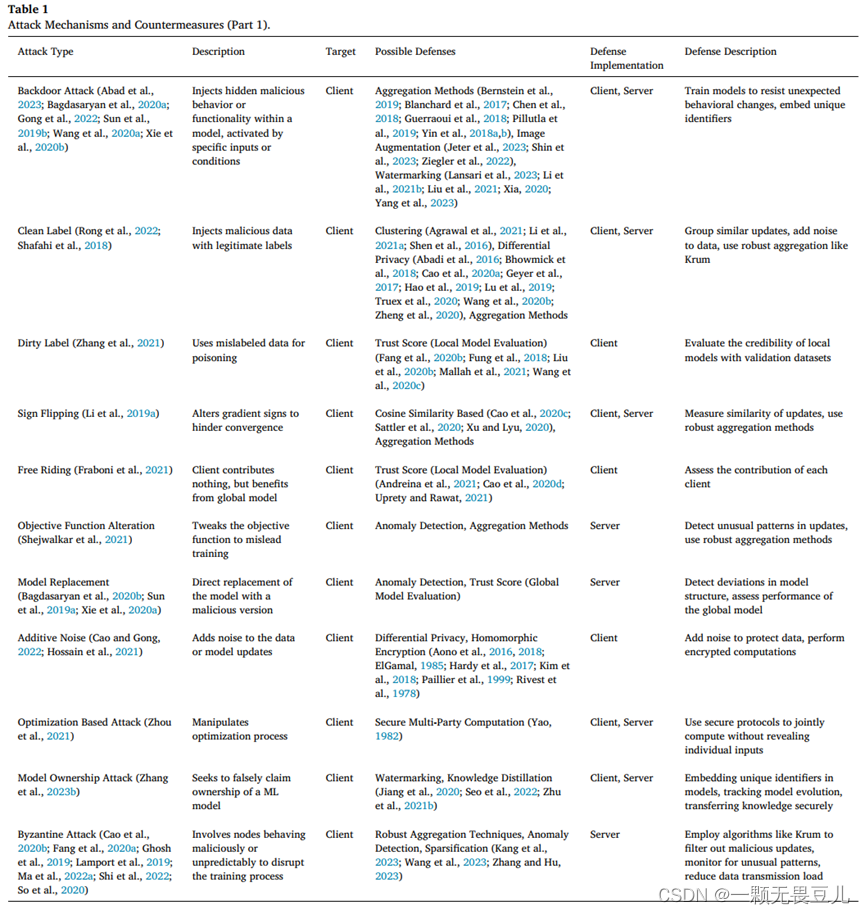

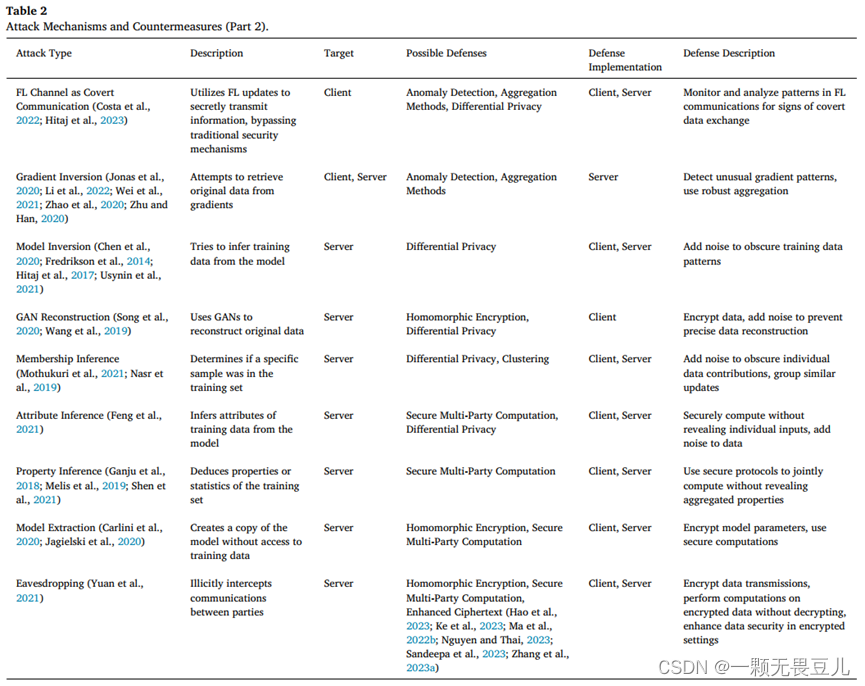

表 1 和表 2 高度概述了 FL 框架中的各种威胁和相应的对策

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1143

1143

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?