在分类任务中,人们总是喜欢基于错误率来衡量分类器任务的成功程度。错误率指的是在所有测试样例中错分的样例比例。实际上,这样的度量错误掩盖了样例如何被分错的事实。在机器学习中,有一个普遍适用的称为混淆矩阵(confusion matrix)的工具,它可以帮助人们更好地了解分类中的错误。

比如有这样一个在房子周围可能发现的动物类型的预测,这个预测的三类问题的混淆矩阵如下表所示:

利用混淆矩阵可以充分理解分类中的错误了。如果混淆矩阵中的非对角线元素均为0,就会得到一个近乎完美的分类器。

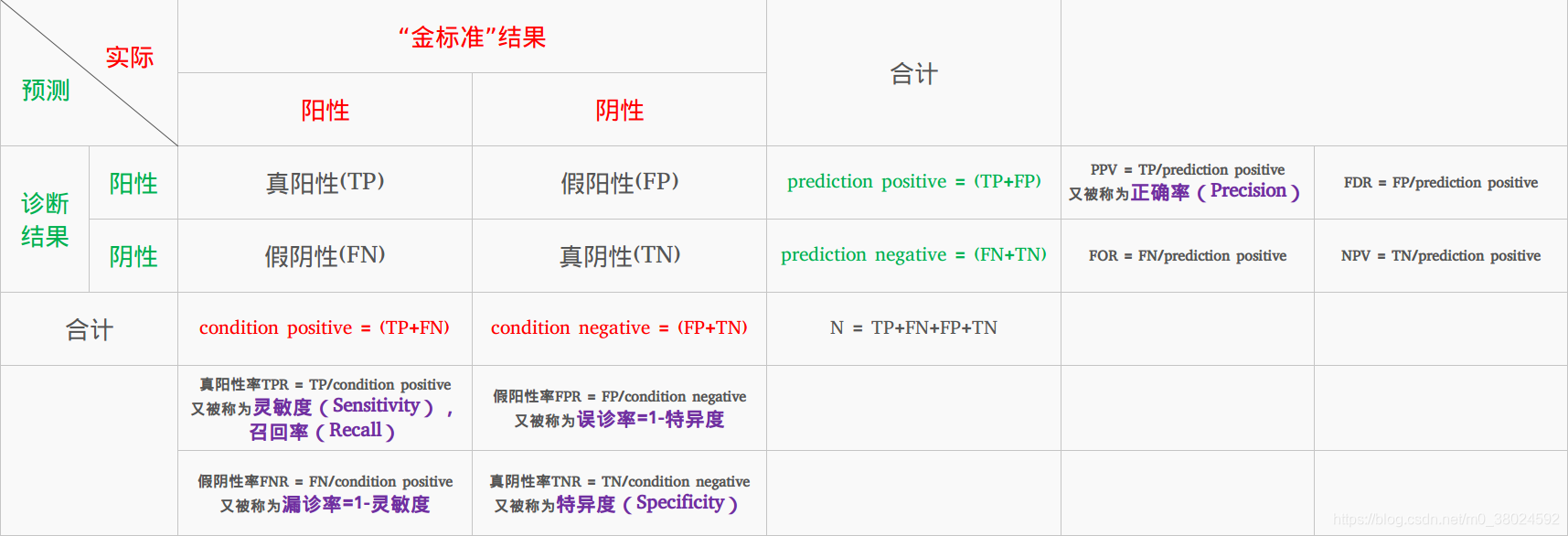

在接下来的讨论中,将以经典的二分类问题为例,对于多分类类比推断。

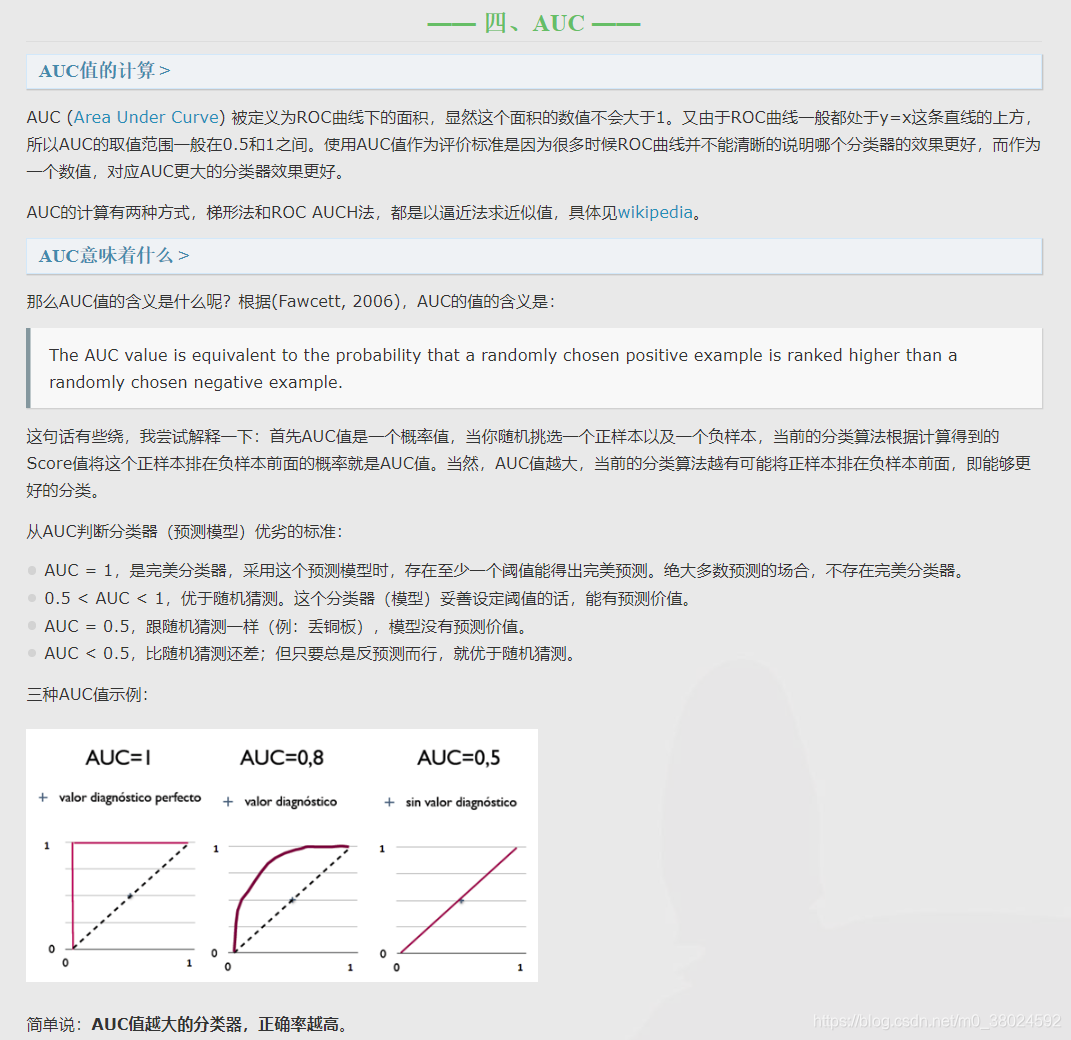

二分类问题在机器学习中是一个很常见的问题,经常会用到。ROC (Receiver Operating Characteristic) 曲线和 AUC (Area Under the Curve) 值常被用来评价一个二值分类器 (binary classifier) 的优劣。之前做医学图像计算机辅助肺结节检测时,在评定模型预测结果时,就用到了ROC和AUC,这里简单介绍一下它们的特点,以及更为深入地,讨论如何作出ROC曲线图和计算AUC值。

ROC曲线:接收者操作特征曲线(receiver operating characteristic curve),是反映敏感性和特异性连续变量的综合指标,roc曲线上每个点反映着对同一信号刺激的感受性。

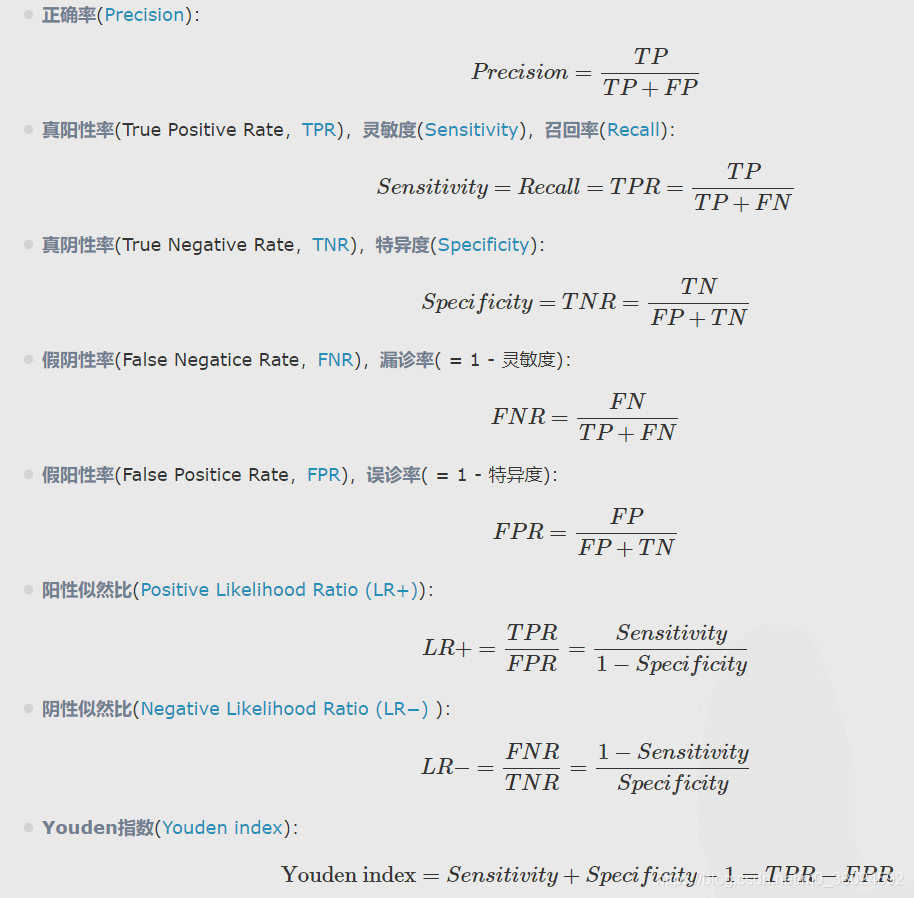

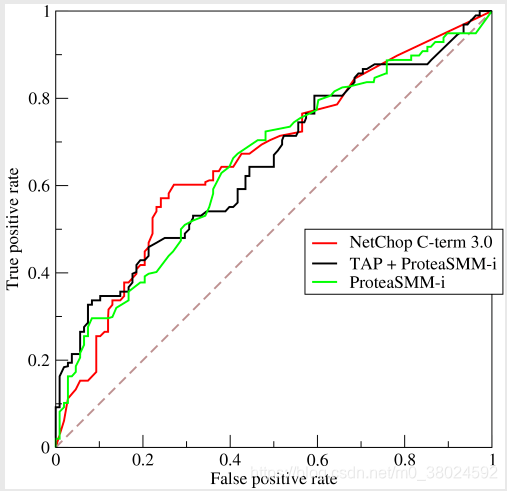

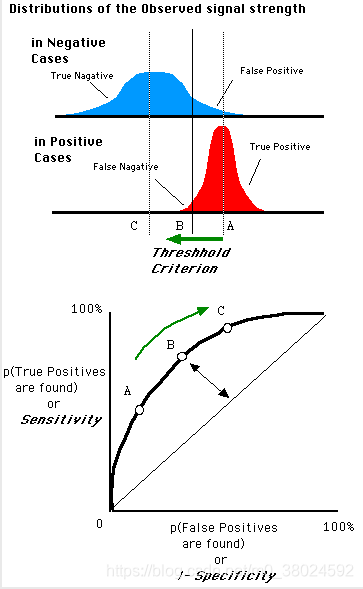

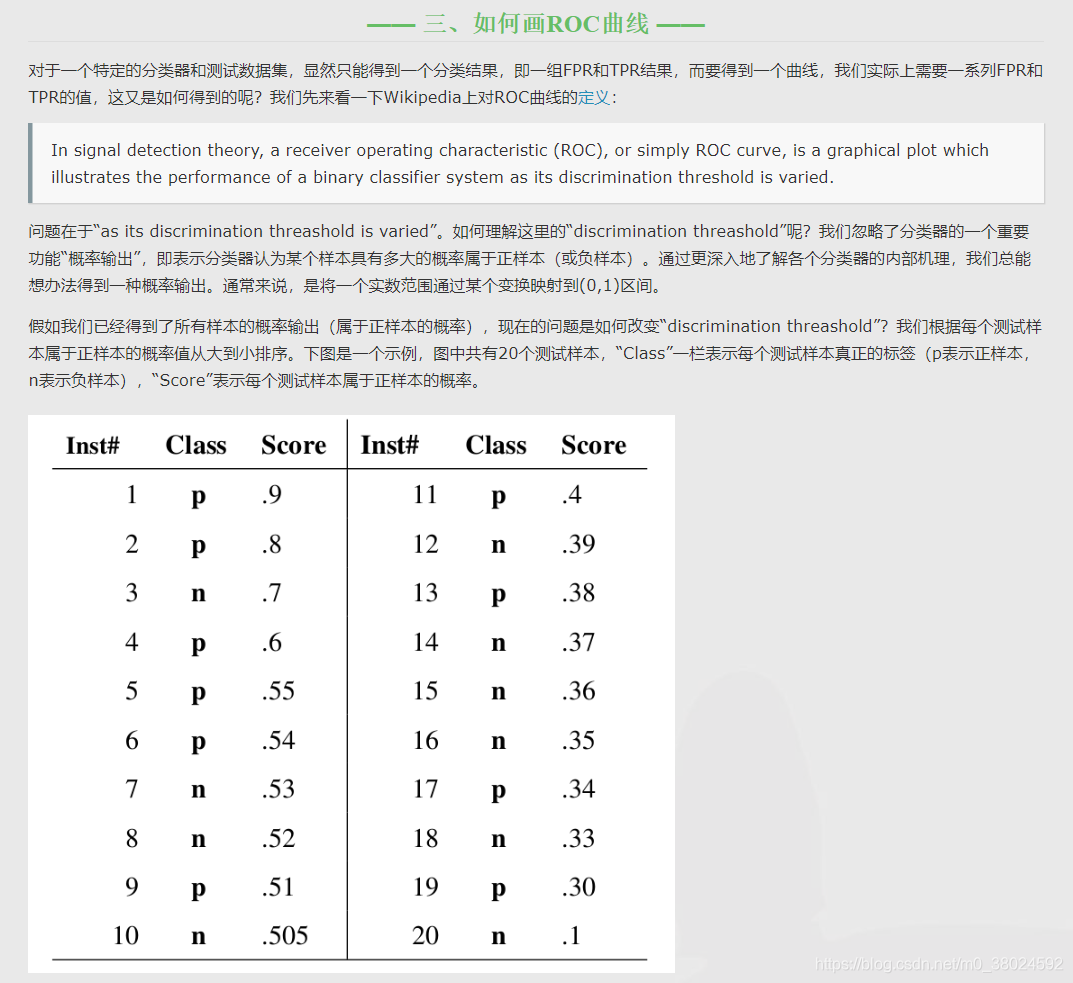

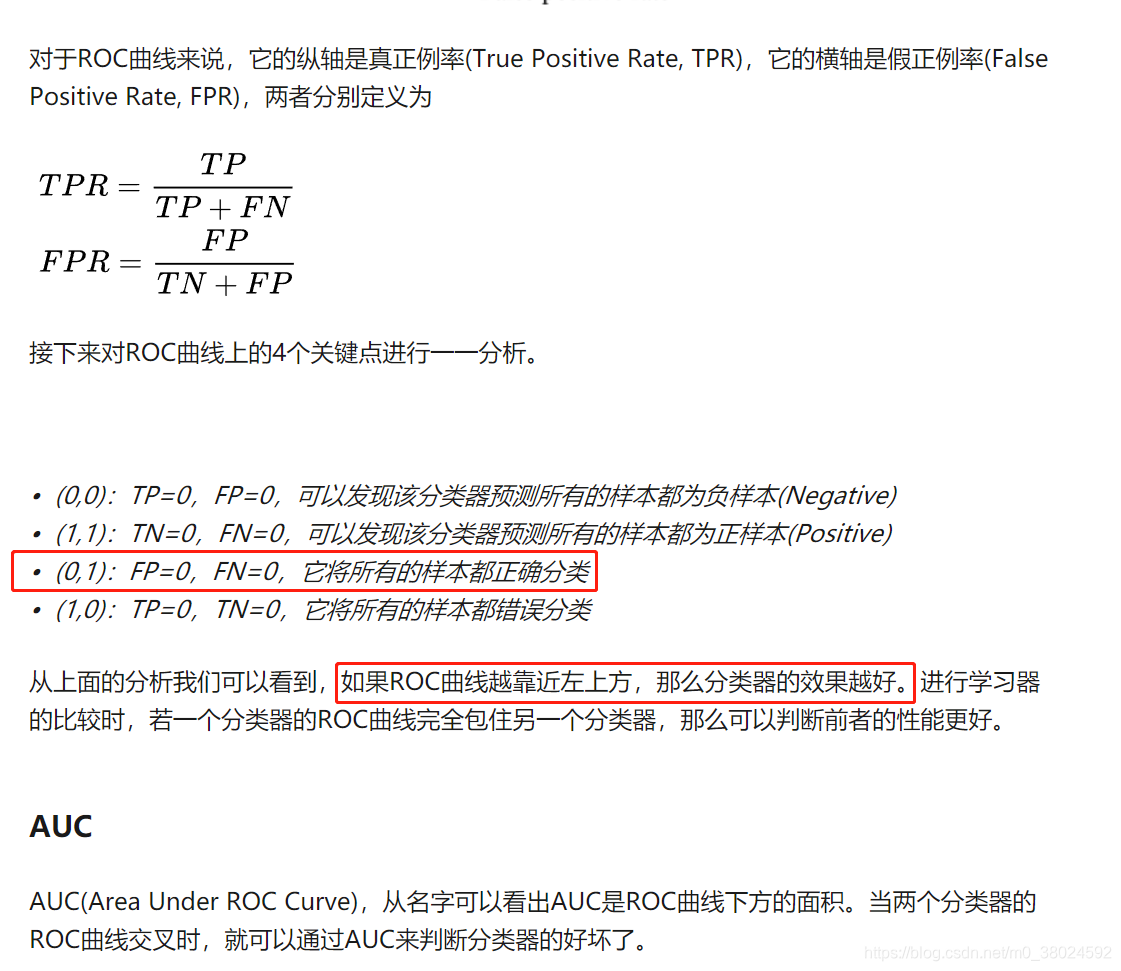

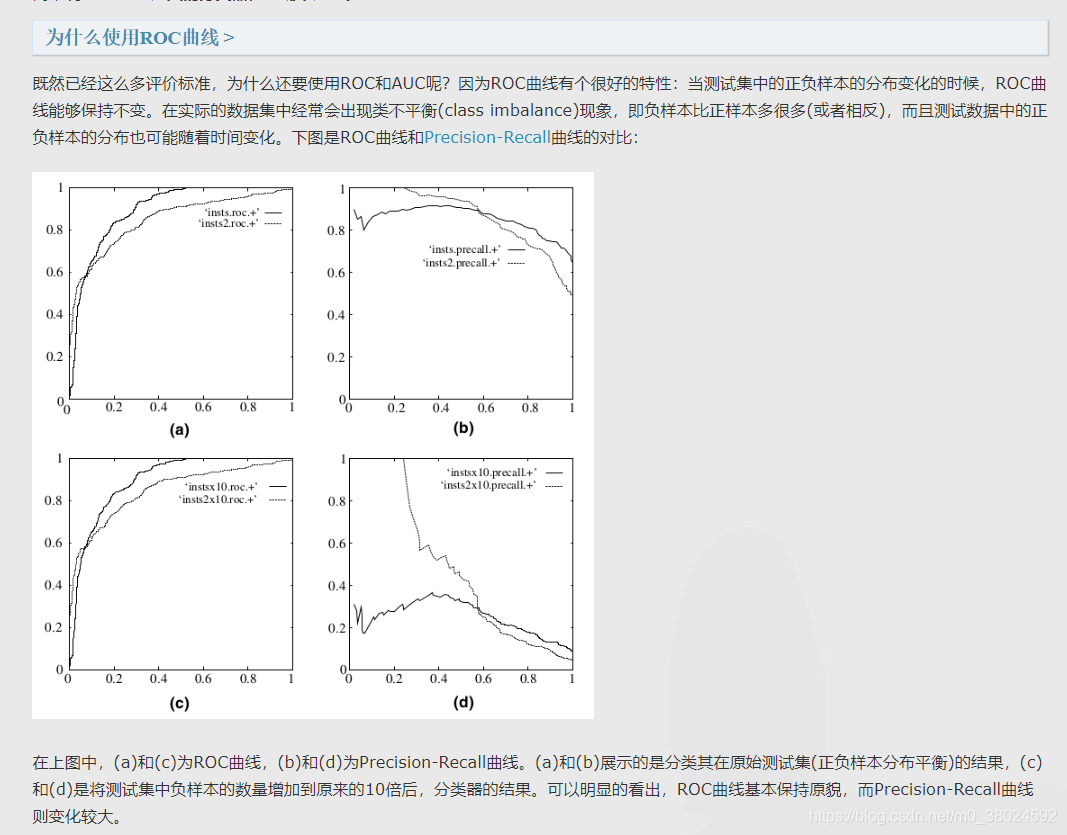

对于分类器或者说分类算法,评价指标主要有precision,recall,F1 score等,以及这里要讨论的ROC和AUC。下图是一个ROC曲线的示例:

- 横坐标:1-Specificity,伪正类率(False positive rate, FPR),预测为正但实际为负的样本占所有负例样本 的比例;

- 纵坐标:Sensitivity,真正类率(True positive rate, TPR),预测为正且实际为正的样本占所有正例样本 的比例。

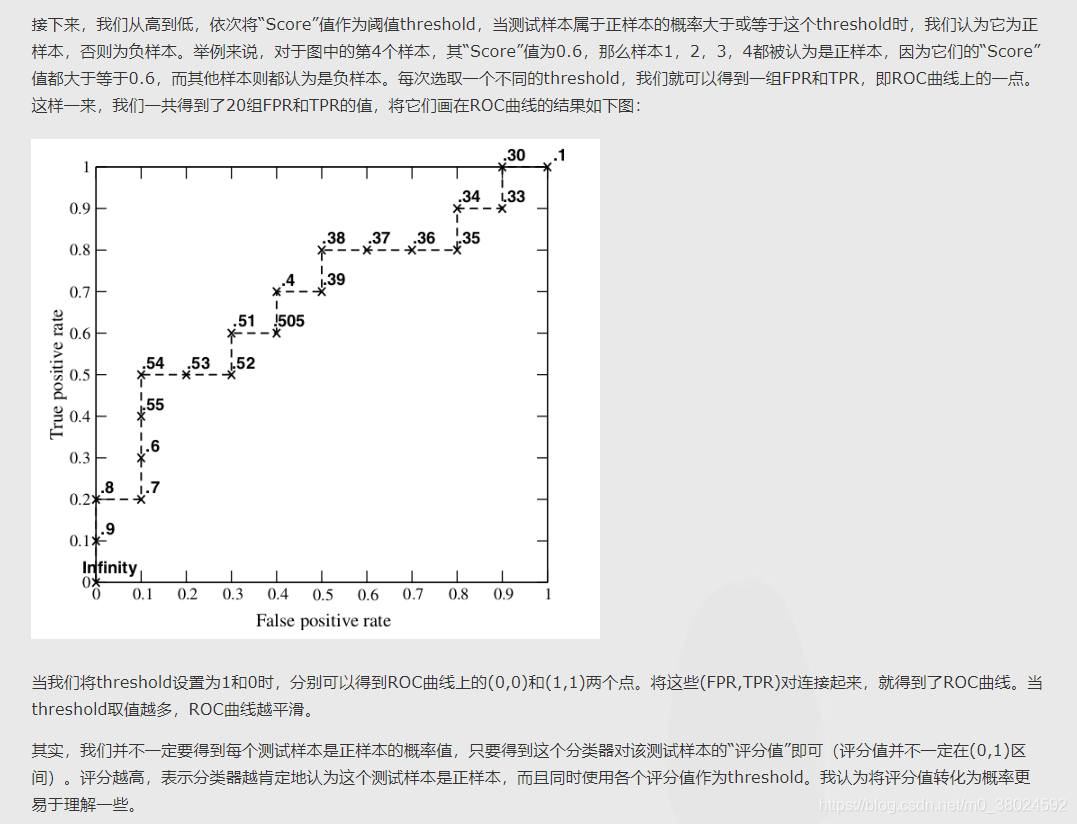

在一个二分类模型中,假设采用逻辑回归分类器,其给出针对每个实例为正类的概率,那么通过设定一个阈值如0.6,概率大于等于0.6的为正类,小于0.6的为负类。对应的就可以算出一组(FPR,TPR),在平面中得到对应坐标点。随着阈值的逐渐减小,越来越多的实例被划分为正类,但是这些正类中同样也掺杂着真正的负实例,即TPR和FPR会同时增大。阈值最大时,对应坐标点为(0,0),阈值最小时,对应坐标点(1,1)。

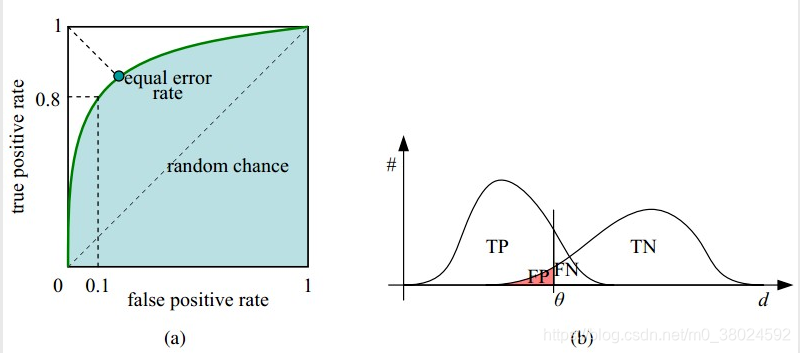

如下面这幅图,(a)图中实线为ROC曲线,线上每个点对应一个阈值。

(a) 理想情况下,TPR应该接近1,FPR应该接近0。ROC曲线上的每一个点对应于一个threshold,对于一个分类器,每个threshold下会有一个TPR和FPR。比如Threshold最大时,TP=FP=0,对应于原点;Threshold最小时,TN=FN=0,对应于右上角的点(1,1)。

(b) P和N得分不作为特征间距离d的一个函数,随着阈值theta增加,TP和FP都增加。

- 横轴FPR:1-TNR,1-Specificity,FPR越大,预测正类中实际负类越多。

- 纵轴TPR:Sensitivity(正类覆盖率),TPR越大,预测正类中实际正类越多。

- 理想目标:TPR=1,FPR=0,即图中(0,1)点,故ROC曲线越靠拢(0,1)点,越偏离45度对角线越好,Sensitivity、Specificity越大效果越好。

随着阈值threshold调整,ROC坐标系里的点如何移动可以参考:

Reference

https://zhwhong.cn/2017/04/14/ROC-AUC-Precision-Recall-analysis/#

本文探讨了机器学习中分类器性能评估的重要工具——混淆矩阵与ROC曲线。混淆矩阵能清晰揭示分类错误的细节,而ROC曲线及其AUC值则用于衡量二分类器的优劣,通过分析TPR与FPR变化,深入了解不同阈值下分类器的表现。

本文探讨了机器学习中分类器性能评估的重要工具——混淆矩阵与ROC曲线。混淆矩阵能清晰揭示分类错误的细节,而ROC曲线及其AUC值则用于衡量二分类器的优劣,通过分析TPR与FPR变化,深入了解不同阈值下分类器的表现。

2079

2079

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?