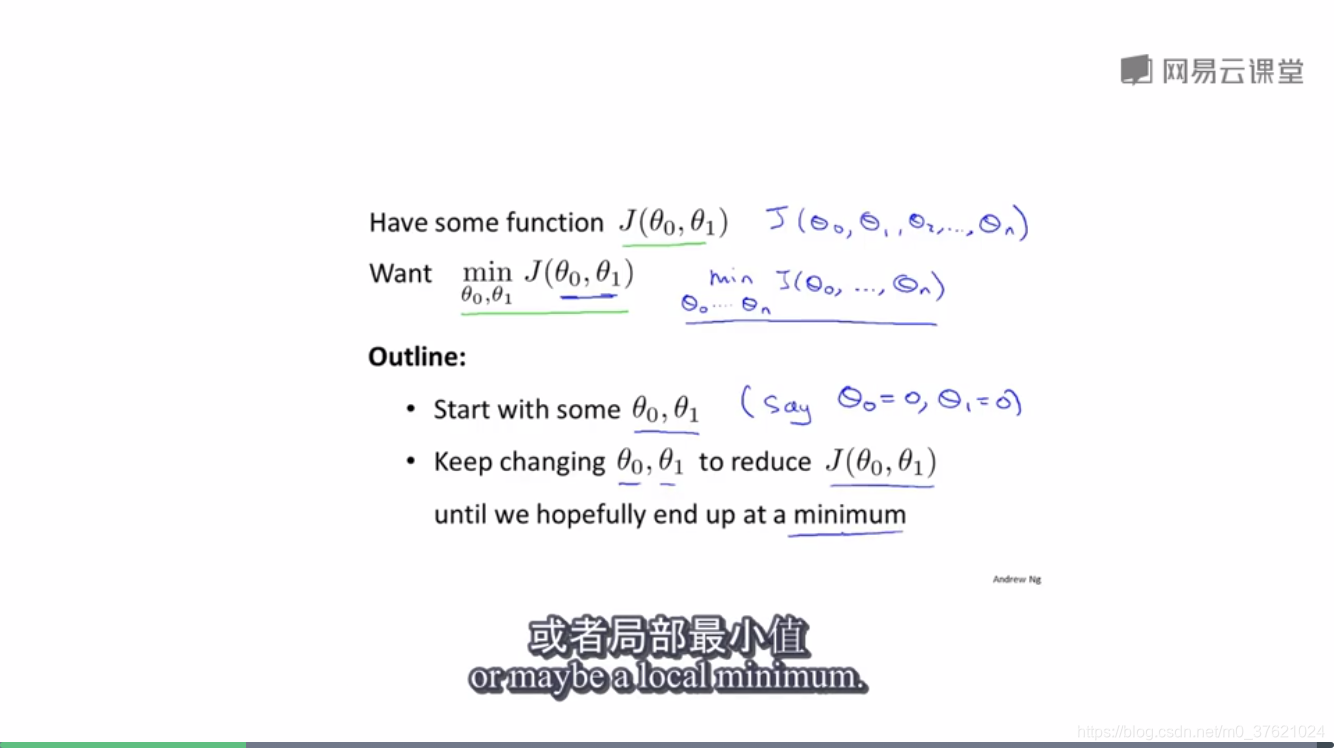

#梯度下降

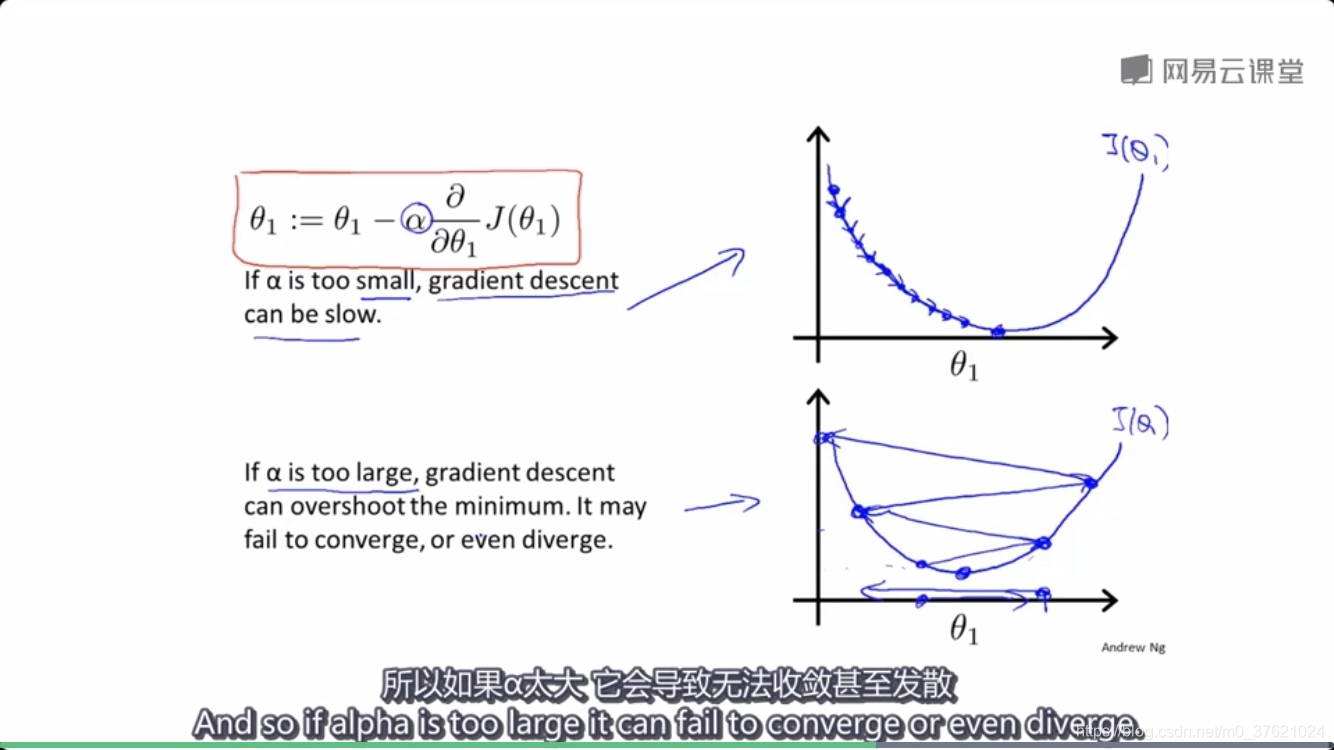

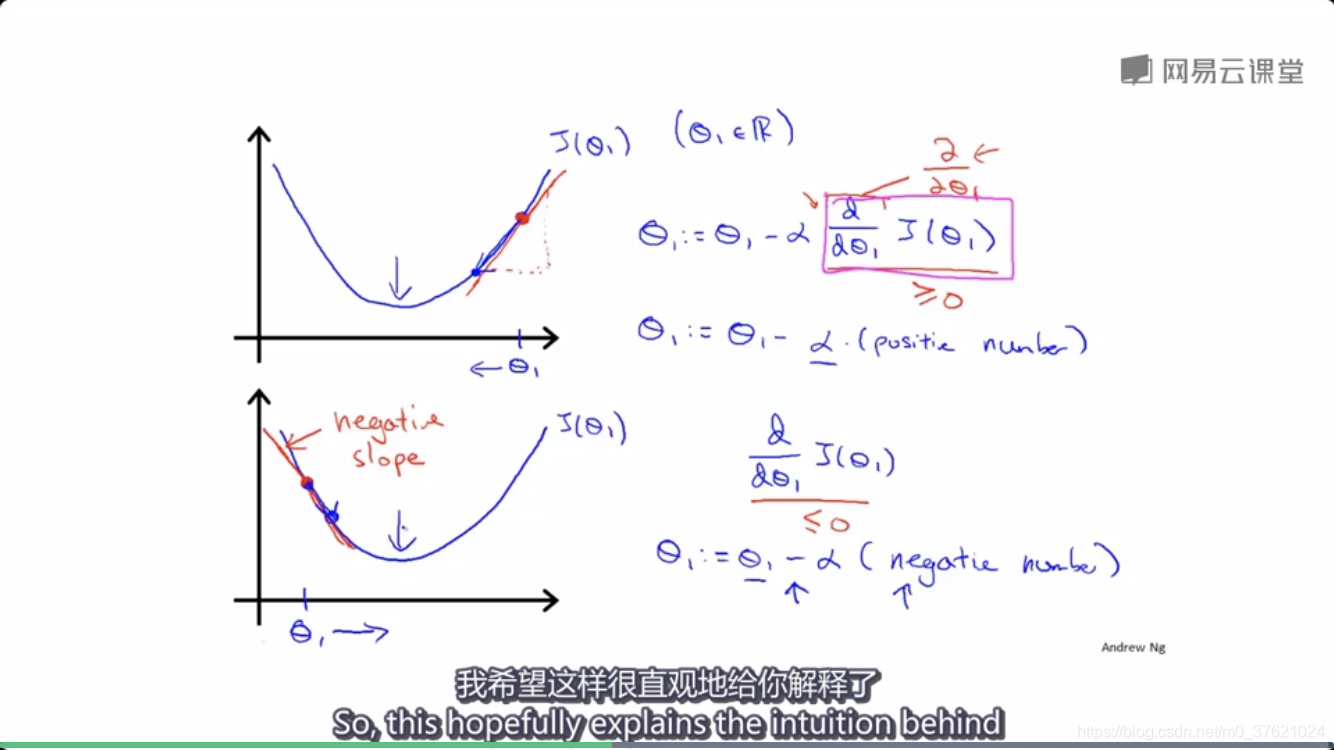

- learning rate(学习速率):控制以多大幅度更新参数。

- 太小移动慢;

- 太大可能越过最小值甚至无法收敛。

- partial derivative terms(偏导项)

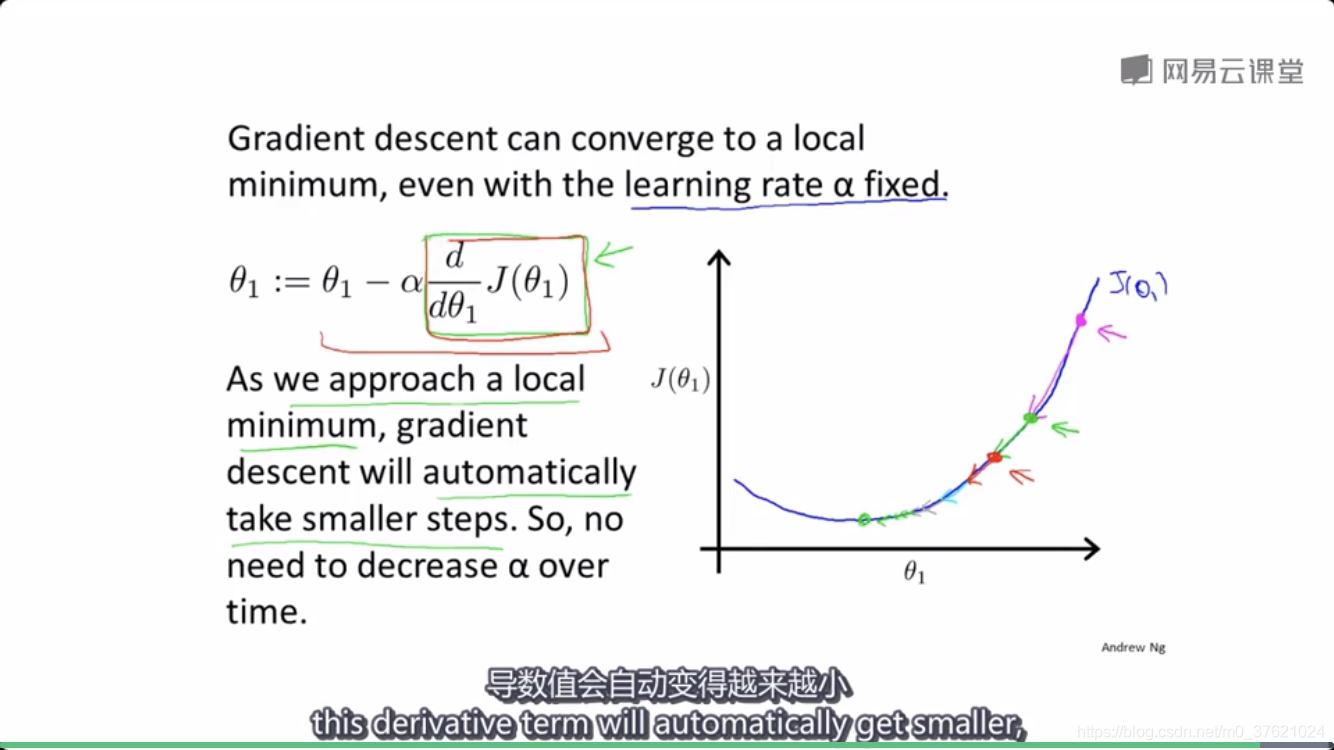

#如果参数已经在局部最小值,则参数不再改变。

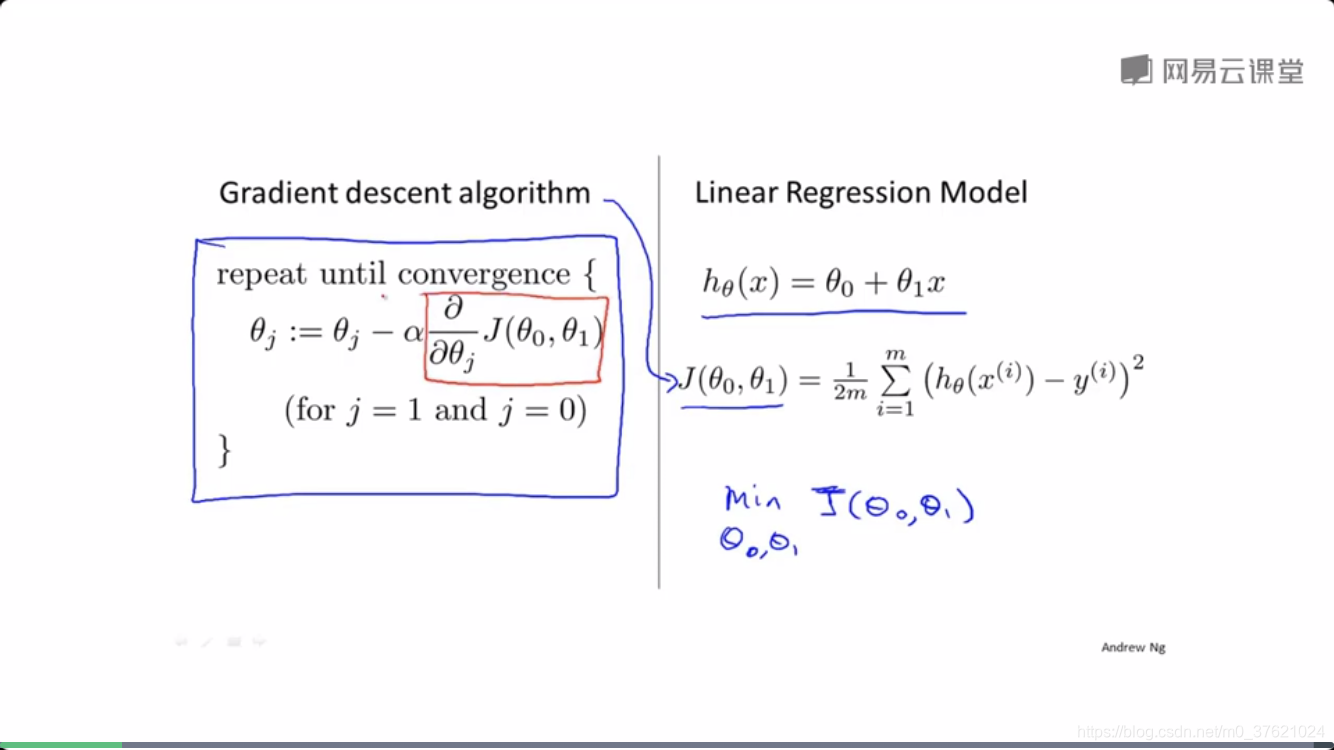

#线性回归中的梯度下降

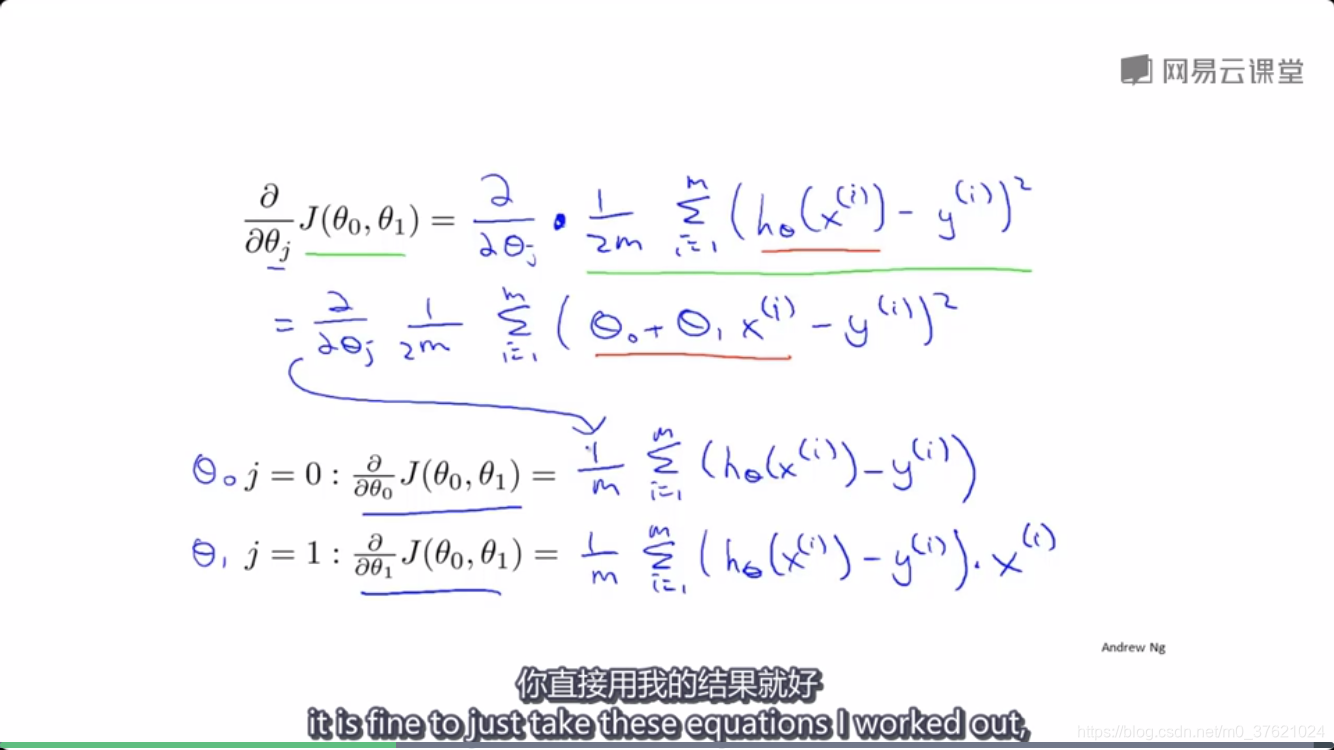

为了应用梯度下降算法,关键步骤是这个导数项。

推导导数项:

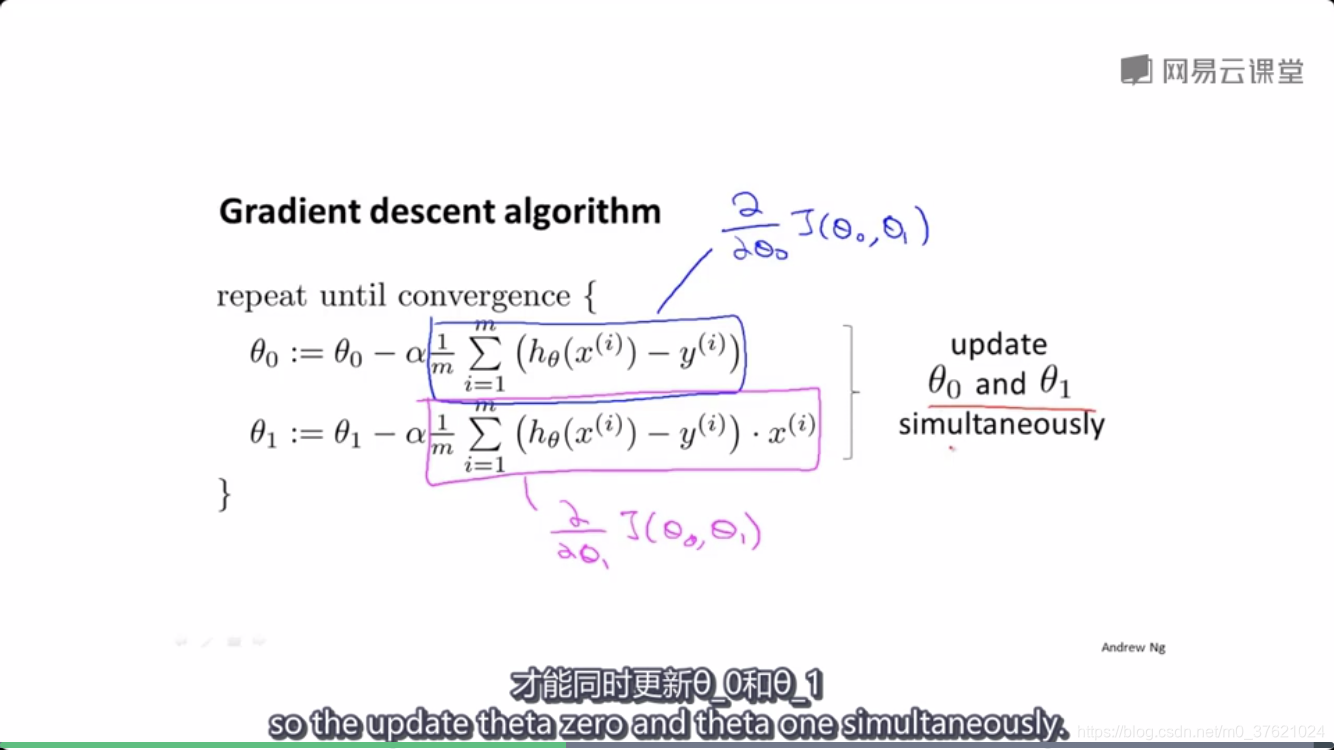

注意要同时更新两个参数。

梯度下降算法的问题之一是它容易陷入局部最优。

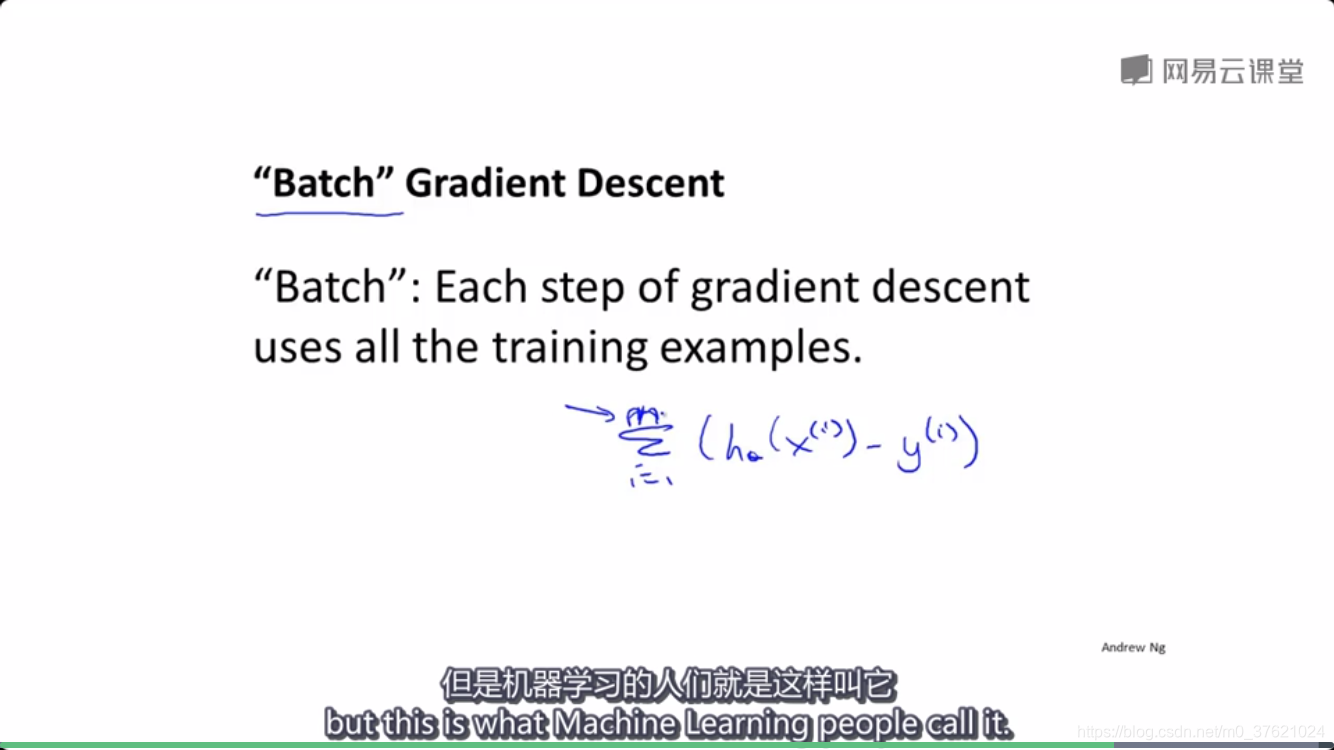

#Batch梯度下降

每一步梯度下降都遍历了整个训练集的样本。

PS.内容大部分为吴恩达老师机器学习的笔记【https://study.163.com/course/introduction/1004570029.htm】

7683

7683

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?