1 过拟合

2 正则化

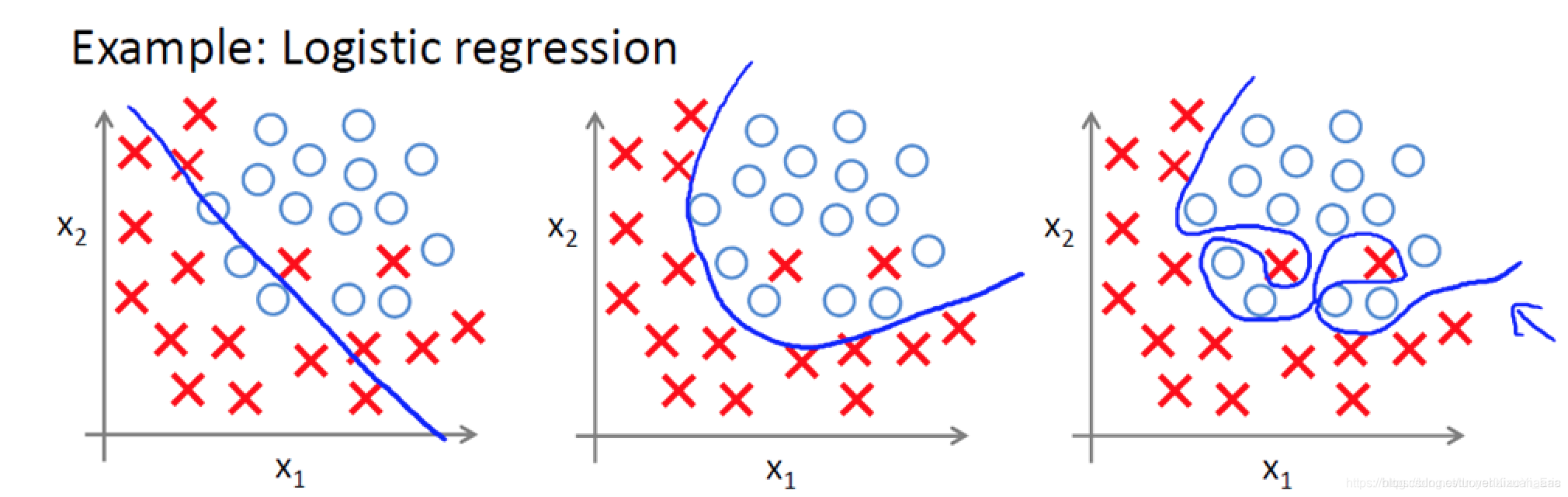

过拟合现象很普遍,根本原因还是数据量不足以支撑复杂度高的模型,因此最直接的解决过拟合问题的办法是增加训练数据量。另一种直接的方法是降低模型复杂度。

如果我们能通过正则化,在固定训练集大小和固定模型复杂度的情况下解决过拟合问题。

2.1 L2正则化

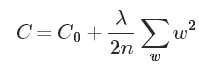

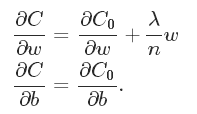

L2正则化也叫做权值衰减,就是在原本的损失函数基础上加上一个惩罚项:

C0可以是任意的普通损失函数,w是模型里面的所有权值,而lambda是正则化参数,它必须大于0(当然也可以认为等于0就是纯粹经验风险损失的情况)。

正则化损失函数(通常也叫结构化损失)综合考虑了模型效果和模型复杂度,这两者的权衡由正则化参数lambda来衡量。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

678

678

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?