ollama

Ollama 是一款开源跨平台的大语言模型(LLM)运行工具,旨在简化本地部署和管理 AI 模型的流程。

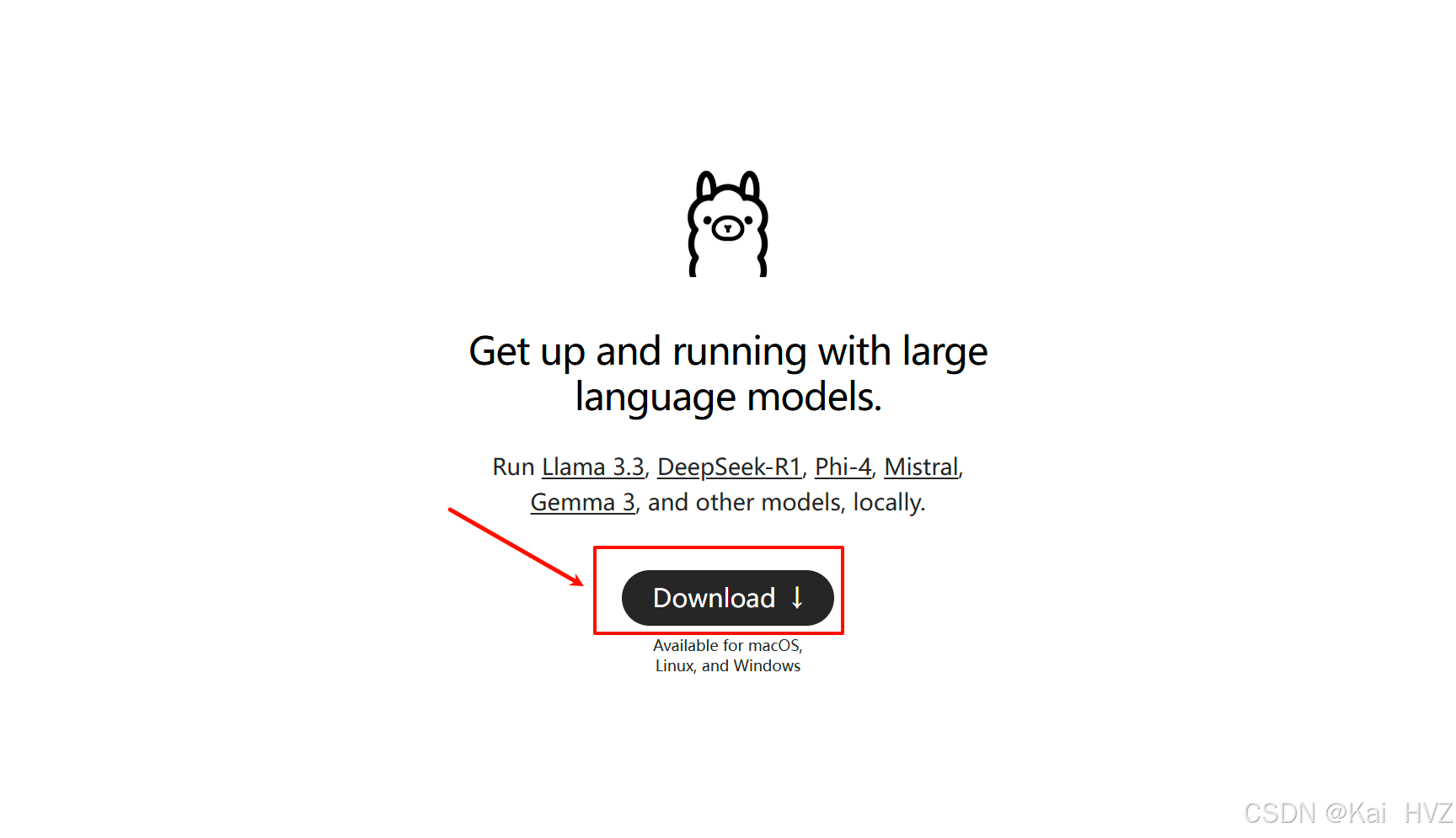

下载ollama

进入官网下载https://ollama.com/

选择需要的系统下载

下载完成后直接进行安装

下载大模型

选择想要部署的模型,这里部署deepseek-r1

选择想要部署的大模型的大小,这里我选择1.5b,因为我的电脑配置没有很高,如果电脑配置很高可以自行选择。

安装模型:复制上方图片中的内容,win+r输入cmd打开控制面板。

输入ollama serve打开ollama,正常下载完成后ollama会自动开启。直接跳过这一步也可以。 然后新添加一个控制面板,输入

然后新添加一个控制面板,输入

进行下载安装。安装完成后再输入一遍上方图片的内容就可以使用。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?