文章目录

0 前言

🔥这两年开始毕业设计和毕业答辩的要求和难度不断提升,传统的毕设题目缺少创新和亮点,往往达不到毕业答辩的要求,这两年不断有学弟学妹告诉学长自己做的项目系统达不到老师的要求。并且很难找到完整的毕设参考学习资料。

为了大家能够顺利以及最少的精力通过毕设,学长分享优质毕业设计项目提供大家参考学习,今天要分享的是

🚩 毕业设计 yolov11骨折检测医疗辅助系统(源码+论文)

🥇学长这里给一个题目综合评分(每项满分5分)

难度系数:3分

工作量:4分

创新点:5分

🧿 项目分享:见文末!

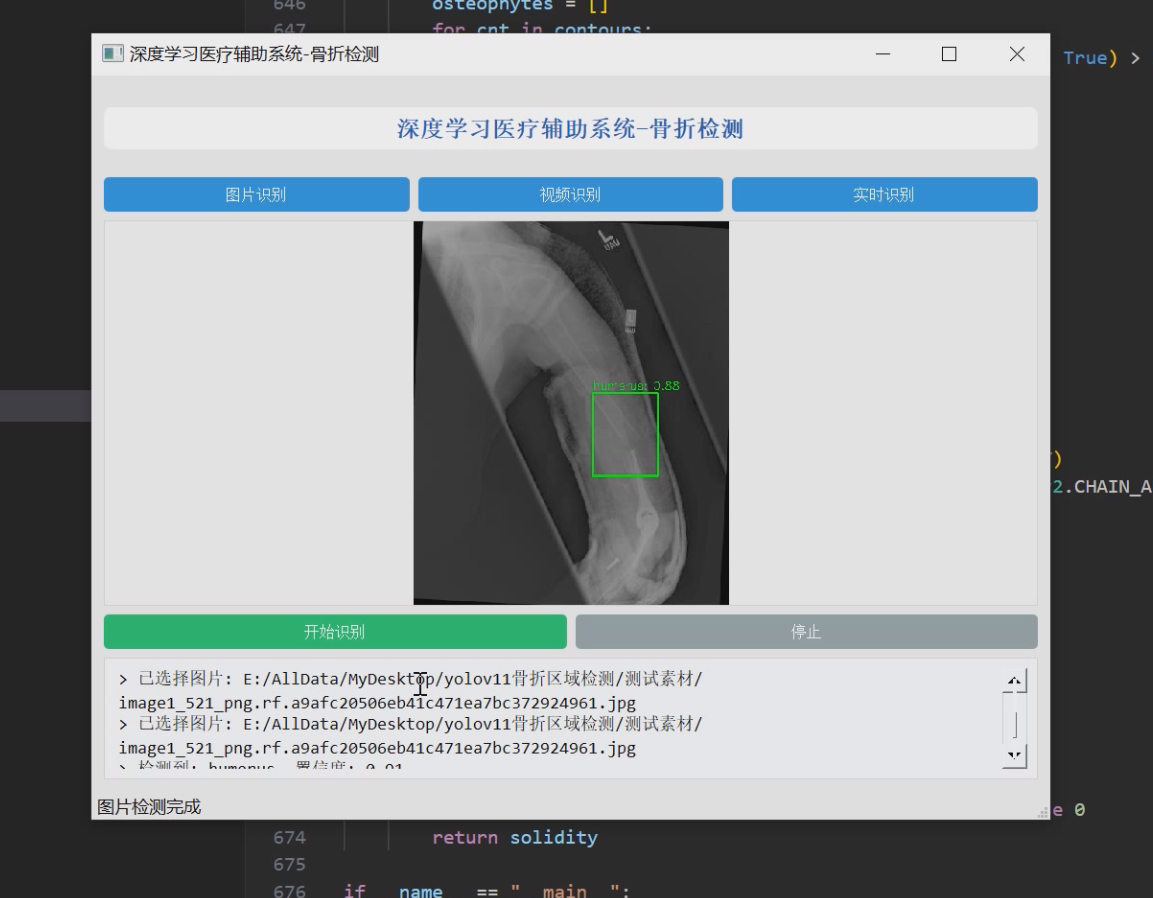

1 项目运行效果

2 课题背景

2.1 研究背景

骨折是临床常见的骨骼系统损伤,准确的早期诊断对治疗方案制定和预后评估至关重要。传统的骨折诊断主要依靠医生的影像学阅片经验,存在以下突出问题:(1)诊断结果受医生经验影响大,存在主观差异性;(2)高负荷工作环境下容易产生视觉疲劳,导致漏诊误诊;(3)复杂骨折病例需要多学科会诊,诊断周期长。据统计,在急诊环境下,骨折的误诊率可达3%-5%,而在基层医疗机构这一比例可能更高。

随着医学影像技术的普及,X光、CT等检查设备已广泛配置于各级医疗机构,产生了海量的医学影像数据。这为计算机辅助诊断(CAD)系统的应用提供了基础条件。近年来,深度学习技术在图像识别领域取得突破性进展,为开发智能骨折检测系统提供了新的技术路径。

2.2 国内外研究现状

计算机辅助骨折检测研究经历了从传统图像处理到深度学习的演进过程。早期研究主要基于形态学处理和特征工程方法,如:

- 边缘检测算法识别骨折线

- 纹理分析判断骨骼异常

- 形状匹配定位骨折部位

这些方法在特定条件下能取得一定效果,但泛化能力有限,难以应对临床复杂的实际情况。

随着深度学习技术的发展,基于卷积神经网络(CNN)的方法逐渐成为主流。代表性工作包括:

- 2018年,Lindsey等人提出FractureNet,在股骨颈骨折检测中达到92%准确率

- 2020年,Zhang等人采用改进的ResNet50网络实现多部位骨折分类

- 2021年,Wang团队将注意力机制引入骨折检测任务,提升了小骨折的识别率

特别值得注意的是,目标检测算法如Faster R-CNN、YOLO系列在骨折定位任务中展现出优势。YOLOv11作为最新的实时检测框架,在保持高速度的同时进一步提升了检测精度,但目前在医疗领域的应用研究仍较少见。

2.3 研究意义

本研究开发的基于YOLOv11的骨折检测系统具有以下重要意义:

-

临床价值:

- 为医生提供客观的辅助诊断意见,减少主观差异

- 提高诊断效率,特别是在急诊和基层医疗场景

- 通过可视化界面直观展示检测结果,便于医患沟通

-

技术创新:

- 首次将YOLOv11应用于骨折检测任务

- 开发了支持多模式(图片/视频/实时)的检测系统

- 针对医疗场景优化了算法参数和界面设计

-

社会效益:

- 有助于提升基层医疗机构的诊断水平

- 为远程医疗和分级诊疗提供技术支持

- 促进人工智能技术在医疗领域的落地应用

3 设计框架(骨折检测系统设计框架说明)

3.1. 系统架构图

3.2. 技术选型

3.2.1 核心组件

| 技术组件 | 用途 | 版本 |

|---|---|---|

| YOLOv11 | 骨折区域检测 | v11.0 |

| PyQt5 | 用户界面开发 | 5.15.7 |

| OpenCV | 图像处理 | 4.5.5 |

| NumPy | 数值计算 | 1.21.5 |

3.2.2 辅助工具

| 工具 | 用途 |

|---|---|

| LabelImg | 数据标注 |

| Roboflow | 数据增强 |

| TensorBoard | 训练监控 |

3.3. 核心模块设计

3.3.1 YOLO模型训练模块

训练流程图

关键伪代码

# 数据准备

dataset = load_dataset('fracture_data')

augmented_data = apply_augmentations(dataset)

# 模型配置

model = YOLO('yolov11.yaml')

model.load_pretrained('yolov11.pt')

# 训练过程

for epoch in range(epochs):

for batch in dataloader:

images, targets = batch

predictions = model(images)

loss = compute_loss(predictions, targets)

optimizer.step(loss)

# 验证集评估

val_metrics = evaluate(model, val_loader)

log_metrics(epoch, val_metrics)

3.3.2 用户交互系统

3.UI组件结构

交互逻辑伪代码

class FractureDetectionApp:

def init_ui(self):

# 创建主窗口

self.window = QMainWindow()

# 添加功能按钮

self.image_btn = QButton("图片识别")

self.video_btn = QButton("视频识别")

# 设置布局

layout = QVBoxLayout()

layout.addWidget(self.image_btn)

layout.addWidget(self.video_btn)

# 连接信号槽

self.image_btn.clicked.connect(self.select_image)

def select_image(self):

# 打开文件对话框

file = QFileDialog.getOpenFileName()

if file:

self.process_image(file)

3.3.3 图像处理流程

处理流程图

核心处理伪代码

def process_frame(frame):

# 图像预处理

img = cv2.cvtColor(frame, cv2.COLOR_BGR2RGB)

img = normalize(img)

# 模型推理

results = model.predict(img)

# NMS处理

boxes = process_boxes(results)

scores = process_scores(results)

keep = nms(boxes, scores)

# 结果绘制

for idx in keep:

box = boxes[idx]

cv2.rectangle(img, box, color=(0,255,0))

return img

3.4. 关键技术实现

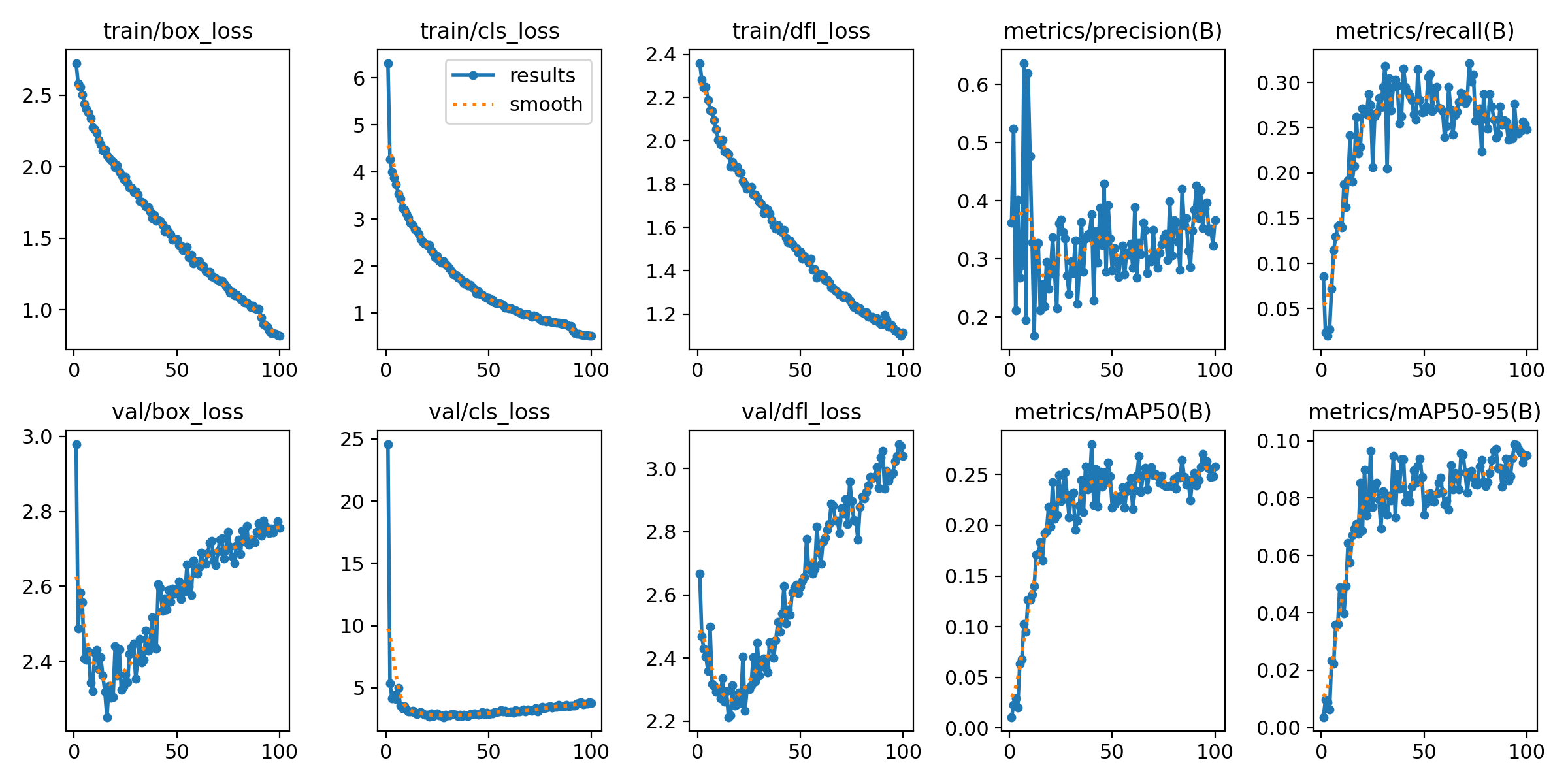

3.4.1 模型训练优化

-

数据增强策略:

- 随机旋转(-15°~15°)

- 亮度调整(±20%)

- 对比度调整(±30%)

-

训练参数:

# yolov11_fracture.yaml

lr0: 0.01

lrf: 0.1

momentum: 0.937

weight_decay: 0.0005

3.4.2 交互系统设计

- 界面布局方案:

# 主界面布局

main_layout = QVBoxLayout()

main_layout.addWidget(title_label) # 标题

main_layout.addLayout(mode_layout) # 模式选择

main_layout.addWidget(result_label) # 结果显示

main_layout.addLayout(control_layout) # 控制按钮

main_layout.addWidget(log_text) # 日志区域

- 多线程处理:

class DetectionThread(QThread):

def run(self):

while running:

frame = camera.get_frame()

processed = process_frame(frame)

emit show_signal(processed)

3.5. 系统集成方案

3.5.1 模块集成关系

3.5.2 数据流设计

- 图片检测流程:

用户选择图片 -> 系统加载图片 -> 预处理 -> 模型推理 ->

NMS处理 -> 绘制结果 -> 显示输出 -> 记录日志

- 实时检测流程:

摄像头启动 -> 逐帧捕获 -> 预处理 -> 模型推理 ->

实时NMS处理 -> 动态显示 -> 性能统计

3.6. 创新点说明

-

多模式检测一体化:

- 集成图片/视频/实时三种检测模式

- 统一的处理流程和显示接口

-

优化的NMS算法:

def enhanced_nms(boxes, scores):

# 添加类别权重

weighted_scores = scores * class_weights

# 动态IOU阈值

iou_thresh = base_thresh * (1 + variance)

# 执行标准NMS

return nms(boxes, weighted_scores, iou_thresh)

4 最后

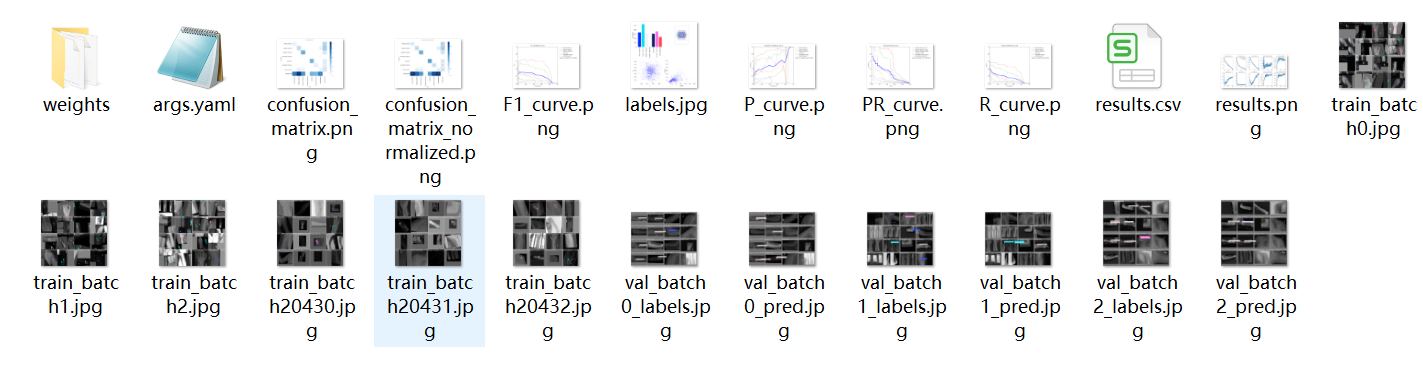

项目包含内容

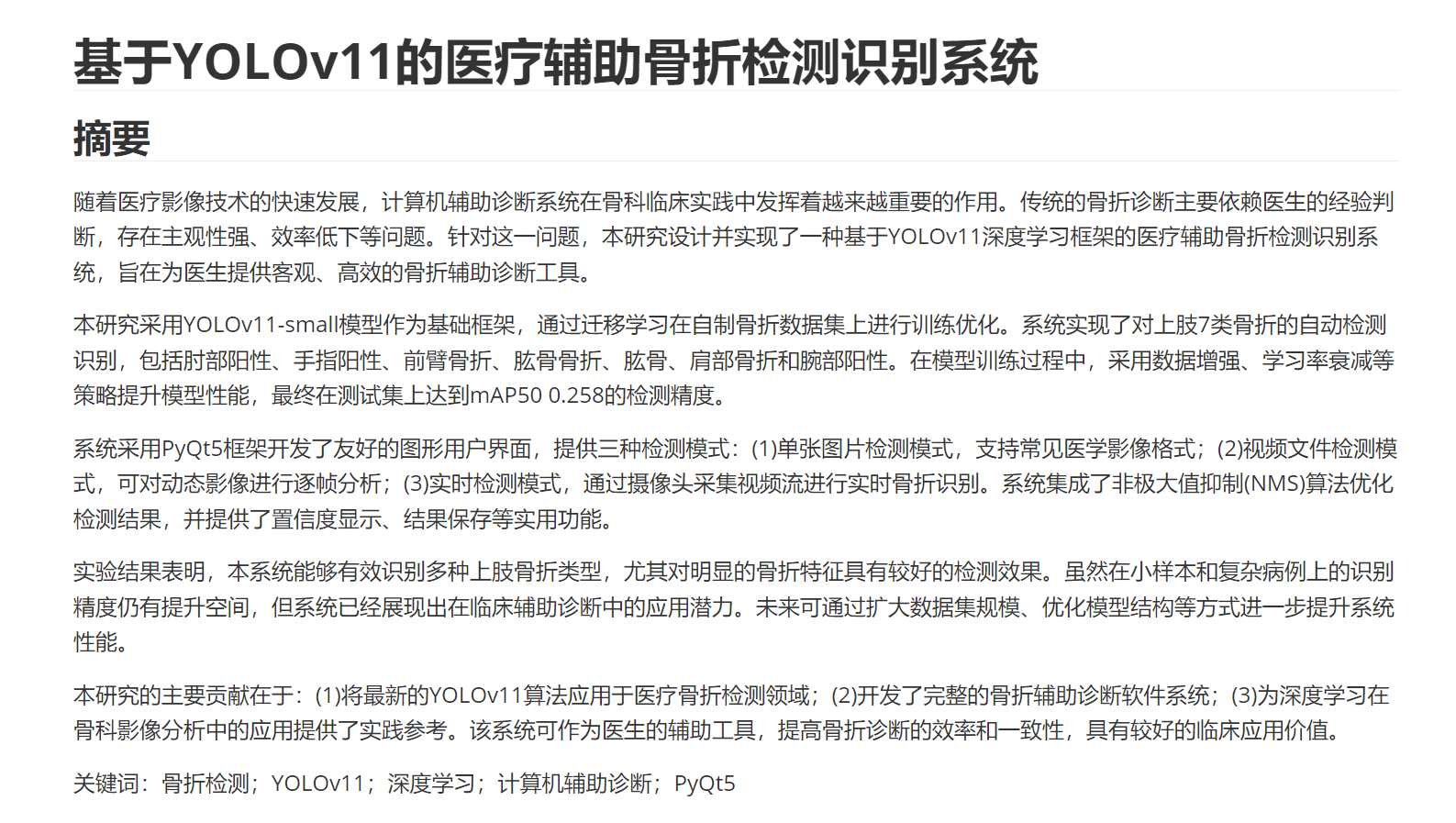

论文摘要

🧿 项目分享:大家可自取用于参考学习,获取方式见文末!

4722

4722

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?