决策树

【关键词】树,熵,信息增益

决策树的优缺点

优点:计算复杂度不高,输出结果易于理解,对中间值的缺失不敏感,可以处理不相关特征数据。既能用于分类,也能用于回归

缺点:可能会产生过度匹配问题。

一、决策树的原理

我们经常使用决策树处理分类问题。近来的调查表明决策树也是最经常使用的数据挖掘算法。它之所以如此流行,一个很重要的原因就是使用者基本上不用了解机器学习算法,也不用深究它是如何工作的。

决策树分类的思想类似于找对象。现想象一个女孩的母亲要给这个女孩介绍男朋友,于是有了下面的对话:

女儿:多大年纪了?

母亲:26。

女儿:长的帅不帅?

母亲:挺帅的。

女儿:收入高不?

母亲:不算很高,中等情况。

女儿:是公务员不?

母亲:是,在税务局上班呢。

女儿:那好,我去见见。

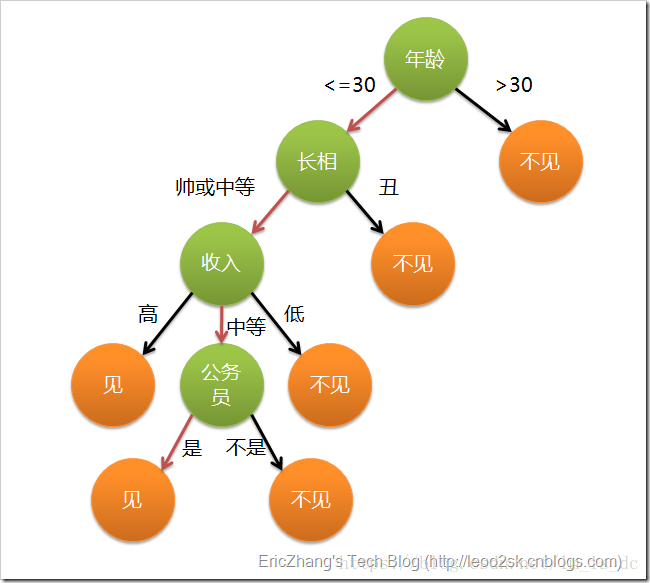

这个女孩的决策过程就是典型的分类树决策。相当于通过年龄、长相、收入和是否公务员对将男人分为两个类别:见和不见。假设这个女孩对男人的要求是:30岁以下、长相中等以上并且是高收入者或中等以上收入的公务员,那么这个可以用下图表示女孩的决策逻辑:

上图完整表达了这个女孩决定是否见

本文介绍了决策树的原理、构造方法,特别是ID3算法,强调了决策树在分类问题中的应用。通过实例展示了如何使用决策树处理鸢尾花数据集,并对比了KNN和逻辑斯蒂回归算法。此外,文章还探讨了决策树的过拟合问题,并引入了随机森林的概念,解释了随机森林是如何通过构建多棵树来改善预测准确性的。

本文介绍了决策树的原理、构造方法,特别是ID3算法,强调了决策树在分类问题中的应用。通过实例展示了如何使用决策树处理鸢尾花数据集,并对比了KNN和逻辑斯蒂回归算法。此外,文章还探讨了决策树的过拟合问题,并引入了随机森林的概念,解释了随机森林是如何通过构建多棵树来改善预测准确性的。

订阅专栏 解锁全文

订阅专栏 解锁全文

921

921