目录

🎬 攻城狮7号:个人主页

🔥 个人专栏:《AI前沿技术要闻》

⛺️ 君子慎独!

🌈 大家好,欢迎来访我的博客!

⛳️ 此篇文章主要介绍 昆仑万维开源UniPic 2.0

📚 本期文章收录在《AI前沿技术要闻》,大家有兴趣可以自行查看!

⛺️ 欢迎各位 ✔️ 点赞 👍 收藏 ⭐留言 📝!

前言

对于许多设计师、内容创作者和营销人员来说,AI绘画工具的出现,更像是一份“喜忧参半”的礼物。

我们惊喜于AI能在一分钟内“画”出过去需要一天才能完成的草图,但很快,我们就陷入了一个新的困境——创作流程被AI工具切割得七零八碎。

想象一下这个场景:你先打开A工具,上传一张参考图,让AI帮你理解图片里的元素和风格;然后,你把理解后的需求,输入到B工具里,让它帮你生成一张全新的图片;最后,你发现生成图有几个细节不满意,又不得不把它导入到C工具(比如Photoshop)里,进行手动的编辑和修改。

每一次导入导出,每一次工具切换,都像是一次创意的“中断”。灵感在这些琐碎的操作中被消磨,风格在不同工具的“理解偏差”中逐渐丢失。我们想要的,不是一堆各自为政的“单项冠军”,而是一个能从头跟到尾的“全能搭档”。

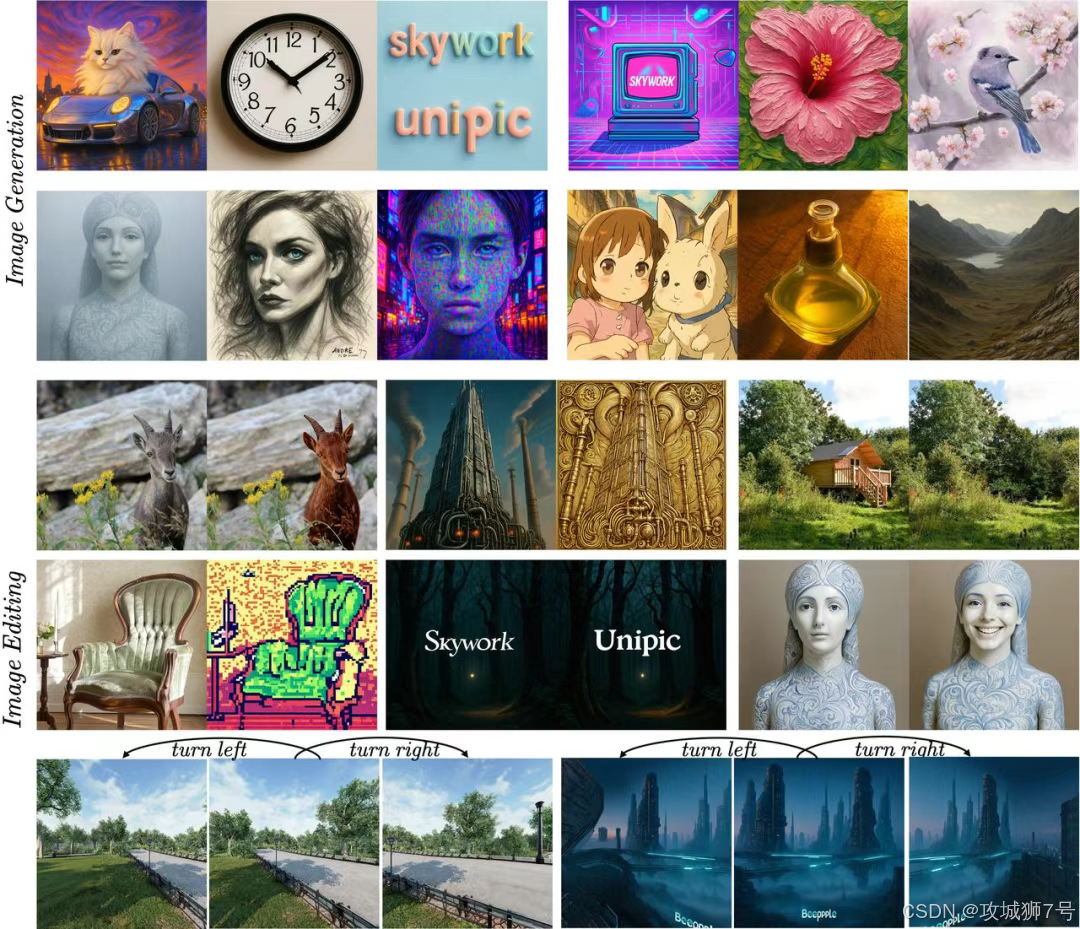

现在,昆仑万维带着他们开源的「Skywork UniPic 2.0」,似乎要为这场“创作流程的反复横跳”画上句号。它不是又一个单纯的生图或P图工具,而是一个真正意义上的“统一多模态模型”,一个将理解、生成、编辑三大核心能力无缝整合的“AI作图全家桶”。

它的核心承诺简单而强大:让你的创意,从此可以“一镜到底”。

一、从“三件套”到“一体机”:创作本该如此丝滑

UniPic 2.0最直观的改变,就是将过去分散的工作流,收束到了一个统一的对话框内。

你不再需要扮演一个“工具搬运工”的角色。整个创作过程,变成了一场与AI的流畅对话:

(1)“你看,这是什么?” (理解能力)

你可以直接扔给它一张照片,问:“这张图里的鸟是什么品种?”或者“帮我分析一下这张海报的设计风格和主要元素”。它能像一个设计助理一样,精准地理解图像内容。

(2)“给我画一个……” (生成能力)

基于理解,或者直接根据你的文字描述,它可以生成细节丰富的图像。无论是“一只戴着飞行员墨镜的猫,坐在热气球里”,还是“赛博朋克风格的兰博基尼在海边漂移”,它都能轻松拿捏。

(3)“把它变成……” (编辑能力)

这是最关键的一步。当图片生成后,你不需要离开,直接在当前对话中下达修改指令:“很好,现在把这只猫换成兔子”,或者“把画面整体变成吉卜力动画风格”,甚至“把这张照片里的路人P掉”。

整个过程行云流水,就像是在和一位既懂你心意、又画工精湛的设计大师合作。原本需要数小时、在多个软件间切换的工作,现在几分钟内就能在一个地方搞定。这种效率的提升,为创意本身留出了宝贵的呼吸空间。

二、揭秘“全家桶”背后的三大“独门配方”

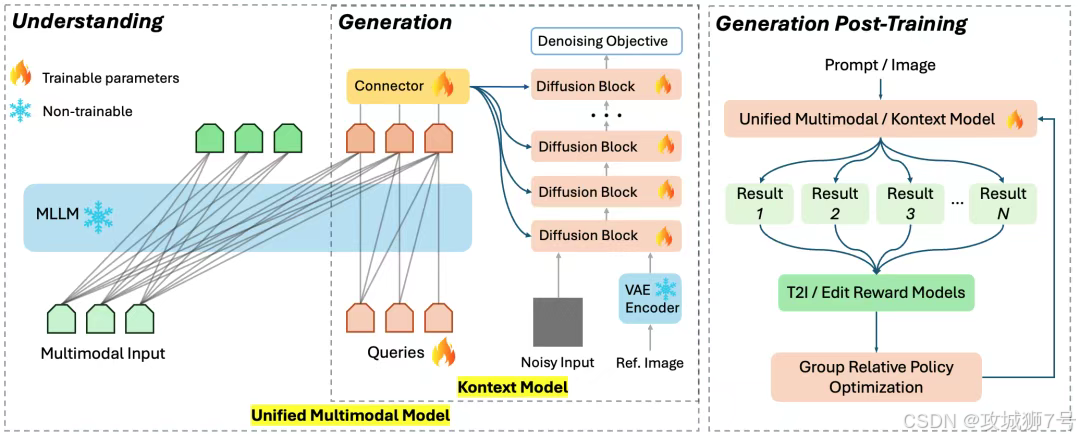

那么,昆仑万维是如何将这三个看似独立的复杂能力,优雅地融合在一起的呢?答案在于其巧妙的“三段式”架构设计。

2.1 轻量化的生图编辑模块

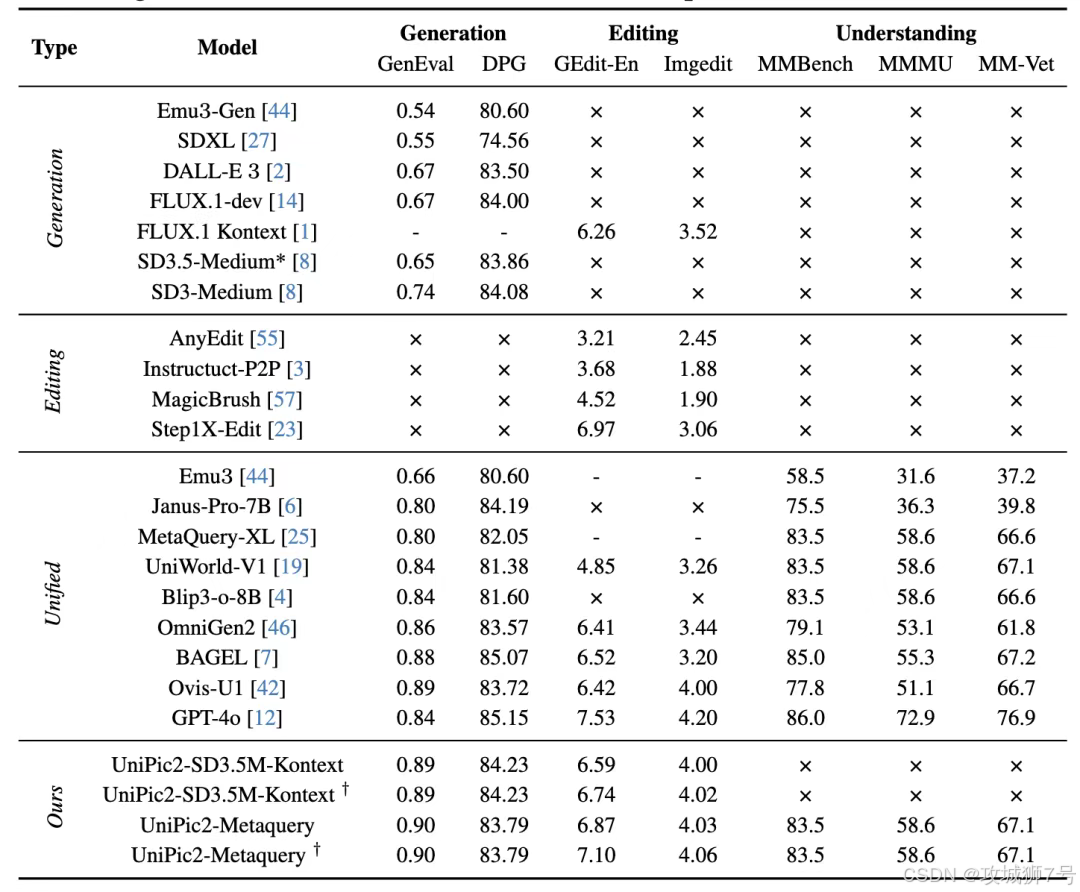

首先,UniPic 2.0选择了一个非常务实的“底座”——基于仅有2B参数的SD3.5-Medium架构进行改造。在动辄上百亿参数的模型竞赛中,这是一个非常“克制”的选择。

“小”的好处是显而易见的:高效、快速、部署门槛低。这意味着它不需要顶级服务器,甚至在消费级的显卡上也能流畅运行,让普通开发者和小型工作室也能轻松上手。

但“小”不等于“弱”。通过高质量的开源数据训练,这个轻量级的引擎被同时赋予了文生图(T2I)和图像编辑(I2I)的双重能力。评测结果甚至显示,这个2B参数的“小个子”,在生图和编辑效果上,超越了像FLUX-Kontext这样12B参数的“大块头”。这证明了其架构设计和训练方法的卓越。

2.2 连接多模态理解模型

有了强大的“引擎”,如何让它变得更“聪明”、更能“理解”世界呢?

UniPic 2.0的答案是“外接一个大脑”。它通过一个轻量的“连接器(Connector)”,将自己的生图编辑引擎,与昆仑万维旗下成熟的多模态模型Qwen2.5-VL(7B参数)连接了起来。

这个“连接器”就像一个高超的同声传译,让负责“理解”的Qwen大脑,能够和负责“动手画”的SD3.5M引擎无缝沟通。通过这种方式,UniPic 2.0兵不血刃地获得了强大的图像理解能力,而无需从零开始训练一个庞大而笨重的模型。这是一种极为聪明和高效的“能力整合”策略。

2.3 创新的多任务强化学习

这是UniPic 2.0最具技术含量的“杀手锏”。

在AI训练中,同时优化两个不同的任务(比如“生成”和“编辑”)常常会“打架”——优化A任务,可能会损害B任务的性能。

为了解决这个难题,昆仑万维团队首创了一种名为“渐进式双任务强化策略”。你可以把它想象成一位训练武林高手的教练,他不会让徒弟同时练习两种冲突的武功,而是分阶段、有侧重地进行。

(1)第一阶段:先强化“图像编辑”能力,让模型学会如何在保留原图结构的基础上,精准地执行修改指令。

(2)第二阶段:再强化“文生图”能力,让模型更好地理解复杂的文字描述,提升生成图像的准确度。

通过这种“渐进式”的训练,两大任务不仅没有互相干扰,反而在协同中实现了“1+1>2”的正向增益。为了确保训练效果,团队甚至专门打造了一个名为“Skywork-EditReward”的奖励模型,像一个严苛的艺术总监,为AI的每一次修改打分,确保结果符合人类的审美。

结语:从“造工具”到“造体系”,AI正在重塑工作流

UniPic 2.0的开源,其意义远不止于一个更好用的AI绘画工具。它揭示了AI技术演进的一个重要趋势:从提供单一功能的“工具”,走向构建完整工作流的“体系”。

当理解、生成、编辑被无缝整合,AI就不再是创意流程中的一个“插件”或“外挂”,而是成为了整个工作流的“操作系统”。它改变的不仅仅是某个环节的速度,而是整条生产线的组织方式。

对于内容行业而言,这意味着:

(1)成本:制作成本大幅下降,产出节奏显著加快。

(2)协作:设计、营销、运营等环节的协作变得更紧密,减少了大量“搬运工”式的重复劳动。

(3)创意:创作者可以从繁琐的工具切换中解放出来,将更多精力投入到构思和质量把控上。

昆仑万维正通过一系列的开源模型(视频、3D、音频等),构建一个覆盖多模态AI核心场景的完整技术体系。UniPic 2.0正是这个宏大蓝图中的一块关键拼图。

当AI不再是舞台上遥不可及的酷炫演示,而是真正能嵌入我们日常高频任务、解决实际痛点的可靠伙伴时,一场真正的生产力革命,才算真正到来。而UniPic 2.0,无疑是朝着这个未来,迈出的坚实而又优雅的一步。

项目主页:

https://unipic-v2.github.io/

技术报告:

https://github.com/SkyworkAI/UniPic/blob/main/UniPic-2/assets/pdf/UNIPIC2.pdf

GitHub地址:

https://github.com/SkyworkAI/UniPic/tree/main/UniPic-2

HuggingFace Gradio:

https://huggingface.co/spaces/Skywork/UniPic2-Metaquery

HuggingFace Model:

https://huggingface.co/Skywork/UniPic2-SD3.5M-Kontext-2B; https://huggingface.co/Skywork/UniPic2-Metaquery-9B

看到这里了还不给博主点一个:

⛳️ 点赞☀️收藏 ⭐️ 关注!

💛 💙 💜 ❤️ 💚💓 💗 💕 💞 💘 💖

再次感谢大家的支持!

你们的点赞就是博主更新最大的动力!