一、模型原理

Linear Rgegrssion基于最小二乘法的线性回归。是机器学习算法里面的基本算法,在sklearn.linear_model 的包里面。它能解决的问题是通过数据拟合,从而得到比较符合事物内部规律的数学表达式。也就是说寻找到数据与数据之间的规律所在。例如对于房价的预测。

二、线性回归的原理表示

我们先从最简单的函数看起,在只有一个变量的情况下,线性回归可以用方程:y = ax+b 表示。

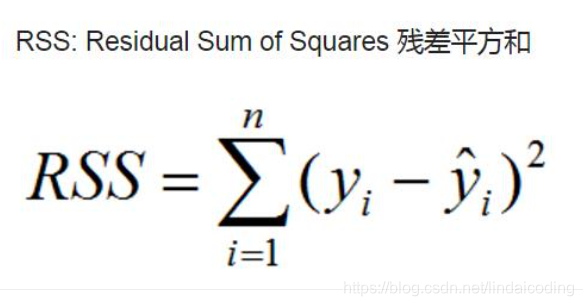

Linear Regression模型会去不断的去调整下图直线的斜率和截距,使得残差平方和Residual sum of Squares(RSS)最小。

这里残差平方是指下图中同一个x坐标下,实际点位置的y轴数值减去拟合直线上y轴数值 的平方,将所有点的残差平方加起来就出来了RSS。

将RSS处以数据数量就得出了MSE,这是一个重要的参数。Model Fitting的目标就是最小化MSE。

一级行函数我们可以求导,那很多个变量的多级函数怎么求函数的系数呢?

一个是用最小二乘法(Ordinary Least Square),拟合一个带有系数** w = (w1, ..., wp) **的线性模型去最小化其预测结果与实际结果的残差平方和。它的公式为:

本文介绍了sklearn线性回归模型的原理,基于最小二乘法的线性回归用于数据拟合,寻找数据间的规律。线性回归模型通过调整直线的斜率和截距最小化残差平方和RSS。讨论了MSE作为优化目标,以及当涉及多个变量时如何使用最小二乘法和梯度下降算法求解函数系数。

本文介绍了sklearn线性回归模型的原理,基于最小二乘法的线性回归用于数据拟合,寻找数据间的规律。线性回归模型通过调整直线的斜率和截距最小化残差平方和RSS。讨论了MSE作为优化目标,以及当涉及多个变量时如何使用最小二乘法和梯度下降算法求解函数系数。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

790

790

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?