相对熵

1.定义

相对熵(也称为KL散度或信息散度)是衡量两个概率分布之间差异的一种方法。若给定两个离散型随机变量的概率分布和

相对熵被定义为

和

之间的差异:

其中 和

分别表示

和

分布下随机变量取值为

的概率。相对熵的值越大,表示两个分布之间的差异越大。

如果 和

是连续型随机变量的概率密度函数,则相对熵的定义为:

其中, 和

分别是

和

的概率密度函数。

2.性质

(1)非负性

注:当且只有对所有,

时,相对熵为零。

(2)非对称性

相对熵可以看作两个概率测度纸质件的距离,即两个概率测度不同程度的度量,满足以下关系式

相对熵非负性的证明

1.定义法证明

对于概率分布为的某信源

,如果采用编码长度为

的方式进行编码,则平均码长为

,如果采用概率分布为

的码长方式进行编码,每个符

号的编码长度为,则平均码长为

那么由于两种编码方式的概

率不匹配,使得平均码长增加,增加量即为相对熵:

,可知增加量一定是非负的,故得证。

2.利用 Jensen 不等式进行证明

对于凸函数的性质,我们可以写出Jensen不等式如下:

相对熵的数学表达式

将 替换成

,原公式转化为:

令 ,上式变为

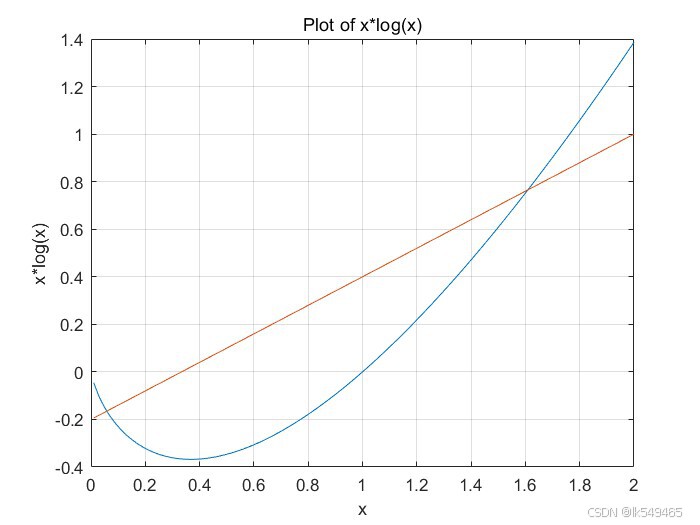

借助MATLAB绘图工具,我们画出了 的图像

x = linspace(0.01, 2, 100);

y1 = x .* log(x);

y2 = 0.6*x - 0.2;

plot(x, y1,x,y2);

xlabel('x');

ylabel('x*log(x)');

title('Plot of x*log(x)');

grid on;

因此我们知道 是一个凸函数,满足Jensen不等式。

对上述表达式进行不等式的运算:

等式成立的条件是:对于相对熵,当且仅当

时,等号成立,因此,非负性得证。

3.泰勒展开法证明:

如果 和

是连续型随机变量的概率密度函数,则证明如下:

在

处的展开是

=0

当且仅当 =

时,等号成立。

7789

7789

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?