然后我们再继续看,flink如果直接从kafka这样的消息队列中读取数据怎么做呢?

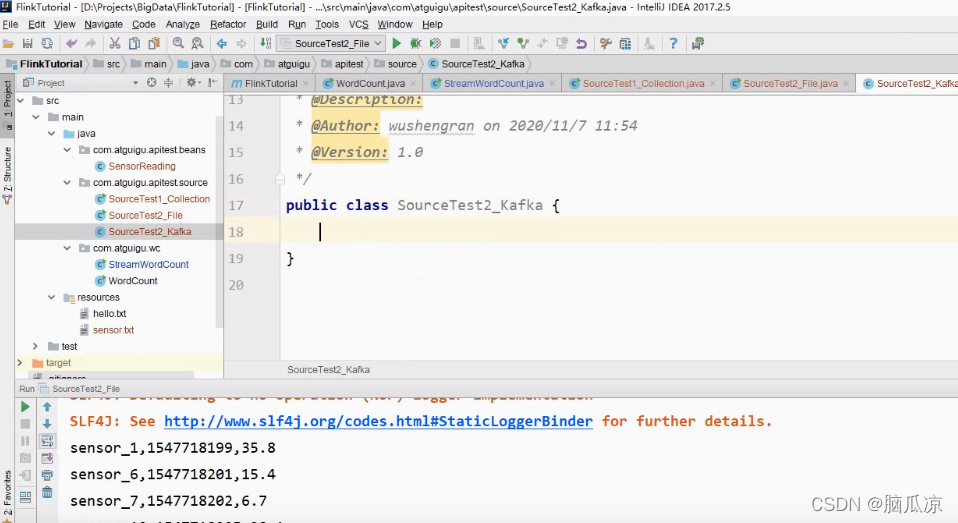

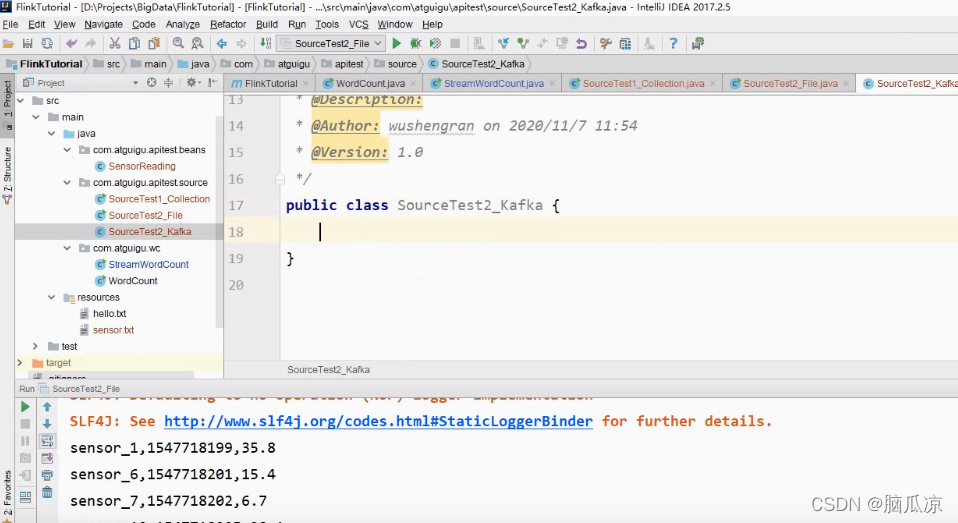

我们新建一个SourceTest2_Kafka来看,可以看到上面的类

然后我们要去,让flink接收kafka的数据的话,

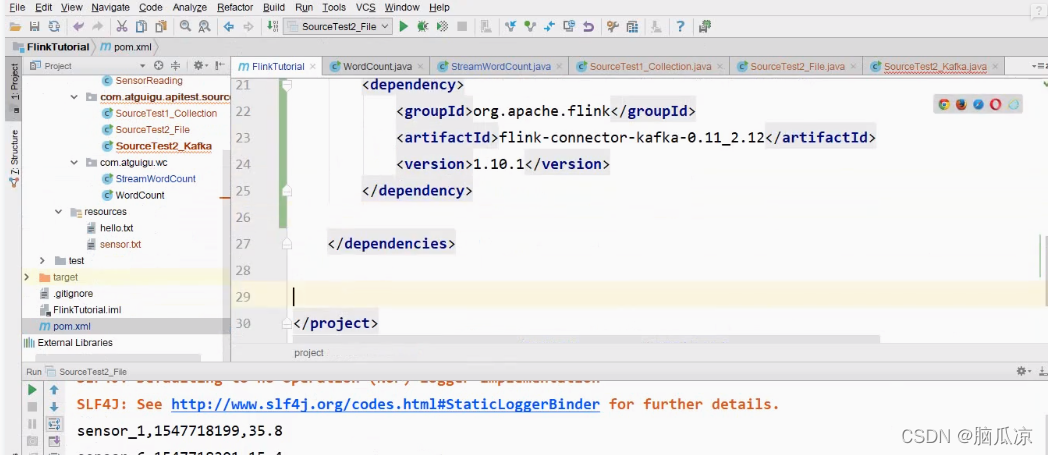

那么首先要能连接kafka,这个时候需要一个依赖

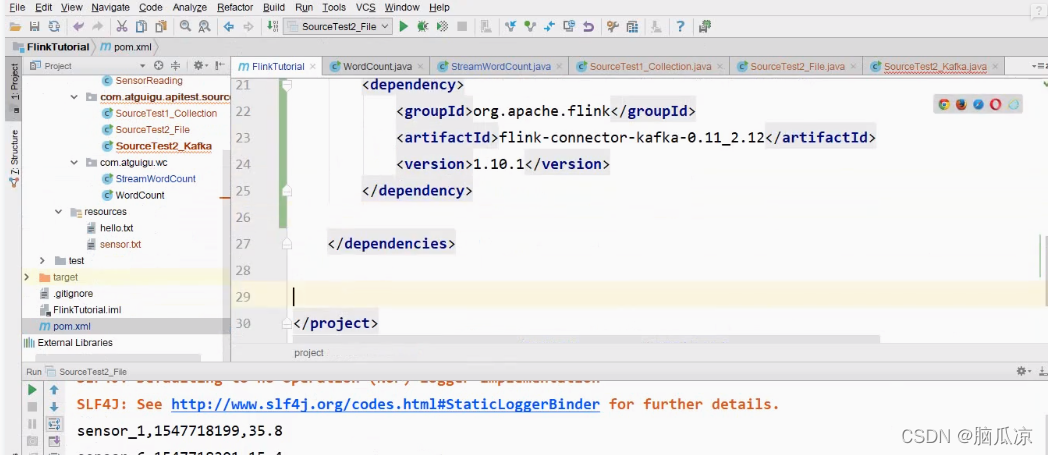

0.11kafka版本,2.12是scala版本

然后我们把依赖假如到pom.xml中去

然后我们再继续看,flink如果直接从kafka这样的消息队列中读取数据怎么做呢?

我们新建一个SourceTest2_Kafka来看,可以看到上面的类

然后我们要去,让flink接收kafka的数据的话,

那么首先要能连接kafka,这个时候需要一个依赖

0.11kafka版本,2.12是scala版本

然后我们把依赖假如到pom.xml中去

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?