然后我们来看看etl,就是数据的抽取,转换,加载的过程,

其实就是数据清洗,有个职业叫etl工程师

然后我们去看数据清洗为什么需要,因为我们处理数据的时候,首先对数据分析,不符合条件的我们可以先过滤掉,然后

再去处理,这个过滤不符合条件的数据,就是etl,数据清洗

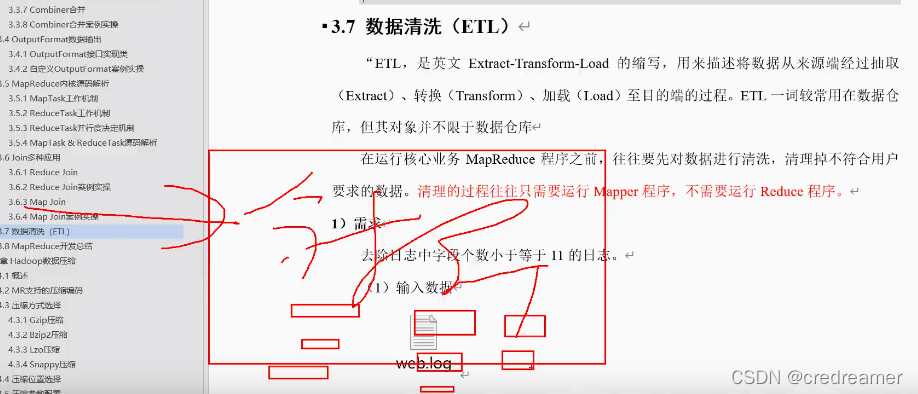

用个案例说明,去除web.log文件中不符合要求的数据

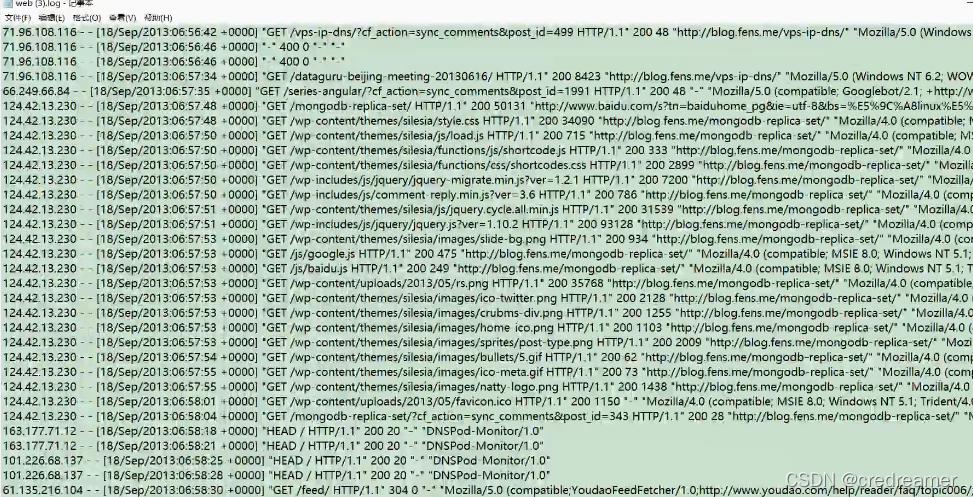

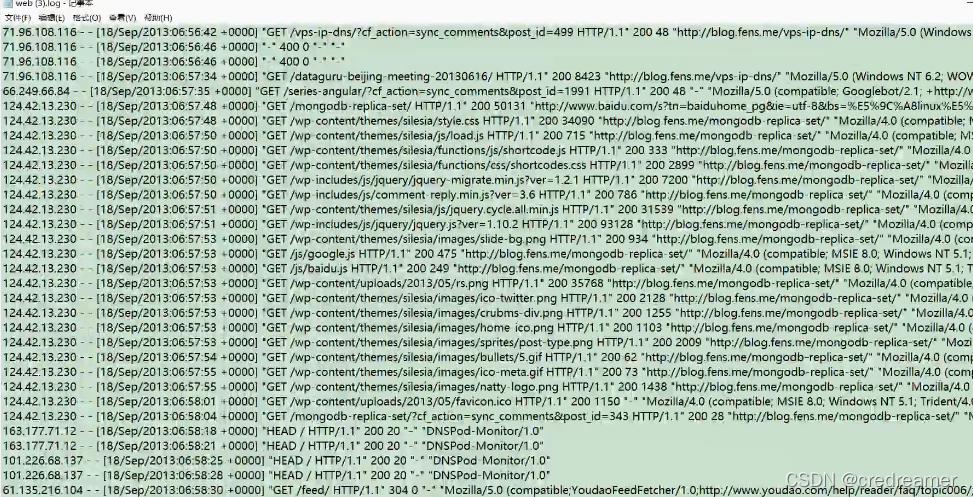

先去看看web.log中内容

然后我们来看看etl,就是数据的抽取,转换,加载的过程,

其实就是数据清洗,有个职业叫etl工程师

然后我们去看数据清洗为什么需要,因为我们处理数据的时候,首先对数据分析,不符合条件的我们可以先过滤掉,然后

再去处理,这个过滤不符合条件的数据,就是etl,数据清洗

用个案例说明,去除web.log文件中不符合要求的数据

先去看看web.log中内容

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?