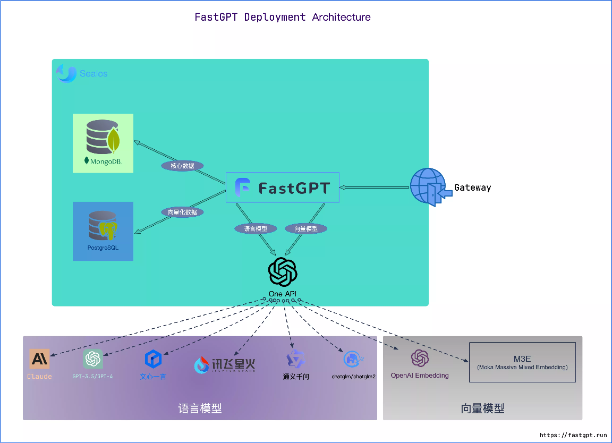

FastGPT 是一个基于 LLM 大语言模型的知识库问答系统,提供开箱即用的数据处理、模型调用等能力,它背后依赖OneApi开源项目来访问各种大语言模型提供的能力。各大语言模型提供的访问接口规范不尽相同,为此OneApi项目提供了统一的API接口去对接各种大语言模型。FastGPT的部署架构如图所示:

本文章将介绍如何部署OneApi和FastGPT,以及两种在线大语言模型(AzureOpenAI和讯飞星火3.5)的配置方法。

我将在Windows系统的WSL子系统上进行部署,WSL子系统安装的是Ubuntu22 Linux系统,WSL的部署方式完全适用于真实的Linux系统。

一、部署OneApi

OneApi项目开源地址:https://github.com/songquanpeng/one-api

1.在/opt目录下创建oneapi目录

cd opt

mkdir oneapi

cd oneapi

2.编辑docker-compose.yml文件

在/opt/oneapi目录下创建docker-compose.yml文件,将下面的内容复制进去并保存

version: '3.8'

services:

oneapi:

container_name: oneapi

image: justsong/one-api:latest

restart: unless-stopped

ports:

- 3001:3000

networks:

- llm_net

volumes:

- ./data:/data

environment:

- TZ=Asia/Shanghai

networks:

llm_net:

name: llm_net

external: true

3.创建llm_net docker网络

docker network create llm_net

4.运行oneapi

docker compose up -d

5.配置AzureOpenAI渠道

登录http://localhost:3001,用户名:root,密码:123456。

如果你没有申请AzureOpenAI,可以直接查看讯飞星火的配置方式。其实申请AzureOpenAI并不难,网上教程很多,只要真实填写相关信息,一般24小时内就可以通过。

接下来我们添加AzureOpenAI渠道,按照图中的方式填写就好了。这里有一个需要注意的地方就是名称那一项填的是Azure上面的部署名称,而这个部署名称必须要和模型名称一致(很奇怪的做法,GitHub上已经有人提了issue,正在解决)

6.测试

渠道添加成功后,可以在渠道列表页面点击“测试”按钮,如果没有问题,会返回测试成功。

7.创建令牌

令牌的名称随便填,由于是测试,可以把额度设置为无限额度。

提交后,可以在令牌列表页面复制刚刚创建的令牌,这个令牌将在部署FastGPT时用到。

二、部署fastgpt

1.在/opt目录下创建fastgpt目录

cd opt

mkdir fastgpt

cd fastgpt

2.编辑docker-compose.yml文件

请先阅读FastGPT官方部署文档:https://doc.fastgpt.in/docs/development/docker/

下载docker-compose.yml文件和config.json文件

curl -O https://raw.githubusercontent.com/labring/FastGPT/main/files/deploy/fastgpt/docker-compose.yml

curl -O https://raw.githubusercontent.com/labring/FastGPT/main/projects/app/data/config.json

编辑docker-compose.yml文件,主要是更改了容器网络,数据库用户名密码之类的

version: '3.8'

services:

pg:

image: ankane/pgvector:v0.5.0 # git

# image: registry.cn-hangzhou.aliyuncs.com/fastgpt/pgvector:v0.5.0 # 阿里云

container_name: pg

restart: always

ports:

- 5432:5432

networks:

- llm_net

environment:

- POSTGRES_USER=fastgpt

- POSTGRES_PASSWORD=123456

- POSTGRES_DB=f

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2818

2818

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?