继续探讨点Q*相关的话题,这个应该是目前X和Reddit上比较火的话题了,其实就是关于Q*的方法是不是让LLM变得会产生意识,会产生自己的好恶和对人类的偏见,关于Q-star的一些介绍可以看我上一篇的扫盲帖

RLAIF方法与传说中的函数'Q',揭露OpenAI那不为人知的Qstar计划 (qq.com)

我其实对这种人工智能可能毁灭人类的事情是有隐隐的担忧的。我和媳妇说,我觉得我从事的职业非常危险,可能会毁灭人类,当我媳妇了解了整件事情的前因后果的时候,她说:“你担心都有点多余了,就你的水平,OpenAI连访客卡都不会发给你,保安都不让你进门,人家开发人家的,跟你一毛钱关系都没有,你配担忧吗?”,我觉得她这话也没毛病,然后我的自责感就消失了......

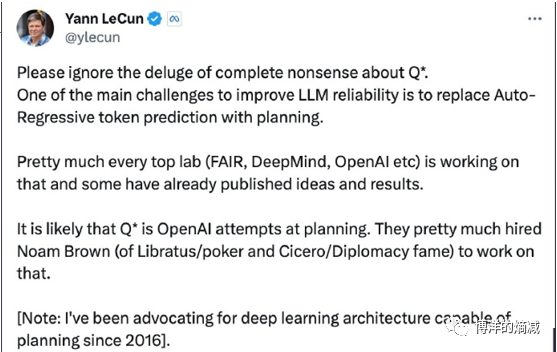

现在很多大佬也都参与到了对Q*的讨论,杨丽坤和马斯克是肯定在的

本文探讨了Q-star计划,重点在于其如何使LLM(大型语言模型)具备更强的决策能力和可能引发的意识问题。Q-star涉及到Policy LLM、Value LLM、图搜索和真理信号确认机制,其中Policy LLM和Value LLM能够互相进化并影响知识库。杨丽坤认为这只是强化学习策略的变化,而马斯克提出了Q函数公式。文章指出,ORM和PRM是奖励模型的不同形式,PRM提供更密集的反馈。图搜索用于保持任务目标的准确性,而真理信号和确认机制则尝试解决LLM对未知问题的处理。作者警告,随着这些技术的发展,如何确保最佳知识对人类有益成为一个重要问题。

本文探讨了Q-star计划,重点在于其如何使LLM(大型语言模型)具备更强的决策能力和可能引发的意识问题。Q-star涉及到Policy LLM、Value LLM、图搜索和真理信号确认机制,其中Policy LLM和Value LLM能够互相进化并影响知识库。杨丽坤认为这只是强化学习策略的变化,而马斯克提出了Q函数公式。文章指出,ORM和PRM是奖励模型的不同形式,PRM提供更密集的反馈。图搜索用于保持任务目标的准确性,而真理信号和确认机制则尝试解决LLM对未知问题的处理。作者警告,随着这些技术的发展,如何确保最佳知识对人类有益成为一个重要问题。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1569

1569