据投资银行高盛(Goldman Sachs)发布报告,随着 AI 技术的突破,预计全球将有 3 亿个工作岗位被生成式 AI 取代。麦肯锡全球研究院也有共识:到 2030 年全球将有 4 亿个工作岗位受到自动化冲击。

如今,普通人的生产力正在被 DeepSeek、Sora 等工具不断重塑,特别是 Cursor 这样的 AI 助手出现以后,即便是完全不懂编程的小白,也仅需通过自然语言描述想法,就能实现 AI 辅助编程、智能代码补全、错误检测与修复、代码优化、插件扩展等多种功能。985 学霸苦学 5 年的编程知识,可能被一句“帮我写个 Python 爬虫”的提示词轻松替代;企业技术总监引以为傲的系统架构,正在被 AutoDev 自动化工具重构……

但硬币的另一面,是 RAG 技术让零基础小白 3 天搭建智能客服,是 Llama3 微调教程在 GitHub 狂揽 10 万星。在 AI 的帮助下,有不少不足十人的开发团队,维护着月活上百万的应用。麦肯锡的报告还预测,到 2030 年,全球 AI 人才缺口将达到 4000 万人,包括很多复合型人才:AI 架构师、多模态算法工程师、AI 安全工程师、AI 产品经理……

可以说,开发者的生存法则,已经被改写了,且极为简单粗暴:要么和生成式 AI 站在一起,吃肉;要么继续做“老派开发”,未来很可能喝西北风。以前大家为 35 岁中年危机而焦虑,以后对于不懂 AI 的开发者来说,能不能坚持到 35 岁都还是个未知数。对开发者而言,应对未来挑战的关键,就是转型为具备 AI 能力的超级个体或是团队内的 AI 应用专家。

但转型这件事儿,不像听起来那么容易。

1转型魔咒背后,是三重现实枷锁

首先硬件就是个大门槛。

- 算力困境

即便 DeepSeek 的出现已经极大降低了硬件成本,但对普通开发者而言,成本依旧高昂:如果想在本地部署 DeepSeek-7B,通常需要至少 32GB 的内存和 24GB 显存的 GPU,并且需要 4/8-bit 量化(会造成准确率下降和生成质量下降),而且一旦配置过低,特别是内存不足的时候,token 的输出速度就会显著变慢,非常影响开发效率。

而随着参数量的增长,对硬件的需求也越来越高,以 DeepSeek-13B 为例,想要在本地部署并流畅运行,通常需要至少两张显存容量为 24G 的高性能显卡。某培训机构的调研显示,有多达 62% 的学员因为本地部署成本放弃了相关的学习和实践机会。

- 启动策略

即便跨过了硬件门槛,在软件层面上,开发者们也需要面对各种各样的问题:在数据处理与预处理阶段,数据噪声、标注错误、样本不均衡等问题,需要极其复杂的清洗流程;在训练与调优阶段,分布式训练需要解决通信开销、并行策略调试复杂的难题;在部署与推理优化阶段,为了降低延迟,提高吞吐量,需要结合量化、剪枝和蒸馏等手段。

开发者还需要设置内容过滤机制、防止幻觉、定期重训练等等……相比之下,PyTorch 环境配置错误、CUDA 版本冲突、OOM 报错等,甚至已经只能算小问题了。

虽然网络上现成的教程不少,但其内容几乎全是指导开发者如何对 AIGC 应用进行训练,这无异于让驾校学员从造发动机开始学开车,是彻彻底底的本末倒置。

在任意技术论坛搜索“LLM 教程”,多数内容都在教授如何设计分层学习率衰减策略、如何在分布式训练中同步梯度更新等等,而这些内容本就不适合入门的开发者,到最后只会造成理论知识和实践的脱节:开发者能头头是道地分析不同分词器的优劣,但面对实际业务中的多轮对话需求时却束手无策。

3.“知识陷阱”

对开发者而言,围绕 AI 进行应用开发需要一个系统性的路径。但市面上的多数 AI 课程只是在贩卖焦虑。

就拿《xx 天教你学会用 OpenAI》《xx 天教你学会用 DeepSeek》这样所谓的教程来举例,实际上这类教程只是围绕“提示词”做文章,并没有真正用于 AI 应用开发的干货。

即便只从教学角度出发,其内容也是极其千篇一律,毕竟诸如 OpenAI 或 DeepSeek 的使用方式基本都是一致的:思考需求——准确给出需求——根据 AI 呈现的结果继续微调——输出最终结果。其中的关键就在于提示词,而这些教程则会把提示词,用指令驱动、需求导向、启发式提问等各种花里胡哨的词进行包装,引导开发者进群或者付费购买,不仅实用性差,还会让他们陷入工具集拼凑的迷宫:缺乏系统化实践框架的学习,就像在游乐场抓娃娃,看似热闹却颗粒无收。

层层困境之下,开发者的转型之路举步维艰。

2破局密钥:开发者如何化繁为简,实现能力进阶?

因此,破局的关键,无非也集中在三个方面:硬件上降低门槛,入门选好起步方向,有足够系统且实际的开发指导。

- 硬件降维:CPU 云实例的“以小搏大”

我们先聊聊硬件门槛的问题,AI 应用开发必须要配置 GPU 算力吗?这件事需要辩证地去看。

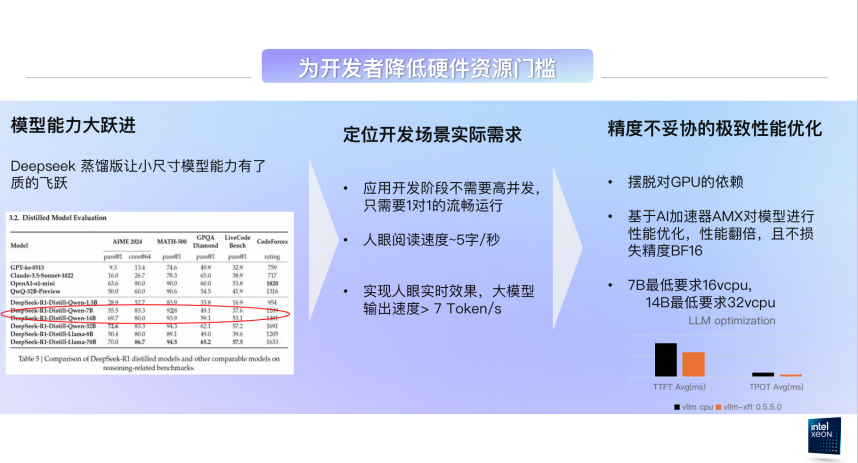

准确来说,在需要支持大规模高并发的生产部署阶段,确实需要算力更强的 GPU 等加速器硬件资源,但是在 AI 应用的开发阶段,其实需要满足 1 对 1 的“实时”性能,即每秒 > 5 token 的输出,才可以很好地支持开发需求,因为这样的速度足以达到人眼阅读速度的“流畅”标准。

事实上,对于普通开发者入门 AI 应用开发,基于 CPU 的云实例才是更为友好的选择。

首先是成本方面,CPU 实例的租赁成本远低于 GPU,开发者无需为高性能显卡支付额外费用,尤其适合个人学习或小规模实验。

其次,CPU 环境下无需处理复杂的 GPU 驱动、CUDA 版本适配等问题,开发者可专注于数据处理和 API 调用等核心技能,降低初期学习门槛。

最后,CPU 实例下,开发流程实际上更接近实际生产环境,许多实际业务场景因成本考量仍依赖 CPU 集群。所以从 CPU 起步,能帮助开发者提前适应真实的工程环境,后续过渡到 GPU 优化时也更容易定位性能瓶颈。

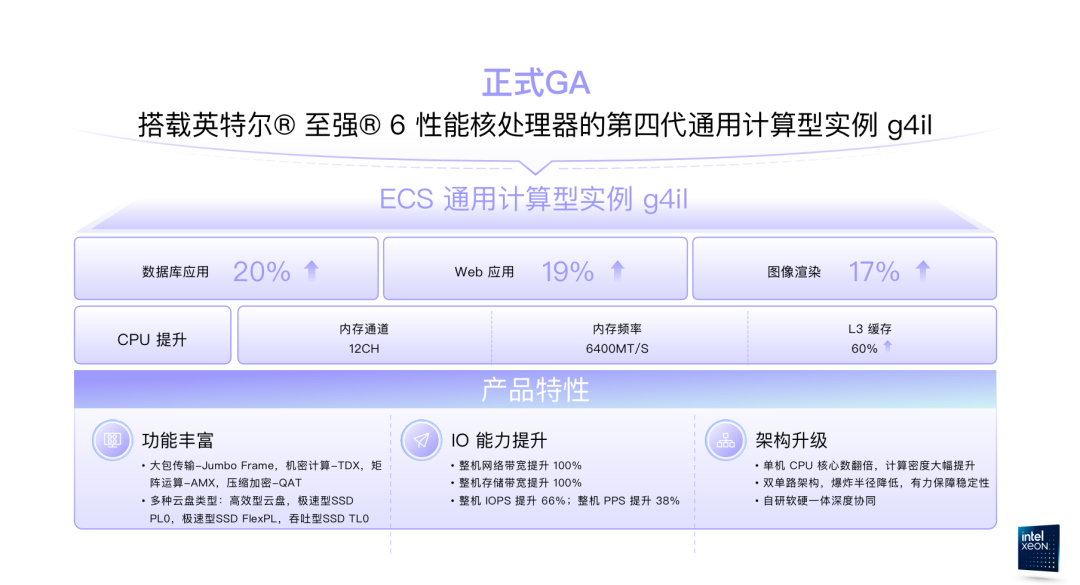

以火山引擎最新推出的 g4il 云实例为例,其搭载了英特尔®至强® 6 性能核处理器。

一方面,作为底层算力基础设施的至强® 6 性能核处理器实现了计算密度、AI 性能等多方面的升级,为云实例部署 AI 应用提供了硬件层面的基础。

针对行业应用越发复杂的现状,英特尔为人工智能、5G 网络、数据分析、科学计算等现代工作负载引入了全新的设计理念,并采用系统级的设计方法,在 CPU 芯片架构中内置了专用工作负载加速器,以提高性能和效率。

其中,用于加速深度学习实时推理和训练性能提升的英特尔® AMX 加速器新增了对 FP16 指令集的支持,为 AI 推理加速提供了更优的底层环境。此外,通过 AVX-512 指令集的加速,如果再结合高速 MRDIMM 内存,至强® 6 性能核处理器整体的 AI 性能则能得到更大提升。

另一方面,g4il 也针对 AI 负载进行了专门优化。

针对推理服务对服务器的高 I/O 性能要求,g4il 进一步升级了 I/O 能力,与第三代实例 g3il 相比,整机网络和存储带宽都实现了 100% 的提升,网络收发 PPS 和存储读写的 IOPS 也提升了 30% 以上。此外,g4il 还采用了创新的双单路架构,使得“爆炸半径”大幅降低,有力保障了产品的稳定性。

成本方面,通过海量的内外资源共池,可以在保证 g4il 实例资源厚度的同时提供极致的弹性能力,一方面可以把超大规模的资源复用所带来的溢价能力和成本红利释放给企业,另一方面,基于字节跳动国内业务的资源分时复用方案,火山引擎推出了业界首创的弹性预约实例,在为弹性需求提供资源确定保证性的同时,还能进一步节省企业的成本。

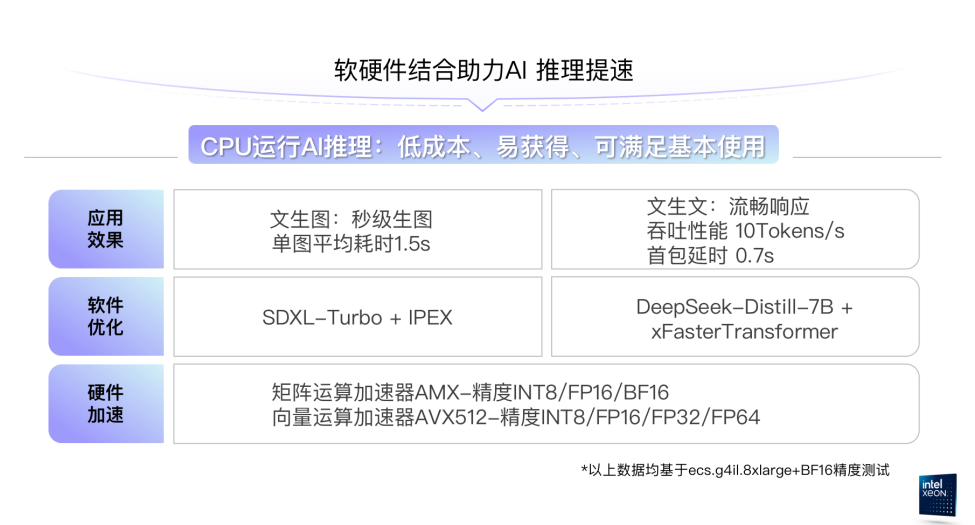

除此之外,g4il 也通过自身的软硬件结合优化提升了 AI 性能:硬件层面,g4il 支持 AVX-512 向量运算加速器和 AMX 矩阵运算加速器,同时还支持 AI 推理中常用的 INT 8、BF 16 和 FP 16 等精度;软件层面,针对文生图和文生文等场景,g4il 都提供了对应的推理引擎来充分释放硬件能力,在运行 SDXL-Turbo 时能够实现秒级的文生图能力。

最后,针对云上的 AI 场景,火山引擎打造了端到端的安全方案,同时基于 CPU 和 GPU 的机密计算能力,对固件内核虚拟化操作系统进行了联合深度优化,在高效实现机密计算的同时,显著降低了因内存加密导致的性能开销。此外,在机密云服务器之上,火山引擎还提供了机密容器、密钥管理、远程证明等丰富的安全能力和服务,为 AI 应用中训练推理和数据前后处理等场景保驾护航。

- 软件突围:RAG 即战力

而在起步方向的选择上,切忌贪多。

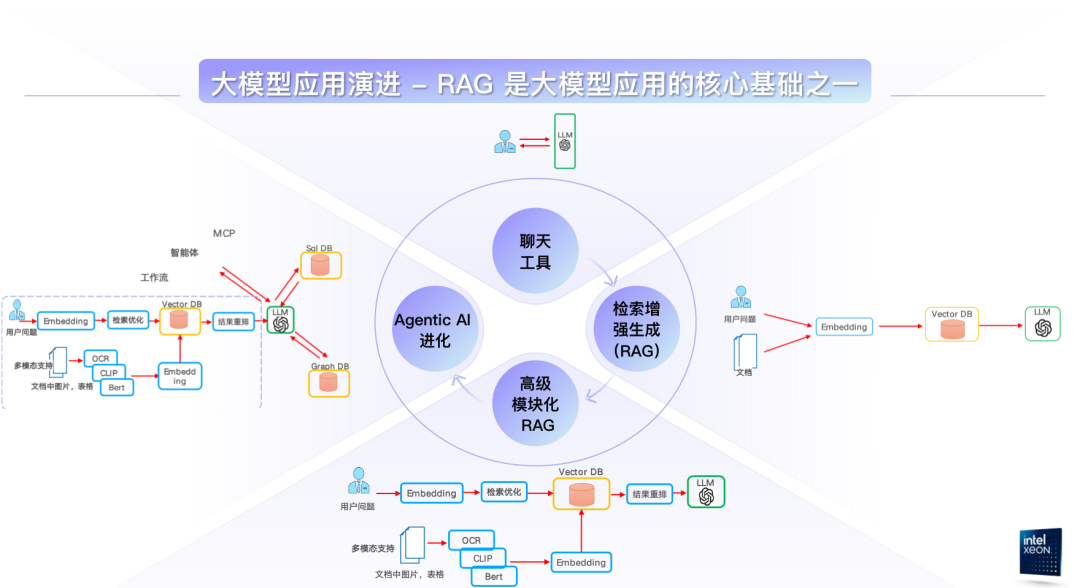

AI 应用开发覆盖了相当广阔的技术栈,单独某一项技术列出来,都意味着极大的学习成本,同时,从底层驱动加速库到框架、工具等一系列的组合也很容易让开发者踩坑。基于此,笔者推荐选择增强检索生成应用(RAG)作为起步的学习和开发方向。

首先,RAG 技术应用前景很好,它是当下解决“幻觉问题”最重要的技术手段之一;其次,开发者无需从头做预训练;此外,RAG 在垂直领域的适配性更强,且拥有较为成熟的工具链支持和社区实践,开发者可以借鉴大量案例实现快速落地,例如结合企业内部文档构建智能客服、结合医疗、法律、金融等领域的专业知识库,进行专业领域问答等等。

此外,围绕 RAG 的现存学习资源最为丰富。早在去年英特尔就推出了 OPEA 开源社区,为开发者提供了开放架构和模块化组件,以及经过优化的、预先验证过的开源应用范例。在今年,英特尔又和火山引擎一起合作,以 OPEA 开源应用范例和虚拟机镜像结合的方式,为开发者提供了一键部署 RAG 最佳实践的能力。

这意味着,依托于云端服务的易用性,从点击部署到应用环境就绪,只需要 3 分钟就可以让开发者快速部署 RAG,掌握 AI 应用的开发核心思路:包括借助模块化架构(检索 + 生成)理解复杂系统设计,提升工程化思维;培养数据优化、结果可控性设计能力等,从而为构建精准、合规的 AI 应用奠定基础。

- 进化路径:从入门到精通

在开发指导方面,英特尔携手火山引擎共同推出了面向开发者群体的实战系列培训课程。开发者在掌握了 RAG 的应用架构、开发环境配置之后,就能通过手把手教程学习如何在火山云 IaaS CPU 实例上部署和启动 OPEA ChatQnA 应用,并以此为基础了解知识库问答应用的架构及源码解析,学习如何配置 WebUI 和 AI 应用直接交互。

不但如此,在初步掌握了 RAG 的开发与部署之后,开发者通过进阶课程可以学习 RAG 性能评估、参数优化、向量检索优化、数据处理流水线的设计与调整等课程,了解如何提高 RAG 系统性能和精度、如何通过 AMX 指令集加速 RAG retrieval - VectorSearch,以及如何解决知识库应用常见问题等等。

优化、数据处理流水线的设计与调整等课程,了解如何提高 RAG 系统性能和精度、如何通过 AMX 指令集加速 RAG retrieval - VectorSearch,以及如何解决知识库应用常见问题等等。

最后,开发者还能在精通 RAG 的基础上,进一步学习应用集群化部署、视频数据检索能力构建、多模态文档内容识别、以及低代码,工作流,智能体方案集成等真正意义上的 AI 应用开发课程,实现从入门到精通的成长。

那么,如何快速系统的去学习大模型LLM?

作为一名从业五年的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

9周快速成为大模型工程师

第1周:基础入门

-

了解大模型基本概念与发展历程

-

学习Python编程基础与PyTorch/TensorFlow框架

-

掌握Transformer架构核心原理

-

第2周:数据处理与训练

-

学习数据清洗、标注与增强技术

-

掌握分布式训练与混合精度训练方法

-

实践小规模模型微调(如BERT/GPT-2)

第3周:模型架构深入

-

分析LLaMA、GPT等主流大模型结构

-

学习注意力机制优化技巧(如Flash Attention)

-

理解模型并行与流水线并行技术

第4周:预训练与微调

-

掌握全参数预训练与LoRA/QLoRA等高效微调方法

-

学习Prompt Engineering与指令微调

-

实践领域适配(如医疗/金融场景)

第5周:推理优化

-

学习模型量化(INT8/FP16)与剪枝技术

-

掌握vLLM/TensorRT等推理加速工具

-

部署模型到生产环境(FastAPI/Docker)

第6周:应用开发 - 构建RAG(检索增强生成)系统

-

开发Agent类应用(如AutoGPT)

-

实践多模态模型(如CLIP/Whisper)

第7周:安全与评估

-

学习大模型安全与对齐技术

-

掌握评估指标(BLEU/ROUGE/人工评测)

-

分析幻觉、偏见等常见问题

第8周:行业实战 - 参与Kaggle/天池大模型竞赛

- 复现最新论文(如Mixtral/Gemma)

- 企业级项目实战(客服/代码生成等)

第9周:前沿拓展

- 学习MoE、Long Context等前沿技术

- 探索AI Infra与MLOps体系

- 制定个人技术发展路线图

👉福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

881

881

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?