一、本文介绍

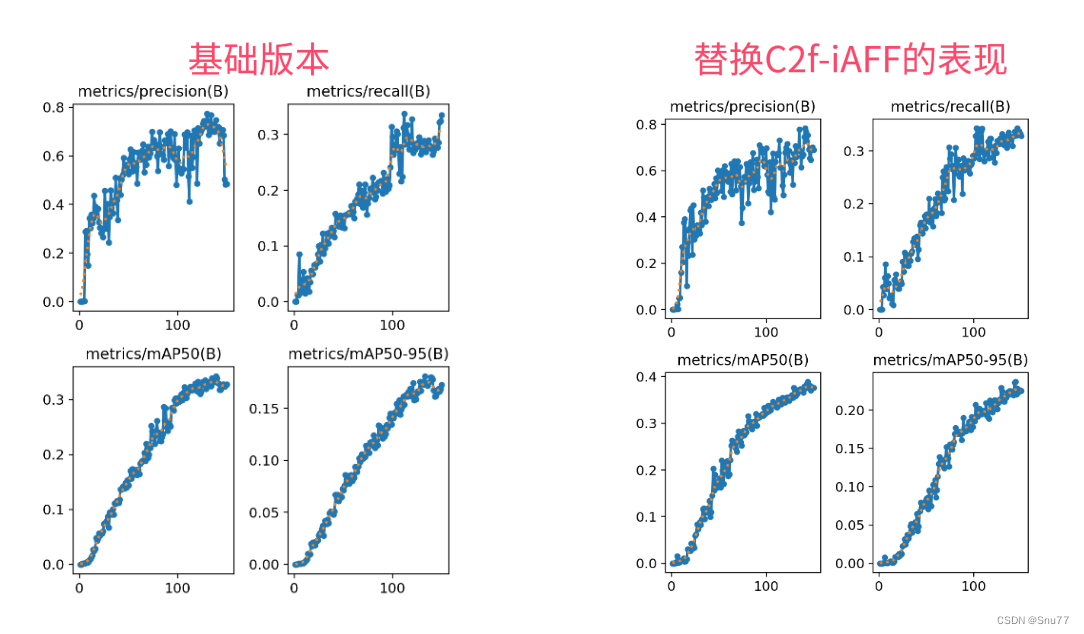

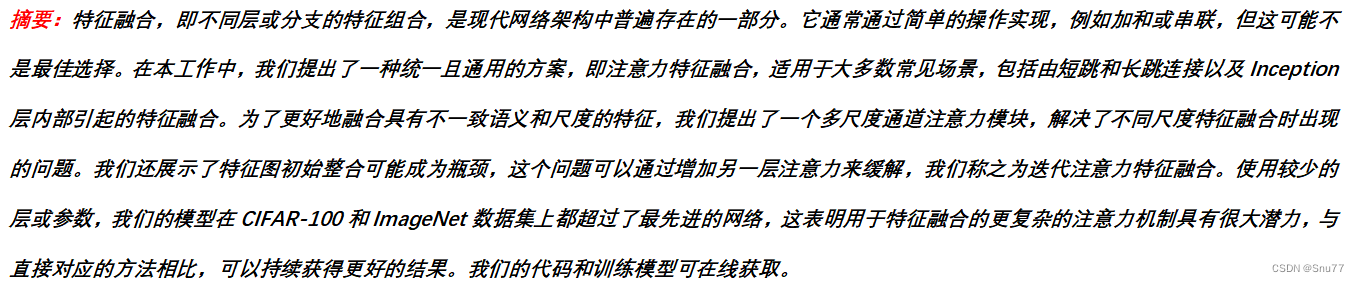

本文给大家带来的最新改进机制是iAFF(迭代注意力特征融合),其主要思想是通过改善特征融合过程来提高检测精度。传统的特征融合方法如加法或串联简单,未考虑到特定对象的融合适用性。iAFF通过引入多尺度通道注意力模块(我个人觉得这个改进机制就算融合了注意力机制的求和操作),更好地整合不同尺度和语义不一致的特征。该方法属于细节上的改进,并不影响任何其它的模块,非常适合大家进行融合改进,单独使用也是有一定的涨点效果。

欢迎大家订阅我的专栏一起学习YOLO!

目录

二、iAFF的基本框架原理

官方论文地址: 官方论文地址点击即可跳转

官方代码地址: 官方代码地址点击即可跳转

iAFF的主要思想在于通过更精细的注意力机制来改善特征融合,从而

订阅专栏 解锁全文

订阅专栏 解锁全文

6735

6735

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?