一、本文介绍

本文给大家带来的改进机制是CVPR2024的最新改进机制DynamicConv其是CVPR2024的最新改进机制,这个论文中介绍了一个名为ParameterNet的新型设计原则,它旨在在大规模视觉预训练模型中增加参数数量,同时尽量不增加浮点运算(FLOPs),所以本文的DynamicConv被提出来了,使得网络在保持低FLOPs的同时增加参数量,在其提出的时候它也提出了一个新的模块hostModule,我勇其魔改C2f从而达到创新的目的,在V5n上其参数量仅有130W计算量为2.9GFLOPs,从而允许这些网络从大规模视觉预训练中获益。

欢迎大家订阅我的专栏一起学习YOLO!

目录

二、原理介绍

官方论文地址: 官方论文地址点击此处即可跳转

官方代码地址: 官方代码地址点击此处即可跳转

动态卷积(Dynamic Convolution)是《DynamicConv.pdf》中提出的一种关键技术,旨在增加网络的参数量而几乎不增加额外的浮点运算(FLOPs)。以下是关于动态卷积的主要信息和原理:

主要原理:

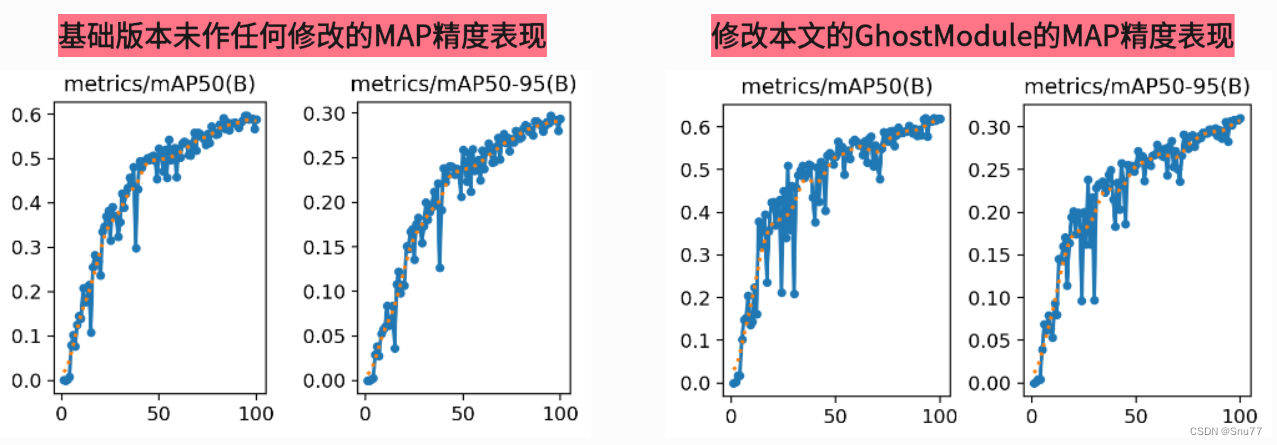

本文介绍了如何将CVPR2024的DynamicConv中的GhostModule应用于YOLOv5,旨在增加模型参数量而不增加FLOPs。详细阐述了动态卷积的工作原理,并提供手把手的代码添加教程,包括修改YOLO模型结构的四个步骤。通过这种方法,有望提升目标检测模型的性能和适应性。

本文介绍了如何将CVPR2024的DynamicConv中的GhostModule应用于YOLOv5,旨在增加模型参数量而不增加FLOPs。详细阐述了动态卷积的工作原理,并提供手把手的代码添加教程,包括修改YOLO模型结构的四个步骤。通过这种方法,有望提升目标检测模型的性能和适应性。

订阅专栏 解锁全文

订阅专栏 解锁全文

700

700