论文地址->官方论文代码地址

官方代码地址->官方下载地址Github

个人修改代码地址-> 个人修改版本下载地址优快云

一、本文介绍

本博客将介绍一种新的时间序列预测模型——FNet,它通过使用傅里叶变换代替自注意力机制,旨在解决传统Transformer模型中的效率问题。FNet模型通过简单的线性变换,包括非参数化的傅里叶变换,来“混合”输入令牌,从而实现了快速且高效的处理方式。这种创新的方法在保持了相对较高的准确性的同时,显著提高了训练速度,特别是在处理长序列数据时更显优势。本文的内容包括:FNet的工作原理,并通过一个实战案例展示如何实现基于FNet的可视化结果和滚动长期预测。

预测类型->多元预测、单元预测、长期预测。

适用对象->资源受限的环境,例如生产服务器或边缘设备

二、FNet的工作原理

1.FNet的框架原理

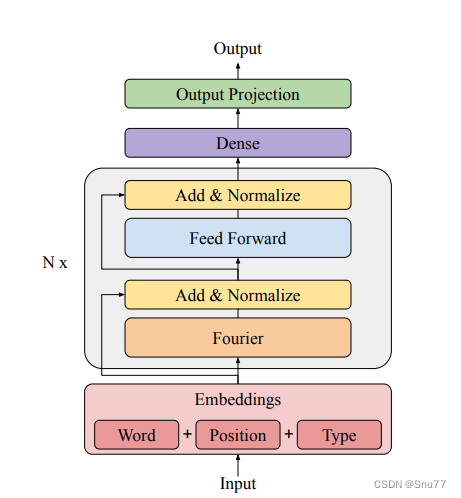

FNet是一种基于Transformer编码器架构的模型,通过替换自注意力子层为简单的线性变换,特别是傅里叶变换,来加速处理过程。FNet架构中的每一层由一个傅里叶混合子层和一个前馈子层组成(下图中的白色框)。傅里叶子层应用2D离散傅里叶变换(DFT)到其输入,一维DFT沿序列维度和隐藏维度。

总结:FNet相对于传统的Transformer的改进其实就一点就是将注意力机制替换为傅里叶变换,所以其精度并没有提升(我觉得反而有下降,但是论文内相等,但是从我的实验角度结果分析精度是有下降的),其这么改进的主要效果就是训练速度的加快,因为注意力机制一般都需要复杂计算,傅里叶变化的计算很简单。

2.FNet的主要优势

FNet的改进主要优势可能就是其训练速度了,这适合一些资源受限的环境,例如生产服务器或边缘设备,当我们在实际工作时候生产环境一般都不带有GPU的所以速度就很重要了,下面我来分析其训练速度的提升。

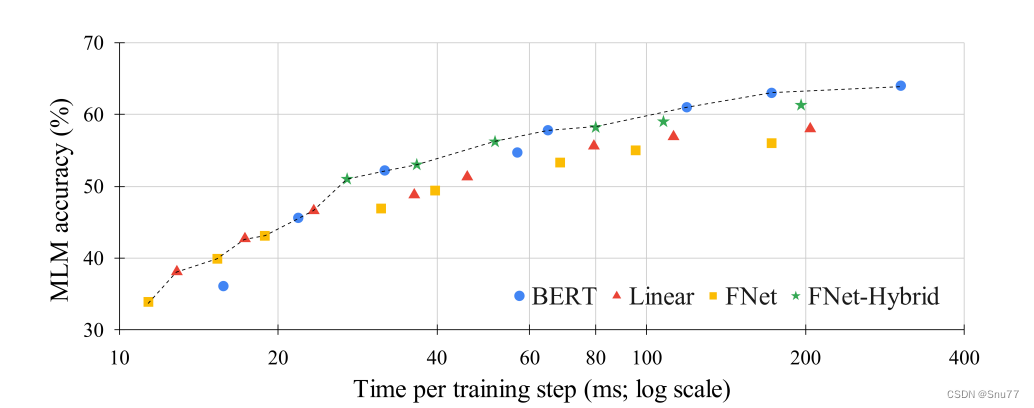

上面的这张图表展示了不同模型在掩码语言模型(MLM)任务中的准确性与训练步骤时间的关系。时间以毫秒(ms)为单位,采用对数尺度表示,可以看出随着训练时间的增加,准确性有所提升

图中展示了四种不同的模型:

- BERT(用蓝色圆点表示)

- Linear(用红色三角形表示)

- FNet(用黄色方块表示)

- FNet-Hybrid(用绿色星形表示)

从图中可以观察到以下几点:

- BERT模型在相对较短的训练时间内提供了高准确性,但随着时间的增加,准确性提升的速度放缓。

- Linear模型在初始阶段准确性较低,但随着训练时间的增加,其准确性的提升速度似乎比BERT模型要快。

- FNet模型的表现介于BERT和Linear模型之间,表明其在训练速度和准确性之间取得了一定的平衡。

- FNet-Hybrid模型与FNet相比,似乎在较长的训练时间内达到了更高的准确性,这表明在FNet中加入了一些自注意力机制可能会有所帮助。

此图的一个关键信息是,尽管BERT在开始时领先,但随着时间的推移,其他模型在准确性上逐渐接近BERT,这表明对于有限的训练时间,其他模型可能是更有效的选择。此外,考虑到时间和准确性的平衡我们本文的模型FNet和FNet-Hybrid可能更适合在资源有限的情况下使用。

三、数据集介绍

本文所用到的数据集为某公司的业务水平评估和其它参数具体的内容我就介绍了估计大家都是想用自己的数据进行训练模型,这里展示部分图片给大家提供参考->

四、参数讲解

模型涉及到的参数全部如下->

parser = argparse.ArgumentParser(description='FNet Multivariate Time Series Forecasting')

# basic config

parser.add_argument('--train', type=bool, default=True, help='Whether to conduct training')

parser.add_argument('--rollingforecast', type=bool, default=True, help='rolling forecast True or False')

parser.add_argument('--rolling_data_path', type=str, default='ETTh1-Test.csv', help='rolling data file')

parser.add_argument('--show_results', type=bool, default=True, help='Whether show forecast and real results graph')

parser.add_argument('--model', type=str, default='FNet',help='Model name')

# data loader

本博客介绍了新的时间序列预测模型FNet,它用傅里叶变换代替自注意力机制,解决传统Transformer效率问题,提高训练速度。文中阐述其工作原理、优势,通过实战案例展示基于FNet的可视化结果和滚动长期预测,还介绍数据集、参数、项目结构等,最后说明定制化训练个人数据集的方法。

本博客介绍了新的时间序列预测模型FNet,它用傅里叶变换代替自注意力机制,解决传统Transformer效率问题,提高训练速度。文中阐述其工作原理、优势,通过实战案例展示基于FNet的可视化结果和滚动长期预测,还介绍数据集、参数、项目结构等,最后说明定制化训练个人数据集的方法。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

660

660