[2024-01-18] 在线运行demo: https://www.modelscope.cn/models/iic/cv_ddcolor_image-colorization/summary

[2023-12-13] Release the DDColor-tiny pre-trained model!

[2023-09-07] Model Zoo 多个模型发布:https://github.com/piddnad/DDColor/blob/master/MODEL_ZOO.md

[2023-05-15] 代码开源 :https://github.com/piddnad/DDColor?tab=readme-ov-file

[2022-12-22] 发布论文 DDColor: Towards Photo-Realistic Image Colorization via Dual Decoders

简介

阿里巴巴摩院 提出基于Unet+Transfomer(cross-attenrtion)。双解码结构的图像上色着色 (image colorization)模型

由于图片残缺脱色破损等病态,多模态的信息的不确定性,自动图像着色是一个具有挑战性的问题。

直接训练深度神经网络通常会导致语义颜色不正确,颜色丰富度低(low color richness)

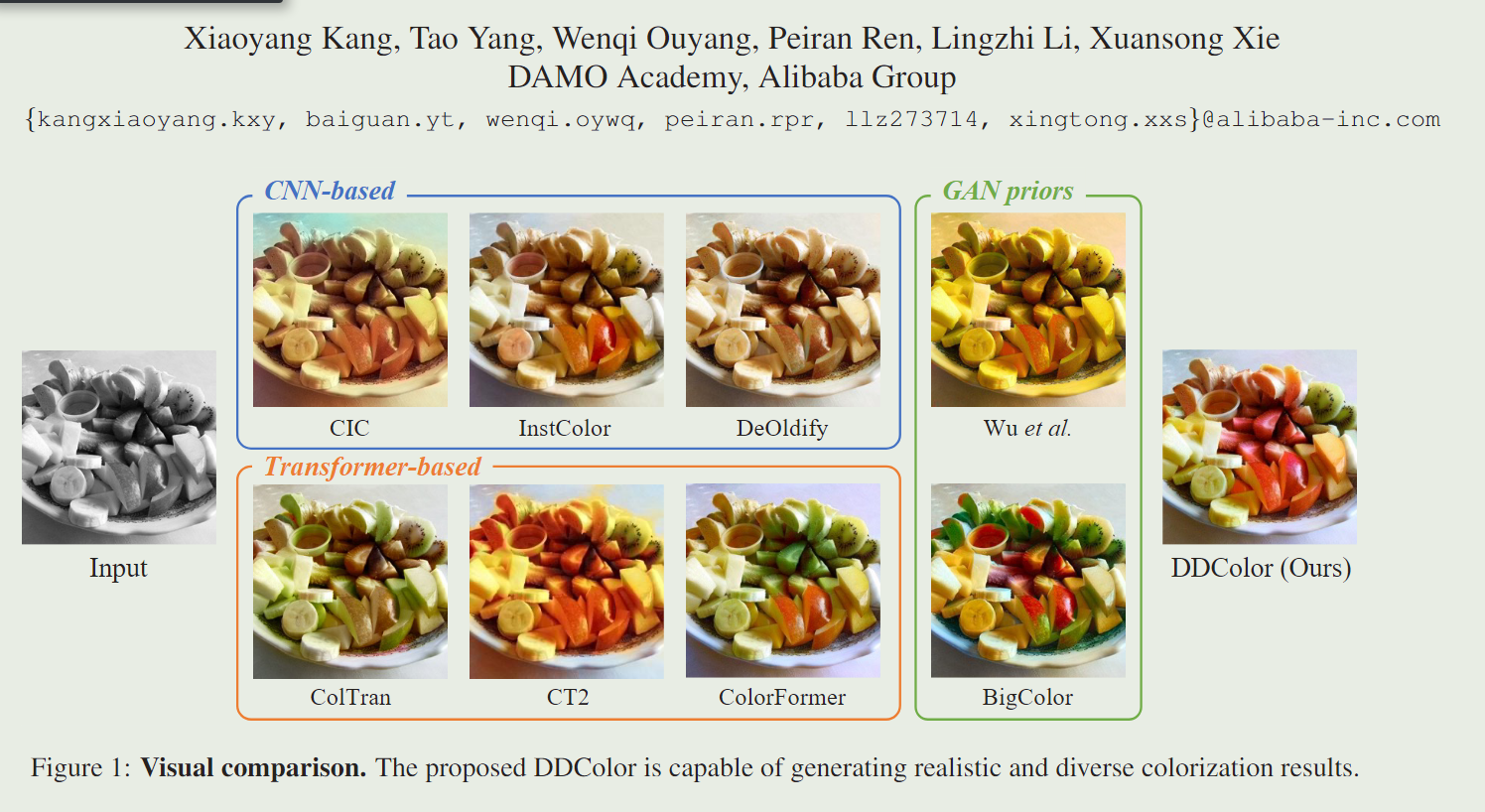

不像以前的方法是通过额外的网络或手动计算先验来优化颜色可能性,我们的方法使用基于变换的颜色解码器以端到端方式学习自适应语义感知的颜色嵌入。通过使用多尺度图像特征来学习颜色查询,我们的方法减轻了颜色溢出,并显著改善了小物体的着色(见图1)。在此基础上,我们提出了一种新的色彩损失,以提高生成结果的色彩丰富度。

主要方法

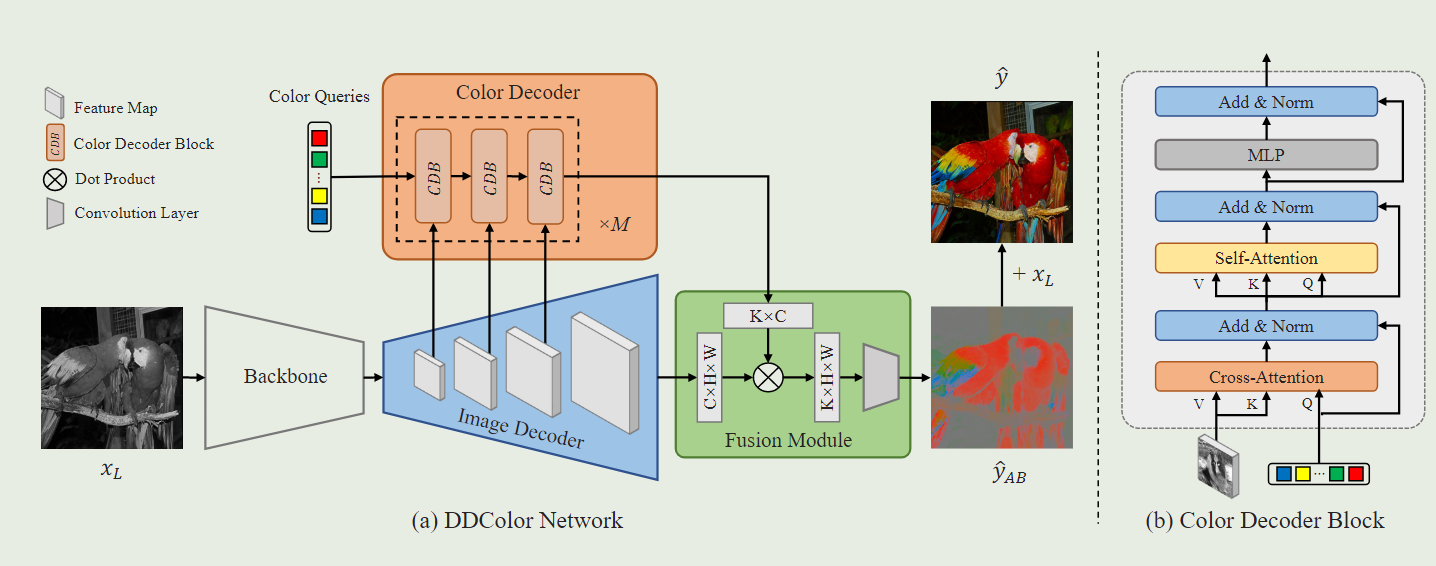

为了使灰度图像XL上色,我们的模型首先使用骨干网络(ConvNeXt)提取其视觉特征。然后将这些特征输入图像解码器,解码器恢复图像的空间结构。

同时,颜色解码器利用图像解码器产生的不同尺度的图像特征学习自适应颜色查询(adaptive color queries)。

融合模块(fusion)将两个解码器产生的图像和颜色特征结合起来,产生色彩生动,语义清晰(vivid and semantic-aware color)的颜色输出。

最后,我们沿着通道维度(channel dimension)将y^AB和xL 串联起来,得到最终的着色结果。

(b)彩色解码器块的结构。以图像特征和**可学习**的颜色查询为输入,通过交叉注意、自注意和前馈操作(feed forward operations)建立语义和颜色表示之间的相关性

具体的:包括一个多尺度(multi-scale) 图像解码器和一个基于transformer的颜色解码器( color decoder)。

前者恢复图像的空间分辨率,而后者通过交叉注意(cross-attention)建立颜色和语义表示之间的相关性。

我们的两个解码器不是使用额外的先验,而是协同工作以利用多尺度图像特征来指导自适应颜色查询的优化,从而显著减轻颜色溢出(color bleeding effects)效果。此外,还引入了一种简单而有效的色彩损失(colorfulness loss),以进一步提高生成结果的颜色丰富度。

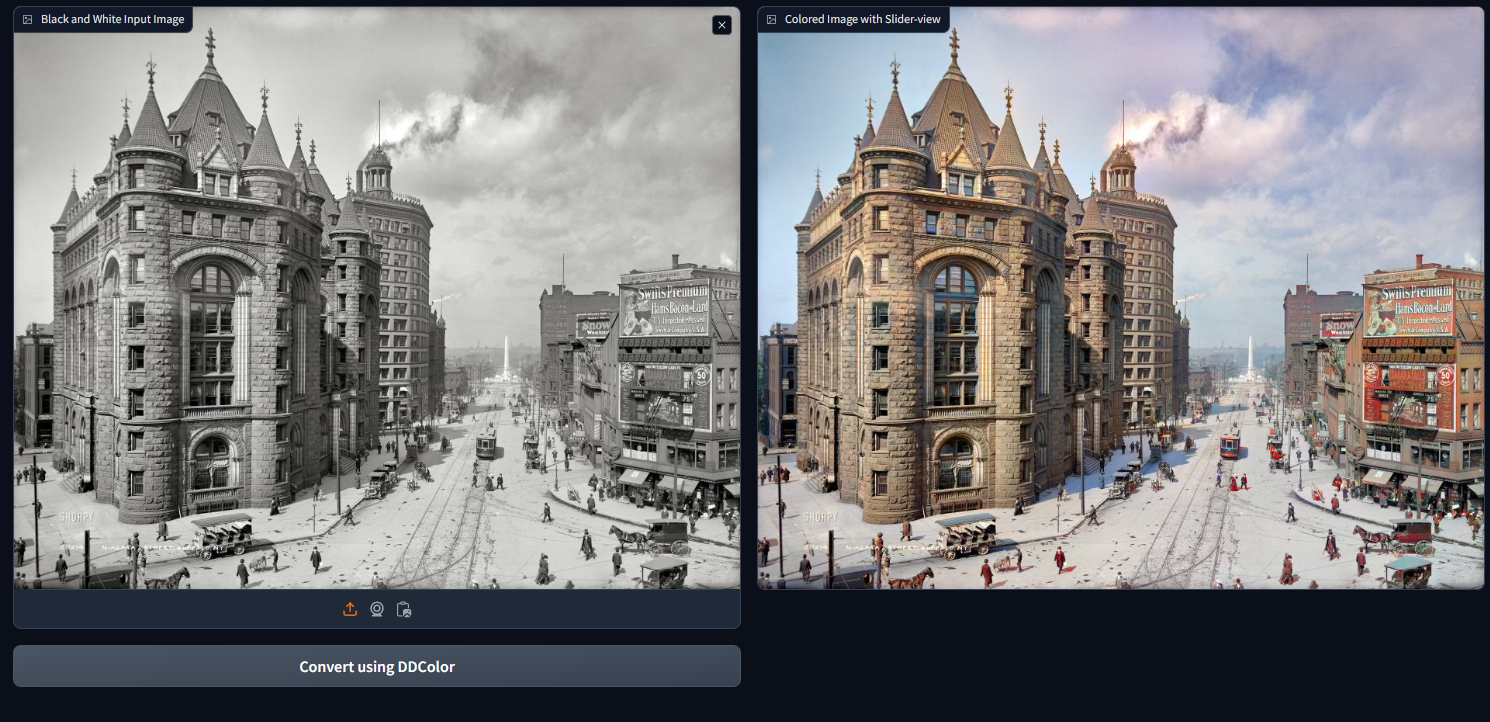

实测

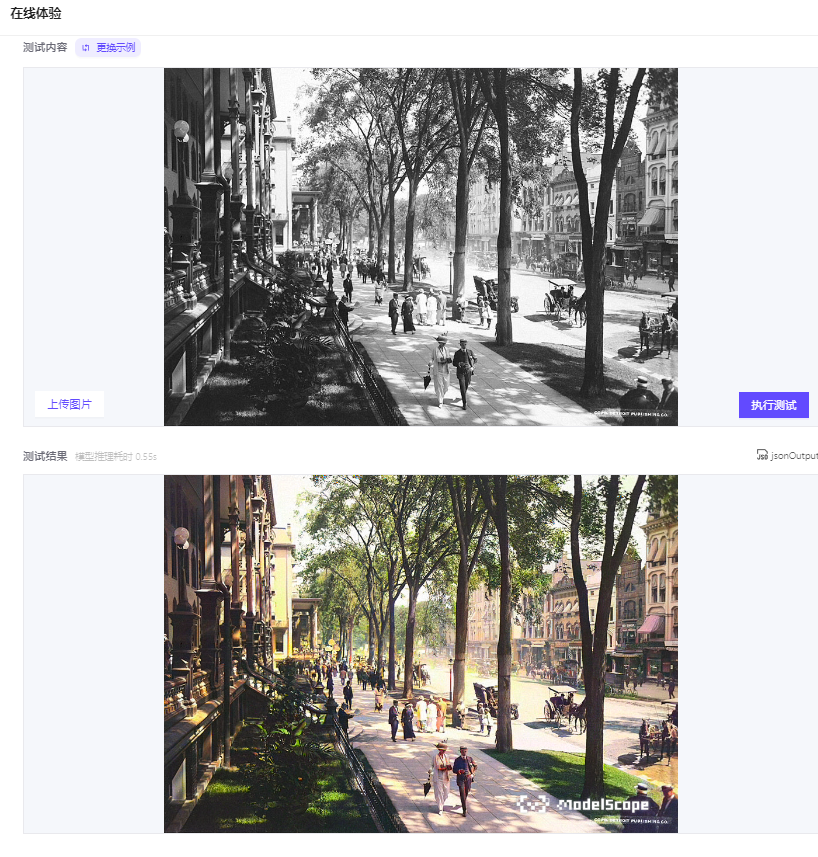

国内阿里demo(打开界面 右侧比较小):

https://www.modelscope.cn/models/iic/cv_ddcolor_image-colorization/summary

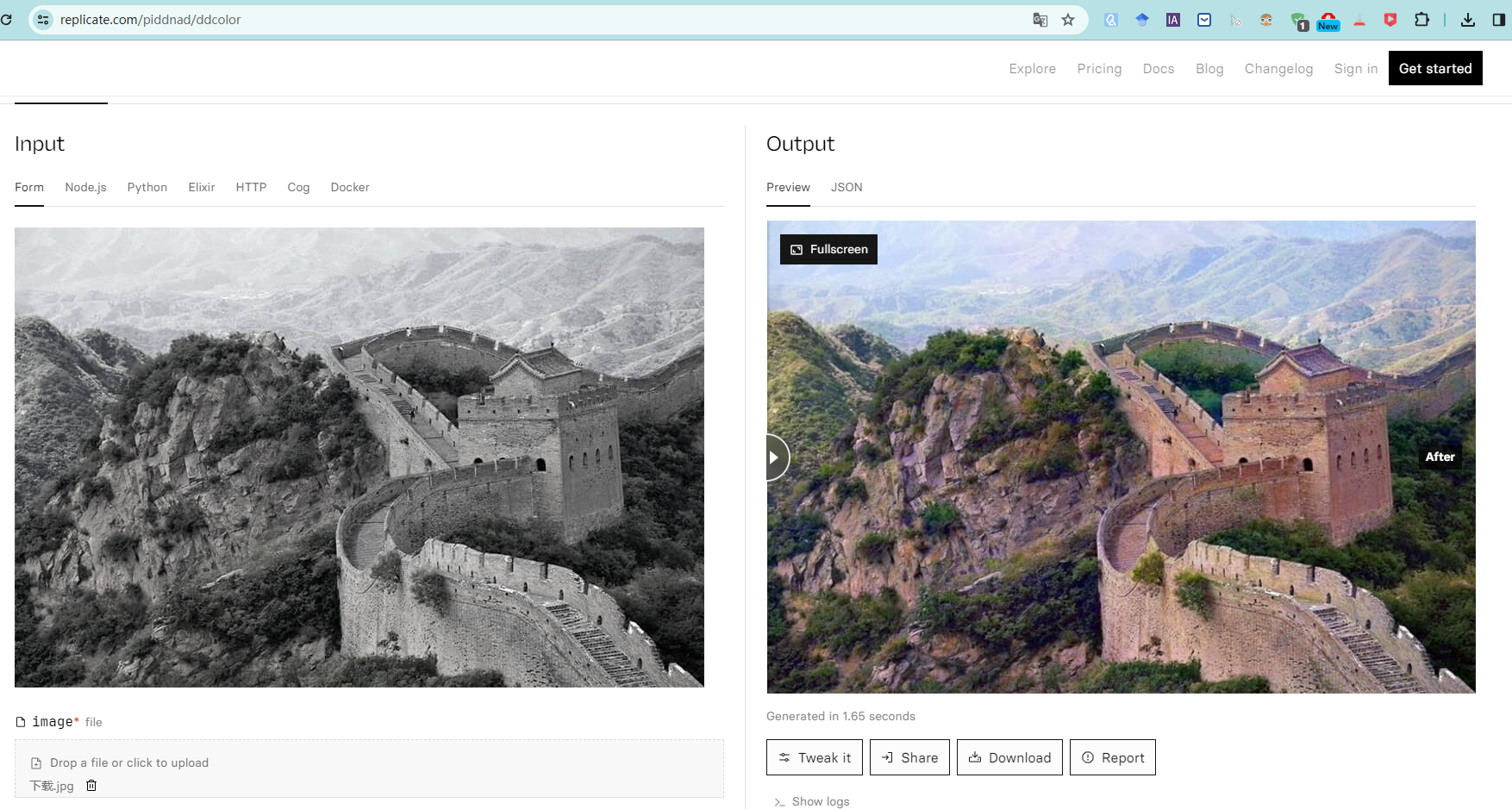

replicate

https://replicate.com/piddnad/ddcolor

本机部署测试

2656

2656

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?