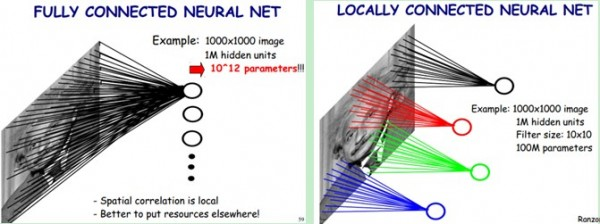

作用:降低参数数目,减少网络运算复杂度。

原理:一般认为人对外界的认知是从局部到全局的,而图像的空间联系也是局部的像素联系较为紧密,而距离较远的像素相关性则较弱。因而,每个神经元其实没有必要对全局图像进行感知,只需要对局部进行感知,然后在更高层将局部的信息综合起来就得到了全局的信息。网络部分连通的思想,也是受启发于生物学里面的视觉系统结构。视觉皮层的神经元就是局部接受信息的(即这些神经元只响应某些特定区域的刺激),这些局部可以称为局部感知野(亦即卷积核)。

卷积神经网络的卷积核大小、卷积层数、每层map个数都是如何确定下来的呢?

参数数量由1000×1000×1M下降为10×10×1M,降低4个数量级。局部连接也被称为“稀疏连接(Sparse Connectivity),但需要注意的是,这里的稀疏连接,仅仅是指卷积核的感知域(10×10)相对于原始图像的高度和宽度(1000×1000)而言的。卷积核的深度(depth)则需要与原始数据保持一致,不能缩减。在这里,卷积核的深度实际上就是卷积核的个数。对于RGB图像而言,如果我们需要在红色、蓝色和绿色等三个通道提取特征,那么卷积核个数就是3)。所以对于隐藏层的某个神经元,它的前向连接个数是由全连接的1000×1000×3个,通过卷积操作,减少到局部连接的到10×10×3个。

注意当卷积核的深度很深时,如100个,则由局部连接带来的参数个数减少量,就要大打折扣。

本文介绍了卷积神经网络中局部连接的重要性及其实现原理。通过采用局部连接而非全连接的方式,大幅度减少了网络中的参数数量,降低了计算复杂度。此外,还详细解释了卷积核大小、卷积层数及每层特征图数量的确定方法。

本文介绍了卷积神经网络中局部连接的重要性及其实现原理。通过采用局部连接而非全连接的方式,大幅度减少了网络中的参数数量,降低了计算复杂度。此外,还详细解释了卷积核大小、卷积层数及每层特征图数量的确定方法。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?