论文地址:LoRA: Low-Rank Adaptation of Large Language Models

LoRA是一种用于adapters和大模型迁移的技术,全称为Low-Rank Adaptation of Large Language Models。它最初主要是用于大型语言模型(LLM)的跨领域与跨语言迁移。在微软的论文《LoRA: Low-Rank Adaptation of Large Language Models》提出了一种低秩adapters学习技术LoRA,实现大规模语言模型的跨领域与跨语言迁移。其主要内容如下:

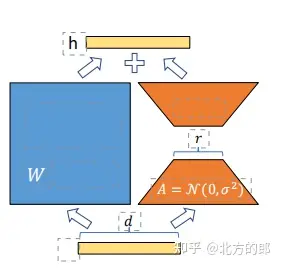

1. 低秩分解:将adapters的参数表示为两个小矩阵U和V的乘积,而不是一个大参数矩阵。这可以显著降低计算复杂度,使adapters可以应用于大语言模型中。

2. 多粒度:提出在词、段落与任务三个粒度学习适配器参数,实现不同粒度的语言变化建模。

3. 异构框架:LoRA可以应用于BERT与GPT等不同结构的transformer模型,实现跨模型的adapters迁移。

4. 无监督学习:使用预测-聚合损失函数进行adapters参数学习,无需额外标注数据。这使得LoRA可以广泛应用于各种downstream任务。

5. 实验结果:在GLUE与XNL

LoRA是一种用于大模型迁移的技术,通过低秩分解减少计算复杂度,实现adapters在大语言模型中的应用。该技术支持多粒度学习、异构框架,并能进行无监督学习,适用于低资源语言处理、跨领域迁移、性别偏倚消除等场景。在StableDiffusion模型中的应用则扩展到多模态语义表示、低资源语言支持、样式迁移和领域适配,增强了模型的灵活性和实用性。

LoRA是一种用于大模型迁移的技术,通过低秩分解减少计算复杂度,实现adapters在大语言模型中的应用。该技术支持多粒度学习、异构框架,并能进行无监督学习,适用于低资源语言处理、跨领域迁移、性别偏倚消除等场景。在StableDiffusion模型中的应用则扩展到多模态语义表示、低资源语言支持、样式迁移和领域适配,增强了模型的灵活性和实用性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2203

2203

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?