摘要

通过neural architecture search的方法提升普通transformer,

速度比普通transformer提升两倍,

效果在机器翻译比普通transformer提升0.7 BLEU

neural architecture search

设计出一些可能的神经网络结构,分别在测试集上评估效果

Search Space

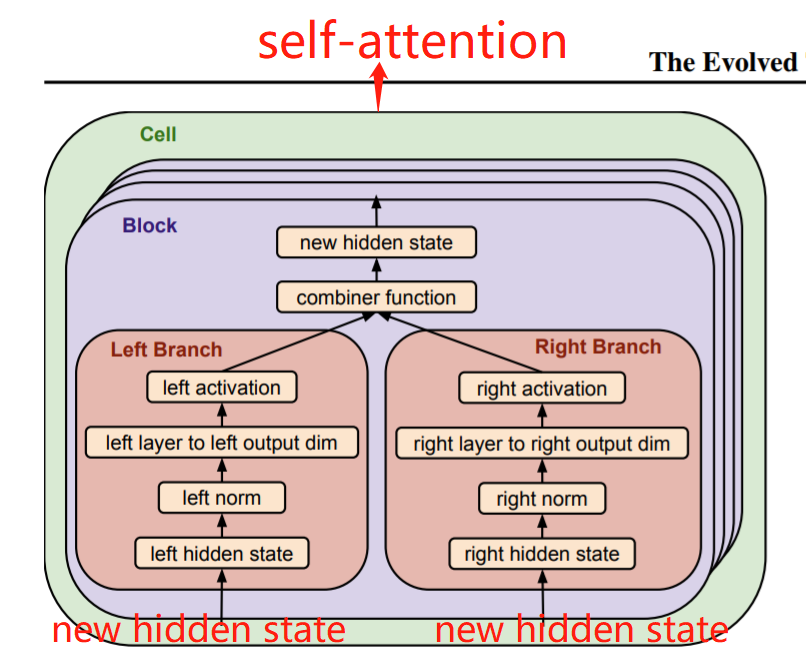

本文搜索空间包括两个stackable cell,一个在transformer模型的encoder,一个在transformer模型的decoder。

每个cell由NASNet-style block组成, 具体通过左右两个block将输入的hidden state转成左右两个hidden state再归并成为一个新的hidden state,作为self-attention的输入。

encoder包括6个block,decoder包括8个block。

block可以由MLP和各种CNN等组成(实际好像还有attention作为layer),里面的normalization, layer, output dimension and activation就是搜索空间

这篇博客探讨了如何通过神经架构搜索(NAS)改进Transformer模型,实现了速度的两倍提升和机器翻译BLEU得分0.7的提高。文章详细介绍了搜索空间,包括在encoder和decoder中的stackable cell设计,每个cell由NASNet-style block组成,包含MLP、CNN等层。最终的优化结构在GitHub上的tensor2tensor库中可找到。

这篇博客探讨了如何通过神经架构搜索(NAS)改进Transformer模型,实现了速度的两倍提升和机器翻译BLEU得分0.7的提高。文章详细介绍了搜索空间,包括在encoder和decoder中的stackable cell设计,每个cell由NASNet-style block组成,包含MLP、CNN等层。最终的优化结构在GitHub上的tensor2tensor库中可找到。

订阅专栏 解锁全文

订阅专栏 解锁全文

2486

2486

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?