我们前面介绍了如何本地部署DeepSeek-R1模型(离线文件分享了,快来抄作业,本地部署一个DeepSeek个人小助理),也对比了不同硬件规格下能支持的模型情况(目前来看,ollama量化过的DeepSeek模型应该就是最具性价比的选择),对一些模型的能力也做了简单测试(简单测试一下DeepSeek和QwQ检索知识库的能力、一道四年级数学题,DeepSeek-R1的32b以下模型全军覆没,视频为证!)。

但是,大家用到了本地部署,应该都绕不过一个本地知识库的问题。

目前综合网上的各种案例,Anything LLM可能是一款比较好用的工具,我们今天来简单试用一下。

0、准备Anything LLM环境

首先,我们下载一个Windows客户端,下载链接如下:

https://anythingllm.com/desktop

完成安装之后,运行程序【开始】使用。

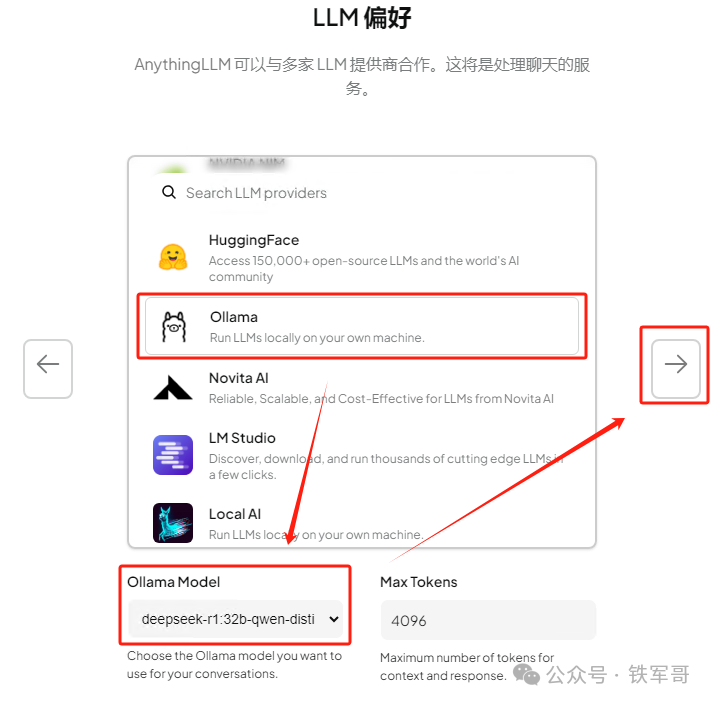

在【LLM偏好】向导页面,根据实际情况选择模型配置,我这里用的ollama,模型有【DeepSeek-R1:32B的INT4量化模型】和【QwQ:32B的INT4量化模型】,今天要对比一下这两款模型,这里我们先选择【deepseek-r1:32b-qwen-distill-q4_K_M】。

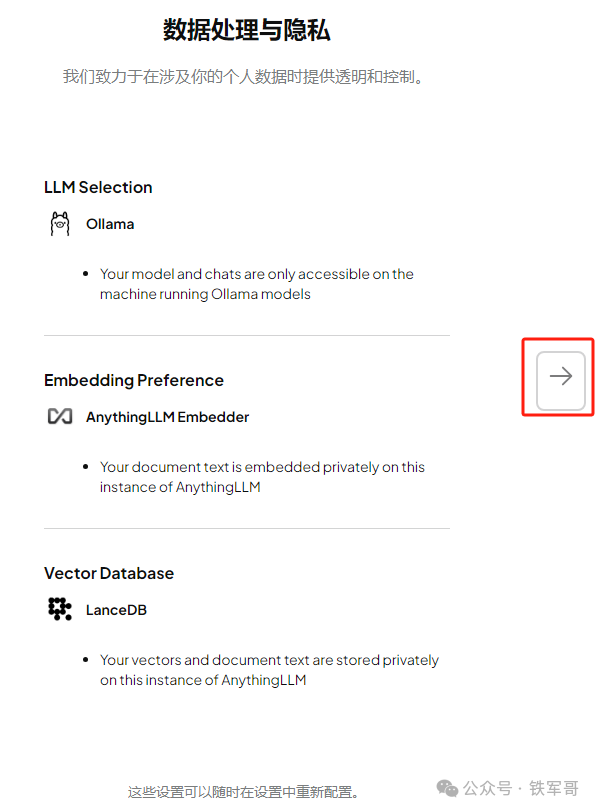

【数据处理与隐私】界面,没有可以配置的项目,直接下一页。

调查界面,既然可以跳过,那我们就【跳过调查】。

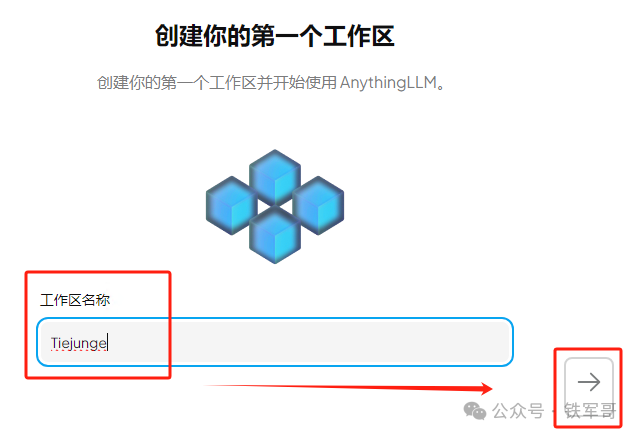

根据提示,输入工作区名称,创建第一个工作区。

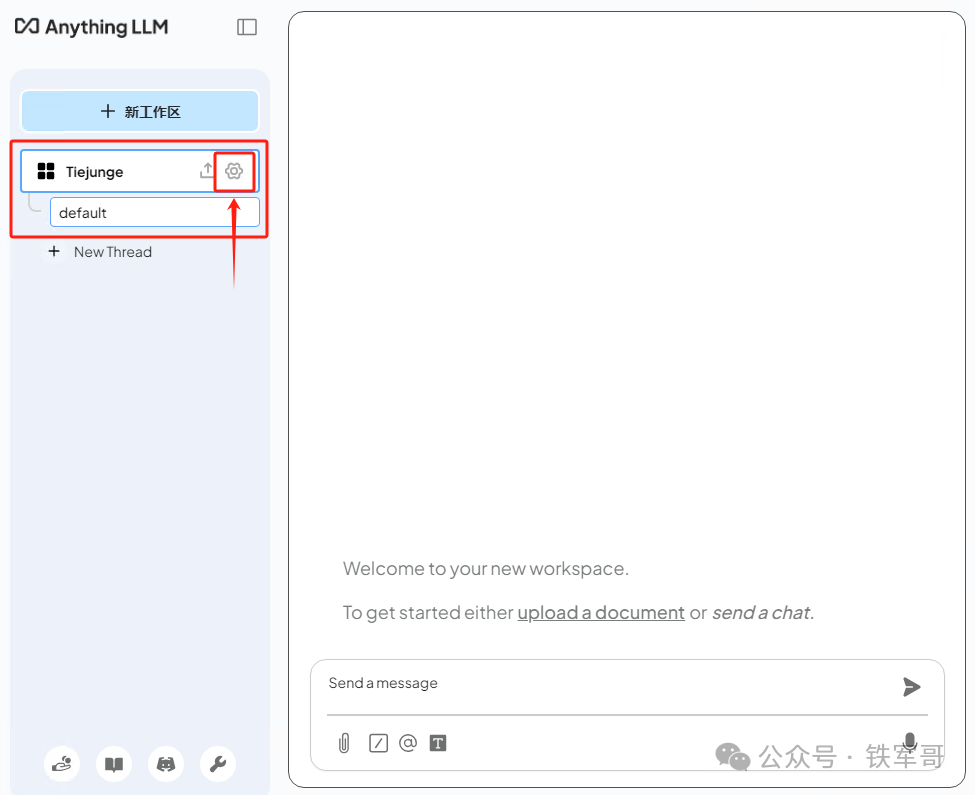

进到对话页面,在工作区旁边有两个按钮,上传按钮是用来配置知识库的,设置按钮是用来配置工作区设置的。

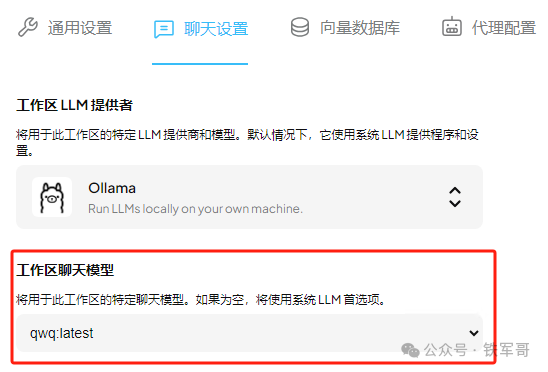

我们先看一下工作区设置,在【聊天设置】页签,上面展示了工作区LLM提供者和工作区模型,后面我们在这里切换QwQ模型。

下面提示聊天模式有【聊天】和【查询】两种模式,其中【聊天】提供“LLM的一般知识”和“找到的文档上下文的答案”,也就是基于模型知识库和用户文档知识库回答;而【查询】仅提供“找到的文档上下文的答案”,不使用内置模型,仅检索用户上传的文档并进行回答。

接下来,我们的测试按照以下步骤将3个问题重复提问6次,每次使用一个新的对话进程:

1、使用DeepSeek-R1:32B的INT4量化模型,选择【聊天】模式,直接提问;

2、使用DeepSeek-R1:32B的INT4量化模型,选择【聊天】模式,上传知识库,再次提问;

3、使用DeepSeek-R1:32B的INT4量化模型,选择【查询】模式,使用知识库再次提问;

4、将模型切换到QwQ:32B的INT4量化模型,选择【聊天】模式,直接提问;

5、使用QwQ:32B的INT4量化模型,选择【聊天】模式,上传知识库,再次提问;

6、使用QwQ:32B的INT4量化模型,选择【查询】模式,使用知识库再次提问。

1、准备测试问题

然后就是问题的选择了,为了能比较详细的命中问题,我选了H3C的SD-WAN配置文档和命令手册作为知识库。

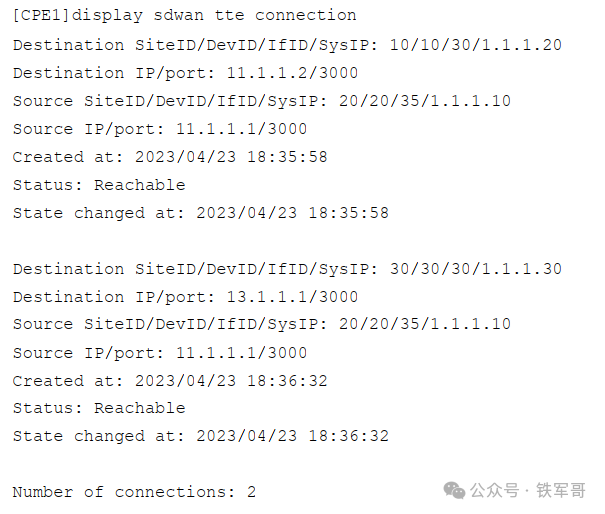

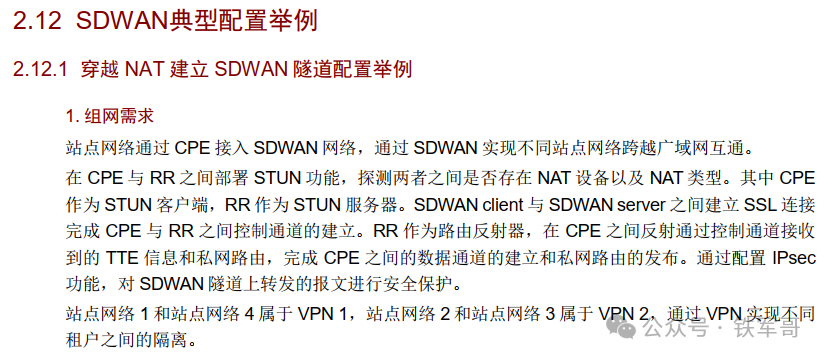

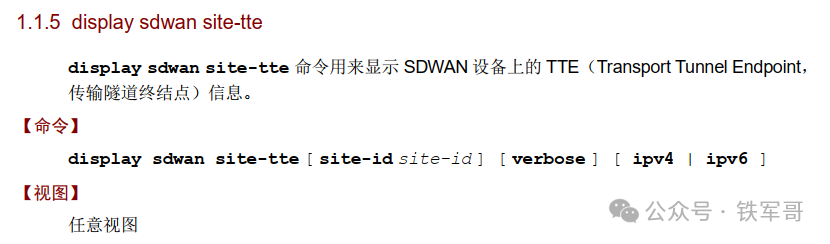

在SD-WAN的官网配置手册中,有两个典型配置案例,分别是“穿越NAT建立SDWAN隧道配置举例”和“按需建立 SDWAN 隧道配置举例”,从实际使用场景来看,穿越NAT建立SDWAN隧道这个配置更贴合一些。在案例的配置验证部分,有一个操作是查看TTE连接,命令及回显如下:

从这里我们就能看出去SD-WAN的配置重点,那么我们的问题也就有了:

1、请介绍一下SD-WAN中的TTE?

参考配置手册的正确解释如下:

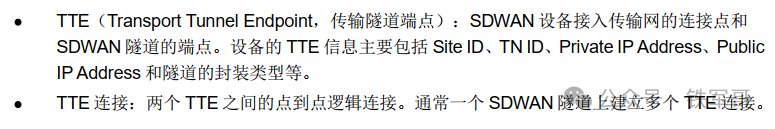

TTE(Transport Tunnel Endpoint,传输隧道端点):SDWAN设备接入传输网的连接点和SDWAN隧道的端点。设备的TTE信息主要包括Site ID、TN ID、Private IP Address、 Public IP Address和隧道的封装类型等。

TTE连接:两个TTE之间的点到点逻辑连接。通常一个SDWAN隧道上建立多个 TTE 连接。

2、如何配置穿越NAT建立SD-WAN隧道?

这个问题可以说和典型配置案例完全匹配,他直接照搬即可。

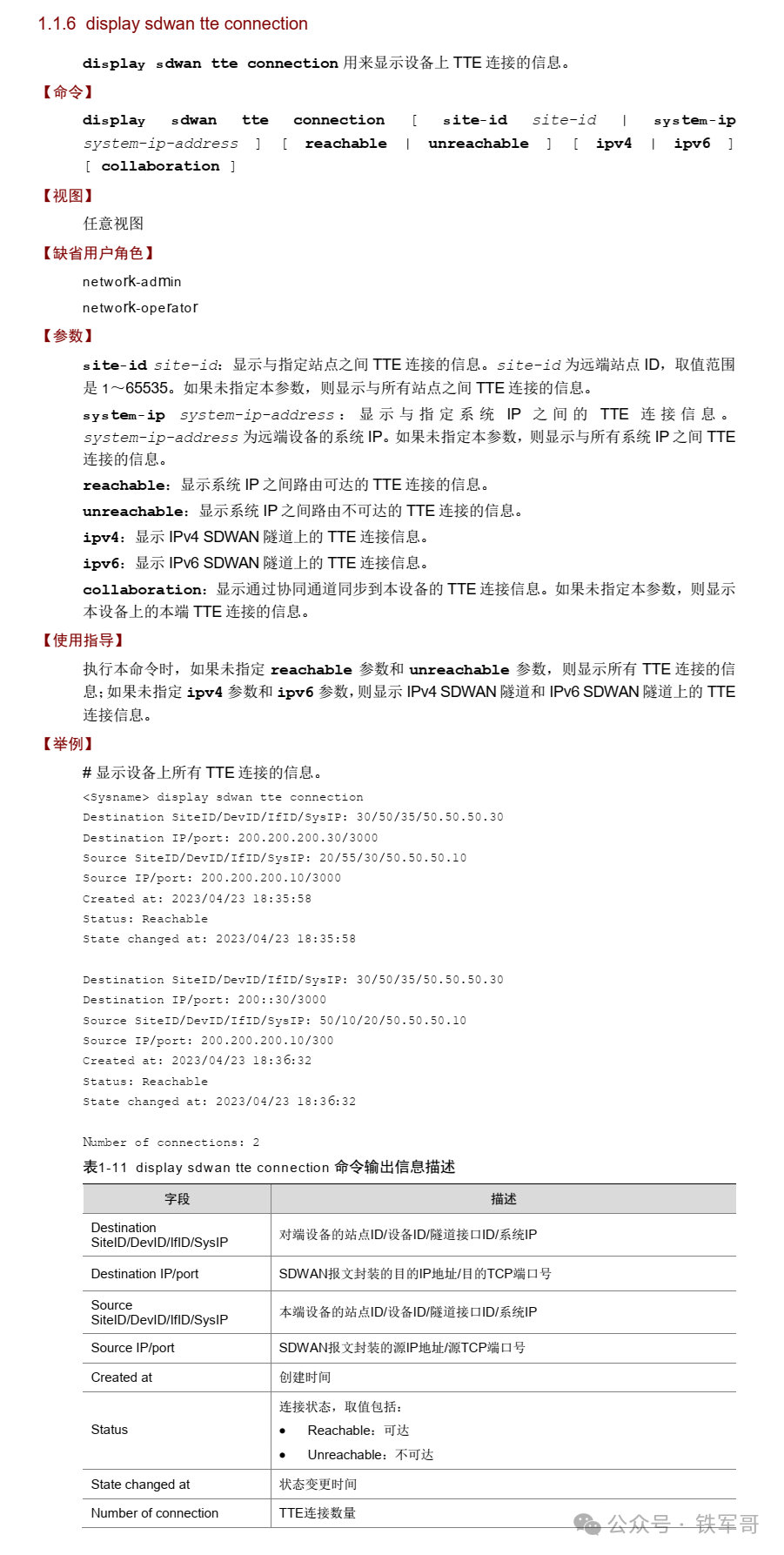

3、请介绍一下display sdwan tte connection命令的作用,以及回显中各参数的含义。

这个问题在配置案例中回显的展示,在命令手册中也有完整的参数解释,应该也没什么难度。

准备工作完成了,我们直接开始测试。

【为节约篇幅,完整的回答请参考另一篇推文(简单测试一下DeepSeek和QwQ检索知识库的能力),本文只做简单的对比分析。】

2、DeepSeek-R1:32B模型直接聊天回答

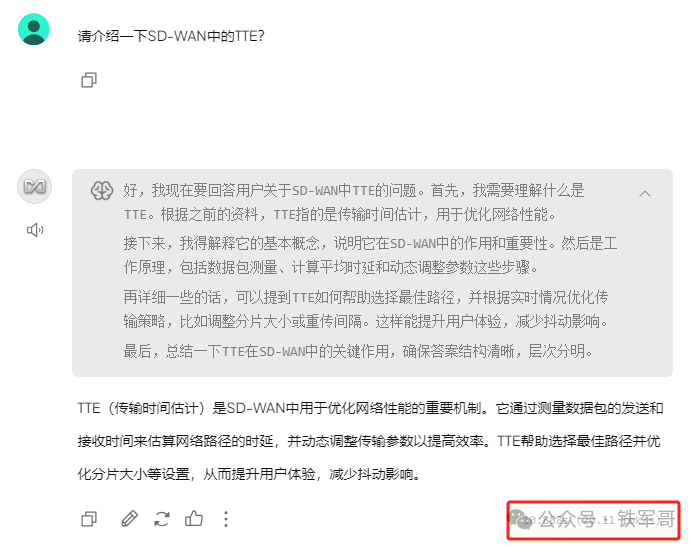

2.1、请介绍一下SD-WAN中的TTE?

在没有语境的情况下,DeepSeek猜测TTE是传输时间估计。

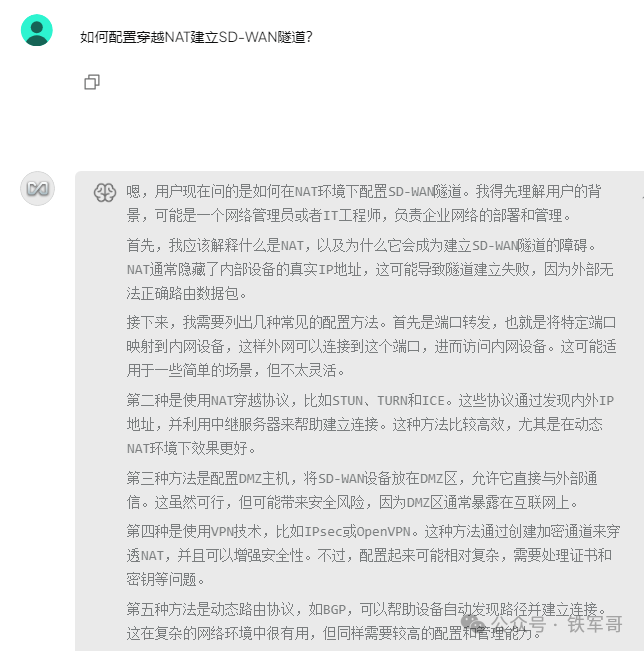

2.2、如何配置穿越NAT建立SD-WAN隧道?

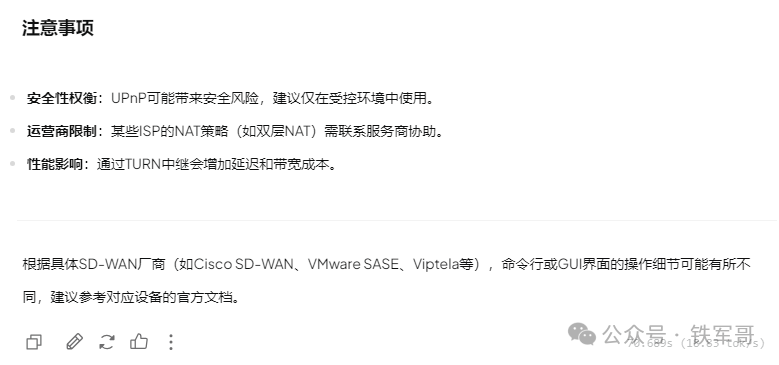

同样的,在没有语境的情况下,DeepSeek按照知识库的储备,给了一篇比较通用的回答。

如果按照这个回答继续追问,没准也能完成一套SD-WAN环境的搭建。

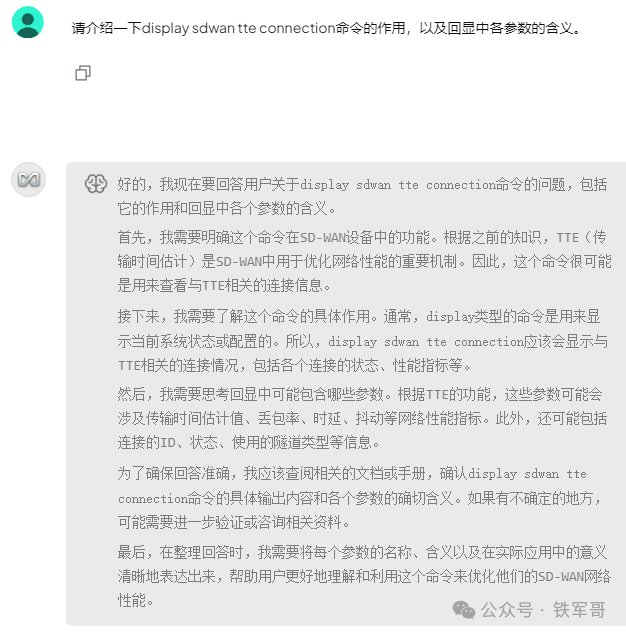

2.3、请介绍一下display sdwan tte connection命令的作用,以及回显中各参数的含义

从这个问题来看,DeepSeek更像是一个开发者,对于一个不存在的命令,他都能按照理解,硬生生地拼接出一个命令应该有的回显信息。

还对相关参数做了详细介绍。

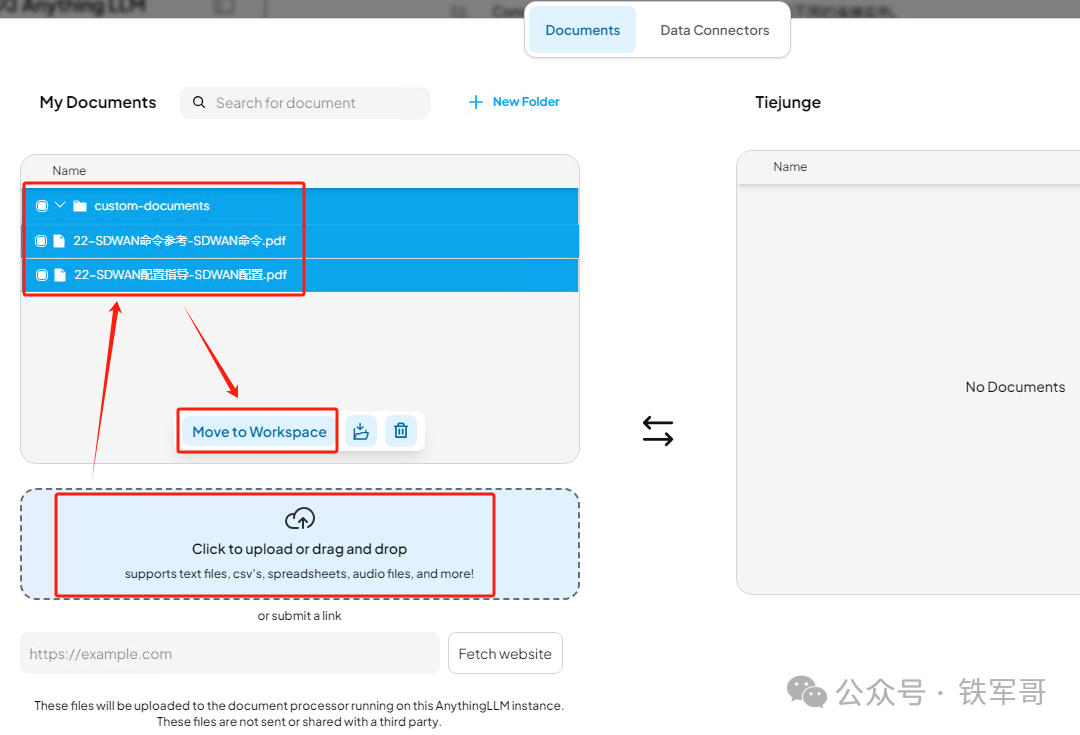

3、上传知识库

在没有知识库的情况下,DeepSeek答的有点天马行空,接下来我们点击工作区旁边的上传按钮,上传提前下载好的配置手册和命令手册;上传完成后,选中所有文件,点击【Move to WorkSpace】准备加载到工作区。

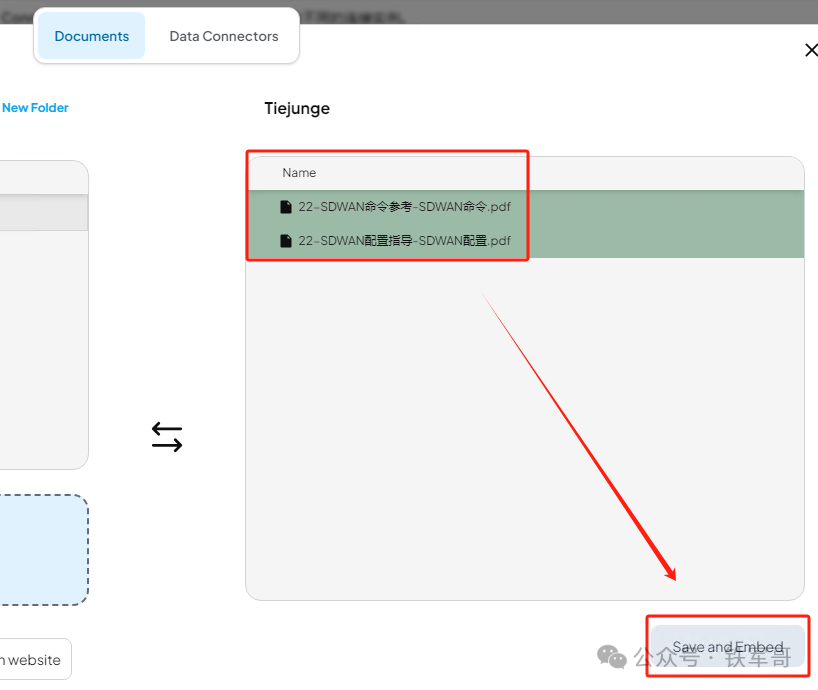

此时右边的工作空间已经显示了文档列表,但是我们还要再次选中文档,然后点击【Save and Embed】应用知识库。

知识库加载完成的状态如下图所示:

4、DeepSeek-R1:32B模型检索知识库聊天回答

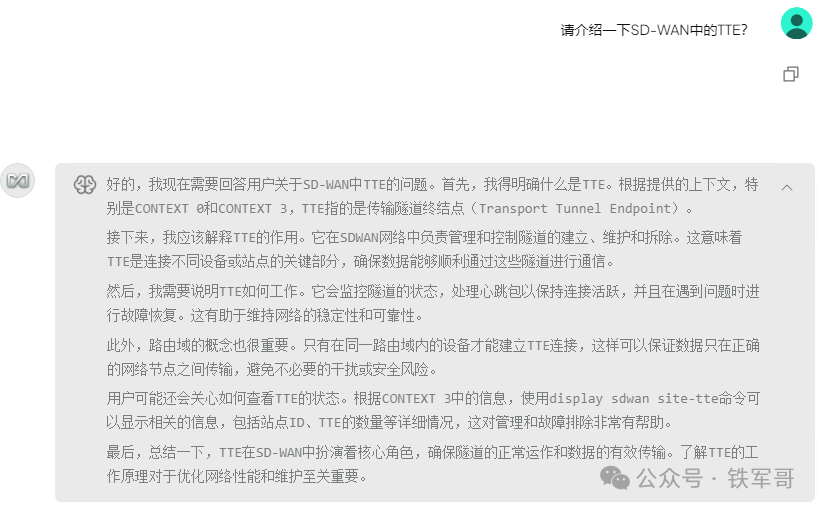

4.1、请介绍一下SD-WAN中的TTE?

两份文档一共99页,经过短暂的搜索之后,DeepSeek就找到了答案,还检索了相关概念。

这才第一个问题,他就把后面问题回答了一部分了,一下子就见多识广了。

4.2、如何配置穿越NAT建立SD-WAN隧道?

回答这个问题,我觉得他直接把配置案例贴出来都行。

但是它自己进行了二次加工,还是融合了部分详细配置和自带数据库的内容,和手册中的配置案例相比,步骤缺失、关键命令缺失,还原度感觉不足20%,按照他的回答完全配不起来。

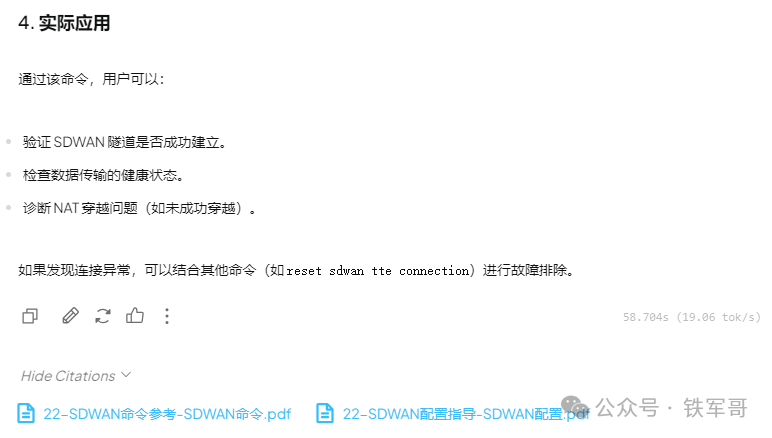

4.3、请介绍一下display sdwan tte connection命令的作用,以及回显中各参数的含义

我认为这个问题只要把命令手册的那一段贴出来就可以了,但是他在思考过程中把TTE的概念给换掉了,还出现了一些不属于这个命令的字段,比如Device ID、Interface ID、Connection Status、Tunnel Type等等。

最终,答案还是跑偏了,他甚至自己编了一个不存在的回显出来。

5、修改聊天模式为查询

如我们前面所看到的,在【聊天设置】页签,将聊天模式从【聊天】切换为【查询】,限制模型仅提供“找到的文档上下文的答案”,不使用内置模型,仅检索用户上传的文档并进行回答。

修改完记得下拉页面,点击底部的【Update WorkSpace】更新配置。

6、DeepSeek-R1:32模型检索知识库查询回答

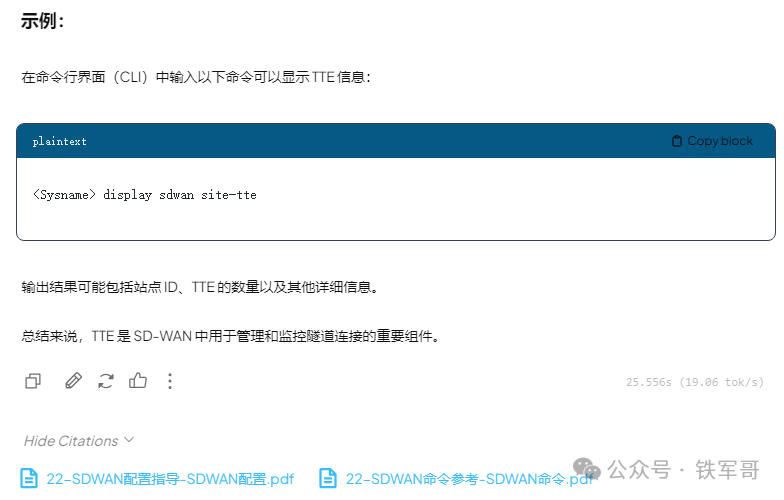

6.1、请介绍一下SD-WAN中的TTE?

聊天模式切换为【查询】之后,回答的输出减少了一半,没有那么发散了。

他还给出了一个显示TTE信息的命令,与命令手册的信息基本匹配。

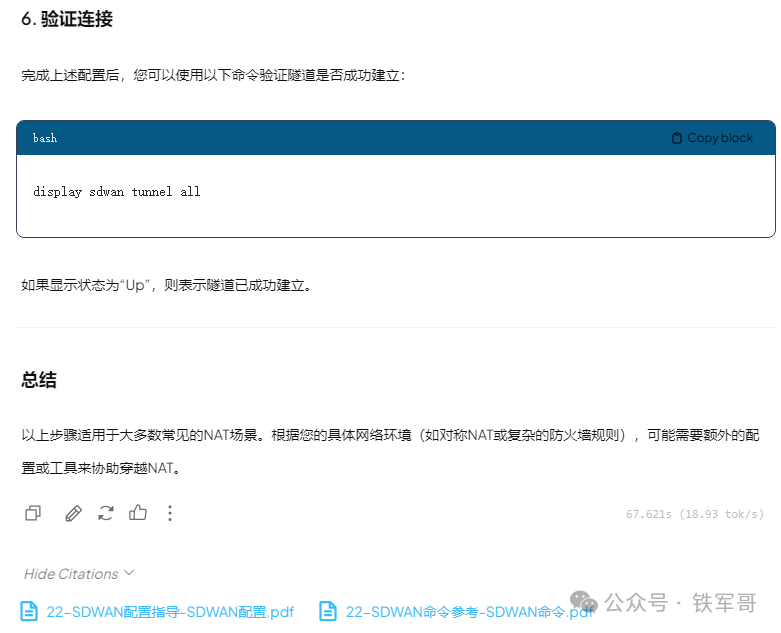

6.2、如何配置穿越NAT建立SD-WAN隧道?

跟聊天模式类似,但是准确性有所提高,它自己又进行了二次加工,和手册中的配置案例相比,还是存在步骤缺失、关键命令缺失等问题,还原度稍微高了一点,但感觉也不足30%,按照他的回答也是配不起来。

6.3、请介绍一下display sdwan tte connection命令的作用,以及回显中各参数的含义

跟聊天模式类似,对话过程中缺少上下文语境,在思考过程中又把TTE的概念给换掉了,同样出现了一些不属于这个命令的字段,比如Device ID、Interface ID、Connection Status、Tunnel Type等等,也编了一个不存在的回显出来。

7、切换模型

接下来,我们在【聊天设置】页签中,将工作区聊天模型切换为QwQ。

8、QwQ:32B模型直接聊天回答

8.1、请介绍一下SD-WAN中的TTE?

虽然QwQ的回答更长,但很显然,他的知识库里面也没有H3C的这个概念。

8.2、如何配置穿越NAT建立SD-WAN隧道?

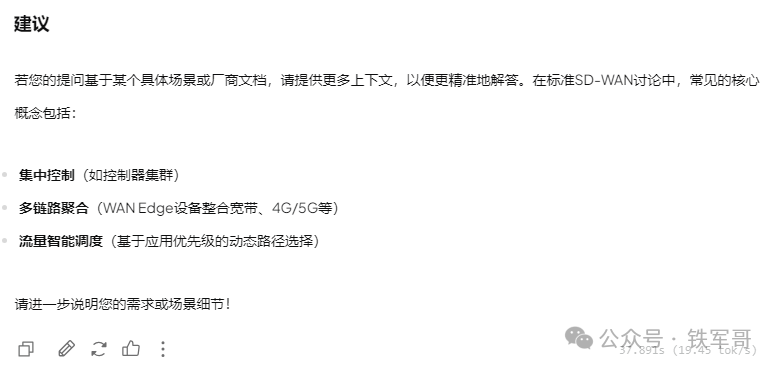

相比之下,QwQ的回答更为丰富,并且给出了各步骤中的配置命令示例。不过,这些命令没有介绍使用环境,貌似来自于不同的厂商或系统,看似丰富,实则参考价值不大。

8.3、请介绍一下display sdwan tte connection命令的作用,以及回显中各参数的含义

该说不说,QwQ比DeepSeek更强,对于一个不存在的命令,他几乎完整的设计除了一个命令应该有的回显信息,并且限定了各参数的数据范围,还用了图表,回答的信息长度接近DeepSeek的两倍。

9、QwQ:32B模型检索知识库聊天回答

9.1、请介绍一下SD-WAN中的TTE?

同样的,QwQ比DeepSeek的回答更丰富,从作用、关键概念、关联配置与监控和可能出现的使用问题等方面展开了详细介绍,回答角度更丰富,内容也更详实。

9.2、如何配置穿越NAT建立SD-WAN隧道?

从配置来看,QwQ给出了一些关键的配置命令,但是,很遗憾,这些命令都不是H3C的配置命令,估计是跟他的知识库混杂了。

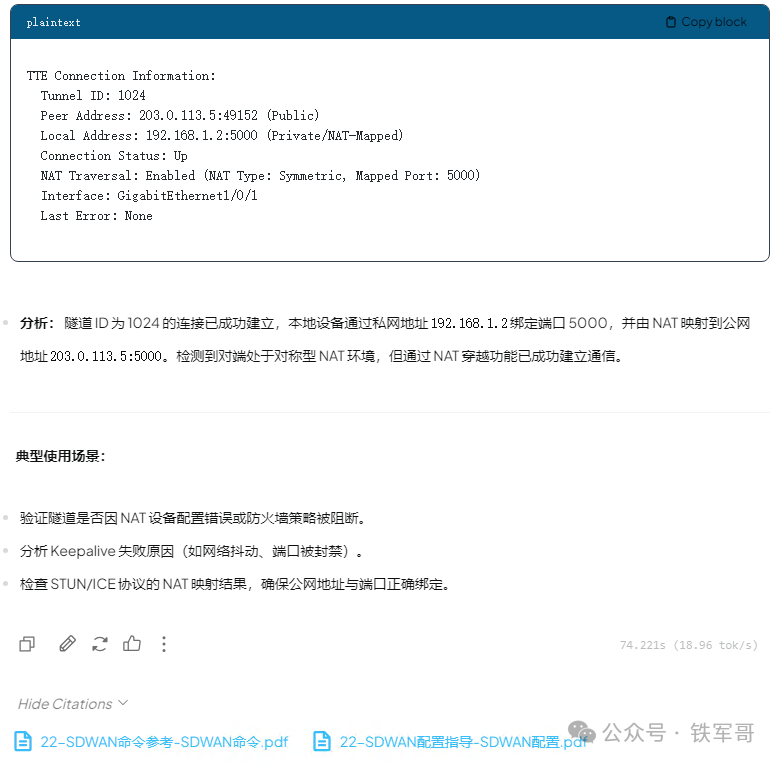

9.3、请介绍一下display sdwan tte connection命令的作用,以及回显中各参数的含义

从QwQ的思考过程中可以看到,他说文档中没有直接提到display sdwan tte connection的详细说明,并且猜测这条命令属于HUAWEI设备。他猜测该命令是 SDWAN 网络运维中诊断隧道连接问题的核心工具,在知识库有完成信息的情况下,他还是完整的杜撰了一个回显出来。

10、QwQ:32B模型检索知识库查询回答

10.1、请介绍一下SD-WAN中的TTE?

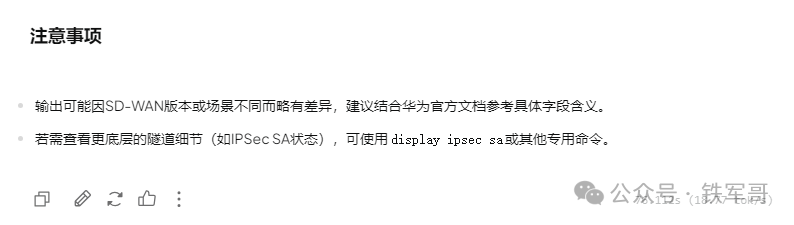

在限制了QwQ使用查询模式之后,回答结果的发散程度明显降低,回答中提供的命令也没有超出文档的范围。

10.2、如何配置穿越NAT建立SD-WAN隧道?

虽然限制QwQ使用仅查询模式,但在这一步它又发散了,通过文档中的display命令,他猜测这是HUAWEI的配置文档,并且直接将设备名称换成了HUAWEI。在设备的配置示例中,虽然有正确的命令,但是存在视图错误的情况;当然,也有他自己编纂的命令混杂其中。

10.3、请介绍一下display sdwan tte connection命令的作用,以及回显中各参数的含义

到这里,查询模式已经限制不住QwQ的思维了,三次回答给出了三个不同的命令回显,他这思维是真的发散。如果没有看过命令手册,一般人还真分不出来哪个是对的;但看过命令手册,你就知道了,没有一个是对的!

但是,我在HUAWEI官网搜索相关文档资料,完全没有搜索到TTE相关的概念,QwQ怎么就非得抓住HUAWEI不放呢?

11、总结

从回答的输出速度来看,DeepSeek的9次回答平均输出速率为19.256 tok/s,QwQ为19.044,DeepSeek稍微快一点点。从回答长度来看,DeepSeek的9次回答平均输出长度为863.5 token,QwQ为1250 token,QwQ输出长度超出DeepSeek 45%;9次回答中,DeepSeek回答长度超过QwQ的情况仅出现1次。

但是从回答准确性来看,QwQ貌似更容易发散,但两者的回答准确性都有些差强人意。本次测试仅仅使用了两个文档,如果文档数量更多,估计只能得到shit一样的回答了。

***推荐阅读***

DeepSeek-R1内卷把自己卷死了,QwQ模型的优势凸显出来了

目前来看,ollama量化过的DeepSeek模型应该就是最具性价比的选择

哪怕用笔记本的4070显卡运行DeepSeek,都要比128核的CPU快得多!

帮你省20块!仅需2条命令即可通过Ollama本地部署DeepSeek-R1模型

离线文件分享了,快来抄作业,本地部署一个DeepSeek个人小助理

Ubuntu使用Tesla P4配置Anaconda+CUDA+PyTorch

没有图形界面,如何快速部署一个Ubuntu 24.10的Server虚拟机

使用openVPN对比AES和SM4加密算法性能,国密好像也没那么差

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?