引言

在机器学习领域,回归分析是一个重要的任务,用于预测连续的输出值。高斯过程回归(Gaussian Process Regression, GPR)是一种非参数化的贝叶斯方法,广泛应用于时间序列预测、函数逼近和不确定性估计。本文将从基础概念入手,逐步介绍高斯过程回归的原理、实现和应用。

1. 什么是高斯过程?

高斯过程(Gaussian Process, GP)是一种概率模型,用于描述一组随机变量的分布。它定义了一个函数空间,其中任意有限个点的联合分布是一个多元高斯分布。高斯过程的核心是核函数(Kernel Function),它定义了输入点之间的相似性。

核函数的作用:

-

核函数 k(x,x′) 表示输入点 x 和 x′ 之间的相似性。

-

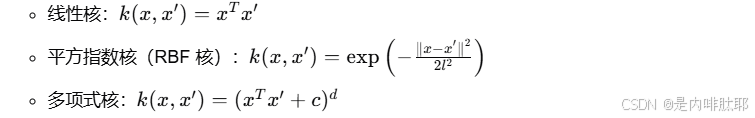

常用的核函数包括线性核、平方指数核(RBF 核)和多项式核。

2. 高斯过程回归的基本原理

高斯过程回归的核心思想是:给定一组训练数据,假设这些数据是由某个高斯过程生成的。通过贝叶斯推断,我们可以计算出测试点的后验分布,从而得到预测值及其不确定性。

关键步骤:

-

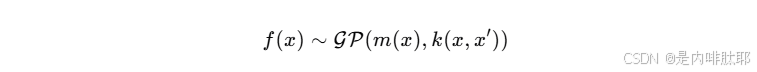

定义先验分布: 假设函数 f(x) 服从高斯过程分布:

其中 m(x) 是均值函数(通常为 0),k(x,x′) 是核函数。

其中 m(x) 是均值函数(通常为 0),k(x,x′) 是核函数。 -

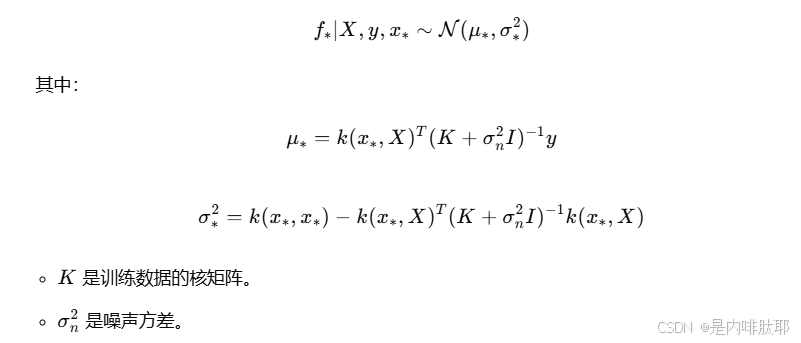

计算后验分布: 给定训练数据 {X,y},测试点 x∗ 的后验分布为:

-

预测与不确定性: 后验分布的均值 μ∗ 是预测值,方差 σ∗2 表示预测的不确定性。

3. 高斯过程回归的实现

高斯过程回归的实现主要依赖于核函数的选择和超参数的优化。以下是实现的关键步骤:

-

选择核函数: 常用的核函数包括:

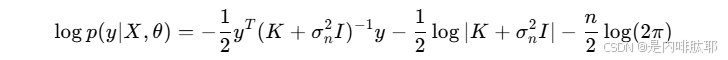

- 优化超参数: 核函数的超参数(如 l 和 σn2)可以通过最大化对数似然函数来优化:

-

预测: 使用优化后的超参数,计算测试点的后验分布,得到预测值和不确定性。

4. 高斯过程回归的应用

高斯过程回归在以下领域有广泛应用:

-

时间序列预测: 用于预测股票价格、气象数据等。

-

函数逼近: 用于拟合复杂函数,特别是在数据量较少的情况下。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1962

1962

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?