曾经火爆一时、激活码炒到天价的 Manus,现在只需要几十行代码就能在你的电脑上复刻,你敢信吗?

没错,这就是 LangChain 1.0 最新架构下的 DeepAgents 框架能带来的降维打击。伴随着国产之光 DeepSeek-v3.2 模型的发布,咱们@木羽Cheny 老师第一时间深度评测了它结合 DeepAgents 搭建复杂智能体系统的表现。结果非常惊喜:响应极快、逻辑缜密,而且非常省钱,完全具备了企业级落地的能力!

无论是需要查阅数百篇文献的全自动市场调研与研报生成,还是涉及几十个文件读写的自动化代码重构,甚至是企业内部复杂的业务流程智能编排,它都能轻松搞定。

这套系统的项目源码➕图文课件➕讲解视频已经整理好啦,伙伴们扫描下方二维码即可领取~

01 DeepAgents 是什么?

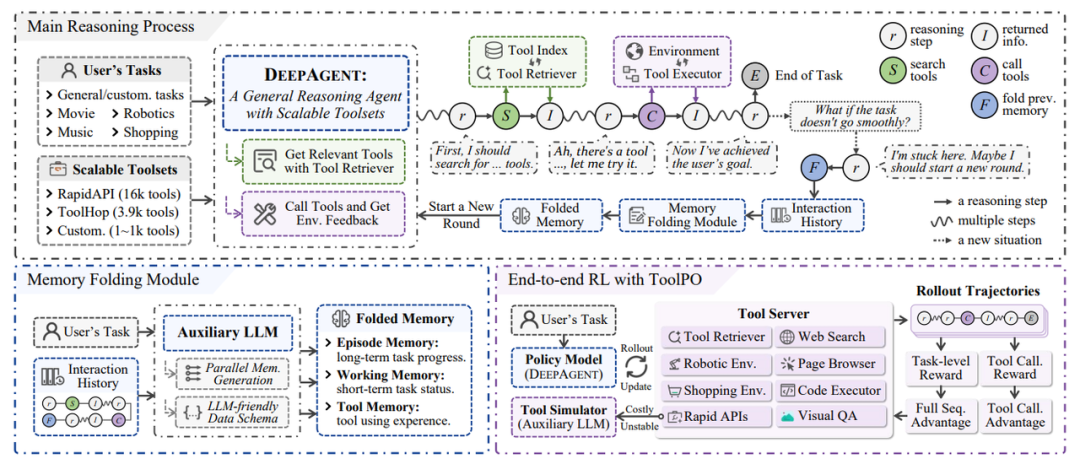

DeepAgents的核心定位就是:用于构建能够处理复杂、多步骤任务的智能体框架。根据官方的说明,它的设计灵感就来自于像 Claude Code、Deep Research 和 Manus 这样的应用。

同时,随着推理类大模型的性能提升以及 MCP 协议的普及,LangChain 对 deepagents 进行一次彻底的架构升级,以适应更复杂的企业级需求,并于 2025 年 10 月 28 日,LangChain 官方博客发布了题为《Doubling down on deepagents》的重磅文章,正式推出 v0.2 版本 。

这次升级的核心在于引入了插件式后端。在此之前,代理的“记忆”和“文件”仅存在于 LangGraph 的状态(State)中,一旦会话结束或系统崩溃,数据即告丢失。v0.2 版本打破了这一限制,允许开发者将后端映射到真实的本地磁盘、S3 云存储或任何自定义的数据库中。这一变革使得 DeepAgents 从一个单纯的对话机器人,进化为一个能够真正操作物理世界数据、具有持久化生命周期的“数字员工” 。

根据官方的说明, DeepAgents 非常适用于以下情况:

-

处理需要计划和分解的复杂、多步骤任务;

-

通过文件系统工具管理大量上下文信息;

-

将工作委派给专门的子代理以实现上下文隔离;

-

在对话和主题之间保持记忆;

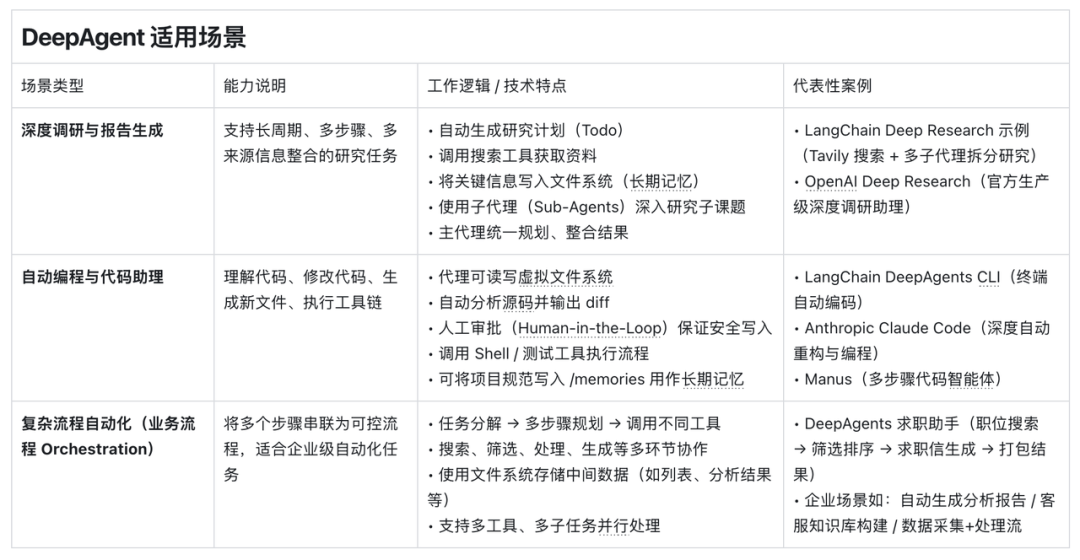

当然这个描述相对来说比较抽象,因此我们这里对适用于DeepAgents的场景进行一个总结:

技术架构虽然复杂,但是使用起来非常简单,只需要定义好代理的规划和执行流程,然后调用 DeepAgents 的 API 即可。如下伪代码所示:

import os

from deepagents import create_deep_agent

from tavily import TavilyClient

# 1. 定义工具

tavily_client = TavilyClient(api_key=os.environ)

def internet_search(query: str):

"""运行网络搜索"""

return tavily_client.search(query)

# 2. 定义系统提示词

# 注意:不需要手动添加关于 TodoList 或文件系统的指令,中间件会自动注入

system_prompt = """

你是一个专家级的研究助理。你的任务是进行彻底的调研并撰写报告。

请充分利用你的规划能力和文件系统来管理你的工作。

"""

# 3. 创建代理

# create_deep_agent 会自动装配 TodoListMiddleware, FilesystemMiddleware 等

agent = create_deep_agent(

model="anthropic:claude-3-5-sonnet-latest",

tools=[internet_search],

system_prompt=system_prompt,

)

# 4. 运行代理

# 代理现在是一个编译好的 LangGraph StateGraph

result = agent.invoke({

"messages": [{"role": "user", "content": "详细调研 LangChain 的最新发展并写一份总结。"}]

})

DeepAgents 不仅是一个软件库,更代表了一种全新的软件范式,它标志着代理构建方式的根本转变:从简单的循环脚本转向基于复杂的代理线束架构。这是一种高度标准化的基础设施,旨在为大语言模型提供执行长时程任务所需的认知脚手架。

02 DeepAgents 的架构设计

DeepAgents 与 LangChian、LangGraph 的关系

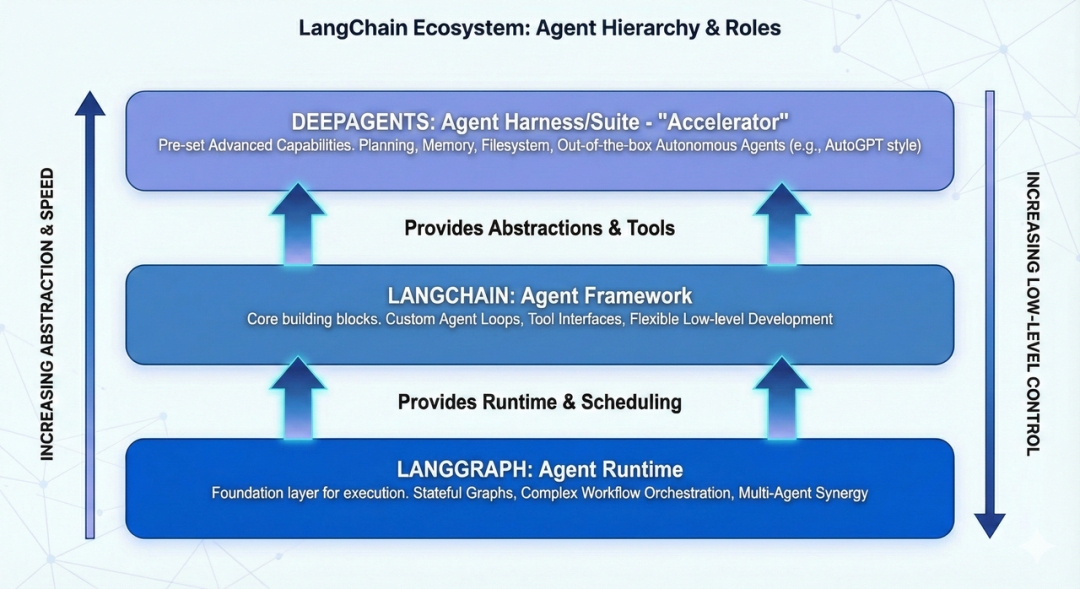

DeepAgent一个构建在 LangChain 和 LangGraph 之上的开源智能体框架(agent harness),将规划工具、文件系统访问、子代理和详细提示词等关键机制整合在一起,以支持复杂的深度任务。所以可以理解为:LangChain、LangGraph 和 DeepAgents 三者构成了 LangChain 生态中不同层次的组件,各有定位。

简单来说,它们按层次构建于彼此之上:DeepAgents 基于 LangChain 的代理抽象实现,而 LangChain 又构建在 LangGraph 的运行时之上。LangChain 团队将它们分别称作“代理框架”(LangChain)、“代理运行时”(LangGraph)和“代理套件/骨架”(DeepAgents):

下表总结了三者的关系和侧重点:

注意:DeepAgents构建的是基于LangGraph的图结构!!

从技术定位上看,如果只需要基础的 Agent 功能并愿意自己设计提示和工具,可以直接使用 LangChain;如果需要构建复杂的多Agent系统或工作流,LangGraph 提供了底层支持;而 DeepAgents 则面向想要省却底层搭建,直接使用现有深度机制来打造 AutoGPT 类自主智能体的需求。因此,DeepAgents 可以被视为在 LangChain 上封装的一层“加速器”:它并非取代 LangChain 或 LangGraph,而是利用它们提供的抽象和运行时,将深度代理常用模式做成开箱即用的组件。

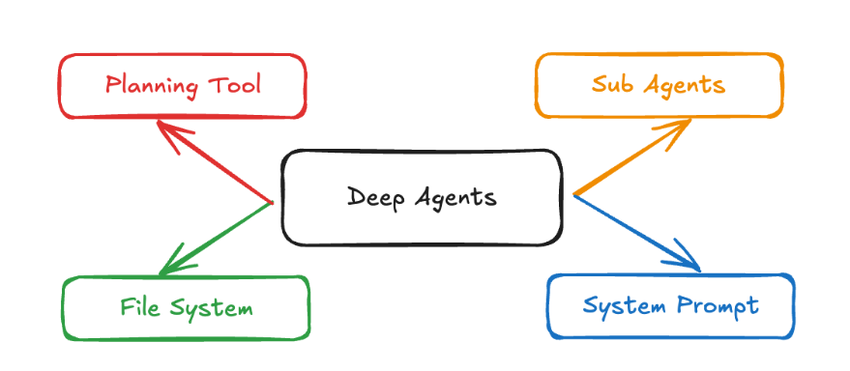

DeepAgents 引入的四大核心机制:

-

红色代表“规划工具”(Todo 清单);

-

绿色代表“文件系统”(虚拟磁盘);

-

橙色代表“子代理”(子任务智能体);

-

蓝色代表“详细系统提示”。

这些组件共同赋能代理处理长时序、复杂多步骤的任务,其核心架构组成如图所示:

03 DeepAgents 构建AI深度代理开发实战

上面给大家讲解了一些基础的新Agent框架介绍,完整项目内容我们还会带大家构建了一个具备实时联网检索能力的 DeepAgents 研究智能体~同时使用 LangGraph Studio 进行可视化!

由于整个项目包含3个课件,上万的字数,

现已将代码体系整理,大家扫码加入【赋范大模型技术社区】即可免费领取完整的【课件代码+讲解视频】~

我们也在持续为大家开源更多企业级落地的大模型实战项目,欢迎扫码加入社区,来和我们链接吧~

780

780

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?