神经网络的实现

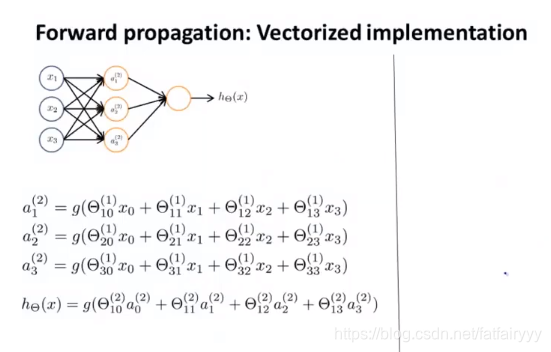

计算出假设函数hθ(x)的步骤是通过左边的这些王芳计算出三个隐藏单元的激活值,然后利用这些值来计算最终的输出hθ(x)。

接下来,为上述方程中的表达式赋予新的符号,以第一项为例。

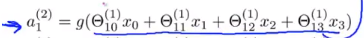

将sigmoid函数中的项表示为z(2)1,其中,上标(2)表示第二层,即神经网络中的隐藏层,对应下图👇。

故,新的表达式为:a1(2) = g( z1(2) ),以此类推,对2和3进行相同操作。

- 如何进行向量化?

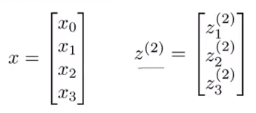

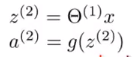

x定义为四维向量,其中x0仍为1,而向量z定义为三维向量,由z1,z2,z3组成。通过向量化,经过下面的两部计算👇。

(如果将第一层输入层也看做隐藏层,那么z(2) = Θ(1)*a(1))

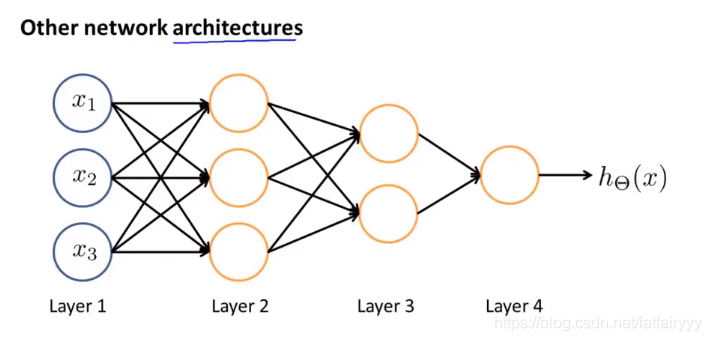

另外,得到hθ(x)还需要a0(2),而如上一篇博文所述,a0存在于偏置单元中,因此,我们需要加入:

这样,a(2)成为了四维向量,因为加入了a0(2) = 1。hθ(x)也可计算而出。如上所述的步骤称为前向传播,即由输入层输入,向前传播给隐藏层,计算出隐藏层的激活项之后继续向前传播直至计算出输出层的激活项。

通过前向传播理解神经网络

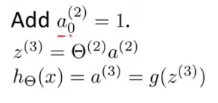

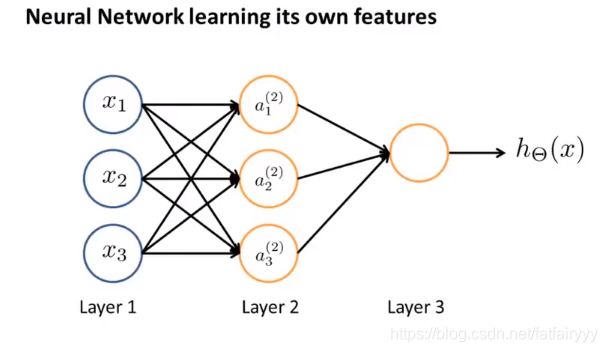

如上图👆所示有这样一个神经网络,暂时盖住图潘左边的部分,即输入层。

观察图中的剩余部分,像一个逻辑回归,即用Layer 3的节点(逻辑回归单元)来预测h(x)的值,但输入逻辑回归的值是通过隐藏层计算的这些数值,即,它不是用x1,x2和x3作为特征量,而是用a1,a2和a3作为特征量。即,神经网络使用的不是x1,x2和x3作为特征量,而是通过自己的学习,得到隐藏层的特征量并加以使用,从而得到一个更好的假设函数。

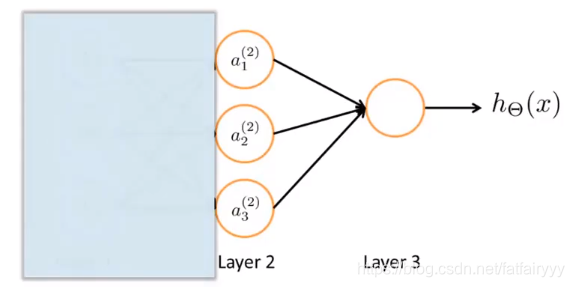

前向传播的其他架构

神经网络架构指的就是不同神经元的连接方式。如上图所示,Layer 1仍称作输入层,Layer 4仍称做输出层,Layer 2和Layer 3为这个网络的两个隐藏层。

应用神经网络的例子

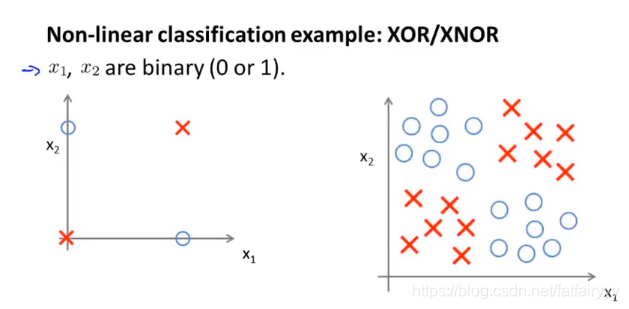

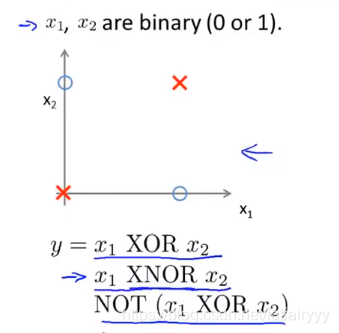

右图为一个复杂的机器学习问题,我们可以视左图为机器学习问题的一个简化版本,其只包括0和1两种结果,且图上只有四个样本点,正负各一个。我们要做的是建立一个非线性的判断边界,来区分正负样本。

更具体的,我们要计算输出函数y = x1 XOR x2 或 x1 XNOR x2(XOR:异或;XNOR:同或),本例中使用同或更好。

现在我们的目标是建立一个能够进行同或运算的神经网络。

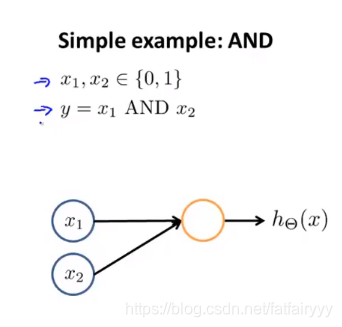

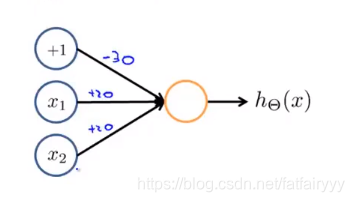

①进行与运算AND的神经网络:

故,怎样得到只含单个神经元的网络,来计算AND函数呢?为了得到期望的结果,加入偏置单元+1并赋值。

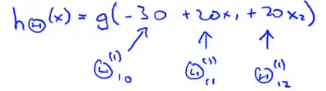

箭头线上的-30表示-30为x0的系数,对应图中的+1单元,下边的两个+20同理。故,hΘ(x) = g( -30 + 20x1 + 20x2 )。

由于输入是二元的,因此可以写出hΘ(x)的值,即AND运算的真值表。

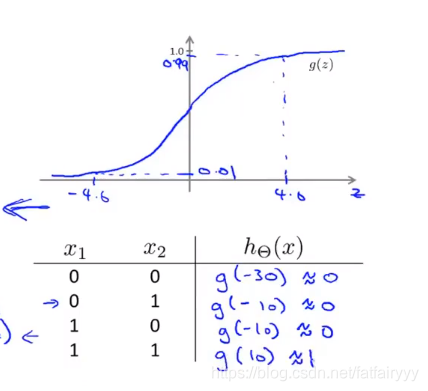

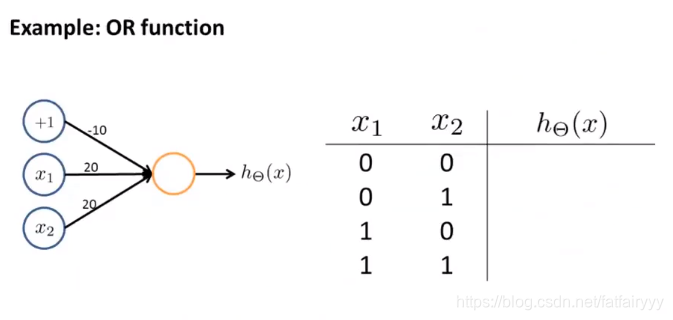

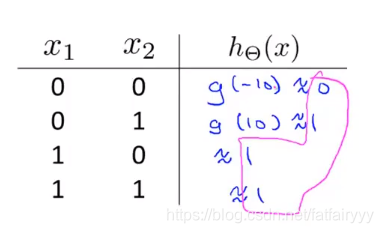

②进行或运算OR的神经网络:

与AND同理,其真值表为:

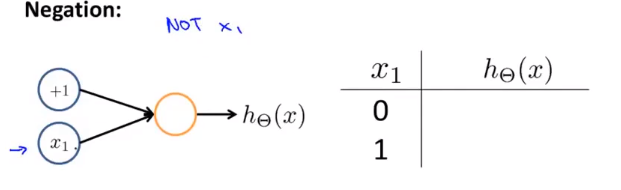

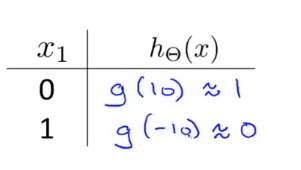

③进行非运算NOT的神经网络:

由于非运算是单目运算符,因此神经网络的输入只有x1和偏置单元+1。

非运算的真值表:

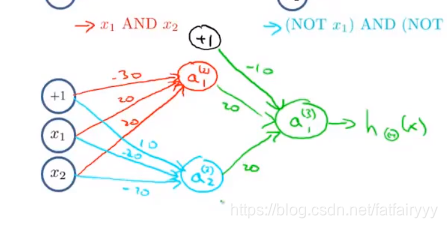

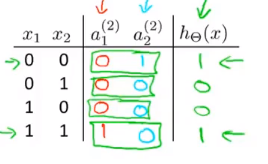

④进行同或运算的神经网络:

神经网络如图所示,第一列权值从上至下为:-30,20,20,10,-20,-20。第二列权权值从上至下为-10,20,20。如此,得到的真值表为:

当输入取值相同时,输出1,反之输出0,实现了同或运算。

418

418

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?