AdaBoost

一种集成元算法,结合弱学习器并根据每个训练样本的“难度”进行调整。

输入

• 数据:输入数据集

- 预处理器:预处理方法

● 学习器:基础学习算法

输出

- 学习器:AdaBoost 学习算法

● 模型:训练好的模型

AdaBoost(全称“自适应增强”)是一个由 Yoav Freund 和 Robert Schapire 提出的机器学习算法,可通过与其他学习算法结合来提升其性能。它通过调整弱学习器的权重实现这一目标。

AdaBoost 适用于分类和回归任务。

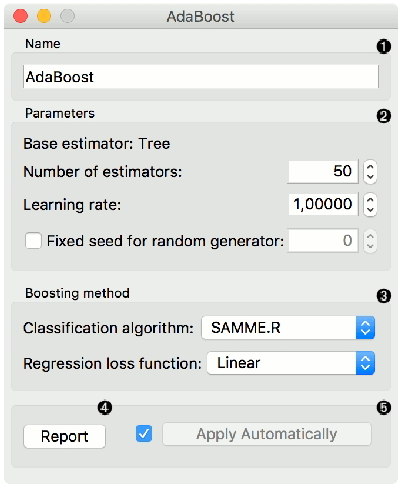

- 命名学习器:可为学习器指定名称(默认名称为“AdaBoost”),该名称将显示在其他组件中。

- 参数设置:

- 基础估计器为树模型,可设置以下参数:

• 估计器数量

● 学习率:控制新信息覆盖旧信息的程度(0=不学习新信息,1=仅考虑最新信息)

• 随机种子:设置固定种子以确保结果可复现。

- 基础估计器为树模型,可设置以下参数:

- 增强方法:

- 分类任务:选

订阅专栏 解锁全文

订阅专栏 解锁全文

76

76

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?