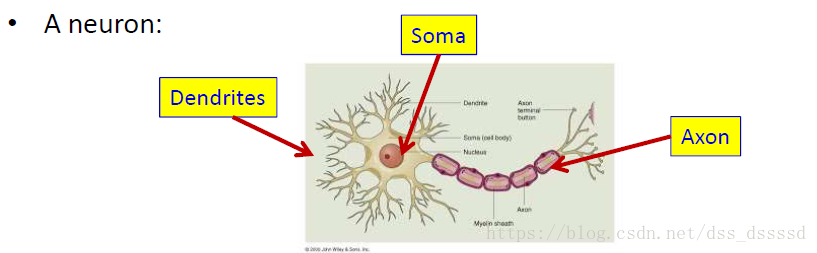

- 神经元结构

- 信号通过树突(dendrites)传入神经元胞体(soma)

- 信号通过轴突(axon)传递给其他的神经元 每个神经元只有一个轴突,成熟的神经元不经过细胞分裂

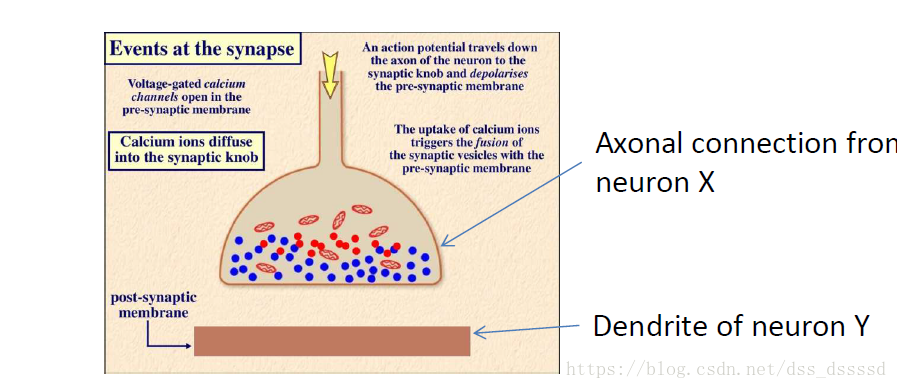

- 如果神经元A重复激励神经元B,那么他激励神经元B的能力会变得更强,在生物学上表现的就是A和B的突触旋钮会变得更大

- 用数学模型表示:

wi=wi+ηxiy w_i = w_i + \eta x_i ywi=wi+ηxiy

wiw_iwi是第iii个输入神经元xix_ixi对输出yyy的权重 - 这个简单的公式是许多机器学习算法得基础

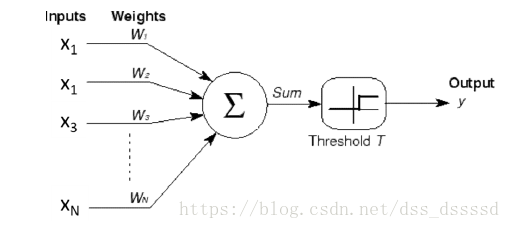

- Rosenblatt’s perceptron

-

输入的线性组合

-

阈值逻辑: 如果输入线性组合之和超过阈值,输出为1

f(n)={1,if ∑iwixi−T>0 0,else f(n)= \begin{cases} 1, & \text {if $\sum_{i}{w_i x_i} - T > 0$ } \\ 0, & \text{else} \end{cases} f(n)={1,0,if ∑iwixi−T>0 else -

提供了学习算法

W→=W→+η(d(x→)−y(x→))x→ \overrightarrow W = \overrightarrow W + \eta(d(\overrightarrow x)- y(\overrightarrow x))\overrightarrow xW=W+η(d(x)−y(x))x- d(x)d(x)d(x)是神经元对于输入xxx的期望输出

- y(x)y(x)y(x)是实际输出

优势:

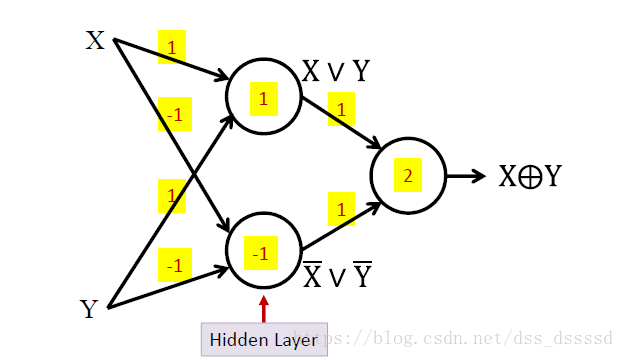

- 可执行布尔任务(非, 或, 与)

- 能够自动更新权值

- 算法可收敛

不能执行异或算法

说明仅有1个神经元完全不够,因而出现了多层感知机(MLP)

本文探讨了神经元的基本结构及信号传递过程,介绍了Rosenblatt的感知机模型,包括其工作原理、学习算法及其局限性。进一步讨论了多层感知机的概念,以及其在分类和模拟连续值函数中的应用。

本文探讨了神经元的基本结构及信号传递过程,介绍了Rosenblatt的感知机模型,包括其工作原理、学习算法及其局限性。进一步讨论了多层感知机的概念,以及其在分类和模拟连续值函数中的应用。

3444

3444

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?