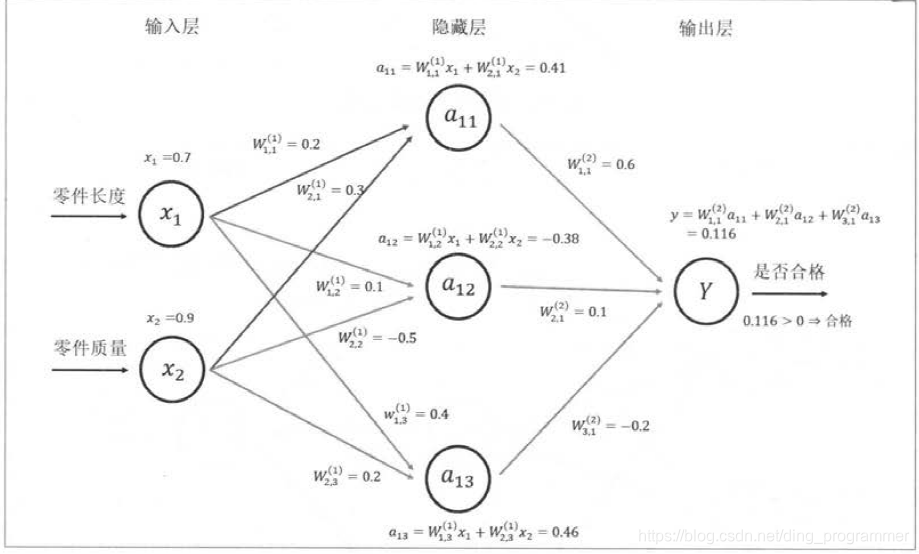

在一个模拟数据集上训练神经网络。下面给出了一个完整的程序来训练神经网络解决二分类问题

这是普通的入门级别的全神经网络

包括 输入层、隐藏层、输出层, 前向传播和后向传播方法

import tensorflow as tf

from numpy.random import RandomState

batch_size=8

w1=tf.Variable(tf.random_normal(([2,3]),stddev=1.0,seed=1) ) # 使用正态分布 生成一个 2行3列的矩阵,

w2=tf.Variable(tf.random_normal(([3,1]),stddev=1.0,seed=1)) # 使用正态分布 生成一个 3行1列的矩阵

x=tf.placeholder(tf.float32,shape=[None,2],name = 'x-input')

y_=tf.placeholder(tf.float32,shape=[None,1],name='y-input') #标准答案

# 前向传播

a=tf.matmul(x,w1)

y=tf.matmul(a,w2)

# 自定义损失函数 反向传播的算法。

y= tf.sigmoid(y)

cross_entropy=-tf.reduce_mean(y_*tf.log(tf.clip_by_value(y,1e-10,1.0))

+(1-y_)*tf.log(tf.clip_by_value(1-y,1e-10,1.0)))

train_step=tf.train.AdamOptimizer(0.001).minimize(cross_entropy)

# 随机生成数据集

rdm=RandomState(1)

dataset_size=128

X=rdm.rand(dataset_size,2)

Y=[ [int (x1+ x2<1)] for (x1,x2) in X]

init_op=tf.global_variables_initializer()

with tf.Session() as sess:

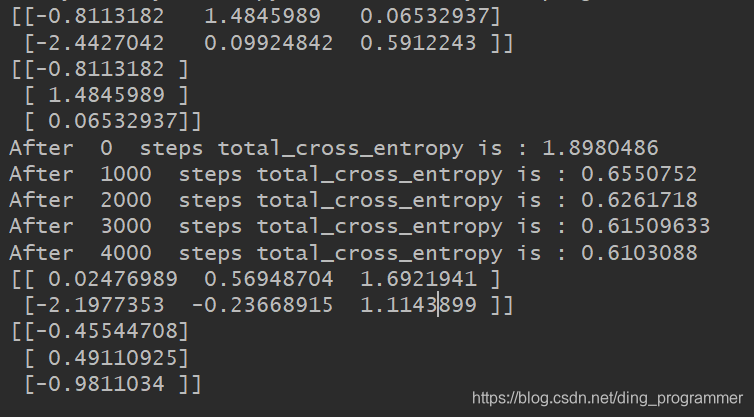

sess.run(init_op)

print(sess.run(w1))

print(sess.run(w2))

STEPS=5000

for i in range(STEPS):

start=(i*batch_size) % dataset_size

end=min(start+batch_size,dataset_size)

sess.run(train_step,feed_dict={x:X[start:end],y_:Y[start:end]})

if i%1000==0:

total_cross_entropy = sess.run(

cross_entropy, feed_dict = {x: X, y_: Y} )

print("After ",i," steps total_cross_entropy is :",total_cross_entropy)

print(sess.run(w1))

print(sess.run(w2))

结果如下:

博客介绍了在模拟数据集上训练神经网络解决二分类问题。给出完整程序,该网络为入门级全神经网络,包含输入层、隐藏层、输出层,采用前向传播和后向传播方法。

博客介绍了在模拟数据集上训练神经网络解决二分类问题。给出完整程序,该网络为入门级全神经网络,包含输入层、隐藏层、输出层,采用前向传播和后向传播方法。

607

607

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?