度量学习DML之Contrastive Loss及其变种_程大海的博客-优快云博客

度量学习DML之Triplet Loss_程大海的博客-优快云博客

度量学习DML之Lifted Structure Loss_程大海的博客-优快云博客

度量学习DML之Circle Loss_程大海的博客-优快云博客

度量学习DML之Cross-Batch Memory_程大海的博客-优快云博客

MixUp

论文:《mixup:Beyond Empirical Risk Minimization》

参考:GitHub - facebookresearch/mixup-cifar10: mixup: Beyond Empirical Risk Minimization

![]()

![]()

其中,![]() 和

和![]() 数两个数据样本,

数两个数据样本,![]() 和

和![]() 是原始的输入数据(如图像矩阵),

是原始的输入数据(如图像矩阵),![]() 和

和![]() 是

是![]() 和

和![]() 对应所属类别的one-hot编码,

对应所属类别的one-hot编码,![]() ,

,![]() ,

,![]() 用来控制mix的强度。

用来控制mix的强度。

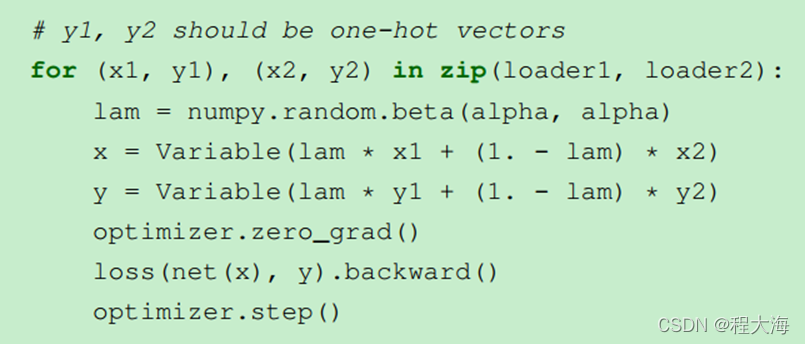

Mixup的Pytorch代码实现实例如下,mixup的官方实现代码中关于![]() 的计算以及loss的计算与下图有所不同。

的计算以及loss的计算与下图有所不同。

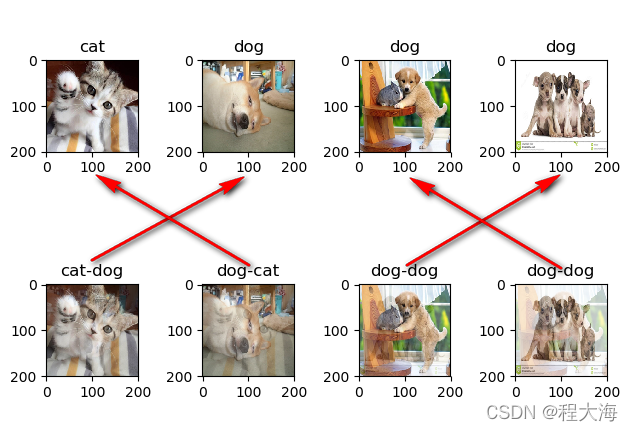

下面看一下mixup在猫狗数据集上的mix效果:

上图中,第一行是原始数据,第二行是对第一行数据进行随机mix之后的数据,第二行的第一幅图就是将第一行的第一幅图和第二幅图进行mix之后得到的。

3273

3273

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?