简介

最优化—“依照给定条件和目标,从众多方案中选择最佳方案以达到最优目标”

在本课程中,用于求就最小或极小值问题。

内容

线性规划、非线性规划、约束优化、无约束优化等,并对如何建立数学模型、如何选择优化方法和提高优化效率。

要求

- 掌握最优化理论的基本概念;无约束优化的基本理论;约束优化的基本理论及线性规划的基本理论

- 熟悉并掌握上述问题所涉及到的优化算法

- 学习并使用优化软件且实现某些算法

参考书目

《最优化计算方法》陈开周编

《最优化理论与算法》陈宝林编

《最优化理论与方法》袁亚湘等编

第一章

最优化问题的两大要素:①可能的方案;②要追求的目标。

②为①的函数,如果①与时间无关就称为静态最优化问题,否则称为动态最优化问题。

此课程基本是静态最优化问题。

引入:0.618 黄金分割比

介绍黄金分割比的应用

历史:

- 17 世纪,Newton & Leibniz 提出了函数的极值问题;后来出现了Lagrange乘数法

- 1847年,Cauchy研究了函数值沿什么方向下降最快的问题,提出了最速下降法;

- 1939年,苏联数学家提出解决下料问题和运输问题这两种线性规划问题的求解方法;

- 1947年,Dantzig 提出解线性规划问题的单纯形法,被称为“20世纪最伟大的创作之一”;

- 1948年,Fritz John 提出最优性条件;

- 1951年,Kuhn和Tucher 提出最优性条件,完成了非线性规划的基础工作;

研究对象:

①由实际生产或科技问题形成最优化的数学模型

②对所形成的最优化数学模型进行数学加工和求解

一般形式:

目标函数:min f(xi,yj,δk)

约束条件:s.t. gl(xi,yj,δk) >= (=,<=) 0 , l=1,2,……,m

一般考虑求极小min,如果是求极大max可以求min(-f)

几个具体题目:ppt 1.2

例2.1 把半径为1的实心金属球熔化后,铸成一个实心圆柱体,问圆柱体取什么尺寸才能使它的表面积最小?

S=6π(2/3)^2/3

例2.2(多参数曲线拟合问题)已知两个物理量x和y之间的依赖关系为:

其中a1,a2,a3,a4和a5为待定参数,为确定这些参数,对x、y测得m个实验点(x1,y1),(x2,y2),…, (xm,ym).试将确定参数的问题表示成最优化问题.

例2.3 现有一批某种型号的圆钢长8米,需要截取2.5米长的毛坯100根,长1.3米的毛坯200根。问如何才能既满足需要,又能使总的用料最少?

设按方案Ⅰ、Ⅱ、Ⅲ、Ⅳ下料的原材料根数分别为xj( j=1,2,3,4), 可列出下面的数学模型:

例2.4 有一旅行团从v0出发要遍游城市v1,v2,…,vn,已知从vi到vj的旅费为cij,问应如何安排行程使总费用最小?

变量—是否从i第个城市到第j个城市,xij=1,0

约束—每个城市只能到达一次、离开一次,

目标—总费用最小

例2.5.(混合饲料配合)以最低成本确定满足动物所需营养的最优混合饲料。设每天需要混合饲料的批量为100磅,这份饲料必须含:至少达到0.8%而不超过1.2%的钙;至少22%的蛋白质;至多5%的粗纤维。假定主要配料包括石灰石、谷物、大豆粉。这些配料的主要营养成分为:

设x1,x2,x3 是生产100磅混合饲料所须的石灰石、谷物、

大豆粉的量(磅)。

优化问题的分类:

无约束优化问题: min f(x) x∈R^n

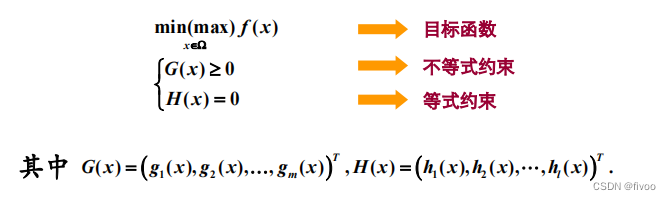

约束优化问题:

向量形式:

等式约束通常可用不等式约束表示出来,有时Ω ≡ R^n。

优化问题的标准型:

一般都会把优化问题转化为标准型,max=>min

H(x)=0 => H(x)>=0

H(x)<=0 => -H(x)>=0

根据函数类型分类:

- 线性规划:目标函数、约束条件都是线性的

- 非线性规划:目标函数、约束条件中的函数不全是线性的

- 二次规划:目标函数为二次函数,约束条件中的函数为线性的

根据函数性质分类:

- 动态与静态

- 随机与确定

- 单目标与多目标

概念

极小点:

其中D为可行域或者说定义域,约束条件所限定的域

局部极小点:D与x*的邻域的交集上有f(x)>=f(x*),

有可能只有x*这一个点;

严格局部极小点:D与x*的邻域的交集且把x* 除去,上有f(x)>f(x*),说明除了x* 还有其他点严格大于f(x*);

全局极小点(最优解):在整个可行域D上都满足f(x)>=f(x* ), 但是有可能整个可行域只有x*一个点;

严格全局极小点(最优解):在整个可行域D上,且不包含x* ,都满足f(x)>f(x* );

定理:

- 问题( P )的任意全局极小点必为局部极小点

- 若目标函数f(x)和约束函数gi(x)均为定义在Rn上的连续函数,则

- 问题( P )的可行集D为闭集

- 问题( P ) 的最优解集合为闭集

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?